Clear Sky Science · pt

Colaboração humano–modelos de linguagem de grande porte na medicina clínica: revisão sistemática e meta‑análise

Por que isso importa para a assistência médica cotidiana

Médicos estão cada vez mais recorrendo a chatbots de IA poderosos, chamados modelos de linguagem de grande porte, para ajudá‑los a raciocinar sobre casos complexos, redigir anotações e interpretar exames. Este estudo faz uma pergunta simples, porém crucial: quando médicos se unem a essas ferramentas, os pacientes realmente se beneficiam? Ao reunir resultados dos melhores ensaios disponíveis, os autores mostram que a resposta é mais complicada do que o hype sugere — às vezes a parceria ajuda, às vezes faz pouca diferença e, em algumas situações, pode até atrapalhar.

O que os pesquisadores analisaram

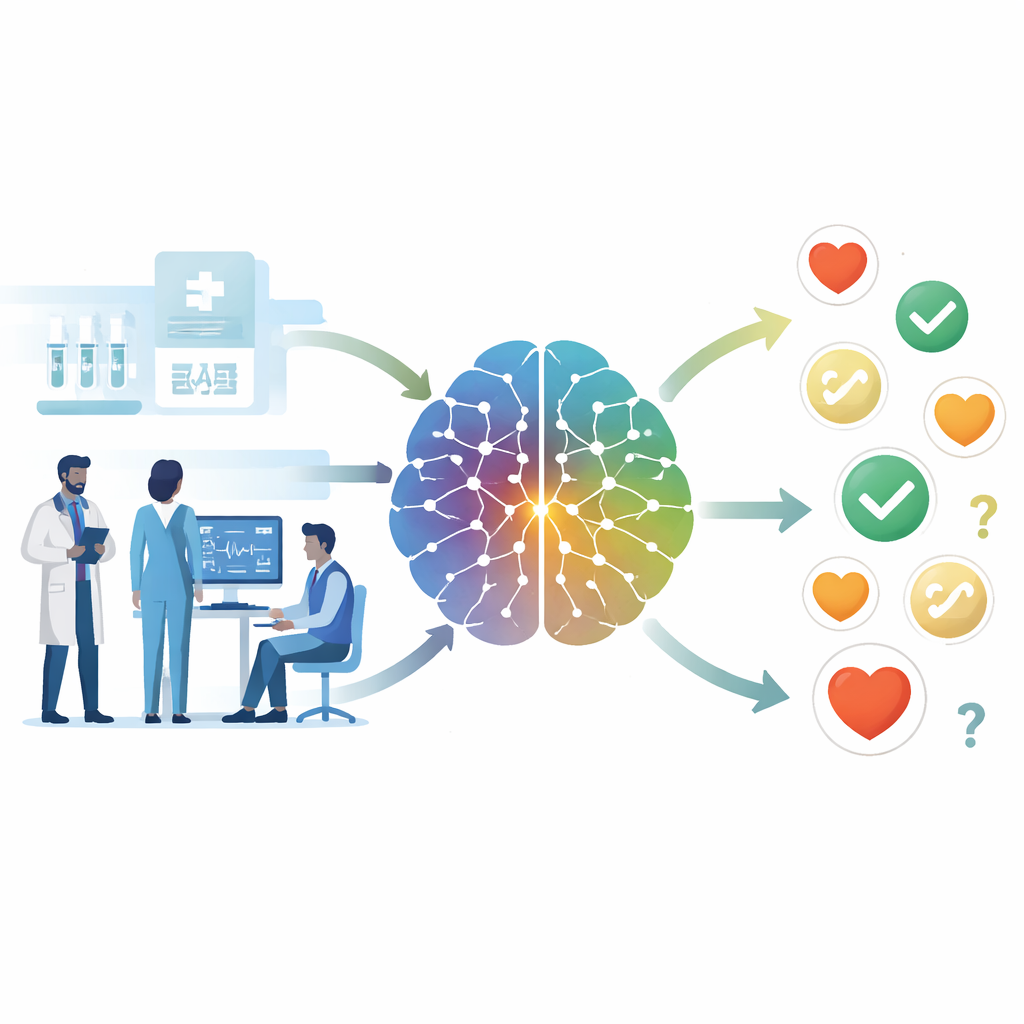

A equipe pesquisou sistematicamente grandes bases de dados médicas em busca de estudos nos quais clínicos atuaram com ou sem ajuda de um sistema de IA baseado em modelos de linguagem de grande porte, como o GPT‑4. Para ser incluído, um estudo teve de comparar diretamente um fluxo de trabalho “médico + IA” com o atendimento usual pelos médicos sozinhos e, em alguns casos, também com a IA atuando isoladamente. As tarefas clínicas abrangeram uma gama de problemas reais: identificar o que poderia estar errado em um paciente criticamente doente, interpretar exames cerebrais, redigir e ler anotações de clínica e decidir como gerir dor torácica e outras queixas comuns. No total, 10 ensaios revisados por pares formaram a espinha dorsal da análise, com alguns preprints adicionais usados apenas para verificar a robustez das conclusões.

Como as equipes médico–IA se saíram

Nestes estudos, parear médicos com IA mostrou pequenas, mas perceptíveis, melhorias em algumas medidas de qualidade diagnóstica e de manejo. Em dois ensaios randomizados que usaram sistemas de pontuação detalhados para decisões de caso, as equipes médico–IA tiveram pontuações cerca de cinco pontos percentuais superiores às dos médicos sozinhos. Em termos simples, se médicos trabalhando sozinhos tomassem cerca de 100 decisões-chave, adicionar IA poderia evitar aproximadamente cinco dessas decisões erradas. Contudo, os autores ressaltam que os dados subjacentes são escassos: apenas alguns ensaios contribuíram para essas estimativas, e a variedade de resultados plausíveis no mundo real é ampla o bastante para incluir ausência de benefício — ou até dano — em outros contextos.

Velocidade, documentação e erros ocultos

Muitos esperam que a IA libere tempo dos médicos. Aqui, as evidências foram pouco impressionantes. Ao combinar três ensaios que mediram a duração das tarefas, os pesquisadores encontraram essencialmente nenhuma economia de tempo global. Em alguns exercícios simulados, os médicos foram um pouco mais rápidos com a IA; em um estudo em clínica real, o efeito líquido no tempo da consulta foi quase zero, embora alguns subgrupos tenham apresentado ganhos modestos. A documentação trouxe um quadro igualmente “misto”. A assistência por IA frequentemente tornou as anotações mais claras e estruturadas, e ajudou não especialistas a entender melhor relatórios técnicos de oftalmologia. Ainda assim, quando os pesquisadores verificaram os fatos, descobriram que cerca de uma em cada três anotações assistidas por IA ainda continha erros. Essa divisão — registros com aparência melhor, mas que podem estar errados — suscita preocupações claras de segurança.

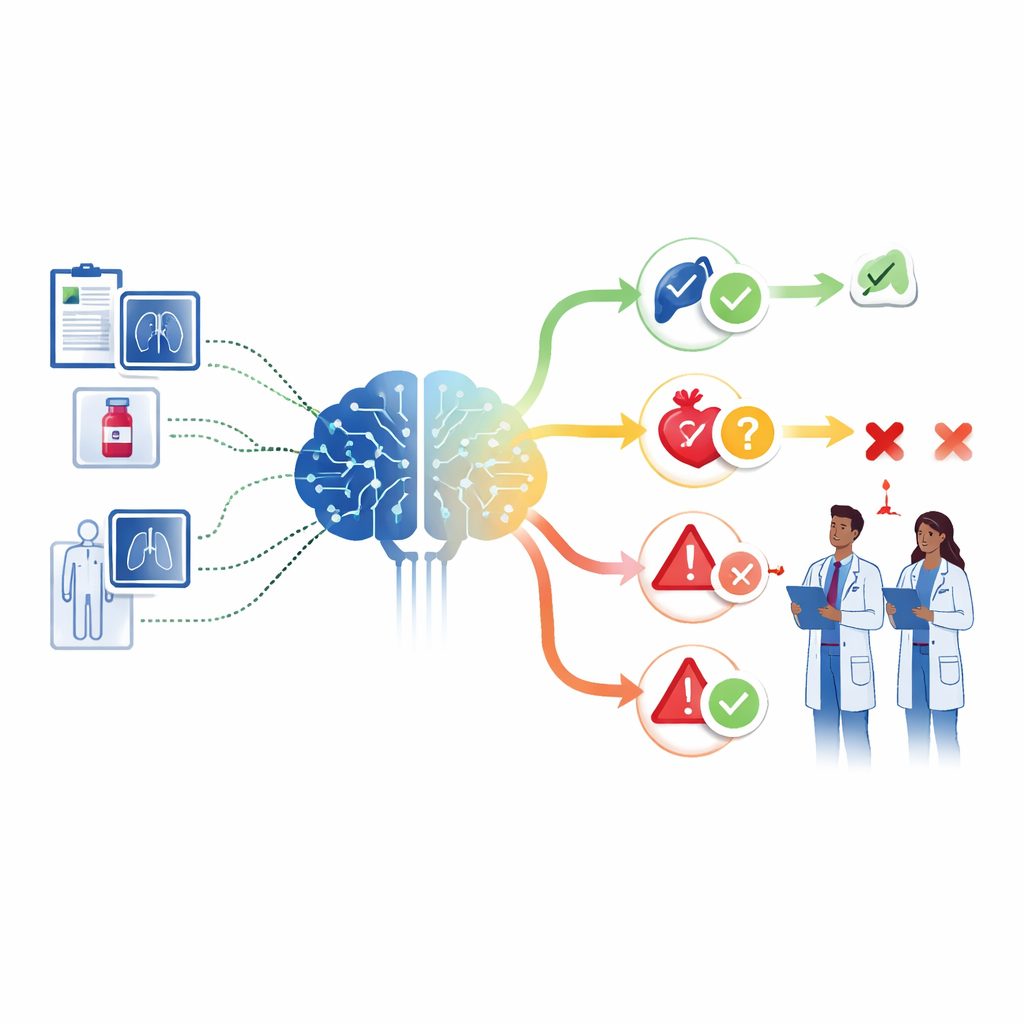

Quando a parceria não supera a máquina

Um achado marcante veio de ensaios que também testaram a IA isoladamente. Em um estudo com pacientes criticamente doentes, a IA por si só teve desempenho equivalente ao da equipe médico–IA, e melhor do que muitos médicos atuando sozinhos. Em outro, relatórios de exames gerados pela IA foram claramente piores do que os produzidos por especialistas humanos, seja com a IA atuando como assistente ou não. Juntos, esses resultados expõem o que os autores chamam de “paradoxo da colaboração”: inserir um humano no fluxo de trabalho não garante uma melhoria sobre uma IA forte e, em algumas situações, a parceria pode diluir os pontos fortes de ambos. Fatores como a forma de apresentação do conselho, o grau de confiança ou desconfiança dos médicos nele e a integração da ferramenta no fluxo de trabalho diário influenciam se a colaboração ajuda ou atrapalha.

O que isso significa para o futuro das equipes médico–IA

No conjunto, a revisão pinta um quadro de promessa cautelosa em vez de uma revolução já consumada. Equipes médico–IA podem melhorar modestamente certas pontuações de decisão e tornar a redação médica mais fácil de ler, mas não economizam tempo de forma confiável e ainda geram um número preocupante de erros factuais. Os autores defendem que os sistemas de saúde implementem essas ferramentas de forma gradual, com salvaguardas robustas que se concentrem em detectar erros em vez de apenas aumentar eficiência. Também pedem ensaios clínicos maiores e em cenários reais, que testem a assistência por IA em hospitais e clínicas movimentados, não apenas em simulações controladas de casos. Até que evidências assim estejam disponíveis, o caminho mais seguro é tratar os modelos de linguagem de grande porte como assistentes poderosos, porém falíveis — e projetar fluxos de trabalho em que os clínicos atuem como revisores críticos e guardiões, não como aceitores passivos dos conselhos da IA.

Citação: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

Palavras-chave: colaboração humano–IA, suporte à decisão clínica, modelos de linguagem de grande porte, precisão diagnóstica, documentação médica