Clear Sky Science · pt

Escalando a ciência regulatória de dispositivos médicos usando grandes modelos de linguagem

Por que isso importa para pacientes e médicos

A medicina moderna está rapidamente se preenchendo com dispositivos “inteligentes” que usam inteligência artificial para ler exames, monitorar sinais vitais e ajudar médicos na tomada de decisões. Só nos Estados Unidos, mais de mil dessas ferramentas já foram liberadas ou aprovadas pela Food and Drug Administration (FDA). Cada dispositivo deixa um rastro documental de relatórios complexos e registros de segurança. Hoje, a maior parte dessa informação ainda é peneirada manualmente, o que é lento, caro e rapidamente fica defasado. Este artigo investiga se grandes modelos de linguagem — o mesmo tipo de IA por trás de chatbots avançados — podem ler esses documentos em escala de forma confiável e transformá‑los em dados utilizáveis para ajudar reguladores, pesquisadores e o público a entender quão bem esses dispositivos são construídos e quão seguros eles se comportam.

O problema do excesso de documentos complexos

Cada dispositivo médico com IA vem acompanhado de resumos de decisão volumosos, relatórios de segurança e avisos de recall. Esses documentos são longos, escritos em jargão denso e frequentemente incluem tabelas, imagens e formatações inconsistentes. Pesquisas anteriores mostraram que responder a perguntas básicas — como como um dispositivo foi testado antes da aprovação, ou o que exatamente deu errado quando houve uma falha — exigiu equipes de especialistas lendo centenas de PDFs linha a linha. Ferramentas simples de busca e correspondência de padrões conseguem encontrar detalhes óbvios, como números de identificação, mas têm dificuldade com questões mais profundas que exigem julgamento, como se um estudo foi conduzido em vários hospitais ou se um dispositivo realmente contribuiu para a lesão ou morte de um paciente. À medida que o número de dispositivos com IA explodiu, essa abordagem manual tornou‑se impossível de acompanhar.

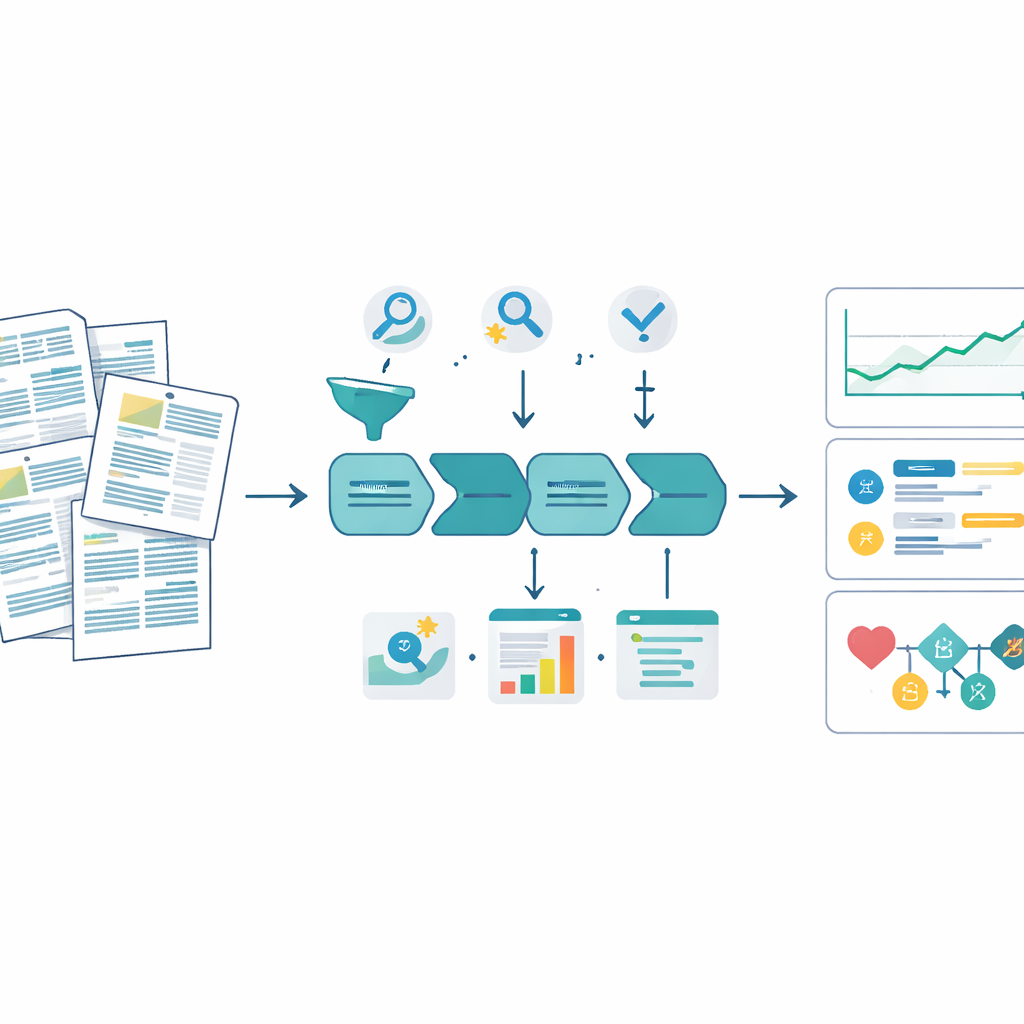

Um fluxo de trabalho de IA que lê como um especialista

Os autores construíram um fluxo de trabalho geral baseado em um grande modelo de linguagem de última geração para enfrentar esse desafio. Primeiro, reuniram todos os resumos de decisão e relatórios de segurança disponíveis publicamente da FDA para 1.247 dispositivos de IA ou aprendizado de máquina e 1.852 relatórios de eventos adversos relacionados até meados de 2025, limpando os PDFs e usando reconhecimento óptico de caracteres quando necessário. Em seguida, em vez de pedir ao modelo para responder a perguntas amplas de uma só vez, dividiram o trabalho em subtarefas menores e bem definidas. Para cada tipo de documento, o modelo recebeu instruções detalhadas fundamentadas nas orientações oficiais da FDA, além de exemplos de como humanos rotulariam as informações. Pediu‑se ao modelo que raciocinasse passo a passo e que produzisse suas respostas em um formato estrito e estruturado, transformando texto livre em campos claros como “número de locais do estudo”, “tipo de evento de segurança” ou “tipo de alteração do dispositivo”.

Verificando a precisão em questões regulatórias reais

Para avaliar se esse sistema podia ser confiável, a equipe conduziu três estudos de caso nos quais pesquisadores anteriores já haviam passado meses em revisão manual. Primeiro, revisitaram como os dispositivos são testados antes da aprovação, perguntando se os ensaios foram conduzidos prospectivamente (coletando dados prospectivamente) e se envolveram múltiplos hospitais. Comparando as saídas do modelo com rótulos de especialistas, observaram taxas de concordância frequentemente acima de 80 a 90 por cento, comparáveis à concordância entre anotadores humanos. Em segundo lugar, usaram o modelo para re‑rotular relatórios de segurança descrevendo falhas, lesões ou mortes, e para classificar o que deu errado com o dispositivo. Quando revisores humanos compararam os códigos originais do fabricante com os sugeridos pelo modelo — sem saber qual era qual — preferiram as escolhas do modelo na grande maioria das vezes, especialmente para categorias sensíveis como morte versus falha. Terceiro, os pesquisadores vincularam detalhes de documentos pré‑aprovação a relatórios de segurança posteriores para explorar quais escolhas iniciais — como escolher um dispositivo predecessor com recalls anteriores ou fazer grandes alterações de hardware — estavam estatisticamente ligadas a maior risco de problemas futuros.

O que as descobertas revelam sobre segurança e supervisão

Uma vez validado, o fluxo permitiu à equipe escalar essas análises de dezenas de dispositivos para toda a população conhecida de ferramentas médicas com IA. Eles descobriram, por exemplo, que avaliações clínicas prospectivas permaneceram relativamente raras ao longo de três décadas, rondando cerca de um em cada dez dispositivos, enquanto as menções a testes em múltiplos locais cresceram substancialmente. Nos relatórios de segurança, o modelo revelou padrões em que o tipo de problema descrito no texto não correspondia ao código enviado à FDA — por exemplo, situações em que falhas de hardware foram rotuladas como problemas de qualidade de imagem. Ao vincular características pré‑aprovação a eventos de segurança posteriores, dispositivos cujos predecessores já tinham recalls ou histórico de eventos adversos mostraram riscos muito maiores de novos relatórios, enquanto dispositivos respaldados por testes clínicos tendiam a ter risco menor. Esses resultados são exploratórios, mas ilustram os tipos de perguntas que agora podem ser feitas rotineiramente em vez de como projetos pontuais.

Limites, salvaguardas e o caminho à frente

Os autores enfatizam que sua abordagem não é infalível e não deve substituir o julgamento de especialistas. Precisão em torno de 80 por cento pode ser mais do que suficiente para analisar tendências de alto nível, mas não para tomar decisões sobre qualquer dispositivo ou paciente individual. O desempenho pode variar entre tipos de dispositivo e anos, e a qualidade dos documentos da FDA e das bases de dados de segurança subjacentes continua sendo um gargalo importante. Ainda assim, este estudo mostra que sistemas de modelos de linguagem cuidadosamente projetados podem transformar montanhas de texto regulatório não estruturado em dados estruturados e auditáveis em dias em vez de anos. Para leitores leigos, a conclusão é que as mesmas tecnologias de IA que alimentam chatbots de consumo também podem ajudar fiscais e pesquisadores a rastrear como dispositivos médicos com IA são construídos, testados e monitorados — potencialmente levando à detecção mais rápida de problemas e a melhores evidências para moldar regras e produtos mais seguros.

Citação: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

Palavras-chave: dispositivos médicos com IA, ciência regulatória, grandes modelos de linguagem, relatórios de segurança da FDA, supervisão de tecnologia em saúde