Clear Sky Science · pt

Modelagem da incerteza na análise multimodal da fala ao longo do espectro da psicose

Ouvindo pistas ocultas na fala do dia a dia

A psicose costuma ser pensada como algo súbito e dramático—vozes, visões e uma ruptura com a realidade. Mas muito antes de uma crise, mudanças sutis podem surgir na forma como as pessoas falam: o tom de voz, a escolha de palavras e até o ritmo das frases. Este estudo investiga se computadores conseguem detectar esses sinais tênues na fala e, o que é crucial, dizer quão confiantes estão no que ouvem. Ao fazer isso, o trabalho aponta para ferramentas futuras que podem ajudar clínicos a acompanhar a saúde mental de forma mais objetiva e personalizar o cuidado ao longo de todo o espectro, desde risco leve até doença manifesta.

Da conversa informal às entrevistas clínicas

Os pesquisadores gravaram a fala de 114 voluntários de língua alemã cobrindo o espectro da psicose: pessoas com transtornos psicóticos iniciais e pessoas sem diagnóstico, mas com níveis baixos ou altos de traços semelhantes à psicose (conhecidos como esquizotipia). Cada pessoa realizou quatro tipos de tarefas de fala, desde entrevistas clínicas estruturadas até relatos autobiográficos mais livres, narração de imagens e conversas cotidianas. Esses diferentes contextos importam porque uma entrevista rigidamente guiada pode revelar certos sintomas, como embotamento emocional, enquanto narrativas abertas podem expor pensamentos dispersos ou percepções incomuns. Ao amostrar vários contextos, a equipe pôde avaliar quão de forma confiável a fala sinalizava sintomas em situações semelhantes às do mundo real.

Ouvindo tanto como falamos quanto o que dizemos

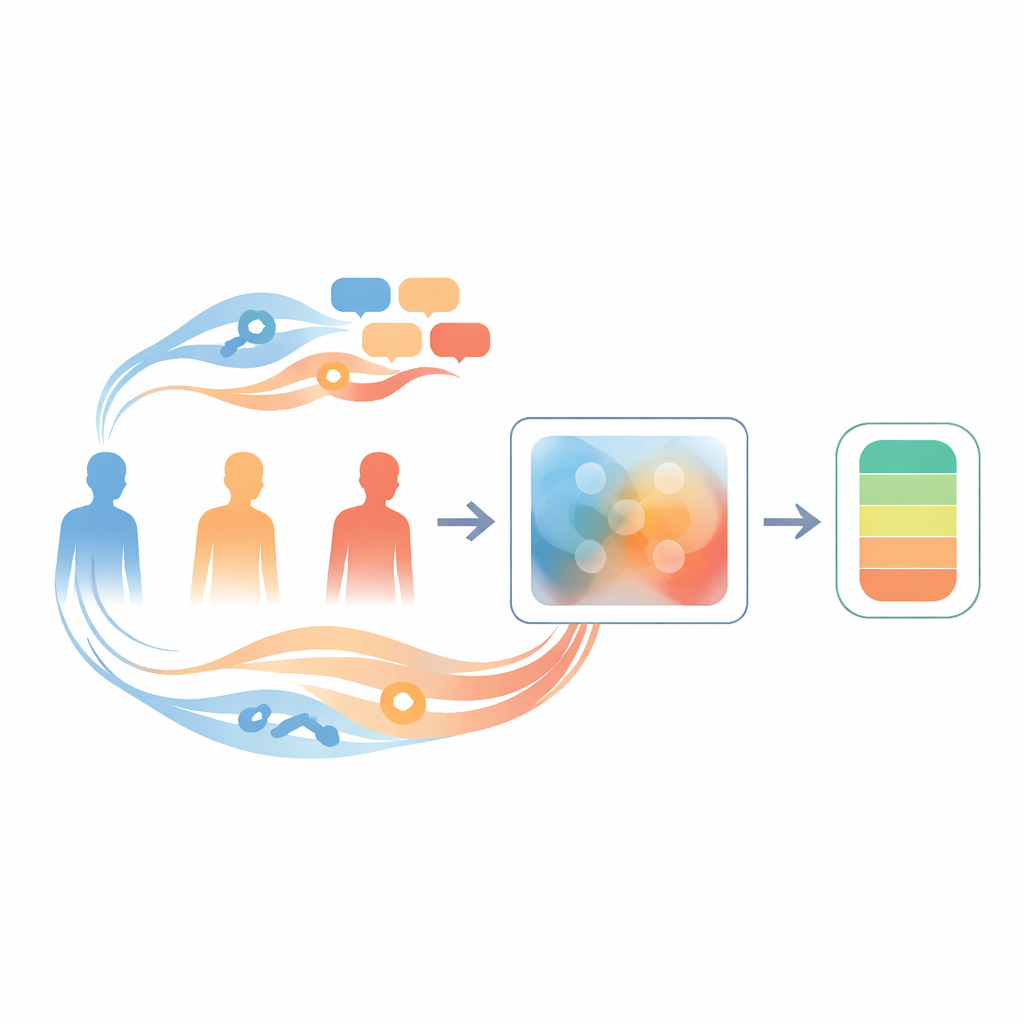

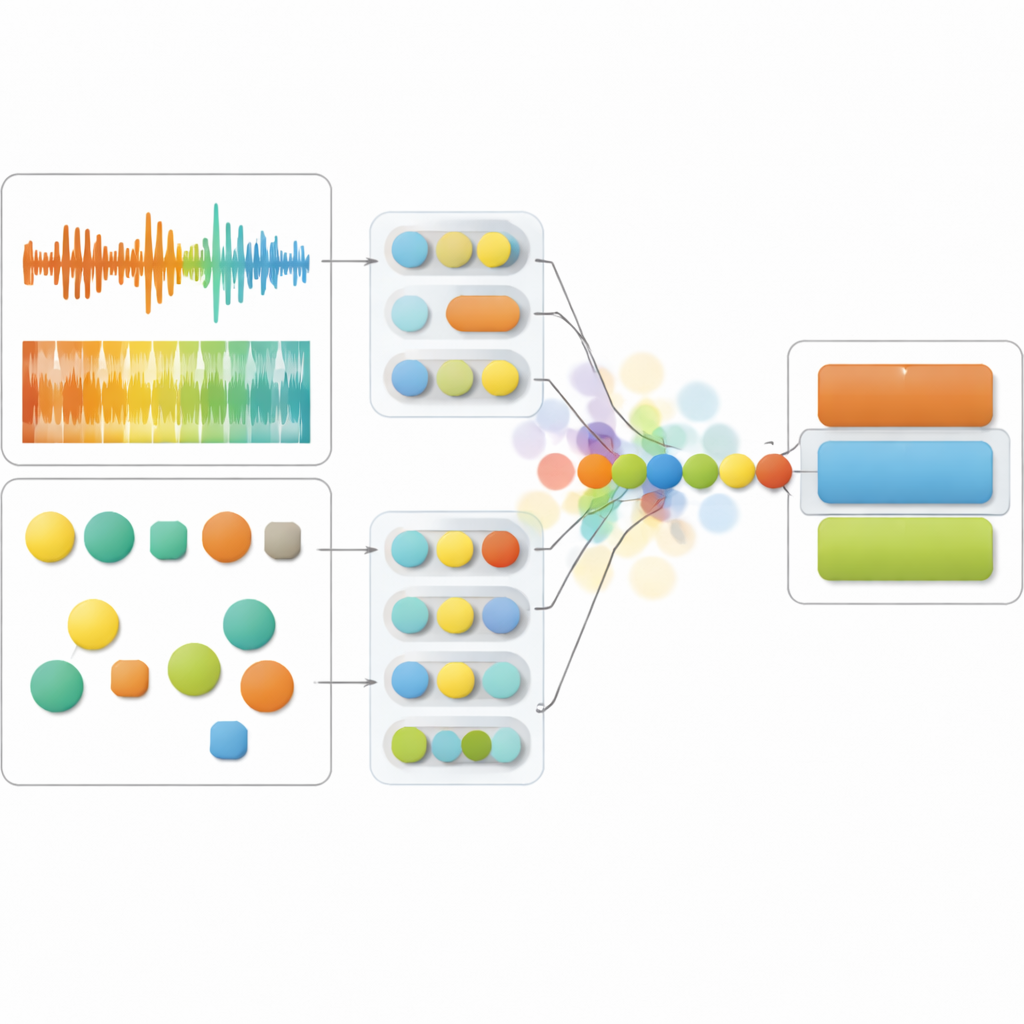

O sistema do estudo escuta duas facetas da fala ao mesmo tempo. No lado sonoro, acompanha características como variações de pitch, intensidade e a estrutura fina da voz, que juntas capturam expressividade, tensão e fluência. No lado linguístico, analisa as próprias palavras—o quão emocionais são, se se concentram em percepções ou conexões sociais e quão coerentes parecem. Redes neurais avançadas, originalmente treinadas em grandes coleções de áudio e texto, convertem esses sinais brutos em impressões numéricas compactas. O modelo central então funde essas impressões ao longo do tempo para que possa julgar, momento a momento, qual canal—som ou linguagem—oferece a pista mais confiável sobre o estado mental da pessoa.

Ensinando o modelo a admitir quando está inseguro

O que diferencia este trabalho é que o modelo não entrega apenas uma previsão; ele também estima sua própria incerteza. Em vez de tratar os fluxos de áudio e texto como fixos, representa-os como nuvens de probabilidade que podem se expandir quando os dados estão ruidosos ou fora do comum. Se a gravação de voz estiver distorcida ou a pessoa falar de forma inaudível, o sistema reduz o peso do som e confia mais nas palavras. Se a transcrição for pouco confiável ou a fala estiver extremamente fragmentada, faz o contrário. Essa fusão consciente da incerteza, chamada Temporal Context Fusion, alcançou desempenho sólido: distinguiu os grupos de baixa esquizotipia, alta esquizotipia e psicose inicial com F1-score de 83% e mostrou confiança bem calibrada, ou seja, a certeza declarada correspondia de perto à frequência com que estava realmente correta.

Padrões de fala que refletem diferentes tipos de sintomas

Ao investigar o funcionamento interno do modelo, os pesquisadores identificaram quais aspectos da fala mais consistentemente acompanhavam diferentes dimensões sintomáticas. Pessoas com sintomas positivos mais intensos—como experiências incomuns ou ideias delirantes—tenderam a apresentar pitch mais alto e mais variável, mudanças rápidas no espectro da voz e maiores oscilações de intensidade, especialmente em narrativas abertas. Sua linguagem também continha muitas palavras de percepção (ligadas a ver, ouvir ou sentir) e termos carregados emocionalmente. Em contraste, pessoas com sintomas negativos mais pronunciados—como retraimento social e embotamento emocional—falavam de forma mais monótona, com pitch restrito e articulação menos flexível, e usavam menos palavras de emoção positiva e termos sociais. Traços desorganizados, tanto em pacientes quanto em voluntários de alta esquizotipia, manifestaram-se como intensidade instável, hesitações e linguagem fragmentada repleta de palavras relacionadas a risco e processos cognitivos, sugerindo esforço mental sem estrutura clara.

Por que isso importa para o cuidado futuro da saúde mental

Em conjunto, os achados mostram que a fala carrega traços mensuráveis relacionados à psicose mesmo em pessoas sem doença clínica, e que esses traços mudam conforme a situação de fala. O modelo consciente da incerteza foi capaz de aproveitar som e linguagem para acompanhar características positivas, negativas e desorganizadas ao longo de um continuum, ao mesmo tempo em que sinalizava quando suas evidências eram fracas. Para um público leigo, a ideia central é que uma escuta cuidadosa—amplificada por IA que conhece seus próprios limites—poderia, eventualmente, ajudar clínicos a monitorar a saúde mental com mais objetividade, reduzir suposições e detectar mudanças relevantes mais cedo. Em vez de substituir o julgamento humano, tais ferramentas poderiam funcionar como um segundo par de ouvidos, destacando padrões na fala cotidiana que merecem atenção mais próxima.

Citação: Rohanian, M., Hüppi, R., Nooralahzadeh, F. et al. Uncertainty modeling in multimodal speech analysis across the psychosis spectrum. npj Digit. Med. 9, 218 (2026). https://doi.org/10.1038/s41746-025-02309-3

Palavras-chave: psicose, análise de fala, aprendizado de máquina, avaliação da saúde mental, IA multimodal