Clear Sky Science · pt

Um conjunto de vision e swin transformers com explicações baseadas em LLM para diagnóstico de doenças em folhas de cana-de-açúcar

Por que identificar folhas doentes de cana-de-açúcar é importante

A cana-de-açúcar é uma cultura fundamental para açúcar, biocombustíveis e muitos meios de subsistência rurais, mas suas folhas são vulneráveis a diversas doenças que corroem a produtividade de forma silenciosa. Os agricultores normalmente dependem da inspeção visual, que pode ser lenta, inconsistente e difícil de escalar em grandes áreas. Este artigo investiga como a inteligência artificial moderna pode ler automaticamente fotos de folhas para detectar múltiplas doenças da cana com alta acurácia e, em seguida, usar um modelo de linguagem para transformar essas previsões em recomendações em linguagem simples para os agricultores.

Como as fotos das folhas viram dados

Os pesquisadores construíram seu sistema usando uma coleção pública de imagens de folhas de cana no Kaggle, contendo quase vinte mil fotos coloridas. Cada imagem pertence a uma das seis categorias: saudável ou uma das cinco doenças comuns, incluindo Bacterial Blight (mancha bacteriana), Mosaic (mosáico), Red Rot (podridão vermelha), Rust (ferrugem) e Yellow Leaf Disease (amarelamento foliar). As fotos foram tiradas em condições reais de campo, portanto incluem variações de iluminação, sombras e fundos confusos. Para preparar os dados, a equipe removeu duplicatas e imagens corrompidas, e então dividiu o conjunto em treino, validação e teste, mantendo o mesmo equilíbrio de tipos de doença em cada parte. Durante o treinamento, eles aumentaram apenas as imagens de treino com rotações, espelhamentos e zooms para imitar diferentes ângulos e distâncias de câmera, tornando o sistema mais robusto sem inflar seu desempenho no teste.

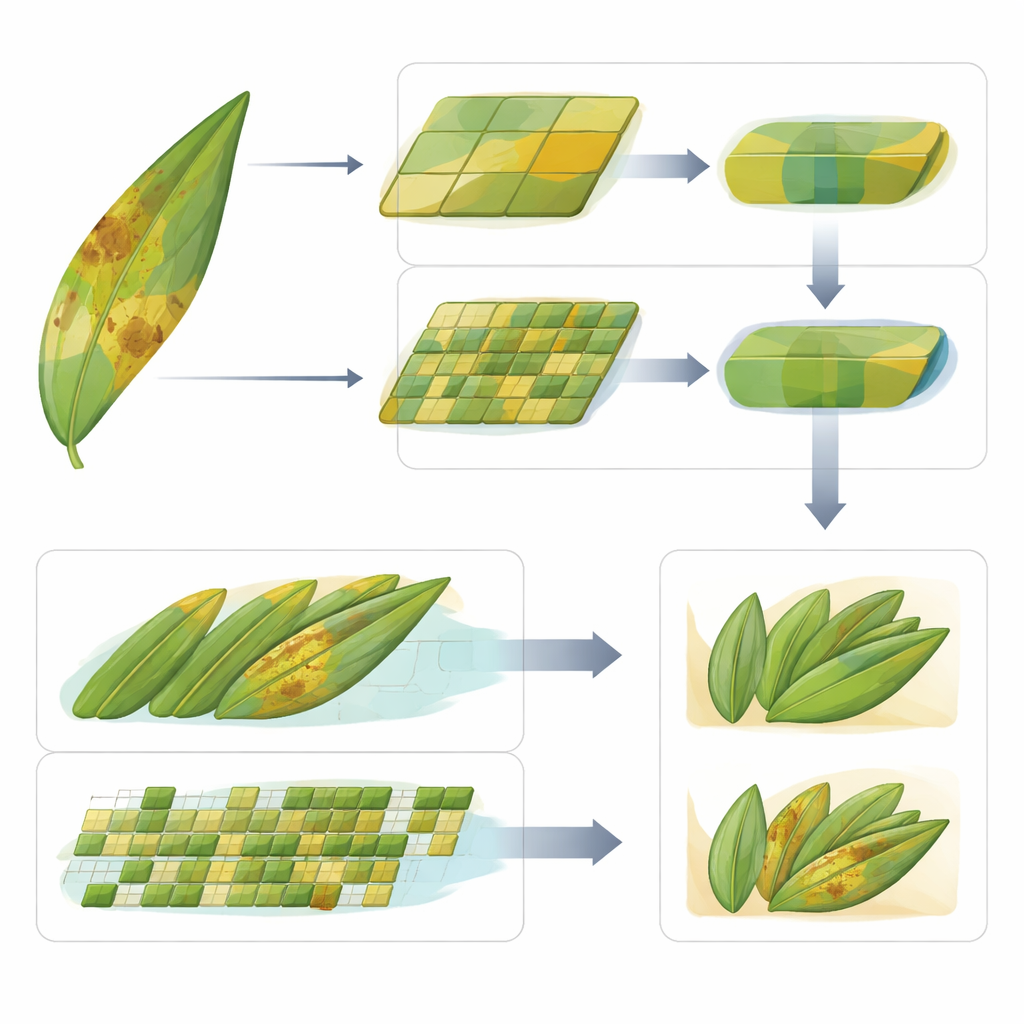

Duas maneiras complementares de olhar uma folha

No cerne do estudo está um “ensemble” que combina dois modelos avançados de visão conhecidos como transformers. Um, o Vision Transformer (ViT), vê cada imagem como um conjunto de patches e aprende padrões ao longo de toda a folha de uma só vez. Essa visão global é adequada para doenças que se espalham como áreas grandes e difusas de descoloração. O outro, chamado Swin Transformer, trabalha com janelas menores e sobrepostas que percorrem a imagem, construindo uma compreensão em camadas de texturas finas e pequenas manchas. Esse foco local ajuda com doenças que aparecem como pequenas lesões, estrias ou pontuações. Por design, o ViT é sensível a mudanças amplas de cor enquanto o Swin presta atenção a detalhes pequenos e agrupados — duas facetas de como doenças reais nas folhas se manifestam no campo.

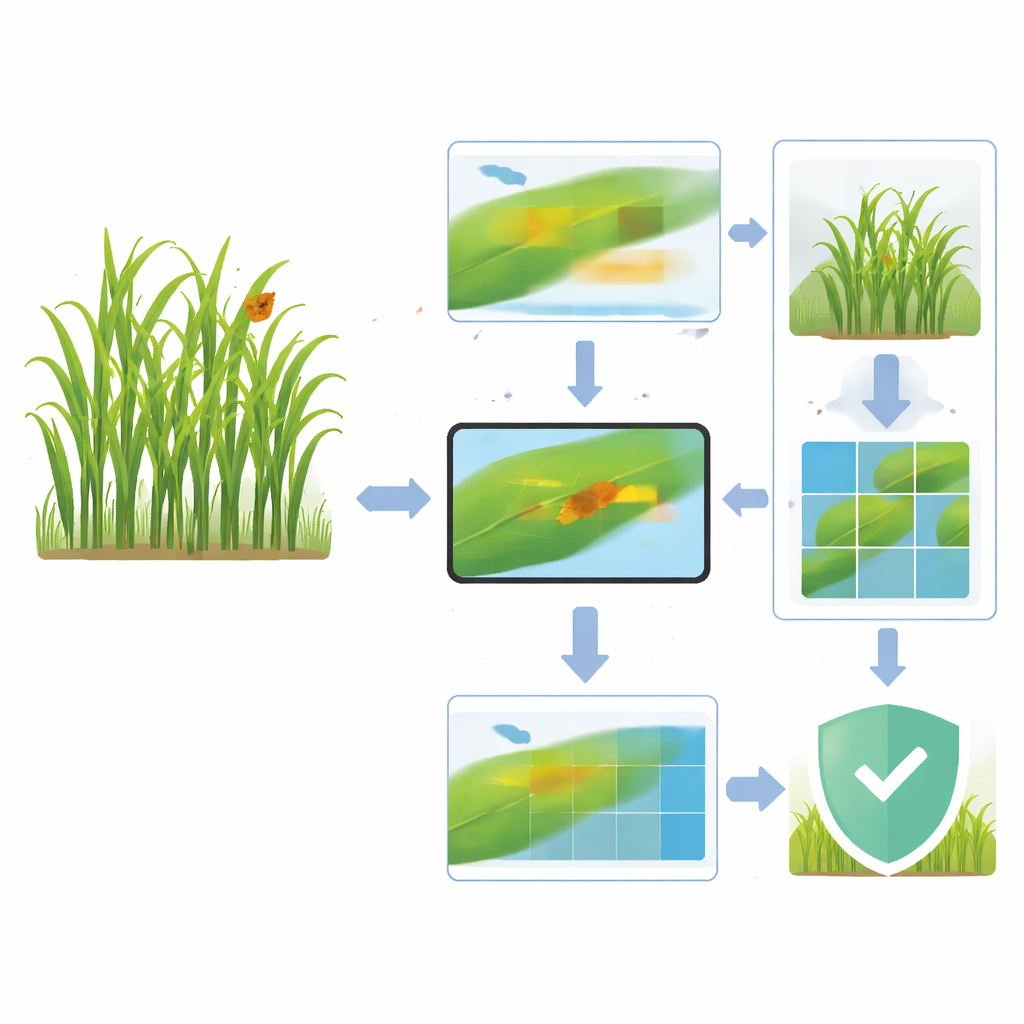

Como os dois modelos se unem

Em vez de construir uma rede nova e complicada, os autores combinam ViT e Swin de forma simples e transparente. Cada modelo primeiro examina a mesma imagem da folha e produz suas próprias pontuações de probabilidade para as seis classes. Essas pontuações são então promediadas, sem pesos treináveis adicionais, e a maior probabilidade combinada decide o diagnóstico final. Essa estratégia de média equilibra as forças de cada modelo e evita overfitting em um conjunto que, embora razoavelmente grande, ainda reflete uma seleção específica de regiões e condições. Experimentos mostram que substituir o Swin por uma rede convolucional tradicional elimina detalhes locais cruciais, e usar apenas o ViT perde sinais sutis — evidência de que o ganho vem da verdadeira sinergia entre atenção global e local, não apenas do empilhamento de mais modelos.

Quão bem o sistema funciona na prática

No conjunto de teste reservado com quase três mil imagens, o ensemble alcança uma acurácia de cerca de 97%, com precisão, recall e F1-score igualmente altas nas seis classes. Ele supera bases convolucionais fortes como ResNet, EfficientNet, MobileNet e DenseNet, bem como os modelos individuais ViT e Swin. A matriz de confusão mostra que a maioria dos erros ocorre entre doenças visualmente semelhantes, como Yellow Leaf e Mosaic, mas, de modo geral, as taxas de classificação incorreta permanecem baixas. As curvas ROC para cada classe são quase perfeitas, indicando que o ensemble é altamente confiante e consistente ao separar folhas saudáveis de doentes e entre os diferentes tipos de doença.

Convertendo previsões em orientações amigáveis ao agricultor

Para ir além de rótulos brutos, os autores conectam seu ensemble de imagens a um grande modelo de linguagem (LLM) hospedado online. Uma vez que a foto da folha é classificada, o nome da doença prevista é enviado ao LLM, que retorna uma explicação curta sobre sintomas prováveis e sugestões gerais de manejo, destinadas a agricultores e técnicos de extensão. Uma interface web construída na plataforma Hugging Face permite que usuários façam upload de uma imagem da folha, vejam a doença prevista e leiam a orientação gerada pela IA em poucos segundos. Os autores enfatizam que essas recomendações são consultivas e devem ser verificadas com especialistas em agronomia, porque LLMs às vezes podem gerar conselhos excessivamente confiantes ou incompletos. Ainda assim, essa camada de linguagem torna o sistema mais acessível para não especialistas.

O que isso significa para futuras ferramentas de agricultura inteligente

Em termos simples, o estudo mostra que combinar duas “formas de ver” a mesma folha — uma que enxerga a floresta, outra que enxerga as árvores — pode gerar um batedor digital muito confiável para doenças da cana-de-açúcar. O ensemble de ViT e Swin Transformers captura tanto sintomas amplos quanto finos, enquanto o modelo de linguagem acoplado ajuda a traduzir previsões técnicas em sugestões amigáveis ao usuário. Embora os modelos ainda precisem ser testados em mais regiões, condições de iluminação e dispositivos, e as saídas de linguagem exijam validação por especialistas, este trabalho aponta para ferramentas práticas para celulares ou tablets que poderiam ajudar agricultores a detectar problemas cedo, reduzir palpites e apoiar o uso mais preciso de tratamentos na cana e, eventualmente, em muitas outras culturas.

Citação: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

Palavras-chave: detecção de doenças da cana-de-açúcar, modelos vision transformer, agricultura de precisão, imagens de folhas de plantas, suporte à decisão por IA