Clear Sky Science · pt

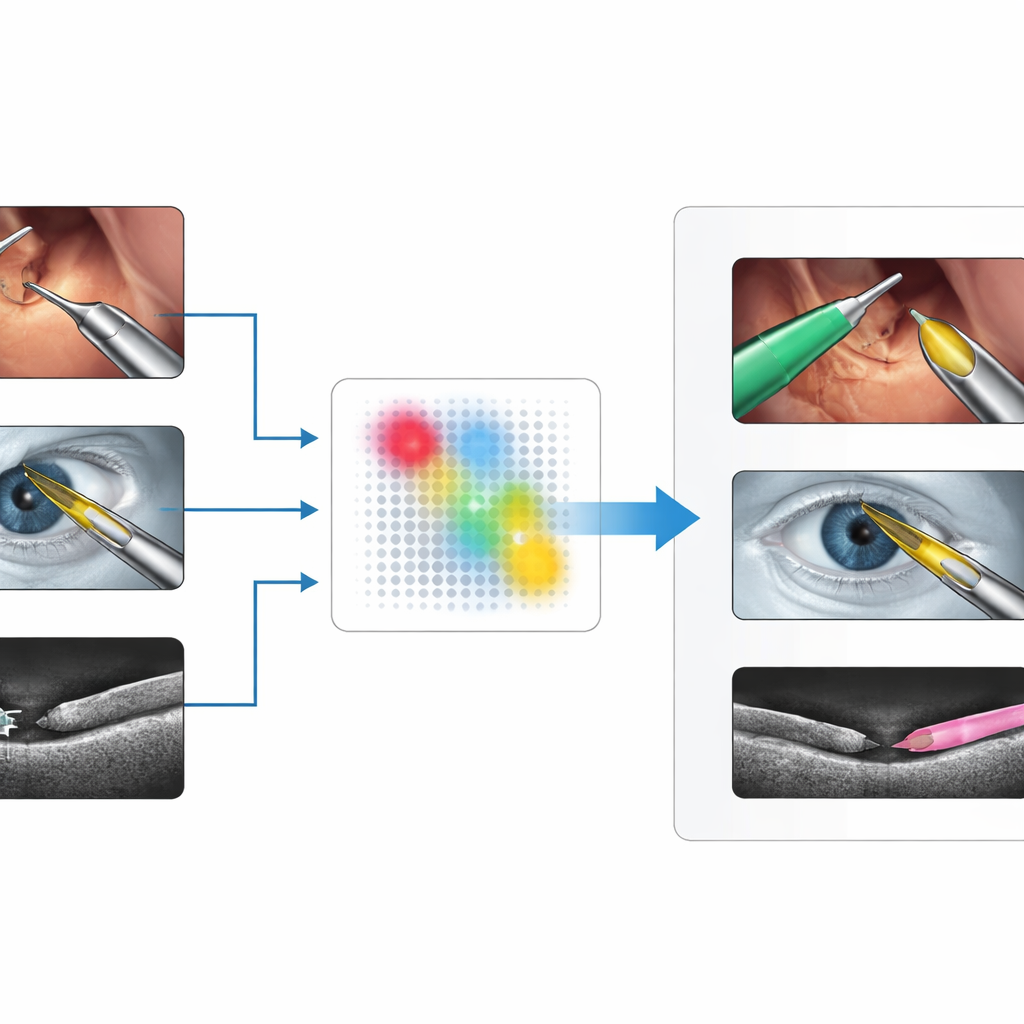

Segmentação de instrumentos cirúrgicos com supervisão fraca e independente de domínio

Por que visões mais inteligentes dos instrumentos cirúrgicos importam

Cirurgiões modernos trabalham cada vez mais com o auxílio de câmeras, microscópios e scanners avançados. Para orientar robôs, alinhar vistas 3D ou ocultar instrumentos em certas imagens, os computadores precisam localizar com confiança cada instrumento cirúrgico em cada quadro — uma tarefa chamada segmentação. Hoje isso geralmente exige milhares de anotações meticulosas e pixel a pixel por especialistas médicos — e mesmo assim os sistemas frequentemente falham quando o equipamento de imagem ou o procedimento muda. Este estudo apresenta uma forma de permitir que modelos de visão poderosos detectem instrumentos em tipos muito diferentes de imagens médicas, sem precisar de desenhos detalhados de cada instrumento antecipadamente.

O desafio de encontrar ferramentas em muitos tipos de imagem

Cirurgiões usam uma ampla variedade de sistemas de imagem: vídeos coloridos de câmeras laparoscópicas dentro do abdome, vistas de microscópio do olho durante cirurgias de catarata e cortes transversais como tomografia de coerência óptica (OCT) ou ultrassom. Em cada um desses casos, os instrumentos cirúrgicos parecem bastante diferentes — hastes de metal brilhante em imagens coloridas, linhas finas e brilhantes ou crescentes em OCT, ou manchas granulars no ultrassom. Métodos de deep learning existentes podem funcionar muito bem, mas somente após serem treinados em grandes conjuntos de dados cuidadosamente anotados para um cenário específico. Quando o dispositivo de imagem, a anatomia ou o tipo de instrumento muda, o desempenho costuma cair drasticamente, e coletar novas anotações é lento, caro e limitado por questões de privacidade e disponibilidade de especialistas.

Uma ideia nova: tratar instrumentos como objetos fora do lugar

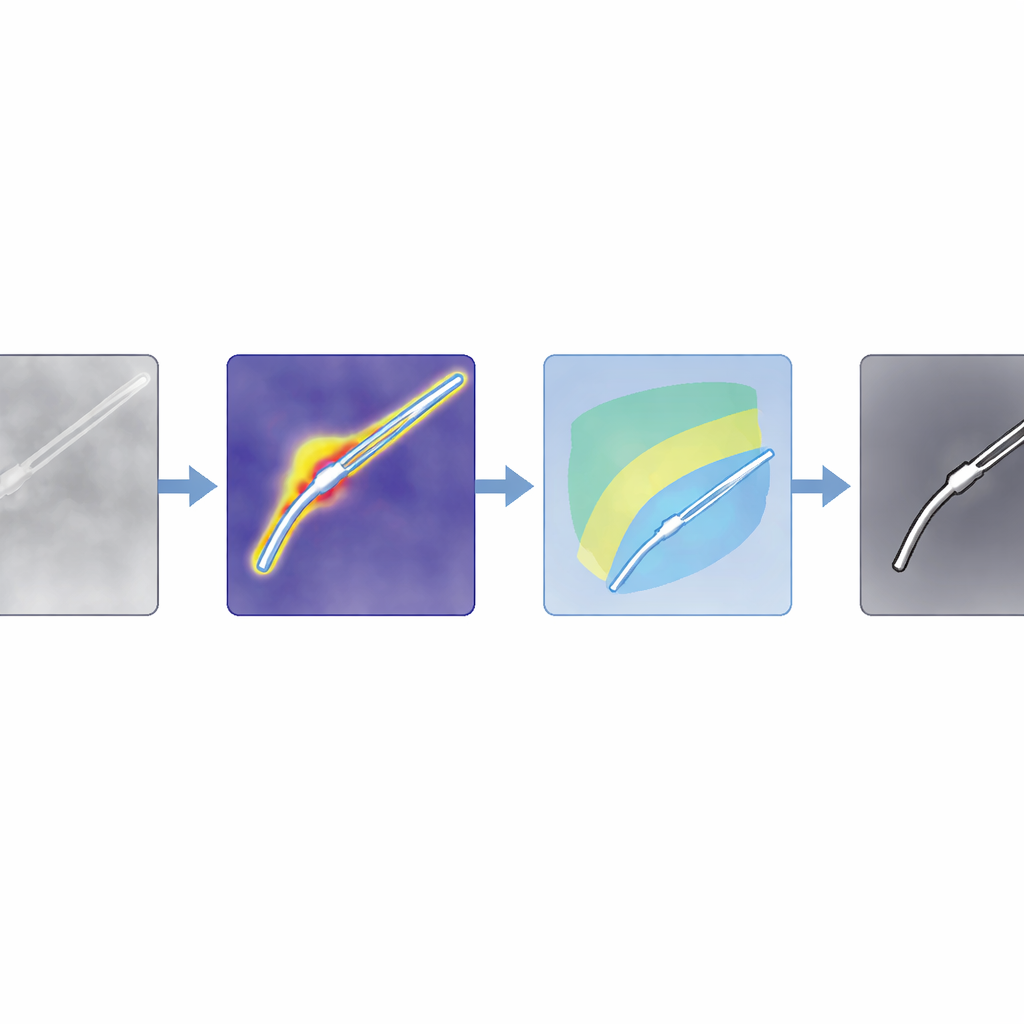

Os autores propõem um método chamado SAM4SIS que inverte o problema. Em vez de ensinar o sistema exatamente como cada instrumento se parece, eles primeiro mostram imagens sem nenhum instrumento, permitindo que o modelo aprenda como é o tecido “normal”. Usam um detector de anomalias chamado PatchCore para construir uma memória desses padrões normais. Quando chega uma nova imagem, o PatchCore destaca regiões cuja aparência não se encaixa nessa memória — áreas que provavelmente contêm instrumentos cirúrgicos. Essa etapa precisa apenas de informação simples no nível da imagem sobre a presença de uma ferramenta, não de contornos pixel a pixel, tornando a configuração muito mais simples.

De pistas grosseiras a contornos precisos

Mapas de anomalia são grosseiros, então a equipe os combina com um poderoso modelo fundacional, o Segment Anything Model 2 (SAM2), que pode traçar contornos nítidos se receber um ponto dentro do objeto de interesse. O truque chave é escolher automaticamente esses pontos a partir do mapa de anomalia, em vez de pedir que um humano clique. Os autores desenham filtros adaptados para imagens coloridas comuns e para varreduras baseadas em intensidade como OCT, realçando regiões com maior probabilidade de conter instrumentos enquanto suprimem sombras e artefatos brilhantes. Em seguida, pontuam as regiões potenciais de instrumento e escolhem os pontos mais fortes como prompts para o SAM2. Como o SAM2 retorna vários contornos candidatos, os autores introduzem uma nova regra de pontuação, SAM4SIS, que mede quão bem cada candidato corresponde ao mapa baseado em anomalia e seleciona a máscara com melhor ajuste.

Funciona em várias cirurgias e scanners

Os pesquisadores testam a abordagem em três conjuntos de dados exigentes: vídeos de cirurgia robótica abdominal (EndoVis2017), imagens de microscópio de operações de catarata (CaDIS) e cortes transversais OCT de olhos de porco com pequenos instrumentos (PASO-SIS). Esses casos cobrem vistas, cores e padrões de ruído muito distintos. Sem nunca retrenar o grande modelo de segmentação ou desenhar novas máscaras, o SAM4SIS alcança pontuações de precisão de contorno entre cerca de 53% e 73%, rivalizando ou superando métodos baseados em prompts de texto e aproximando-se de alguns sistemas supervisionados. Ele se sai especialmente bem onde métodos tradicionais têm dificuldades, como em dados de OCT e ultrassom, e requer menos de um minuto de tempo de configuração. A equipe também mostra que a mesma ideia pode realçar outros objetos estranhos, como bolas de algodão em ultrassom cerebral, sugerindo que o conceito não se limita a instrumentos.

O que isso significa para a cirurgia inteligente do futuro

Para o leitor, a mensagem central é que computadores agora podem aprender a “segmentar qualquer coisa nova” em cenas cirúrgicas ao primeiro entender como é o tecido normal e depois sinalizar formas desconhecidas como prováveis instrumentos, que são então refinadas por um modelo de visão de propósito geral. Essa abordagem evita trabalhos intensivos de anotação, adapta-se a diferentes tecnologias de imagem e pode ser integrada a fluxos de trabalho cirúrgicos com preparação mínima. Embora modelos especializados e cuidadosamente treinados ainda vençam quando há muitos dados rotulados disponíveis, o SAM4SIS oferece uma alternativa prática para procedimentos novos, configurações de imagem raras ou pesquisas em estágio inicial, aproximando a detecção automática e robusta de instrumentos da realidade clínica cotidiana.

Citação: Peter, R., Pham, D.X.V., Matten, P. et al. Domain-agnostic weakly supervised surgical instrument segmentation. Sci Rep 16, 9337 (2026). https://doi.org/10.1038/s41598-026-43054-1

Palavras-chave: segmentação de instrumentos cirúrgicos, IA em imagens médicas, detecção de anomalias, modelos fundacionais de visão, cirurgia robótica