Clear Sky Science · pt

Desenvolvimento e avaliação de uma estrutura de aprendizado por transferência em múltiplas etapas para análise robusta de imagens médicas

Por que uma leitura de imagem mais inteligente importa

A medicina moderna depende fortemente de imagens — de mamografias a radiografias de tórax — para detectar doenças precocemente e orientar tratamentos. Mas ensinar computadores a interpretar essas imagens com a precisão de especialistas humanos geralmente exige conjuntos de dados enormes e rotulados com cuidado, algo que muitos hospitais simplesmente não têm. Este estudo apresenta uma nova forma de treinar sistemas de inteligência artificial que aproveita melhor as imagens existentes, incluindo fotos laboratoriais de baixo custo de células cancerígenas, para melhorar o desempenho em exames do mundo real, ao mesmo tempo em que reduz as exigências de privacidade e de dados.

De fotos do dia a dia a exames hospitalares

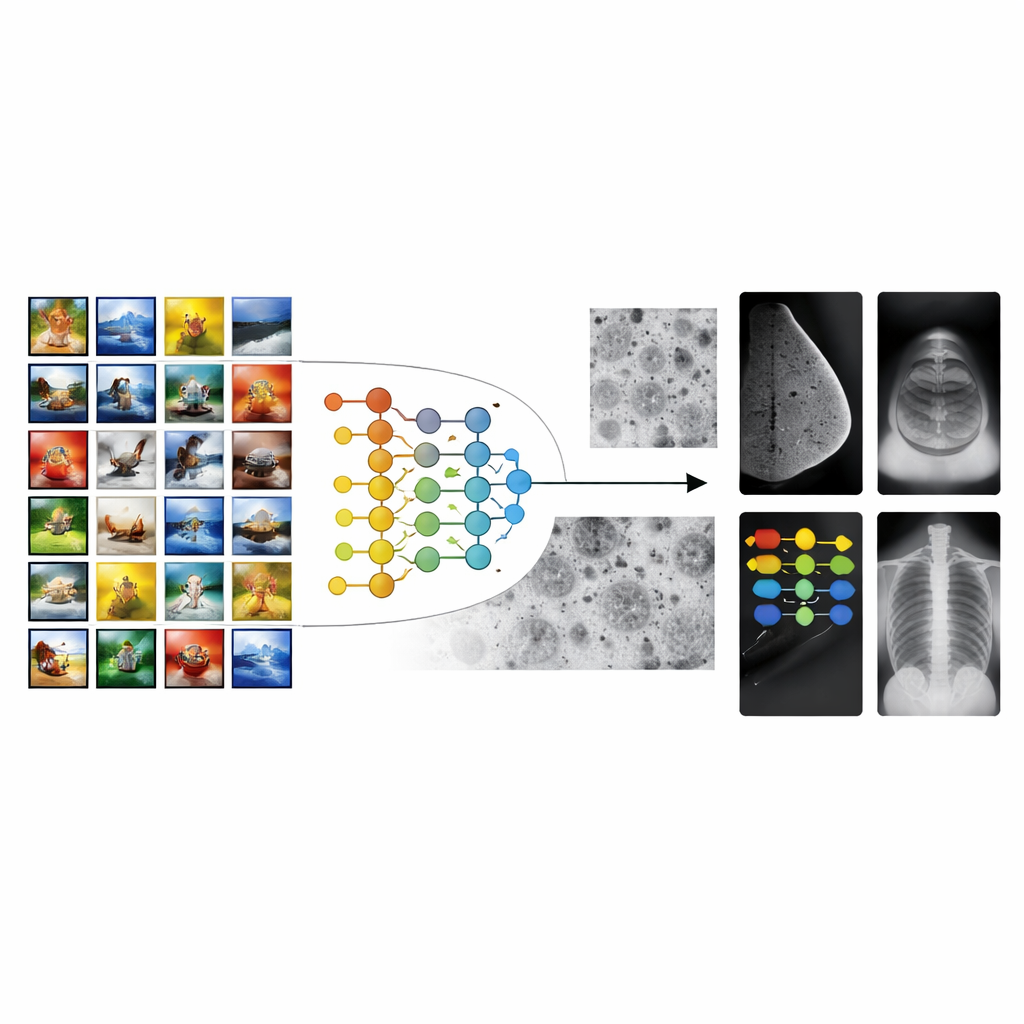

A maioria dos sistemas de IA para imagens médicas parte de modelos treinados em milhões de fotos do cotidiano, como animais, objetos e paisagens. Essa estratégia, conhecida como aprendizado por transferência, dá aos algoritmos uma “vantagem inicial” para reconhecer formas e texturas. Contudo, existe um grande fosso entre fotos de viagem e exames médicos. Os padrões relevantes em uma mamografia ou em uma radiografia — micropontos, sombras tênues ou texturas sutis do tecido — não se parecem com objetos em fotos comuns. Como resultado, o aprendizado por transferência convencional pode estagnar, gerando ferramentas que vão bem em laboratório, mas têm dificuldades em diferentes hospitais, aparelhos ou grupos de pacientes.

Construindo uma ponte com imagens de células

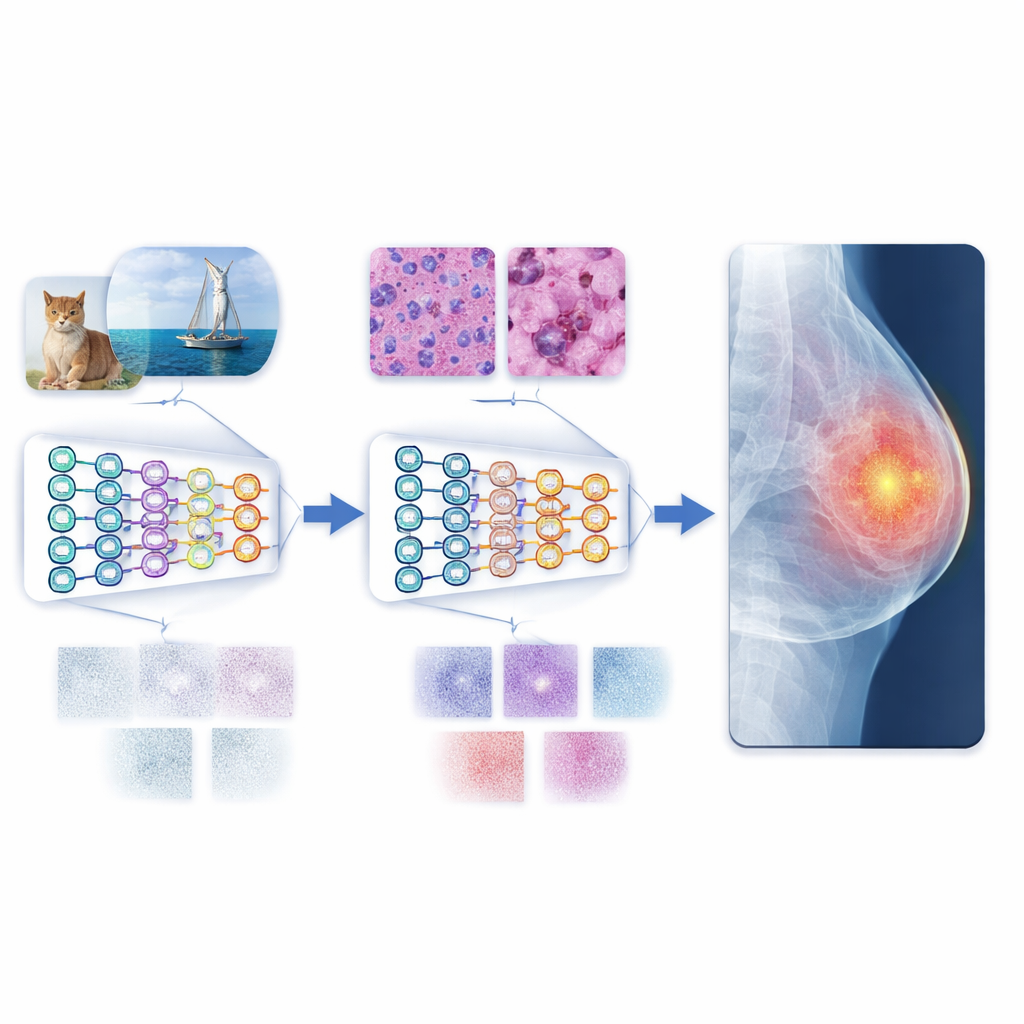

Os autores propõem uma estrutura de aprendizado por transferência em múltiplas etapas (MSTL) que adiciona um passo intermediário crucial entre imagens gerais e exames clínicos. Após um primeiro treinamento em uma grande coleção de imagens naturais, o modelo é refinado com fotos microscópicas de linhagens de células cancerígenas cultivadas em laboratório. Essas imagens de células compartilham muitos atributos visuais com exames médicos: estruturas densas e agrupadas; texturas de alta resolução; e variações sutis de brilho. Além disso, são relativamente baratas de produzir, podem ser geradas em grande quantidade e evitam as preocupações de privacidade associadas aos dados dos pacientes. Ao adaptar-se primeiro a esse universo de imagens de células, o modelo aprende características mais relevantes aos padrões de doença antes mesmo de ver uma mamografia, um ultrassom ou uma radiografia.

Testando em diferentes tipos de exame

Para avaliar essa estratégia, os pesquisadores treinaram tanto redes neurais convolucionais tradicionais quanto os mais recentes vision transformers em três tarefas de imagem comuns: detecção de câncer de mama em mamografias, análise de lesões mamárias em ultrassom e detecção de pneumonia em radiografias de tórax. Compararam três estilos de treinamento: começar do zero, usar aprendizado por transferência convencional a partir de imagens naturais e usar o novo método em múltiplas etapas com imagens de células cancerígenas como ponte. A abordagem multietapa entregou consistentemente os melhores resultados, frequentemente aproximando a acurácia do ideal nos conjuntos de dados testados. Os vision transformers, que conseguem capturar padrões de longo alcance em toda a imagem, superaram as redes convolucionais padrão em quase todas as situações, especialmente quando combinados com o treinamento multietapa.

Medindo quão bem o conhecimento se transfere

Além das métricas simples de acurácia, a equipe examinou o quão facilmente as características aprendidas em uma etapa transitavam para a seguinte. Utilizaram três medidas de transferibilidade que refletem quão compatíveis os padrões de imagem aprendidos são com novas tarefas. Para mamografias e radiografias de tórax em particular, essas medidas acompanharam de perto o desempenho real, especialmente para o modelo mais forte, um vision transformer base (ViTB-16). Essa relação estreita sugere que a etapa intermediária com imagens de células faz mais do que apenas melhorar números; ela produz representações que realmente “se encaixam” melhor às imagens médicas. Experimentos adicionais mostraram que reduzir pela metade o número de imagens de células prejudicou o desempenho, e substituí-las por outras modalidades médicas (como endoscopia ou imagens oculares) foi menos eficaz, ressaltando o valor especial das linhagens de células cancerígenas como ponte.

Rumo a diagnósticos automatizados mais confiáveis

Em termos práticos, o estudo demonstra que ensinar um sistema de IA a ler imagens de células cultivadas em laboratório antes de exames hospitalares torna-o um “leitor” de imagens médicas mais habilidoso e confiável. Esse caminho multietapa reduz o descompasso entre fotos coloridas do cotidiano e os padrões complexos e sóbrios das imagens clínicas, permitindo que o modelo generalize melhor mesmo com quantidades modestas de dados médicos rotulados. Combinada com vision transformers modernos, a abordagem oferece desempenho de ponta em vários conjuntos de referência. Embora sejam necessários dados mais diversos e testes mais amplos, a estrutura aponta para ferramentas escaláveis e amigas da privacidade que podem apoiar médicos a diagnosticar doenças com mais precisão e consistência ao redor do mundo.

Citação: Ayana, G., Park, Sy., Jeong, K.C. et al. Development and evaluation of a multistage transfer learning framework for robust medical image analysis. Sci Rep 16, 8873 (2026). https://doi.org/10.1038/s41598-026-42157-z

Palavras-chave: análise de imagens médicas, aprendizado por transferência, aprendizado profundo, vision transformers, imagens de células cancerígenas