Clear Sky Science · pt

Projeto e implementação de uma estrutura de deep learning para classificação automatizada de culturas e diagnóstico de saúde na agricultura de precisão

Campos mais inteligentes para um mundo faminto

Alimentar uma população global em crescimento significa extrair mais alimento de cada hectare enquanto se desperdiça menos água, fertilizantes e mão de obra. Ainda assim, agricultores passam inúmeras horas caminhando por suas terras, verificando folhas e solo visualmente. Este artigo introduz uma forma automatizada de monitorar culturas usando drones, satélites em órbita e sensores enterrados, todos conectados a um sistema de deep learning capaz de detectar problemas precocemente e sugerir ações rápidas.

Unindo céu e solo

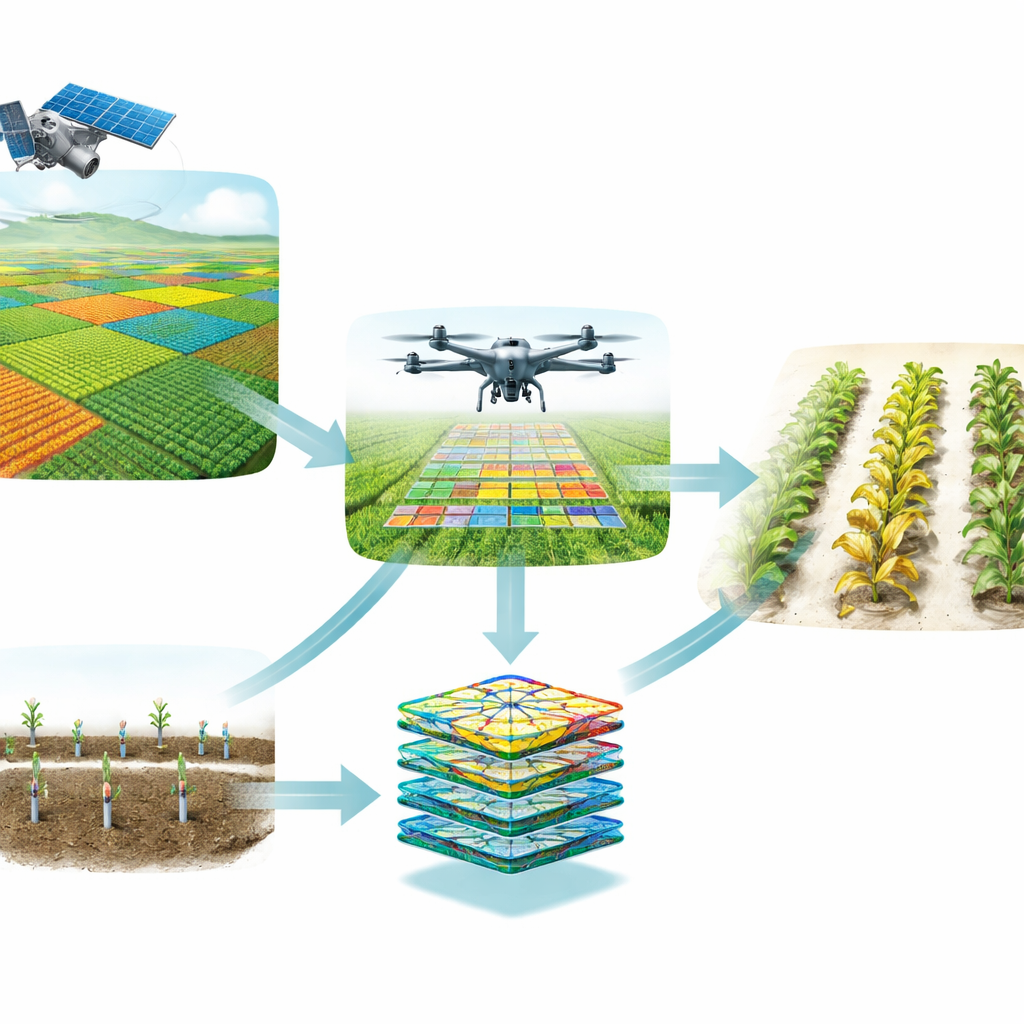

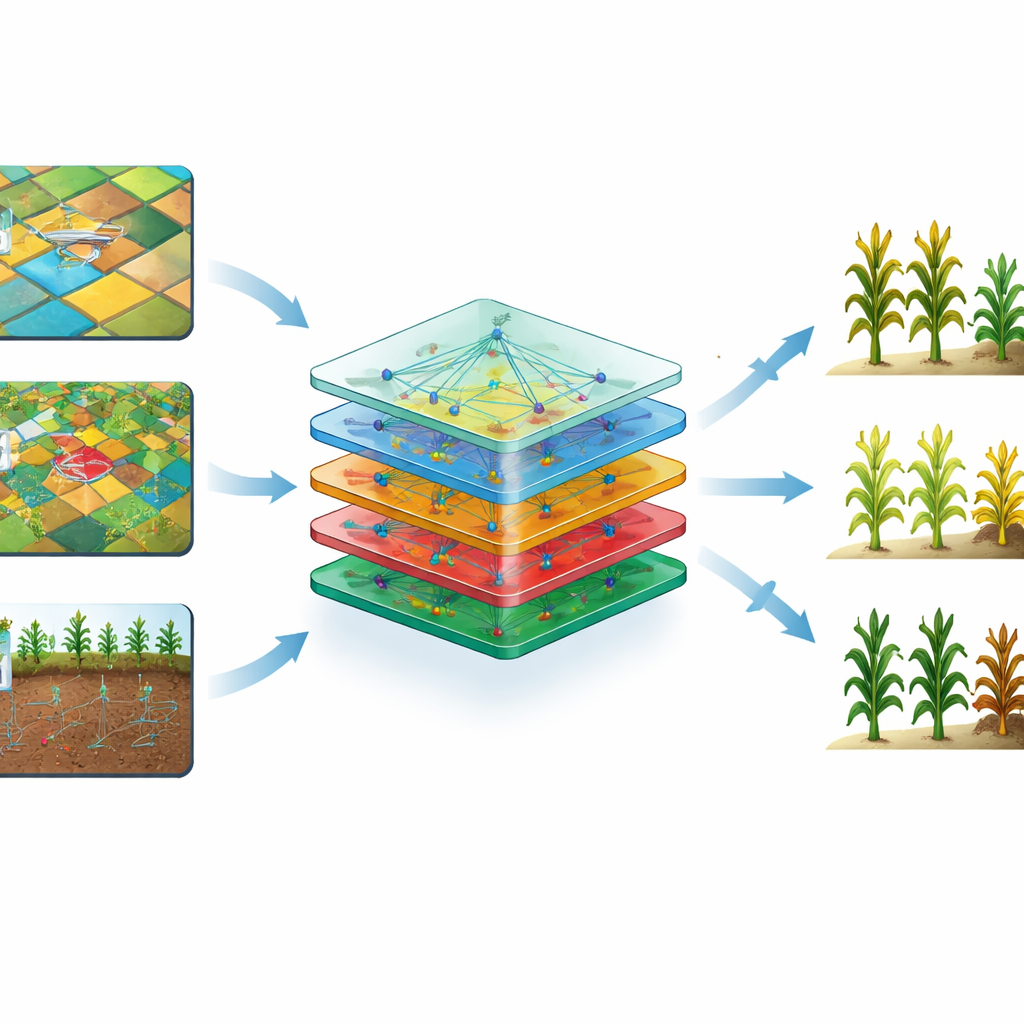

A maioria das ferramentas agrícolas de alta tecnologia observa apenas uma parte do problema: fotos em close das folhas ou leituras brutas de sondas de solo. Os autores argumentam que essa visão em “silos” perde pistas importantes. A estrutura proposta mescla três pontos de vista. Do espaço, imagens de satélite revelam padrões em larga escala, como quais áreas do campo estão sob estresse. Do ar, drones capturam vistas detalhadas em cores e no infravermelho próximo de plantas individuais. No solo, sensores conectados à internet monitoram umidade, nutrientes, temperatura e outras condições. Ao alinhar essas fontes de dados no tempo e no espaço, o sistema consegue conectar o que vê nas folhas ao que acontece no solo e no ambiente ao redor.

Como o médico digital das culturas aprende

O núcleo da estrutura é um modelo de deep learning treinado para reconhecer tipos de cultura e condições de saúde. Primeiro, todos os dados recebidos passam por limpeza e padronização: cenas de satélite com nuvens são normalizadas, imagens de drone são redimensionadas e ajustadas para variação de iluminação, e lacunas em registros meteorológicos são preenchidas. O sistema também aumenta os dados de imagem rotacionando e espelhando fotos para que o modelo aprenda a ignorar o ângulo da câmera e se concentrar em características reais da planta. Em seguida, uma rede especializada de análise de imagens, conhecida como rede neural convolucional, extrai padrões como textura das folhas, alterações de cor e formas de lesões, enquanto camadas adicionais processam as leituras numéricas dos sensores. Um mecanismo de “atenção” ajuda o modelo a se concentrar nas regiões mais informativas — como um pedaço de folhas manchadas — ao mesmo tempo em que desconsidera o solo ou o céu em segundo plano.

De dados brutos a decisões em tempo real

Uma vez treinado, o modelo funciona como um médico das culturas sempre ativo. Dados de múltiplas fontes são transmitidos ao sistema e fundidos em uma única representação interna. As camadas guiadas por atenção comparam o que observam com milhares de exemplos passados e, então, o bloco final de classificação decide se uma planta está saudável ou apresenta sinais de doença, dano por pragas ou estresse. Em vez de rotular um campo apenas como bom ou ruim, a estrutura relaciona seu diagnóstico visual aos níveis atuais de umidade e nutrientes do solo. Essa combinação permite priorizar alertas: por exemplo, um padrão de doença associado a condições de alta umidade pode disparar um aviso de alta urgência, acionando pulverização direcionada imediata em vez de tratamento generalizado por toda a fazenda.

Testando o sistema

Para verificar se a abordagem funciona além da teoria, os autores treinaram e avaliaram sua estrutura em um conjunto de dados público de agricultura de precisão que inclui imagens de satélite, fotos de drones e leituras de sensores de solo para culturas básicas: milho, batata e trigo. Eles dividiram os dados em conjuntos de treinamento, validação e teste para evitar overfitting e compararam seu modelo com técnicas tradicionais de deep learning e de machine learning. Seu sistema multimodal alcançou consistentemente mais de 90% de acurácia na identificação do tipo de cultura e do estado de saúde, além de produzir previsões mais rápidas que os modelos de referência. Importante, quando uma fonte de dados foi degradada — por exemplo, imagens de drone afetadas por sombras — o sistema ainda manteve alta precisão ao se apoiar mais fortemente nas informações de solo e satélite.

O que isso significa para os agricultores

O principal resultado do estudo é que combinar visões do céu ao solo permite que computadores avaliem a saúde das culturas com mais confiabilidade do que observadores humanos ou ferramentas de sensor único. Para os agricultores, isso pode significar avisos antecipados de surtos de doença, uso mais preciso de água e produtos químicos, redução de custos de mão de obra e, em última instância, maiores rendimentos com menor impacto ambiental. Embora o sistema atual ainda dependa de boa conectividade para enviar dados à nuvem, versões futuras poderiam rodar diretamente em drones ou dispositivos de edge no campo. Se implementados em larga escala, esses guardiões múltiplos e inteligentes da fazenda poderiam se tornar uma pedra angular de uma agricultura verdadeiramente sustentável e orientada por dados.

Citação: Pal, A.K., Patro, B.D.K. & Chaube, S. Design and implementation of a deep learning framework for automated crop classification and health diagnosis in precision agriculture. Sci Rep 16, 11436 (2026). https://doi.org/10.1038/s41598-026-42151-5

Palavras-chave: agricultura de precisão, detecção de doenças em culturas, aprendizado profundo, imagens de drones e satélite, agricultura inteligente