Clear Sky Science · pt

GWKNN: um algoritmo k-vizinhos mais próximos aprimorado com reconstrução de métrica G e Otimizador Lobo Cinzento

Reconhecimento de Padrões mais Inteligente para a Enxurrada de Dados Atual

De exames médicos a transações bancárias, a vida moderna gera oceanos de dados. Muito dessa informação precisa ser classificada automaticamente em categorias: saudável ou doente, fraudulento ou normal, spam ou genuíno. Um método clássico para esse tipo de tarefa é o algoritmo k-vizinhos mais próximos (KNN), que rotula um novo caso observando os exemplos passados mais semelhantes. Ainda assim, à medida que os conjuntos de dados crescem, ficam mais complexos e mais desbalanceados, essa ideia simples começa a falhar. O artigo apresenta o GWKNN, uma versão reformulada do KNN projetada para usar distâncias entre pontos de forma mais inteligente e para tratar casos raros, porém importantes, com mais justiça.

Por que a Similaridade Simples é Insuficiente

O KNN convencional pressupõe que todas as características de um ponto de dados contribuem igualmente e mede similaridade com uma distância euclidiana padrão. Isso pode funcionar bem quando os dados são de baixa dimensionalidade e bem separados, mas os dados do mundo real costumam ser de alta dimensionalidade, ruidosos e misturar diferentes tipos de informação. Nesses casos, a distância usual pode ser enganosa, levando o algoritmo a selecionar vizinhos pouco úteis. Ao mesmo tempo, muitos conjuntos de dados são desbalanceados: categorias comuns dominam, enquanto categorias raras, mas cruciais — como uma doença em estágio inicial — estão sub-representadas. Quando o KNN vota entre exemplos próximos, a classe majoritária tende a abafar essas classes minoritárias, resultando em decisões viesadas e às vezes perigosas.

Ensinando ao Algoritmo um Sentido de Distância Melhor

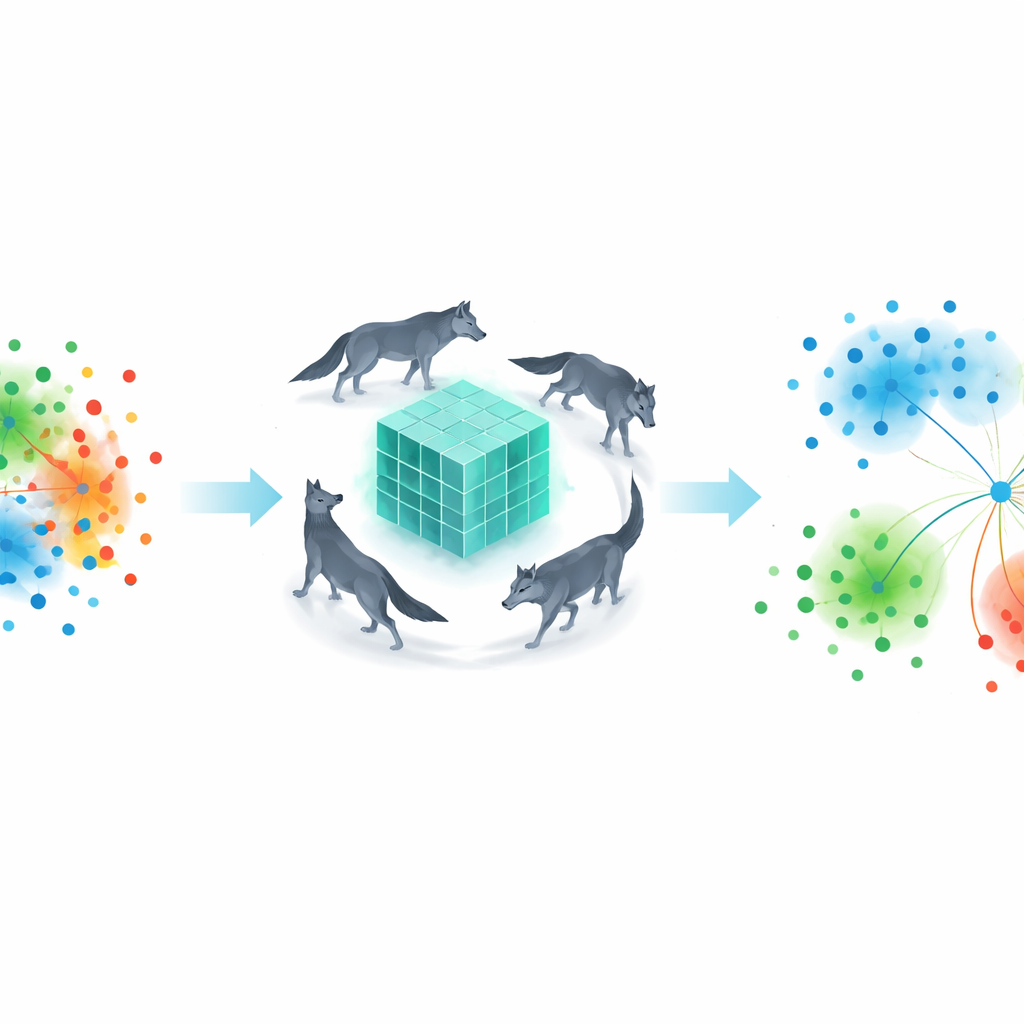

A primeira grande inovação do GWKNN é uma medida de distância aprendida. Em vez de fixar a regra da linha reta usual, os autores permitem que o algoritmo descubra quão distantes os pontos de dados devem ser de um modo que separe melhor as categorias. Eles codificam isso como uma métrica flexível “G” que remodela o espaço para que características informativas pesem mais e as redundantes pesem menos. Para ajustar essa métrica, o método se inspira no comportamento de caça dos lobos cinzentos. Um procedimento de inteligência de enxame, chamado Otimizador Lobo Cinzento, explora várias formas possíveis de esticar e comprimir o espaço de dados, mantendo aquelas que reduzem erros de classificação enquanto preservam estabilidade matemática. Ao longo de muitas iterações, os “lobos” virtuais convergem para uma regra de distância que faz pontos semelhantes se agruparem de forma mais confiável, mesmo em conjuntos de dados de alta dimensionalidade e intrincados.

Dando uma Voz Mais Forte aos Casos Raros

A segunda melhoria mira o viés de votação. O KNN padrão simplesmente conta quantos dos k vizinhos pertencem a cada classe e escolhe a maioria. O GWKNN, em vez disso, pondera cada voto de acordo com a frequência dessa classe no conjunto de treinamento. Classes que aparecem menos recebem pesos maiores; classes muito frequentes ganham pesos menores. Um pequeno termo de suavização impede que categorias extremamente raras dominem a decisão. Assim, se um novo ponto de dados estiver próximo de alguns exemplos de uma classe minoritária e de muitos exemplos da classe majoritária, os sinais das minorias não são automaticamente sufocados. O esquema é simples de computar, mas tem efeito poderoso: incentiva o classificador a prestar mais atenção a padrões raros, porém significativos, melhorando a equidade e a revocação para classes minoritárias.

Testando o Novo Método

Para verificar se o GWKNN realmente ajuda na prática, os autores o avaliaram em 12 conjuntos de benchmark do conhecido repositório UCI. Essas coleções abrangem dados financeiros, medições médicas, caligrafia, sementes de plantas e vários conjuntos de expressão gênica e câncer de alta dimensionalidade, com problemas de duas classes e multiclasses. Eles compararam quatro versões do KNN: o baseline simples, uma versão apenas com a nova métrica de distância, uma versão apenas com os novos pesos de votação e o GWKNN completo combinando ambas as ideias. Também confrontaram o GWKNN com sete classificadores amplamente usados, incluindo máquinas de vetor de suporte, árvores de decisão, florestas aleatórias, regressão logística, Naive Bayes e uma rede neural. Em divisões repetidas de treino–teste, acompanharam não só a acurácia média, mas também a variabilidade dos resultados.

Resultados: Mais Preciso e Mais Consistente

A abordagem combinada GWKNN ficou em primeiro lugar ou empatada pelo melhor desempenho na maioria dos conjuntos de dados, especialmente naqueles com muitas features e tamanhos de classes desiguais. Em tarefas relativamente simples, todos os métodos se saíram bem e os ganhos foram modestos, mas o GWKNN ainda tendia a melhorar ligeiramente a acurácia e reduzir a variabilidade. Em conjuntos de expressão gênica mais difíceis, com milhares de características, as vantagens foram mais claras: a métrica de distância aprendida ajudou o algoritmo a formar vizinhanças mais significativas, e a votação ponderada melhorou o reconhecimento de classes sub-representadas. Testes estatísticos em todos os conjuntos confirmaram que as colocações do GWKNN foram significativamente melhores do que as do KNN padrão e de alguns modelos clássicos, indicando que suas melhorias não são apenas flutuações fortuitas, mas robustas em diferentes condições de dados.

O Que Isso Significa para Decisões de Dados Cotidianas

Para não especialistas, a conclusão é que o GWKNN refina uma ideia bem intuitiva — “olhe para casos passados semelhantes” — para se ajustar melhor à realidade desordenada dos dados modernos. Ao aprender a medir similaridade de forma orientada pelos dados e ao aumentar a influência de categorias raras durante a votação, o método busca ser mais preciso e mais justo. Embora essa sofisticação extra implique custo computacional adicional, especialmente para conjuntos muito grandes e de alta dimensionalidade, o GWKNN mostra forte potencial para tarefas em que a classificação correta de casos minoritários realmente importa, como detecção precoce de doenças ou identificação de fraudes. O trabalho ilustra como algoritmos clássicos podem ser atualizados com insights de otimização e equidade para acompanhar a escala e a complexidade das informações atuais.

Citação: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

Palavras-chave: k-vizinhos mais próximos, aprendizado de métrica de distância, desequilíbrio de classes, inteligência de enxame, classificação de dados