Clear Sky Science · pt

Um sistema otimizado de servoacionamento visual qualitativo em tempo real baseado em HOG para cadeira de rodas autônoma

Viagens mais inteligentes para quem mais precisa

Para muitas pessoas que dependem de cadeiras de rodas motorizadas, dirigir por corredores lotados ou calçadas irregulares pode ser cansativo, estressante ou mesmo impossível sem ajuda. Este artigo apresenta uma nova forma de a cadeira “enxergar” o entorno por meio de uma pequena câmera e se orientar de maneira suave e segura em tempo real, mesmo usando hardware barato. Ao redesenhar cuidadosamente como a informação visual é processada e convertida em movimento, o autor demonstra que a navegação inteligente da cadeira pode rodar em um computador minúsculo e de baixo consumo, mantendo os usuários confortáveis e no controle.

Por que cadeiras de rodas comuns têm dificuldade no mundo real

Cadeiras de rodas motorizadas tradicionais geralmente são dirigidas diretamente por um joystick ou dependem de sensores de impacto simples para evitar obstáculos. Essas abordagens costumam falhar em espaços movimentados e dinâmicos, como corredores de hospitais, shoppings ou calçadas da cidade. Usuários relatam que o que mais desejam é um movimento suave, previsível e confiável em diferentes condições de iluminação, não velocidade bruta. Ao mesmo tempo, muitos métodos robóticos avançados que usam câmeras e matemática complexa exigem computadores potentes, que são caros e volumosos demais para cadeiras cotidianas. Essa lacuna — entre o que os usuários precisam e o que o hardware de baixo custo pode suportar — é exatamente o que o estudo procura fechar.

Ensinando a cadeira a ler padrões em vez de pontos

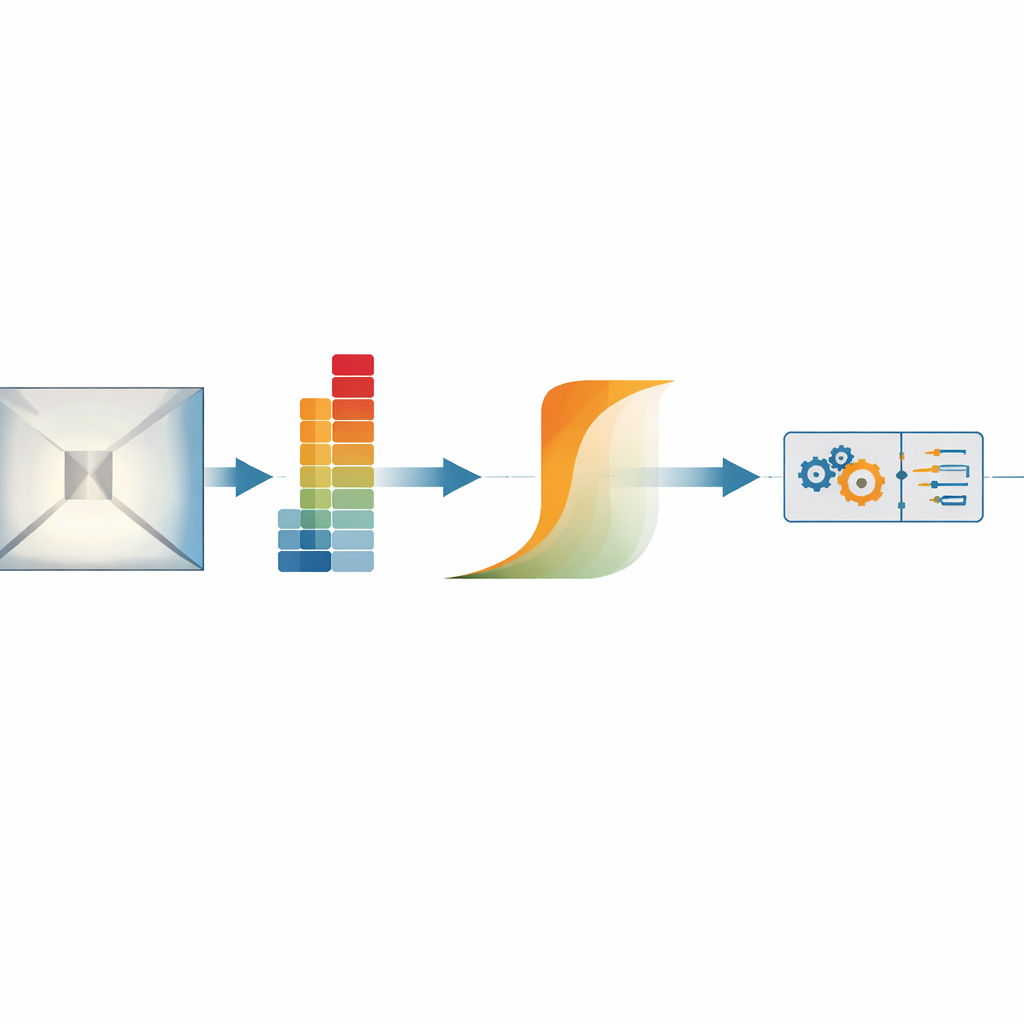

O sistema usa uma câmera montada na cadeira para observar a cena à frente e a representar não como pontos ou marcos individuais, mas como padrões de contornos e linhas conhecidos como histogramas de gradiente. Em termos simples, ele analisa como a luminosidade varia pela imagem e condensa isso em uma impressão digital compacta da cena. Esse tipo de descrição de padrão é naturalmente tolerante a mudanças de iluminação e bloqueios parciais, como um transeunte que cruza brevemente o campo de visão da câmera. A cadeira compara o padrão atual com um padrão “meta” que corresponde a uma vista desejada — como a aparência de um corredor reto ou um marco no final de um caminho — e então ajusta seu movimento para aproximar os dois.

Deixando margem para um controle mais seguro

Em vez de exigir uma correspondência perfeita entre as vistas atual e desejada, o método introduz uma “zona de confiança” flexível. Se a visão da câmera estiver suficientemente próxima do objetivo, o sistema de controle relaxa deliberadamente, evitando correções nervosas de vai e vem. Isso é obtido por meio de uma função de ativação matemática que aumenta ou diminui gradualmente a resposta de direção dependendo do tamanho do erro visual, em vez de simplesmente aplicar mais esforço sempre que houver qualquer erro. Como resultado, a cadeira lida com oclusões parciais e incerteza visual sem solavancos bruscos, mantendo trajetórias suaves em tarefas como seguir corredores ou mover‑se em direção a uma sequência de alvos visuais.

Fazendo visão avançada funcionar em um computador minúsculo

Um grande desafio é que essas impressões digitais visuais ricas costumam ser caras de calcular. O autor aborda isso reescrevendo os cálculos para usar operações eficientes “tudo de uma vez” em vez de laços aninhados lentos, reduzindo precisão desnecessária e organizando cuidadosamente o uso de memória. Rodando em um Raspberry Pi — um computador do tamanho de um cartão de crédito frequentemente usado em projetos hobby — o software melhorado eleva a velocidade de processamento de níveis impraticáveis (cerca de uma imagem a cada 12 segundos) para aproximadamente cinco imagens e meia por segundo. Os motores da cadeira recebem comandos em uma taxa muito mais rápida e estável, de modo que as rodas se movimentam suavemente enquanto a câmera e o sistema de visão atualizam em segundo plano. Camadas extras de segurança, incluindo freios de hardware e um watchdog que interrompe a cadeira se os comandos deixarem de chegar, são incorporadas para adequar o sistema ao uso assistivo real.

Da teoria de laboratório à ajuda do dia a dia

Por meio de experimentos em corredores, calçadas e testes controlados em vídeo, o sistema guia consistentemente a cadeira de um objetivo visual ao próximo enquanto reduz gradualmente suas correções de direção à medida que se aproxima de cada alvo. O erro de correspondência de padrões da câmera diminui de forma constante, confirmando que a cadeira está se alinhando visualmente sem perder rastros de características importantes pelo caminho. Em linguagem direta, o estudo mostra que um computador pequeno e acessível e uma câmera simples são suficientes para fornecer a uma cadeira de rodas motorizada um “piloto automático” guiado por câmera, estável e que respeita conforto e segurança. Isso abre caminho para auxílios de navegação baseados em câmera mais acessíveis para pessoas com mobilidade reduzida e prepara o terreno para futuros aprimoramentos, como percepção 3D mais rica e desvio de obstáculos ainda mais suave.

Citação: Hafez, A.H.A. An optimized real-time qualitative HOG-based visual servoing system for autonomous wheelchair. Sci Rep 16, 8688 (2026). https://doi.org/10.1038/s41598-026-41566-4

Palavras-chave: cadeira de rodas autônoma, robótica assistiva, visão computacional, navegação visual, controle em tempo real