Clear Sky Science · pt

Estrutura de privacidade estocástica incorporada por Poisson para aprendizado federado com criptografia homomórfica segura em IA médica

Protegendo Segredos Médicos Enquanto Se Ensina Máquinas

Hospitais estão coletando um grande número de imagens de raio‑X que poderiam ajudar médicos a identificar doenças como a COVID‑19 mais cedo e com maior precisão. Mas essas imagens também são profundamente pessoais, e regras rígidas de privacidade dificultam reunir os dados em um único local para treinar ferramentas poderosas de inteligência artificial (IA). Este estudo apresenta uma forma de permitir que hospitais colaborem em um sistema compartilhado de diagnóstico por raio‑X sem nunca entregar suas imagens brutas a terceiros, com o objetivo de manter os dados dos pacientes protegidos enquanto se alcança alta precisão.

Por Que Compartilhar Dados Médicos É Tão Difícil

A IA moderna prospera com conjuntos de dados grandes e variados, mas hospitais normalmente armazenam imagens localmente e hesitam — ou são impedidos legalmente — de enviá‑las a um servidor central. Abordagens tradicionais que copiam todos os dados para um grande banco correm risco de vazamentos e ataques cibernéticos, minando a confiança pública e violando regulações. Mesmo métodos mais recentes, em que hospitais treinam um modelo compartilhado em um arranjo chamado “aprendizado federado”, não são totalmente seguros: atacantes habilidosos às vezes conseguem reconstruir imagens de pacientes a partir de atualizações do modelo. Ao mesmo tempo, dados médicos costumam ser desiguais e desordenados, com alguns hospitais tendo muito mais casos de determinada doença do que outros, o que pode desestabilizar o treinamento e reduzir a confiabilidade.

Uma Rede Cooperativa Que Nunca Compartilha Raios‑X Brutos

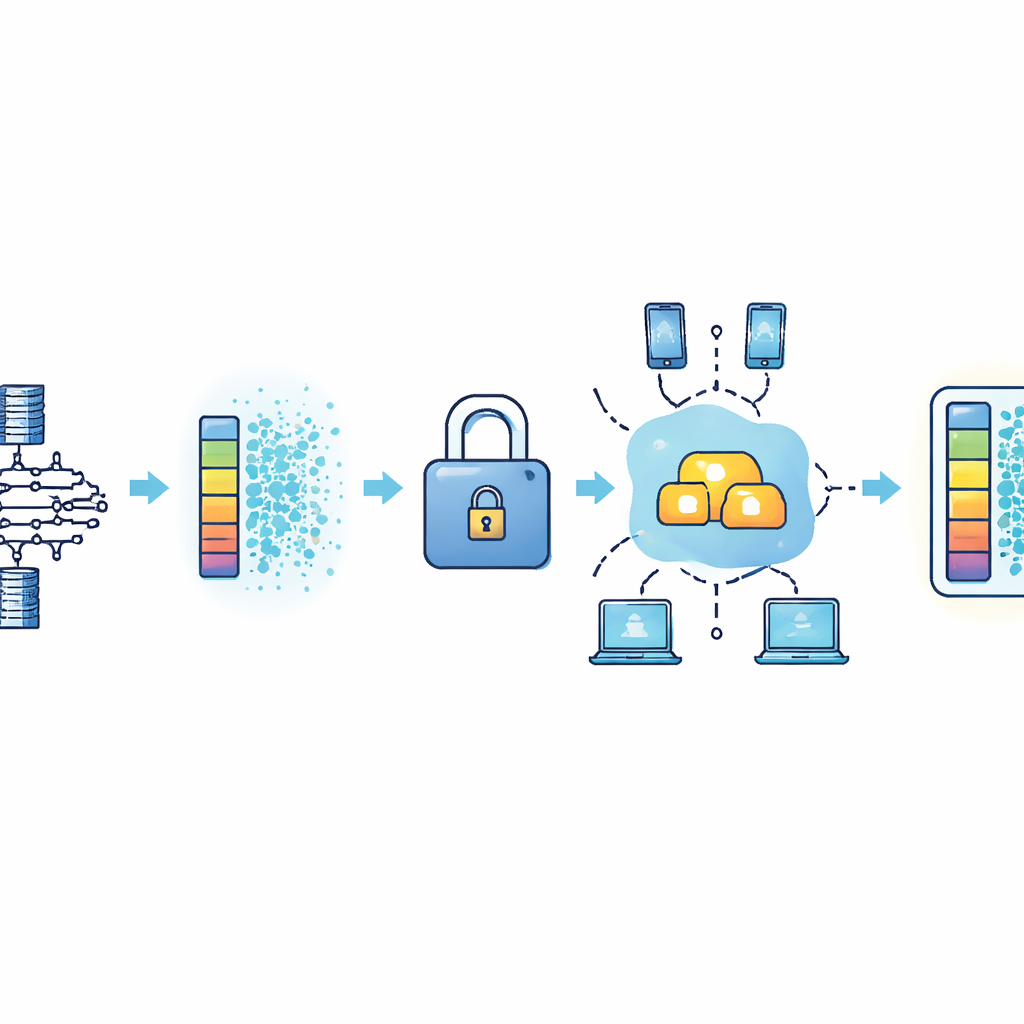

Os autores projetam uma estrutura de aprendizado federado centrada em um modelo de reconhecimento de imagem robusto conhecido como ResNet‑50 para distinguir COVID‑19 de radiografias torácicas normais. Cada hospital treina sua própria cópia desse modelo em suas imagens locais, mantendo todos os raios‑X no local. Em vez de enviar imagens, os hospitais transmitem apenas atualizações numéricas que descrevem como o modelo local deve mudar. Um servidor central faz a média dessas atualizações para formar um modelo global melhorado e depois envia o modelo refinado de volta a cada hospital. Repetir esse ciclo permite que o modelo compartilhado se beneficie da experiência combinada de todos os participantes sem expor exames individuais.

Adicionando “Ruído” Digital e Cofres para Mais Privacidade

Para impedir que atacantes reconstruam imagens de pacientes a partir das atualizações do modelo, a estrutura sobrepõe duas técnicas de privacidade ao aprendizado federado. Primeiro, cada hospital adiciona ruído aleatório cuidadosamente calibrado às suas atualizações de modelo, algo como acrescentar estática a um sinal de rádio para tornar vozes individuais mais difíceis de distinguir, enquanto a mensagem geral ainda é preservada. Segundo, antes que as atualizações viajem pela rede, elas são criptografadas usando um método que permite ao servidor somá‑las enquanto permanecem trancadas — semelhante a somar valores dentro de envelopes selados. Apenas um detentor de chave confiável pode desbloquear o resultado combinado, e o servidor central nunca vê a atualização de um hospital em forma legível. Juntas, essas etapas visam frustrar tentativas de engenharia reversa dos dados dos pacientes enquanto preservam a utilidade do modelo compartilhado.

Testando o Sistema

A equipe avalia sua estrutura em um conjunto equilibrado de imagens de radiografia torácica com COVID‑19 e normais, simulando vários hospitais como sites de treinamento separados. Eles comparam três configurações: treinamento centralizado clássico com todos os dados reunidos, aprendizado federado padrão sem proteções extras, e sua abordagem com privacidade reforçada. Apesar do ruído e da criptografia adicionados, o sistema protegido atinge resultados notavelmente altos — cerca de 99,6% de acurácia, com precisão, sensibilidade e valor F1 igualmente fortes — igualando ou superando tanto a versão centralizada quanto a federada sem proteção. Medidas de rodadas de comunicação, perda de treinamento e tempo de computação mostram que a acurácia melhora de forma consistente conforme os sites colaboram, enquanto o custo adicional de tempo devido à criptografia permanece modesto. Experimentos de ablação, nos quais partes do sistema são ativadas ou desativadas, confirmam que os níveis de ruído escolhidos e a estratégia de criptografia mais compressão oferecem forte privacidade com apenas pequenas compensações de desempenho.

O Que Isso Significa para o Cuidado Futuro

Para não especialistas, a mensagem principal é que este trabalho demonstra uma receita prática para treinar IA a partir dos raios‑X de muitos hospitais sem expor imagens brutas ou enfraquecer leis de privacidade. Ao combinar um modelo de imagem de alto desempenho com “estática” digital e agregação criptografada, a estrutura mostra que hospitais podem construir conjuntamente ferramentas diagnósticas precisas mantendo os prontuários dos pacientes localmente e fora do alcance de olhares indesejados. Embora testado em um conjunto de dados relativamente pequeno e focado em radiografias de COVID‑19, as mesmas ideias poderiam se estender a outras doenças, tipos de imagem e até outros campos sensíveis como finanças. Em suma, o estudo aponta para um futuro em que IA poderosa e forte privacidade médica podem se reforçar mutuamente, em vez de se opor.

Citação: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

Palavras-chave: aprendizado federado, imagem médica, privacidade de dados, criptografia homomórfica, diagnóstico por raio‑X