Clear Sky Science · pt

Inteligência humana versus artificial no diagnóstico em patologia oral: um estudo comparativo do ChatGPT, Grok e MANUS

Por que isso importa para a sua próxima visita ao dentista

Quando um dentista encontra uma lesão suspeita na sua boca, a palavra final sobre se ela é inofensiva ou perigosa normalmente vem de um especialista que analisa o tecido ao microscópio. Esse trabalho é cuidadoso, consome tempo e, em muitas partes do mundo, faltam especialistas. Este estudo faz uma pergunta atual: os modernos sistemas de inteligência artificial podem ajudar a interpretar essas imagens microscópicas de tecidos bucais com precisão próxima à dos especialistas humanos, tornando o diagnóstico mais rápido, consistente e mais amplamente disponível?

O que os pesquisadores se propuseram a testar

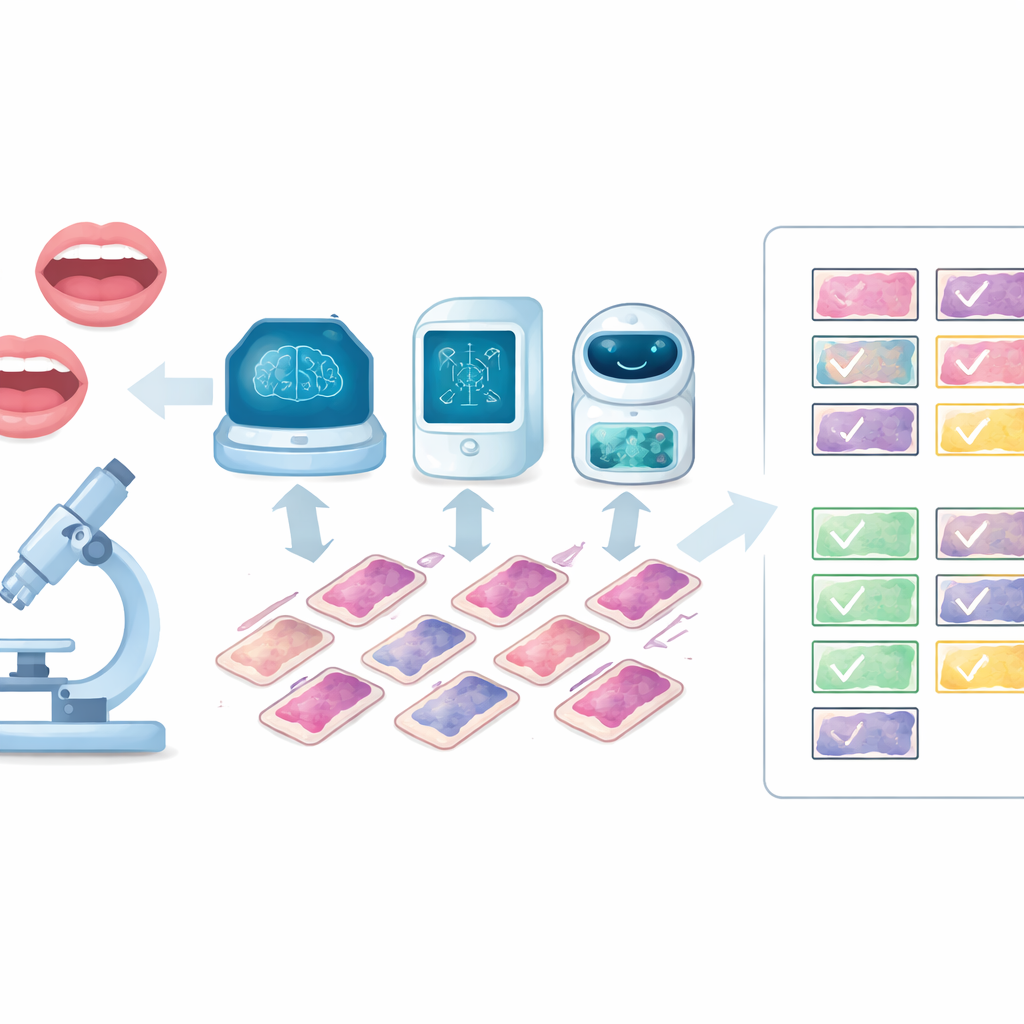

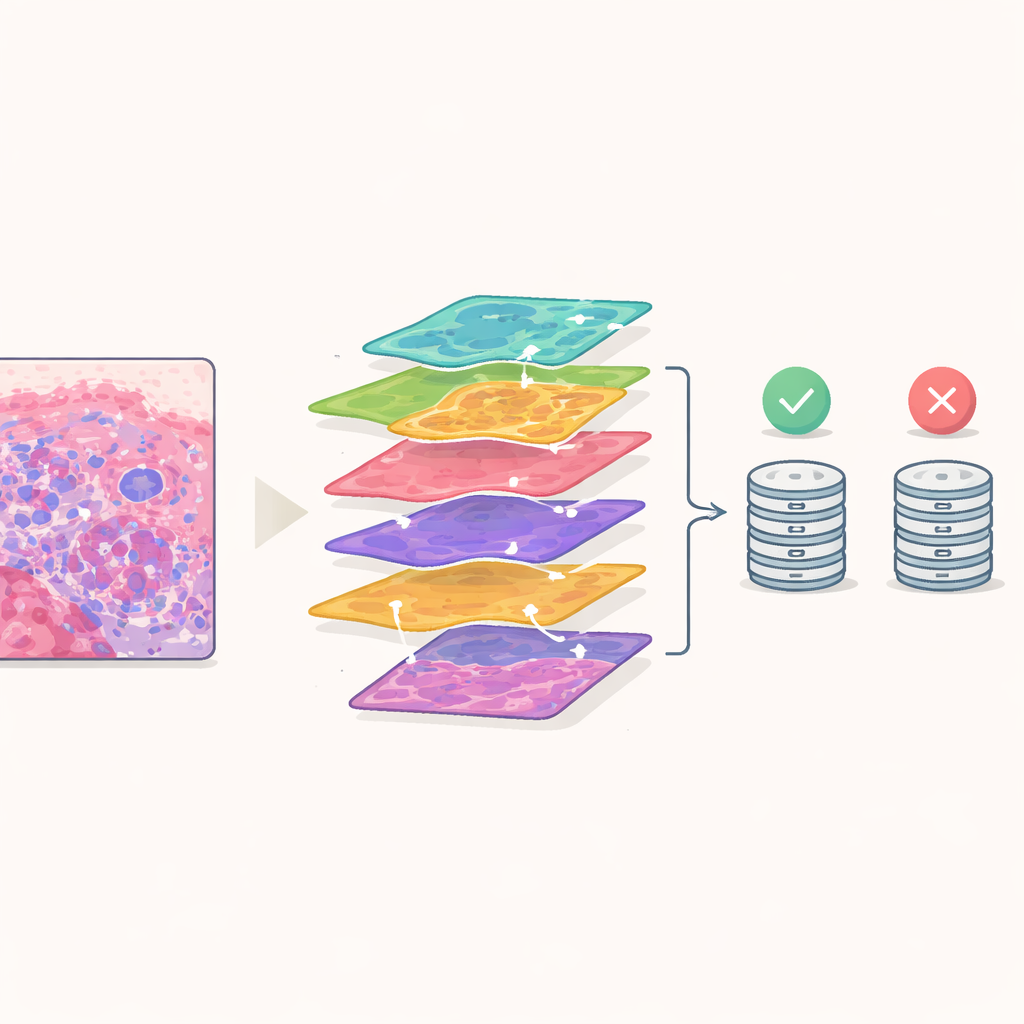

A equipe concentrou-se em três programas avançados conhecidos por entender tanto imagens quanto linguagem: ChatGPT, Grok e um sistema médico chamado MANUS. Em vez de usar dados de pacientes reais, recorreram a 100 imagens microscópicas claras e de alta qualidade retiradas de um livro-texto padrão de doenças orais. Cada imagem mostrava um tipo diferente de lesão, variando de alterações precursoras de câncer a tumores, cistos e proliferações reativas. Dois patologistas orais experientes primeiro concordaram sobre o diagnóstico correto para cada lâmina, criando um padrão humano robusto contra o qual comparar as máquinas.

Como funcionou a comparação direta

Cada uma das 100 lâminas foi apresentada aos três sistemas de IA usando a mesma mensagem curta descrevendo o caso e a mesma imagem digital. Pediu-se aos modelos que indicassem o único diagnóstico mais provável, assim como um especialista faria ao emitir um laudo. Para verificar se os sistemas mantinham respostas estáveis ao longo do tempo, os pesquisadores repetiram todo o processo duas semanas depois com as mesmas lâminas e instruções. Enquanto isso, os dois patologistas humanos leram as lâminas de forma independente, sem ver os resultados da IA, e depois discutiram eventuais diferenças até concordarem em uma decisão final. Essas decisões de especialistas foram tratadas como a melhor resposta disponível.

Desempenho das máquinas e dos humanos

As três ferramentas de IA tiveram desempenho notável. Na segunda rodada de testes, Grok identificou corretamente 97 de 100 casos, MANUS 96 e ChatGPT 94. O par de especialistas humanos obteve pontuação ligeiramente superior, classificando corretamente 98 lâminas. O ChatGPT destacou-se por apresentar praticamente as mesmas respostas nas duas rodadas, mostrando forte consistência interna, enquanto MANUS e Grok também exibiram desempenho sólido e estável. Quando os sistemas foram comparados entre si, concordaram na grande maioria dos casos, sugerindo que designs diferentes de IA podem chegar a julgamentos muito semelhantes quando recebem imagens de alta qualidade.

Quão perto a IA esteve do raciocínio dos especialistas

Achar a resposta correta é apenas parte da questão; também importa se os computadores tendem a concordar com os padrões de raciocínio humano. Nesse aspecto, o MANUS mostrou o alinhamento mais próximo com as decisões dos patologistas, mesmo quando não superou o Grok em acurácia bruta. O Grok, embora ligeiramente mais preciso no geral, às vezes chegou a escolhas diferentes das dos especialistas nos poucos casos mais difíceis. A maioria dos erros nos três sistemas ocorreu em lâminas visualmente confusas mesmo para olhos treinados, onde alterações teciduais se sobrepunham ou pareciam limítrofes entre duas condições. Ainda assim, não houve grandes discrepâncias de desempenho entre os modelos, e todos os três apresentaram níveis de concordância com os humanos que os autores descrevem como moderados a substanciais.

O que isso pode significar para o cuidado futuro

O estudo sugere que os atuais sistemas multimodais de IA já são capazes de atuar como auxiliares confiáveis no diagnóstico microscópico de doenças orais. Eles não substituem os patologistas, que ainda tiveram a melhor acurácia geral e fornecem julgamento clínico essencial, mas podem funcionar como segundos leitores rápidos, apoiar a formação de novos especialistas ou oferecer assistência de nível especializado em regiões com acesso limitado a serviços de patologia odontológica. Como a pesquisa usou imagens cuidadosamente selecionadas de livros-texto em vez de amostras do mundo real, os autores enfatizam que são necessários mais testes em coleções clínicas maiores e mais variadas e com informações adicionais do paciente. Se essas verificações posteriores confirmarem a promessa inicial, a IA pode tornar o diagnóstico de doenças bucais mais preciso, consistente e acessível para pacientes em todo o mundo.

Citação: Alshammari, A.F., Madfa, A.A. & Anazi, B.A. Human versus artificial intelligence in oral pathology diagnosis: a comparative study of ChatGPT, Grok, and MANUS. Sci Rep 16, 11057 (2026). https://doi.org/10.1038/s41598-026-40792-0

Palavras-chave: patologia oral, patologia digital, inteligência artificial, modelos de linguagem ampla, diagnóstico histopatológico