Clear Sky Science · pt

Abrindo a caixa-preta: IA explicável para análise automatizada de bioturbação em testemunhos e afloramentos

Vendo pistas ocultas na lama antiga

Quando animais cavam através da lama macia do fundo do mar, deixam para trás um labirinto de túneis que pode ser preservado por milhões de anos. Esses padrões sutis, chamados de bioturbação, ajudam geólogos a interpretar ambientes passados e até a localizar reservatórios de petróleo e gás. Mas identificar e classificar essas marcas visualmente é um trabalho lento e sujeito a variação entre observadores. Este estudo mostra como uma nova geração de inteligência artificial “explicável” pode não apenas automatizar essa tarefa, como também revelar exatamente o que o computador está observando, transformando uma caixa-preta em uma caixa de vidro.

Por que túneis em rocha importam

Muitas decisões geológicas ainda começam com uma observação simples: de penhascos, testemunhos de perfuração e lâminas delgadas de rocha. A disposição das camadas, o quão limpas ou perturbadas elas parecem e onde túneis as cortam são indícios de profundidade da água, energia do ambiente, níveis de oxigênio e das criaturas que ali viveram. Geólogos costumam resumir essa perturbação como intensidade de bioturbação, que vai de camadas intactas a sedimento completamente remexido. Essas classificações são vitais para reconstruir linhas costeiras antigas e para avaliar com que facilidade fluidos podem se mover por arenitos enterrados que podem servir como reservatórios. Ainda assim, até especialistas podem discordar, especialmente em casos limítrofes onde a bioturbação é moderada em vez de claramente fraca ou intensa.

Ensinando um computador a ler fotos de rocha

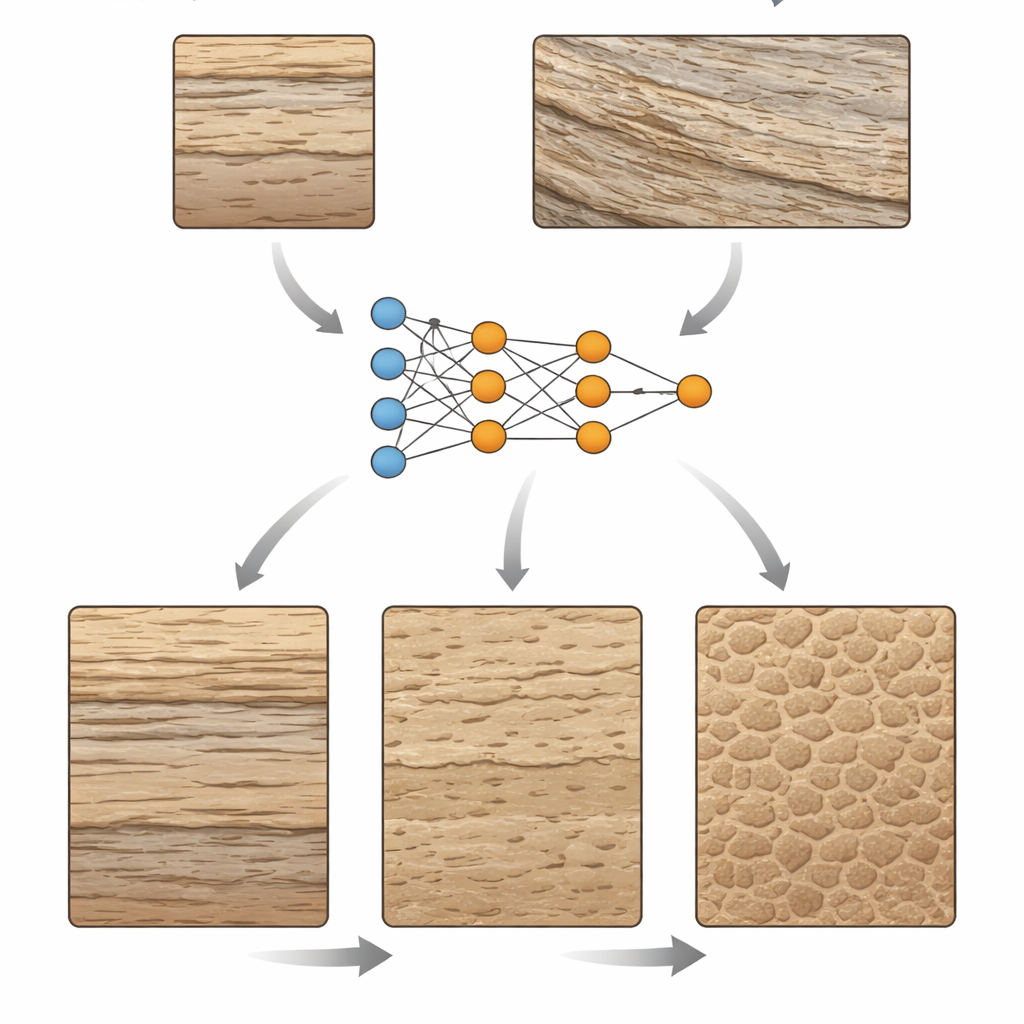

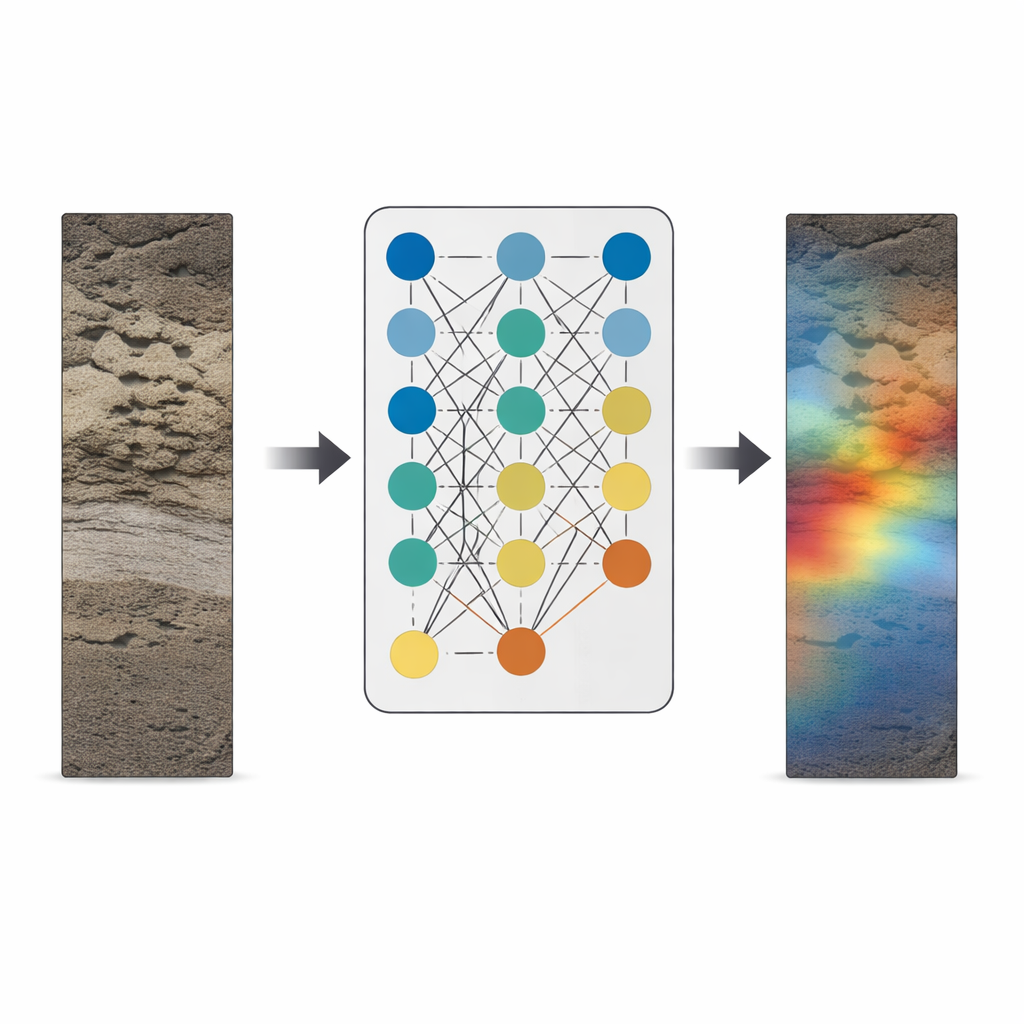

Os autores partem de um modelo de aprendizado profundo anterior, treinado para classificar fotos de testemunhos de arenito e afloramentos em três níveis amplos de bioturbação: não trabalhado, moderadamente trabalhado e intensamente trabalhado. O modelo já havia mostrado alta precisão, classificando corretamente a maioria das 262 imagens de teste. Neste estudo, o foco desloca-se de “Quão bem ele faz?” para “O que ele realmente está vendo?” Para responder, a equipe usa ferramentas de IA explicável que produzem mapas de calor sobre cada imagem, destacando as regiões que mais influenciaram a escolha do modelo. Áreas mais vermelhas importam mais para a decisão; tons mais frios importam menos. Essa abordagem permite que geólogos comparem a atenção visual da máquina com a de um icnólogo experiente — um especialista em fósseis de rastro.

Como a caixa-preta se ilumina

O método, conhecido como Grad-CAM, aproveita as camadas finais da rede neural, onde a imagem foi destilada em blocos grosseiros de características. Quando o modelo decide por uma classe, o Grad-CAM mede quão sensível essa decisão é a cada bloco e projeta o resultado de volta na foto original como uma sobreposição colorida. Para rochas sem bioturbação, os mapas de calor tendem a acender blocos de estratificação bem preservada ou unidades maciças e intocadas, às vezes também destacando fraturas naturais ou seixos dispersos que se sobressaem contra um fundo uniforme. Em imagens moderadamente bioturbadas, os mapas normalmente focalizam túneis individuais ou zonas onde a estratificação está parcialmente interrompida, coincindo estreitamente com o que especialistas humanos assinalariam. Em amostras intensamente trabalhadas, onde quase toda a estrutura original foi apagada, os mapas exibem um padrão salpicado espalhado pela imagem, espelhando o revolvimento generalizado do antigo fundo marinho.

O que o modelo erra — e por quê

Como as explicações são visuais, os pesquisadores podem investigar os erros do modelo em vez de apenas registrá-los como falhas. Algumas imagens não trabalhadas foram interpretadas como bioturbadas quando certos clastos ou texturas por acaso lembraram túneis. Em outros casos, traços fósseis muito pequenos ou muito tênues foram ignorados, especialmente quando ocupavam apenas um canto reduzido da foto. Estruturas muito grandes também causaram problemas: se um único túnel largo preenchia a maior parte do quadro e seus detalhes internos estavam atenuados, o modelo o tratou como uma massa sem feição em vez de um rastro. É importante notar que os mapas de calor mostram que o sistema geralmente ignora detritos não geológicos, como marcas de caneta, cortes de serra e sombras, demonstrando que aprendeu a focar em tecidos rochosos em vez de ruído fotográfico. Os autores sugerem que imagens de treinamento mais variadas e de maior qualidade e melhor cobertura dos níveis limítrofes de intensidade poderiam aprimorar ainda mais o desempenho.

De ferramenta de especialista a auxílio didático

Ao abrir o funcionamento interno do modelo à inspeção, a IA explicável ajuda a reduzir a lacuna de confiança entre geocientistas e algoritmos. O estudo mostra que a atenção da rede normalmente se alinha ao julgamento de especialistas, concentrando-se nos mesmos túneis e zonas perturbadas que um icnólogo treinado enfatizaria. Essa transparência facilita a adoção da análise automatizada de bioturbação tanto na pesquisa quanto na indústria, onde a triagem rápida e consistente de grandes bibliotecas de imagens pode economizar tempo e reduzir o viés humano. Ao mesmo tempo, os mapas de calor coloridos funcionam como uma ferramenta de ensino, guiando o olhar dos estudantes para as pistas texturais sutis que separam rochas não trabalhadas, moderadamente trabalhadas e completamente revolvidas. Ao transformar decisões invisíveis do modelo em padrões visíveis, o trabalho aponta para um futuro em que a IA não substitui a intuição geológica, mas a aguça e amplia.

Citação: Ayranci, K., Yildirim, I.E., Yildirim, E.U. et al. Opening the black box: explainable AI for automated bioturbation analysis in cores and outcrops. Sci Rep 16, 9725 (2026). https://doi.org/10.1038/s41598-026-40747-5

Palavras-chave: IA explicável, bioturbação, análise de imagens geológicas, aprendizado profundo, testemunhos sedimentares