Clear Sky Science · pt

Abordando o equilíbrio entre justiça e desempenho na predição do grau de glioma usando técnicas de mitigação de viés

Por que tratar tumores com justiça importa

Quando médicos usam inteligência artificial para auxiliar no diagnóstico de tumores cerebrais, podemos supor que o computador é neutro. Mas se os dados usados para treinar essas ferramentas refletem desigualdades existentes em saúde, o software pode tratar alguns pacientes de forma menos justa do que outros sem que isso seja óbvio. Este estudo investiga como sistemas de aprendizado de máquina que predizem a gravidade dos gliomas — um tipo comum de tumor cerebral em adultos — podem, sem querer, favorecer certos grupos raciais ou de gênero, e testa maneiras práticas de tornar essas predições mais justas sem sacrificar muita acurácia.

Tumores cerebrais e auxiliares computacionais

Gliomas são tumores cerebrais que variam desde formas de crescimento mais lento e mais tratáveis até cânceres muito agressivos com baixa sobrevida. Classificar corretamente esses tumores é vital, pois orienta cirurgia, radioterapia e tratamento medicamentoso. Os pesquisadores trabalharam com um conjunto de dados público de 839 adultos com glioma de baixo grau ou glioblastoma agressivo. Para cada paciente, havia idade, gênero, raça e 20 marcadores genéticos comuns no tumor. Eles treinaram três modelos de predição padrão — regressão logística, florestas aleatórias e gradient boosting — para distinguir os dois graus tumorais usando essas características, e então verificaram tanto a acurácia geral dos modelos quanto como eles tratavam diferentes grupos de pacientes.

Procurando desequilíbrios ocultos

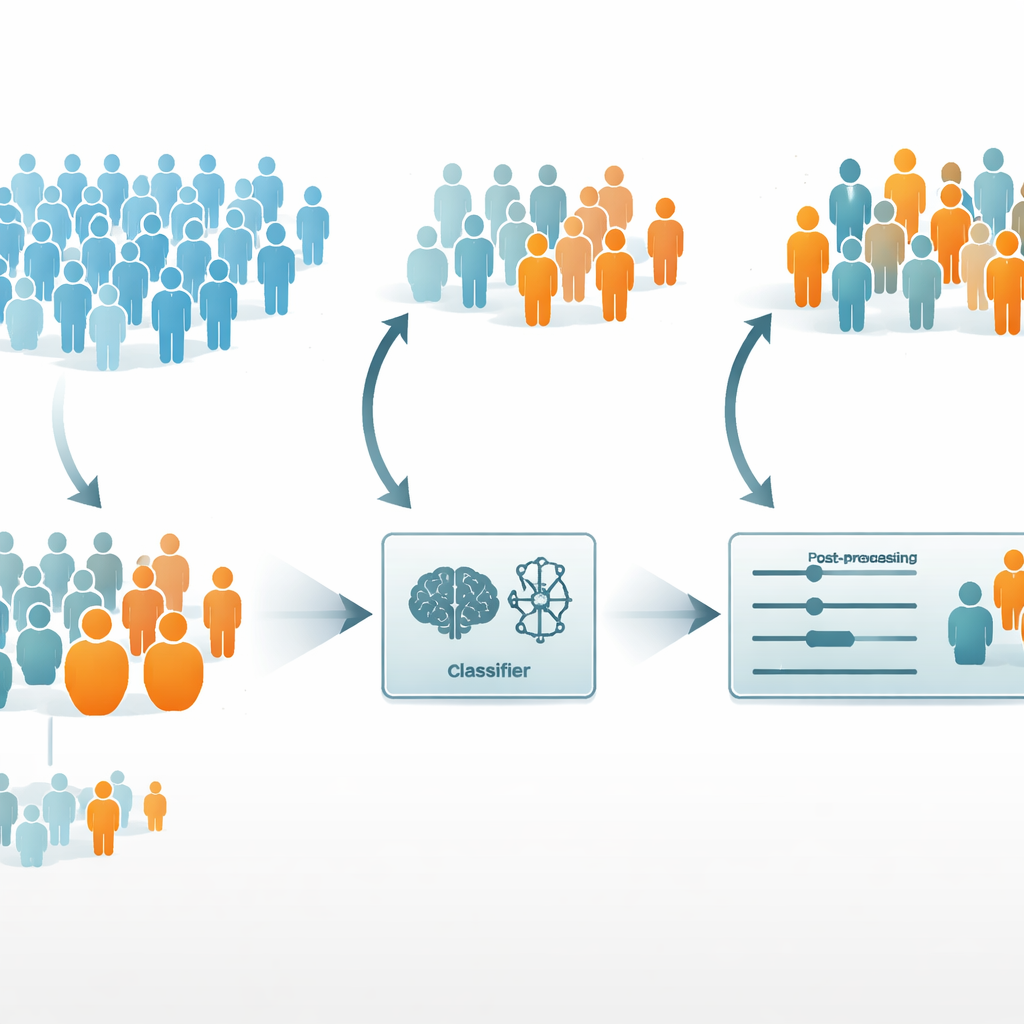

Para investigar a justiça, a equipe focou em duas características “protegidas”: raça (brancos vs. não brancos) e gênero (masculino vs. feminino). O próprio conjunto de dados era enviesado — mais de 90% dos pacientes eram brancos, e havia notavelmente mais homens do que mulheres. Os autores usaram medidas de justiça a nível de grupo que comparam com que frequência diferentes grupos recebem uma predição correta de “alto grau” e com que frequência o modelo comete erros para cada grupo. Todos os três modelos foram bastante precisos no geral, com regressão logística tendo o melhor desempenho. Mas abaixo desse sucesso, as checagens de justiça revelaram que pacientes não brancos geralmente tiveram resultados piores do que pacientes brancos, especialmente na identificação correta dos tumores menos agressivos. Em contraste, o desempenho entre homens e mulheres foi muito mais equilibrado, com apenas pequenas diferenças entre os gêneros.

Tentando corrigir o viés

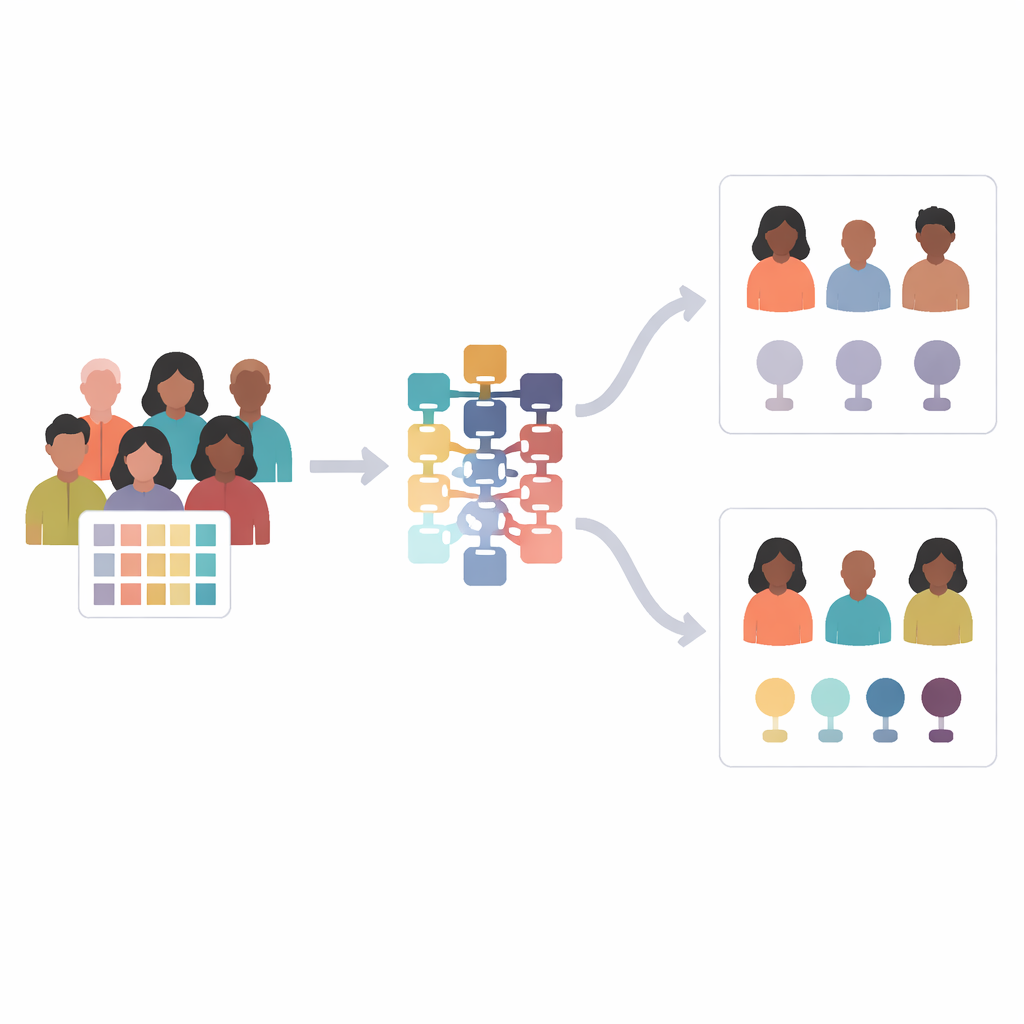

Os pesquisadores então perguntaram se poderiam melhorar a justiça sem enfraquecer seriamente a utilidade clínica do modelo. Escolheram regressão logística como modelo base, já que era tanto o mais preciso quanto o mais justo dos três. Testaram duas estratégias comuns de desenviesamento. Uma abordagem de “pré-processamento” chamada reponderação deu maior importância a pacientes sub-representados durante o treinamento, para que o modelo lhes prestasse mais atenção. Uma abordagem de “pós-processamento” chamada odds equalizados manteve o modelo treinado, mas ajustou suas saídas para que as taxas de erro ficassem mais semelhantes entre os grupos.

O que mudou quando o modelo foi ajustado

Para o gênero, ambas as estratégias geralmente ajudaram: a qualidade da predição para mulheres melhorou, e as diferenças entre homens e mulheres diminuíram em grande medida. Para a raça, onde o desequilíbrio nos dados era muito mais forte, o quadro foi mais complicado. A reponderação às vezes teve efeito contrário, piorando ligeiramente o desempenho para pacientes não brancos e até aumentando a injustiça segundo algumas medidas. Em contraste, o método de pós-processamento reduziu substancialmente as discrepâncias raciais nas taxas de erro enquanto mantinha alta a acurácia geral do modelo, embora tenha reduzido um pouco o desempenho para o grupo majoritário. Os autores também mostraram que os números de justiça para o grupo muito menor de não brancos são estatisticamente instáveis — mudar a predição de apenas uma pessoa pode alterar visivelmente as pontuações de justiça — então esses resultados devem ser interpretados com cautela.

O que isso significa para pacientes e médicos

O estudo conclui que não existe almoço grátis: melhorar a justiça em IA médica frequentemente envolve trade-offs de desempenho, e a melhor correção depende de quão enviesados estão os dados e qual objetivo de justiça é priorizado. Neste exemplo de tumor cerebral, ajustar as saídas do modelo após o treinamento foi a maneira mais prática de tornar as recomendações de tratamento mais equitativas entre raça e gênero, preservando forte poder preditivo. O trabalho destaca que verificações de justiça devem ser rotineiras ao implantar IA em saúde, especialmente para condições graves como glioma, e que existem métodos para tornar essas ferramentas mais justas — mas eles devem ser escolhidos e interpretados com cuidado.

Citação: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

Palavras-chave: classificação de glioma, justiça em IA médica, viés algorítmico, tumores cerebrais, mitigação de viés