Clear Sky Science · pt

IA explicável na educação: integrando conhecimento do domínio educacional no modelo de deep learning para melhorar a previsão de desempenho estudantil

Por que previsões mais inteligentes sobre alunos importam

As escolas estão cada vez mais recorrendo à inteligência artificial para identificar quais alunos podem ter dificuldades e quem pode precisar de apoio extra. Mas quando esses sistemas se comportam como caixas-pretas seladas, eles podem destacar padrões estranhos — por exemplo, sugerir que a vida amorosa de um adolescente importa mais do que o tempo de estudo — deixando professores e pais inseguros sobre confiar nos resultados. Este artigo mostra como construir um sistema de previsão de desempenho estudantil que não apenas faz prognósticos melhores das notas de matemática, como também “raciocina” de maneiras que se alinham com o que décadas de pesquisa educacional já nos dizem.

De dados brutos a alertas de risco

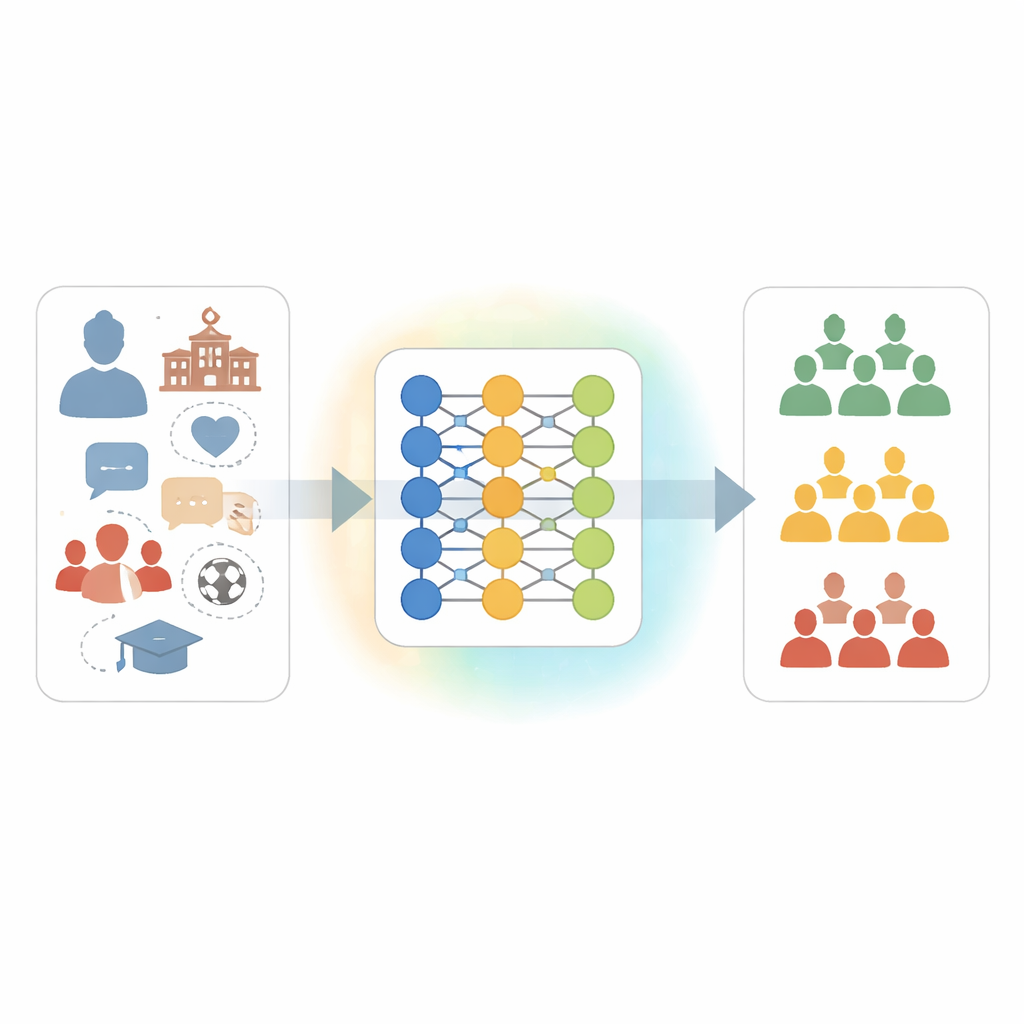

Os pesquisadores trabalharam com um conjunto de dados público e bem conhecido de 395 alunos do ensino médio português, cada um descrito por 30 informações. Estas variavam desde demografia básica (idade, sexo, tamanho da família) até detalhes relacionados à escola (tempo de estudo, faltas, aulas extras) e aspectos da vida social e bem-estar (relacionamento familiar, tempo livre, sair com amigos). O objetivo foi prever a nota final de matemática de cada aluno e então agrupá-los em três categorias práticas: provável reprovação, dentro do esperado ou desempenho excelente. Um modelo de deep learning chamado rede neural artificial (ANN) foi treinado para captar padrões sutis entre todos esses fatores.

Quando a caixa-preta erra

Embora a ANN original tenha alcançado uma precisão respeitável, uma inspeção mais atenta revelou algo preocupante. Usando uma técnica moderna de explicação conhecida como SHAP, os autores examinaram quais características o modelo mais utilizava. Alguns dos sinais mais fortes entravam em conflito com achados educacionais bem estabelecidos. Por exemplo, a escola que o aluno frequentava, seu estado romântico e com que frequência saía pareceram influentes de forma incomum, enquanto fatores apoiados por pesquisa, como a educação dos pais, o emprego da mãe, a frequência a creches na infância, o tamanho da família e o tempo semanal de estudo receberam surpreendentemente pouca importância. Essas discrepâncias sugeriram que a ANN estava se apegando a particularidades deste conjunto de dados em vez de relações que educadores consideram significativas ou justas.

Ensinando à rede o que educadores já sabem

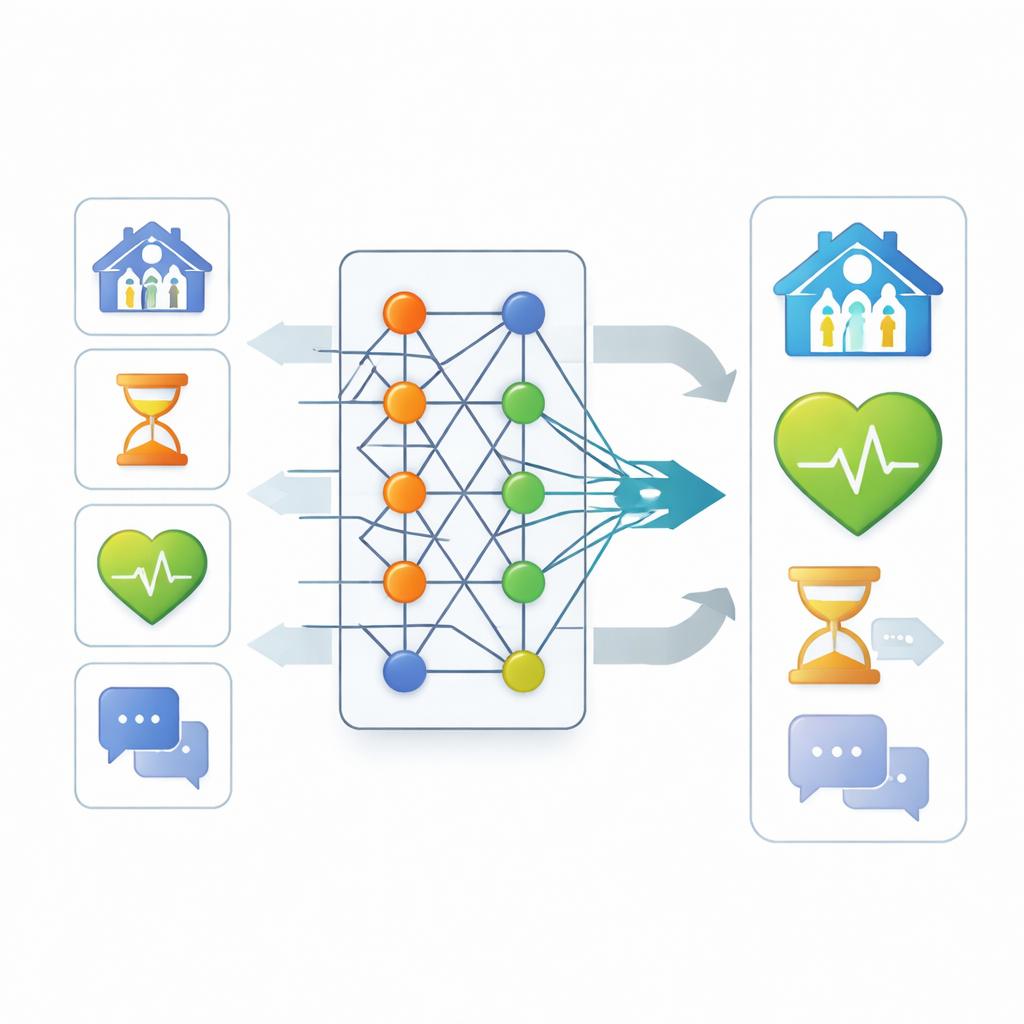

Para realinhar o modelo com o conhecimento educacional, os autores propuseram uma nova estratégia de treinamento chamada algoritmo Students’ Performance Prediction Explanation (SPPE). Primeiro, eles revisaram a literatura educacional para classificar as características em dois grupos aproximados: aquelas consistentemente ligadas ao desempenho (como tempo de estudo, educação dos pais e aspirações de ensino superior) e aquelas que são preditores mais fracos ou incertos (como estado romântico ou avaliações genéricas de relacionamento familiar). Durante o treinamento, o SPPE incentiva a rede neural a aumentar sua dependência do primeiro grupo e atenuar a do segundo. Faz isso monitorando quanto cada característica contribui para as previsões e adicionando uma penalidade suave sempre que o padrão de importância aprendido pela rede se afasta desse conhecimento de domínio.

Explicações mais claras e previsões mais precisas

Após os ajustes do SPPE, o raciocínio interno do modelo mudou de maneiras que melhor corresponderam às expectativas dos educadores. Tempo de estudo, histórico dos pais, tamanho da família e a escolarização precoce subiram na escala de importância, enquanto identidade da escola, sair com amigos e estado romântico tornaram-se menos dominantes. Tão importante quanto, esse realinhamento não sacrificou a acurácia — ele a aumentou. Ao prever em qual das três faixas de nota um aluno cairia, a rede melhorada classificou corretamente cerca de dois terços dos alunos, comparado com pouco mais de um terço do modelo original. Medidas padrão de precisão, recall e uma pontuação F1 combinada aumentaram substancialmente, e testes estatísticos confirmaram que os ganhos provavelmente não se deveram ao acaso. Os autores também mostraram que a mesma estratégia SPPE melhorou vários outros projetos de redes neurais, sugerindo que a abordagem é robusta e não um truque pontual.

O que isso significa para salas de aula e IA

Para educadores e formuladores de políticas, o estudo oferece uma saída da escolha desconfortável entre modelos precisos porém opacos e modelos transparentes porém fracos. Ao entrelaçar a expertise humana no próprio processo de aprendizagem, o SPPE produz previsões que são ao mesmo tempo mais confiáveis e mais fáceis de justificar: o tempo dedicado ao estudo e as ambições educacionais de longo prazo passam a ter mais peso do que a escola que o aluno por acaso frequenta. Embora o trabalho se concentre em um conjunto de dados de matemática de Portugal, a mensagem mais ampla é que IA explicável, guiada por conhecimento, pode apoiar decisões melhores e mais justas sobre o apoio aos alunos — desde que o contexto local e o juízo de especialistas sejam incorporados desde o início.

Citação: Qiang, M., Liu, Z. & Zhang, R. Explainable AI in education: integrating educational domain knowledge into the deep learning model for improved student performance prediction. Sci Rep 16, 9515 (2026). https://doi.org/10.1038/s41598-026-40538-y

Palavras-chave: previsão de desempenho estudantil, IA explicável, mineração de dados educacionais, redes neurais na educação, integração de conhecimento de domínio