Clear Sky Science · pt

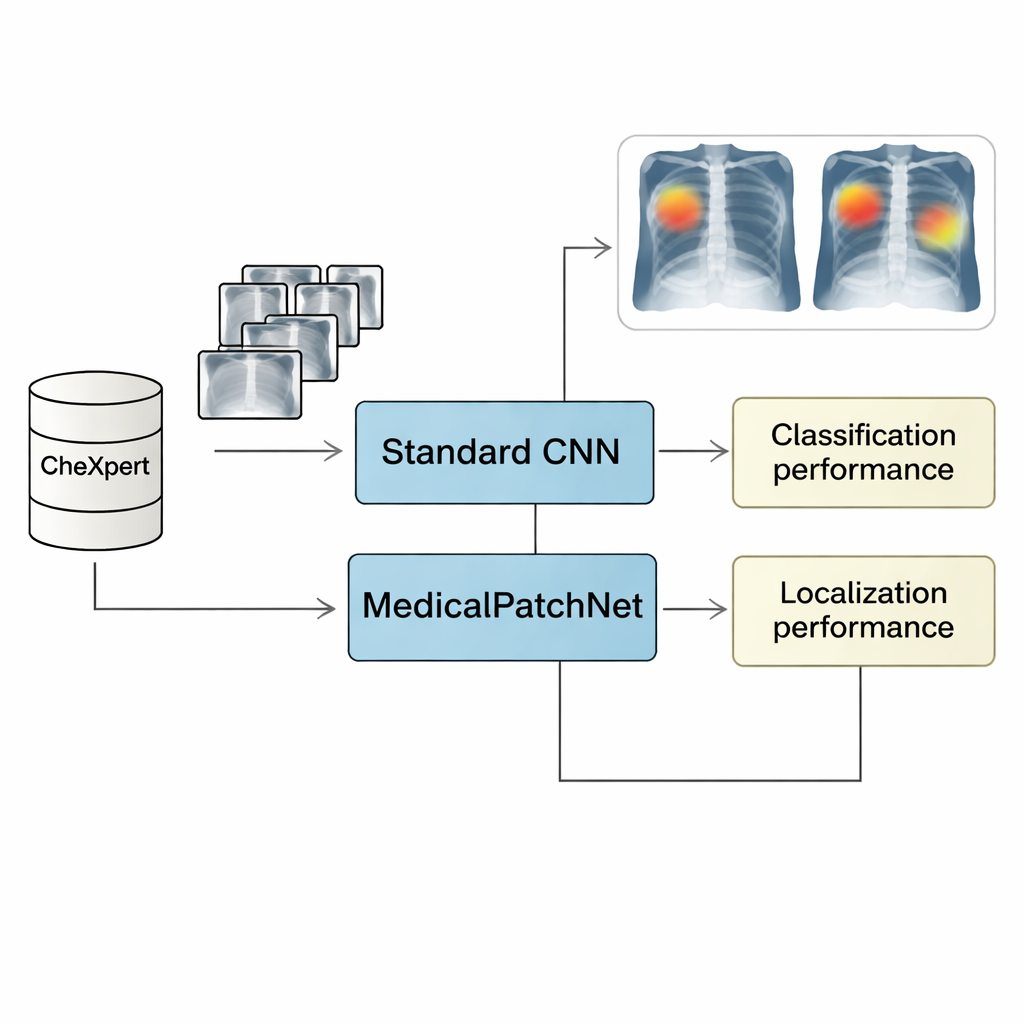

MedicalPatchNet: uma arquitetura de IA autoexplicável baseada em patches para classificação de radiografias torácicas

Por que raios‑X mais inteligentes importam

Radiografias torácicas estão entre os exames médicos mais comuns do mundo, e sistemas de inteligência artificial (IA) ajudam cada vez mais os médicos a interpretá‑las. Mas muitos dos modelos de melhor desempenho hoje funcionam como “caixas‑pretas”: podem ser precisos, porém mesmo especialistas não conseguem ver facilmente por que chegaram a um diagnóstico específico. Essa falta de transparência dificulta a confiança dos clínicos e o uso seguro da IA na prática real. O estudo apresenta o MedicalPatchNet, uma nova abordagem de IA que busca manter alta acurácia enquanto torna seu raciocínio visível e compreensível, inclusive para quem não tem formação em aprendizado de máquina.

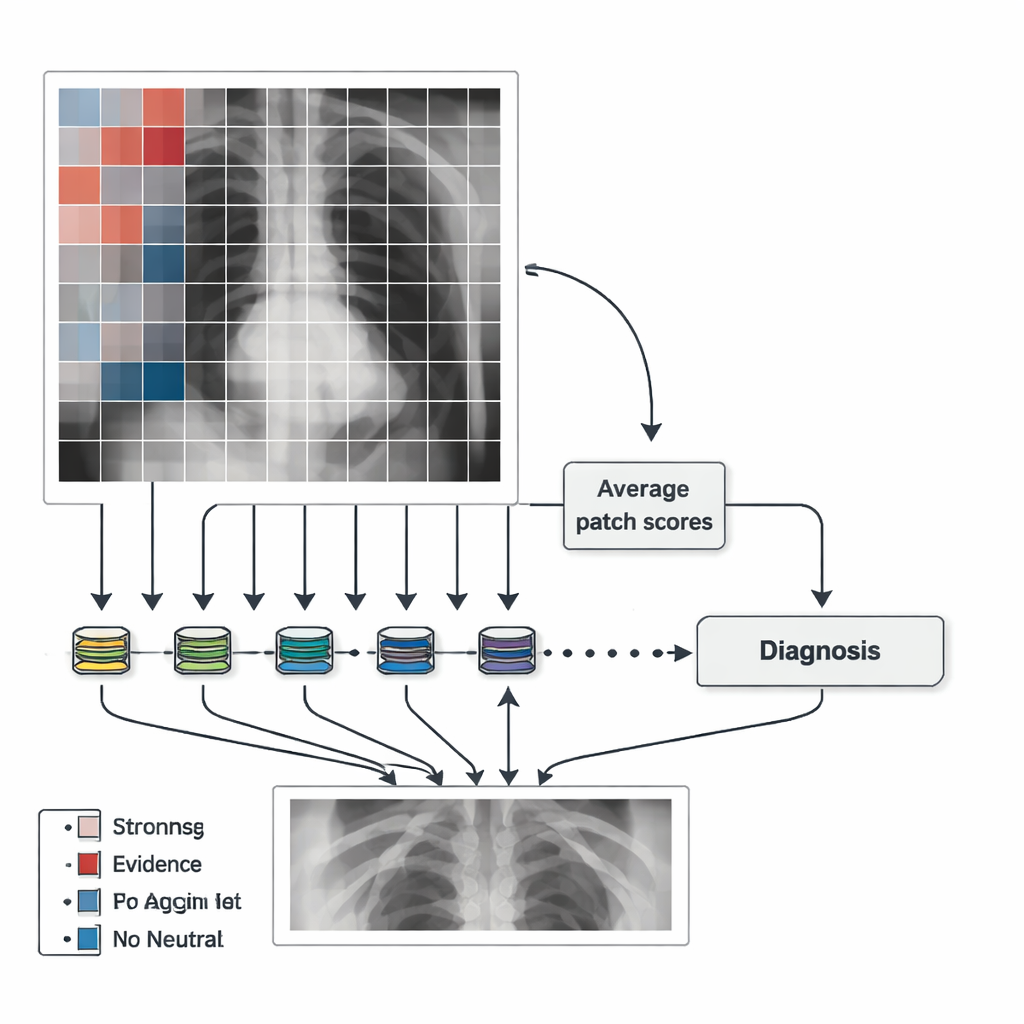

Dividindo imagens em pequenas regiões significativas

Em vez de analisar uma radiografia torácica como um grande todo misterioso, o MedicalPatchNet atua dividindo a imagem em muitos quadrados pequenos e não sobrepostos, ou “patches”. Cada patch é processado pela mesma rede neural, que produz uma pontuação para diversos achados possíveis, como opacidade pulmonar, pneumonia ou derrame pleural (líquido ao redor dos pulmões). Essas pontuações por patch são então simplesmente médias para obter uma decisão geral para toda a imagem. Como a resposta final é apenas a soma de muitos votos locais, fica simples mostrar quanto cada patch contribuiu para o diagnóstico. Fundamentalmente, não há mecanismos de atenção ocultos nem esquemas complexos de ponderação interna, de modo que a influência de cada região é definida explicitamente em vez de aprendida de forma opaca.

Transformando decisões do modelo em mapas visuais claros

Os autores usam essas pontuações por patch para criar “mapas de saliência” que destacam onde a IA encontrou evidências a favor ou contra uma doença. Patches que apoiam fortemente um achado são mostrados em cores quentes (por exemplo, vermelho), os que contrariam em cores frias (como azul) e áreas neutras em cinza. Isso facilita ver se o modelo está focando nos pulmões, no coração ou, preocupantemente, em elementos irrelevantes como artefatos de borda ou rótulos de texto. Para tornar os mapas mais suaves e menos em blocos, a equipe também gera mapas após deslocar ligeiramente a imagem em vários passos pequenos e calcular a média dos resultados. Isso adiciona algum custo computacional, mas produz heatmaps que combinam melhor com a anatomia subjacente, preservando ao mesmo tempo o vínculo claro entre cada região e sua contribuição para a decisão final.

Igualando desempenho de caixas‑pretas enquanto melhora a confiança

Para testar o MedicalPatchNet, os pesquisadores o treinaram no CheXpert, um grande conjunto de dados público com mais de 220.000 radiografias torácicas rotuladas para 14 achados comuns. Compararam seu desempenho com o de um forte modelo convencional de nível de imagem usando a mesma rede base (EfficientNetV2‑S). Em média, os dois modelos alcançaram desempenho diagnóstico quase idêntico, medido pela Área Sob a Curva ROC (AUROC), sensibilidade, especificidade e acurácia. Em outras palavras, forçar o modelo a raciocinar patch a patch e depois fazer a média dos resultados não reduziu de forma significativa sua capacidade de reconhecer doenças. Isso sugere que, para muitas tarefas em radiografia torácica, a informação local da imagem é suficiente, sem necessidade do modelo depender de padrões globais complexos para ter bom desempenho.

Ver onde o modelo “olha” em busca de doença

Além da acurácia geral, a questão principal é se o MedicalPatchNet se explica de forma mais confiável do que ferramentas populares “pós‑hoc”, como Grad‑CAM e suas variantes. Para isso, a equipe usou um segundo conjunto de dados, o CheXlocalize, que fornece contornos desenhados por radiologistas das regiões de doença reais. Eles mediram com que frequência o ponto mais destacado por um método caía dentro da área anormal verdadeira (a “taxa de acerto”) e quão bem a região destacada sobrepunha‑se às anotações de especialistas (Intersection over Union média, ou mIoU). Os mapas baseados em patches do MedicalPatchNet alcançaram taxas de acerto maiores do que explicações no estilo Grad‑CAM em nove de dez condições, e o melhor sobrepõe‑me geral ao contar previsões corretas e incorretas. Essa avaliação mais ampla é importante porque penaliza explicações que parecem boas apenas quando o modelo está certo, mas deixam de revelar comportamentos enganosos quando o modelo está errado.

De palpites opacos a parceiros transparentes

Para não especialistas, o resultado principal é que o MedicalPatchNet demonstra ser possível manter desempenho próximo ao estado da arte em diagnóstico por radiografia torácica enquanto torna o raciocínio da IA muito mais transparente. Em vez de heatmaps misteriosos que podem ou não refletir o que realmente motivou a decisão, essa abordagem vincula cada destaque diretamente a um voto local no cálculo do modelo. Os clínicos podem ver não apenas se a IA acredita que uma doença está presente, mas também exatamente onde na imagem ela encontrou evidências a favor ou contra. Embora o método ainda tenha limites — como dificuldade com condições que dependem da consideração conjunta de regiões distantes da imagem —, ele oferece um caminho prático para ferramentas de IA que se comportem menos como caixas‑pretas e mais como parceiros claros e responsáveis em imagem médica.

Citação: Wienholt, P., Kuhl, C., Kather, J.N. et al. MedicalPatchNet: a patch-based self-explainable AI architecture for chest X-ray classification. Sci Rep 16, 7467 (2026). https://doi.org/10.1038/s41598-026-40358-0

Palavras-chave: IA para radiografia torácica, aprendizado profundo explicável, MedicalPatchNet, mapas de saliência em imagens médicas, suporte à decisão em radiologia