Clear Sky Science · pt

Colorização de imagens por deep transfer learning usando VGG19 e CLAHE

Devolvendo vida a fotos antigas

Muitos de nós guardamos caixas de fotos de família em preto e branco ou apreciamos filmes clássicos e documentários vintage. Imaginar como aquelas cenas eram na vida real — céus azuis, campos verdes, tons de pele quentes — pode tornar o passado mais próximo e vívido. Este artigo explora um novo método computacional que adiciona automaticamente cores realistas e contraste agradável a imagens em tons de cinza, facilitando a restauração de fotos antigas, a renovação de filmes em preto e branco e até a melhoria de exames médicos, sem exigir que um especialista pinte cada tonalidade à mão.

Do tingimento manual às máquinas inteligentes

Colorizar imagens é mais difícil do que parece porque uma única tonalidade de cinza pode corresponder a muitas cores possíveis: um cinza médio pode ser um tijolo vermelho, uma folha verde ou uma camisa azul. Ferramentas anteriores dependiam muito da orientação humana. Artistas podiam desenhar “rabiscos” de cor em partes da imagem, e o software propagava essas dicas por regiões semelhantes. Outros sistemas copiavam cores de uma foto de referência com conteúdo parecido. Embora esses métodos pudessem ser convincentes, falhavam quando a orientação era escassa, a imagem de referência não combinava bem ou a cena era complexa. Com a ascensão do deep learning, novos programas aprenderam a “adivinhar” cores diretamente a partir de grandes coleções de fotos de exemplo, reduzindo a necessidade de trabalho manual, mas exigindo tempo de treinamento e poder computacional enormes.

Ensinando a uma rede como o mundo se parece

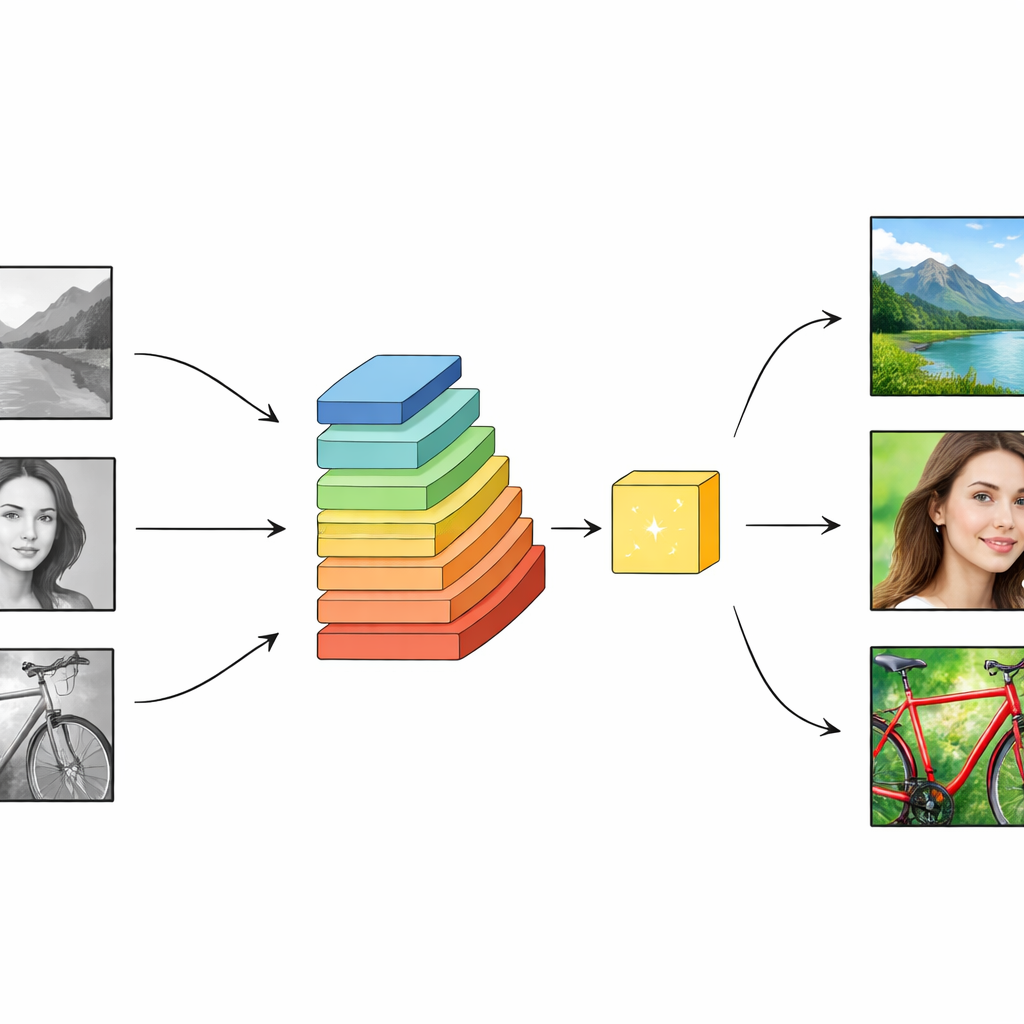

Os autores ampliam esse progresso com uma estratégia conhecida como transfer learning. Em vez de treinar um sistema novo do zero, eles reaproveitam uma poderosa rede de visão chamada VGG19, que já foi treinada em milhões de imagens coloridas. Essa rede tem muitas camadas que progridem de padrões simples, como bordas e texturas, até objetos e cenas inteiras: rostos, árvores, edifícios, céus. O sistema de colorização alimenta uma versão em tons de cinza da imagem na VGG19 e coleta características de várias camadas ao mesmo tempo, formando um “empilhamento” rico de informação para cada pixel. Isso ajuda o modelo a entender tanto detalhes finos — como fios de cabelo ou bordas de folhas — quanto o contexto mais amplo, por exemplo se a cena é uma praia, uma rua da cidade ou uma floresta. Com esse contexto, a rede está melhor posicionada para escolher cores críveis, não apenas matematicamente plausíveis.

Transformando luz e sombra em cor e contraste

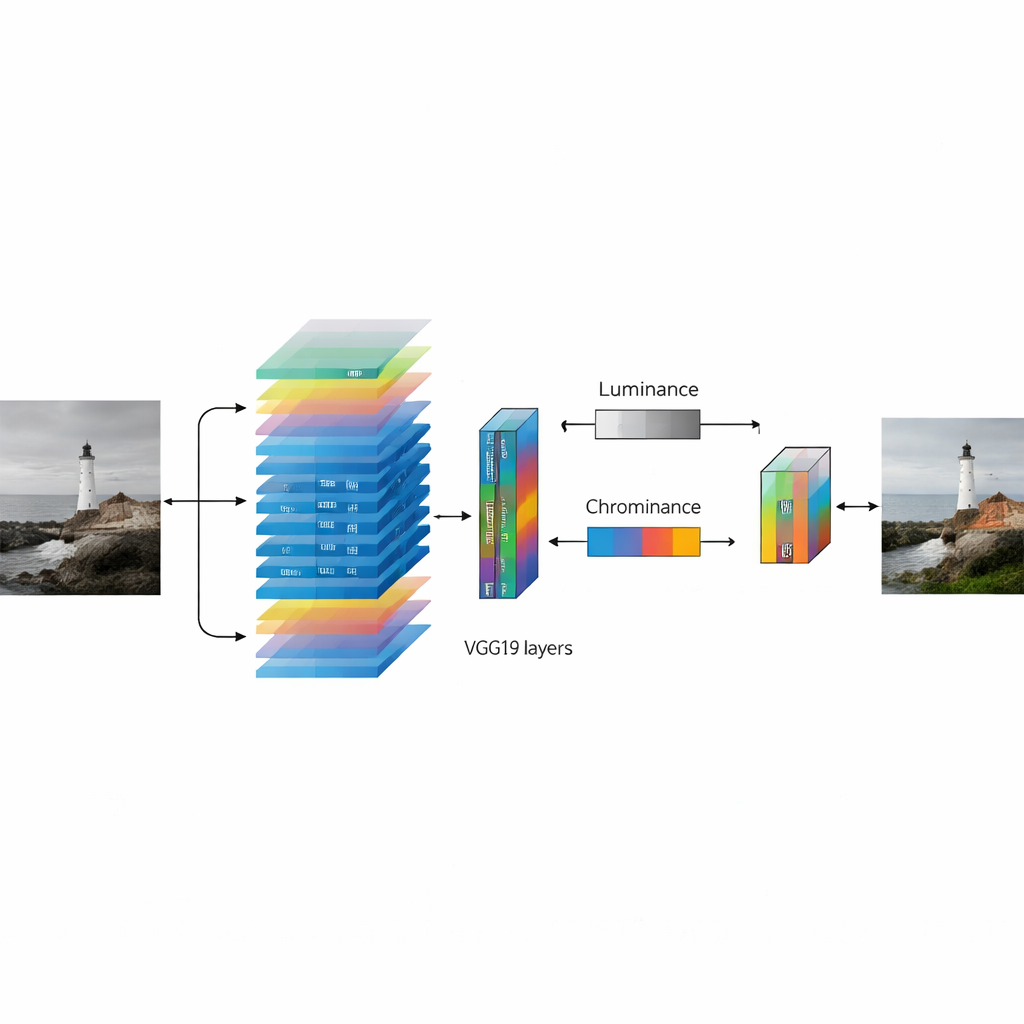

Para tornar as decisões de cor mais estáveis, o método representa as imagens em um espaço de cor que separa luminosidade do conteúdo cromático. A entrada em tons de cinza serve como canal de brilho, enquanto a tarefa da rede é prever os dois canais restantes que codificam os deslocamentos sutis entre vermelho e verde e entre azul e amarelo. Ao manter o brilho fixo, o sistema preserva a modelagem e a estrutura originais da imagem. Depois que a rede produz sua melhor estimativa das informações de cor faltantes, é aplicado um passo final de realce. Aqui os autores usam uma técnica chamada equalização adaptativa de histograma, que estica localmente a faixa entre áreas escuras e claras. Isso torna as texturas mais nítidas, as bordas mais definidas e as cores mais vibrantes, sem simplesmente “estourar” as regiões claras nem perder detalhes nas sombras.

Colocando o método à prova

Para avaliar o desempenho na prática, os pesquisadores treinaram e testaram o método em várias coleções de imagens bem conhecidas que incluem objetos, cenas, pessoas e ambientes do cotidiano. Eles compararam seus resultados com uma variedade de métodos concorrentes, incluindo sistemas guiados por dicas do usuário, modelos generativos que tentam inventar imagens realistas e modelos mais recentes baseados em transformers. Usando medidas padrão de qualidade de imagem, seu método produziu de forma consistente cores mais nítidas e fiéis e estruturas mais claras, com desempenho especialmente forte em um conjunto desafiador de fotografias de cena. Comparações visuais mostram que suas imagens colorizadas frequentemente se aproximam mais das fotos coloridas originais, com saturação mais rica porém controlada e contraste melhor equilibrado. Também destacam onde o método tem dificuldades: imagens muito escuras ou excessivamente claras, ou cenas com texturas incomuns e cores raras, ainda podem levar a tonalidades estranhas ou iluminação desigual.

O que isso significa para imagens do dia a dia

Em termos simples, este estudo mostra que dar a um sistema de colorização uma forte formação prévia sobre o mundo visual — e então aprimorar cuidadosamente o resultado — pode produzir imagens que parecem mais naturais ao olho humano. Ao se apoiar numa grande rede pré‑treinada e adicionar um passo inteligente de ampliação de contraste, os autores oferecem uma ferramenta prática capaz de reviver fotografias históricas, enriquecer filmes em preto e branco e tornar certos tipos de imagens médicas mais fáceis de interpretar. Embora não seja perfeita e possa falhar em condições de iluminação extremas ou em cenas muito incomuns, essa abordagem aproxima a colorização automatizada de algo em que não‑especialistas possam confiar, tornando a cor realista acessível para uma ampla gama de usos cotidianos.

Citação: Ghosh, N., Mandal, G. Deep transfer learning based image colorization using VGG19 and CLAHE. Sci Rep 16, 9528 (2026). https://doi.org/10.1038/s41598-026-40292-1

Palavras-chave: colorização de imagens, deep learning, transfer learning, restauração fotográfica, realce de contraste