Clear Sky Science · pt

Uma estrutura integrada para mitigação proativa de deepfakes via marca d’água orientada por atenção e verificação de autenticidade baseada em blockchain

Por que vídeos falsificados são problema de todo mundo

Vídeos que parecem e soam reais agora podem ser forjados com softwares prontos para uso, borrando a linha entre verdade e ficção online. Esses chamados deepfakes já são usados em golpes, assédio e manobras políticas. Em vez de tentar identificar fakes depois que eles se espalham, este estudo propõe outra questão: e se pudéssemos proteger discretamente vídeos genuínos no momento em que são criados, de forma que qualquer adulteração posterior se tornasse óbvia?

De perseguir falsificações a proteger os originais

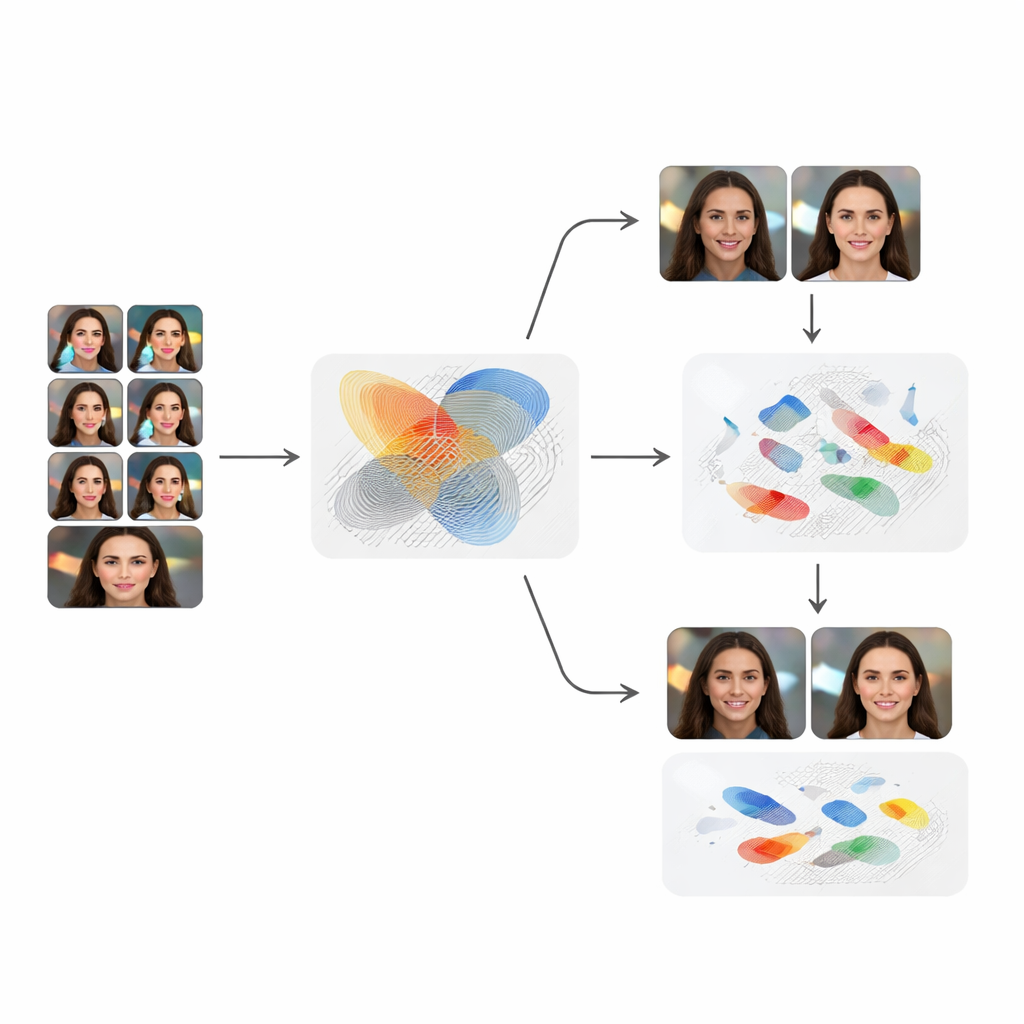

A maior parte da pesquisa atual tenta capturar deepfakes a posteriori, treinando algoritmos para detectar pequenos artefatos deixados por modelos generativos. Mas à medida que esses modelos melhoram, esse jogo de gato e rato fica mais difícil de vencer. Os autores defendem uma abordagem proativa: proteger imagens autênticas enquanto são gravadas, para que espectadores e plataformas possam depois verificar se o que veem é o original intacto. A estrutura combina três camadas: um analisador de vídeo inteligente que decide onde a proteção é mais importante, uma marca digital invisível entrelaçada em cada quadro e um registro em blockchain que fixa a identidade do arquivo como um todo.

Ensinar ao sistema o que realmente importa em um vídeo

A primeira camada é um modelo de atenção que aprende quais partes do vídeo carregam os movimentos e detalhes mais significativos ao longo do tempo. A equipe treina uma rede compacta, porém poderosa, em milhares de clipes cotidianos mostrando pessoas realizando ações. Uma parte da rede examina cada quadro como uma fotografia estática, enquanto outra observa como as coisas se movem em trechos de 16 quadros. Juntas, elas alcançam mais de 97% de acurácia em um teste padrão de reconhecimento de ação, mostrando que o sistema aprendeu padrões ricos de como humanos e cenas mudam ao longo do tempo. Esses padrões são então convertidos em mapas de atenção que destacam regiões onde qualquer adulteração afetaria mais a narrativa do vídeo.

Esconder uma marca secreta onde os falsificadores mais irão causar dano

Em seguida, uma marca digital invisível — uma marca d’água — é inserida em cada quadro, mas não de forma simples e uniforme. Uma rede generativa cria um padrão sutil, semelhante a ruído, que é misturado com mais intensidade nas regiões que o modelo de atenção sinaliza como importantes, como rostos ou mãos em movimento, e com menos intensidade em outras áreas para preservar a qualidade visual. Os espectadores não percebem diferença, e medidas de qualidade confirmam que os quadros marcados são quase indistinguíveis dos originais. Ainda assim, o padrão é forte e complexo o suficiente para que uma rede acompanhante, treinada como uma espécie de decodificador, possa posteriormente recuperar a assinatura oculta do material genuíno, quadro a quadro.

Testando deepfakes e distorções do dia a dia

Para verificar se essa proteção resiste no mundo real, os autores conduzem uma série de testes de estresse. Eles primeiro marcam com watermark um conjunto diverso de vídeos curtos de banco de imagens e então os enviam ao DeepFaceLab, uma das ferramentas de troca de rosto mais usadas, para criar deepfakes convincentes. Em todos os 50 clipes manipulados, a marca oculta é ou destruída ou fortemente embaralhada, e o sistema sinaliza corretamente o vídeo como adulterado. O método também se mantém bem frente a etapas comuns de processamento, como recompressão intensa, redimensionamento e desfoque, que frequentemente ocorrem quando clipes são compartilhados online, embora ruído aleatório muito forte possa eventualmente sobrecarregar o sinal oculto. Experimentos cuidadosos mostram que tanto a orientação por atenção quanto o uso do movimento ao longo do tempo são cruciais; remover qualquer um desses componentes enfraquece significativamente a proteção.

Fixando confiança com uma impressão digital permanente

A camada final vai além do conteúdo dos quadros e assegura o próprio arquivo de vídeo. Após a aplicação da marca d’água, o arquivo completo é submetido a uma função criptográfica que produz uma curta impressão digital digital. Essa impressão, junto com informações básicas sobre o clipe, é escrita em um registro em blockchain, onde não pode ser alterada sem deixar rastros. Depois, qualquer pessoa pode enviar uma cópia do vídeo: o sistema tenta recuperar a marca d’água e também recomputa a impressão digital. Se tanto a marca oculta quanto a impressão criptográfica coincidirem com os registros originais, o vídeo pode ser tratado como autêntico com alta confiança; se qualquer um falhar, os espectadores sabem que a filmagem foi alterada.

O que isso significa para os vídeos que você vê

Em termos simples, este trabalho mostra que podemos passar de adivinhar se um vídeo é falso para provar que um vídeo é real. Ao discretamente inserir uma marca inteligente e difícil de forjar nas partes mais significativas de cada quadro e respaldá‑la com uma entrada imutável no registro, a estrutura detecta todos os ataques de troca de rosto testados e resiste a muitas distorções corriqueiras. Embora ainda enfrente dificuldades sob ruído visual extremo e precise de testes mais amplos, aponta para um futuro no qual câmeras, plataformas e redações possam distribuir vídeos com prova de autenticidade embutida — tornando muito mais difícil para os deepfakes se passarem pela verdade.

Citação: Hajjej, F., Hamid, M. & Alluhaidan, A.S. An integrated framework for proactive deepfake mitigation via attention-driven watermarking and blockchain-based authenticity verification. Sci Rep 16, 9545 (2026). https://doi.org/10.1038/s41598-026-40166-6

Palavras-chave: proteção contra deepfakes, autenticidade de vídeo, marcação digital, verificação em blockchain, segurança de mídia