Clear Sky Science · pt

Calibrando classificadores profundos com propagação dinâmica de confiança e normalização adaptativa

Por que confiar na confiança da IA importa

Sistemas modernos de inteligência artificial não apenas dizem o que acreditam ver em uma foto ou leitura de sensor — eles também indicam o quão certos estão. Essa confiança auto‑declarada é crucial em cenários de segurança crítica, como imagem médica, direção autônoma ou monitoramento industrial, onde uma sensação equivocada de certeza pode ser perigosa. Ainda assim, redes neurais profundas atuais são notoriamente excessivamente confiantes em seus erros, e correções existentes frequentemente falham quando os dados são desbalanceados ou vêm de ambientes em mudança. Este artigo apresenta um novo método, chamado Propagação Dinâmica de Confiança com Normalização Alternada (DCP‑AN), projetado para tornar as pontuações de confiança dos sistemas de IA mais honestas, estáveis e eficientes em condições realistas e mutáveis.

Quando máquinas inteligentes estão pontos demasiado certas

A maioria dos modelos de aprendizado profundo populares é treinada para prever o rótulo correto, não para avaliar quão confiável é cada previsão. Como resultado, uma rede pode estar 99% “certa” de que uma imagem mostra um gato quando, na verdade, é um cachorro. Técnicas padrão de calibração, como ajuste de temperatura ou divisão de previsões em intervalos de confiança, tentam corrigir isso após o treinamento aplicando ajustes globais. No entanto, esses métodos tratam todas as categorias e todos os exemplos da mesma forma. No mundo real, os dados raramente são balanceados: algumas classes “de cabeça” comuns têm muitos exemplos, enquanto classes raras da “cauda” podem aparecer apenas algumas vezes. Redes tendem a ser excessivamente confiantes em classes comuns e pouco confiantes em classes raras — uma lacuna que correções estáticas e únicas não conseguem fechar — especialmente quando a distribuição de dados muda entre domínios, por exemplo de esboços artísticos para fotos do mundo real.

Uma nova maneira de compartilhar informação entre dados e rótulos

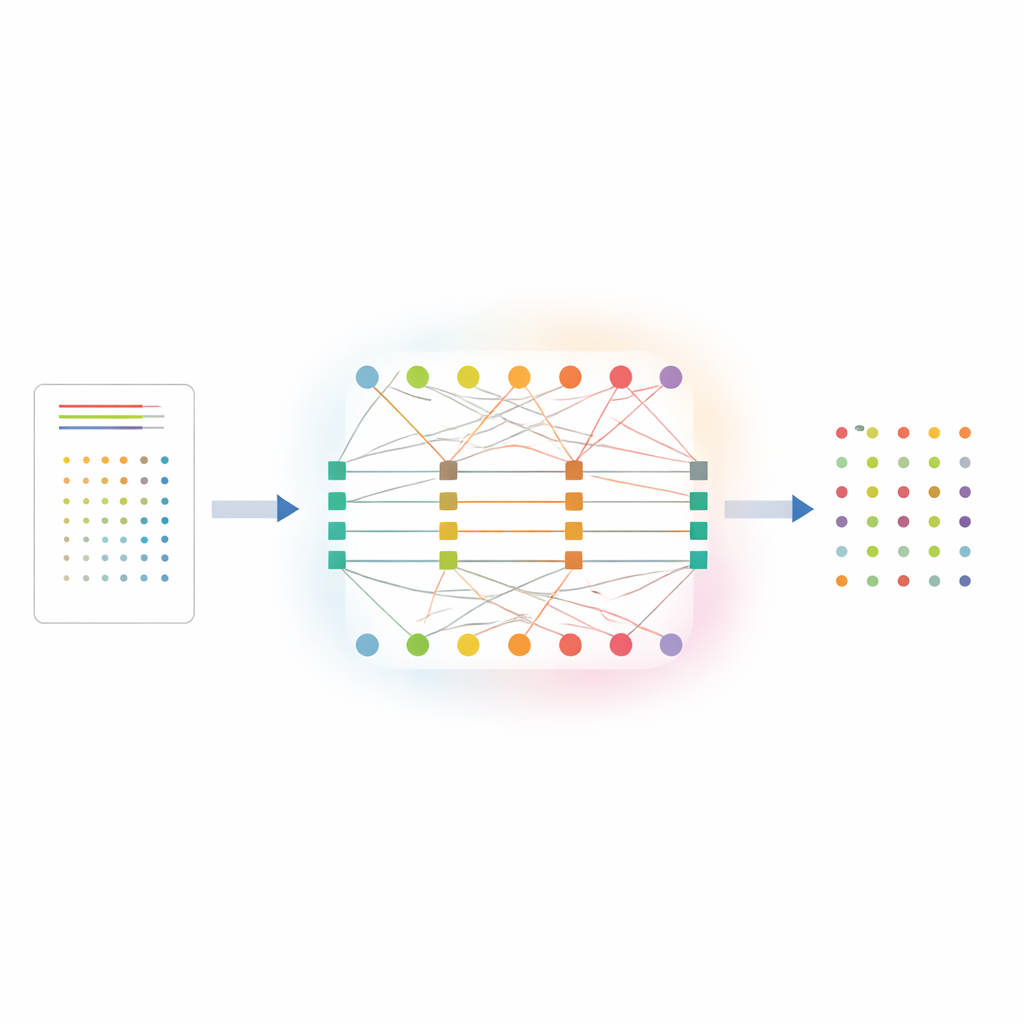

DCP‑AN enfrenta esse problema modelando explicitamente como a confiança deve fluir entre amostras individuais e as classes às quais elas pertencem. O método representa a relação entre amostras e classes como uma rede de duas camadas: uma camada de nós para amostras e outra para classes, ligadas por conexões ponderadas que codificam forças de predição iniciais. A confiança é então refinada por meio de uma dança em duas etapas. Na primeira etapa, a informação flui das amostras para as classes, ajustando o quão concentradas as predições de cada classe estão, guiada por quão incerta essa classe aparenta ser no momento. Na segunda etapa, a informação flui de volta das classes para as amostras, ajustando o perfil de confiança de cada amostra com base em quão consistente ele é com estimativas anteriores. Ao repetir esse processo de ida e volta por um número limitado de vezes, o sistema incentiva uma melhor “colaboração” entre exemplos e rótulos, de modo que classes raras recebam sinais mais claros em vez de serem abafadas por classes comuns.

Aumentando a temperatura onde é necessário

Uma inovação chave no DCP‑AN é um “campo de temperatura” adaptativo que muda a intensidade com que o método remodela a confiança, dependendo de quão incertos os aspectos locais e globais parecem. Em vez de usar um único valor de temperatura para todas as previsões, o método calcula forças de ajuste separadas para classes e para amostras, com base em medidas de incerteza e desalinhamento ao longo do tempo. Para classes de cabeça que a rede já trata com confiança, a temperatura efetiva resfria suavemente, evitando excesso de suavização e preservando distinções nítidas. Para classes de cauda e amostras ambíguas, a temperatura sobe, permitindo correções mais fortes que elevem sua confiança quando justificadas e amortecem picos espúrios. Esse comportamento dinâmico emerge de uma regra de atualização fundamentada e mostra-se capaz de responder rapidamente quando a incerteza cresce, mantendo-se estável quando o modelo já está bem alinhado.

Melhora confiável através de tarefas e hardware

Os autores avaliam cuidadosamente o DCP‑AN em vários conjuntos de imagens amplamente usados. Em uma versão de ImageNet com distribuição longa, onde algumas categorias têm centenas de vezes mais imagens que outras, o método aumenta a acurácia em classes raras de cauda em cerca de 10 pontos percentuais absolutos e reduz uma medida padrão de erro de calibração em mais da metade em comparação com uma linha de base não corrigida. Em um teste cross‑domain que transfere um modelo treinado em obras de arte para fotos do mundo real, o DCP‑AN tanto aumenta a acurácia no novo domínio quanto reduz uma medida estatística da lacuna entre dados de origem e destino. Importante, esses ganhos não ocorrem ao custo de alto consumo computacional: rodando em uma placa gráfica moderna, o método adiciona pouco mais de um milissegundo de atraso e menos de meio megabyte de memória extra, mantendo‑o prático para dispositivos em tempo real e de borda.

O que isso significa para a IA do dia a dia

Em termos simples, este trabalho mostra que podemos tornar sistemas de IA não apenas mais inteligentes, mas mais autoconscientes sobre quando podem estar errados. Ao permitir que a informação de confiança flua entre exemplos e categorias, e ao adaptar quão agressivamente se corrige com base na incerteza mutável, o DCP‑AN fornece estimativas de probabilidade que combinam melhor com a realidade — mesmo para eventos raros e em ambientes que mudam. Como vem com uma garantia matemática de que suas atualizações iterativas convergem rapidamente, e por operar com sobrecarga mínima, esse arcabouço pode ser integrado a redes neurais existentes em domínios como saúde, robótica e monitoramento de segurança. O resultado é uma IA que ainda comete erros, mas é muito mais honesta sobre o grau de certeza — um passo crucial rumo a sistemas em que as pessoas podem confiar com segurança.

Citação: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

Palavras-chave: calibração de confiança, redes neurais profundas, reconhecimento com distribuição longa, estimativa de incerteza, adaptação de domínio