Clear Sky Science · pt

Uma estrutura flexível para otimização de hiperparâmetros usando homotopia e modelos substitutos

Por que ajustar os controles da IA importa

Sistemas modernos de inteligência artificial dependem não apenas de algoritmos engenhosos e de grandes volumes de dados, mas também de uma camada surpreendentemente exigente de configurações chamadas “hiperparâmetros”. Esses são os botões que determinam o tamanho do modelo, a velocidade de aprendizado e como ele lida com dados ruidosos. Erros nesses ajustes podem transformar um sistema promissor em um fracasso. Este artigo apresenta o HomOpt, uma nova forma de ajustar esses controles de maneira mais eficiente e confiável, especialmente quando o espaço de busca é enorme e desordenado, tornando-o atraente para quem busca fazer a IA funcionar melhor com menos tentativa e erro.

Uma nova maneira de guiar a busca

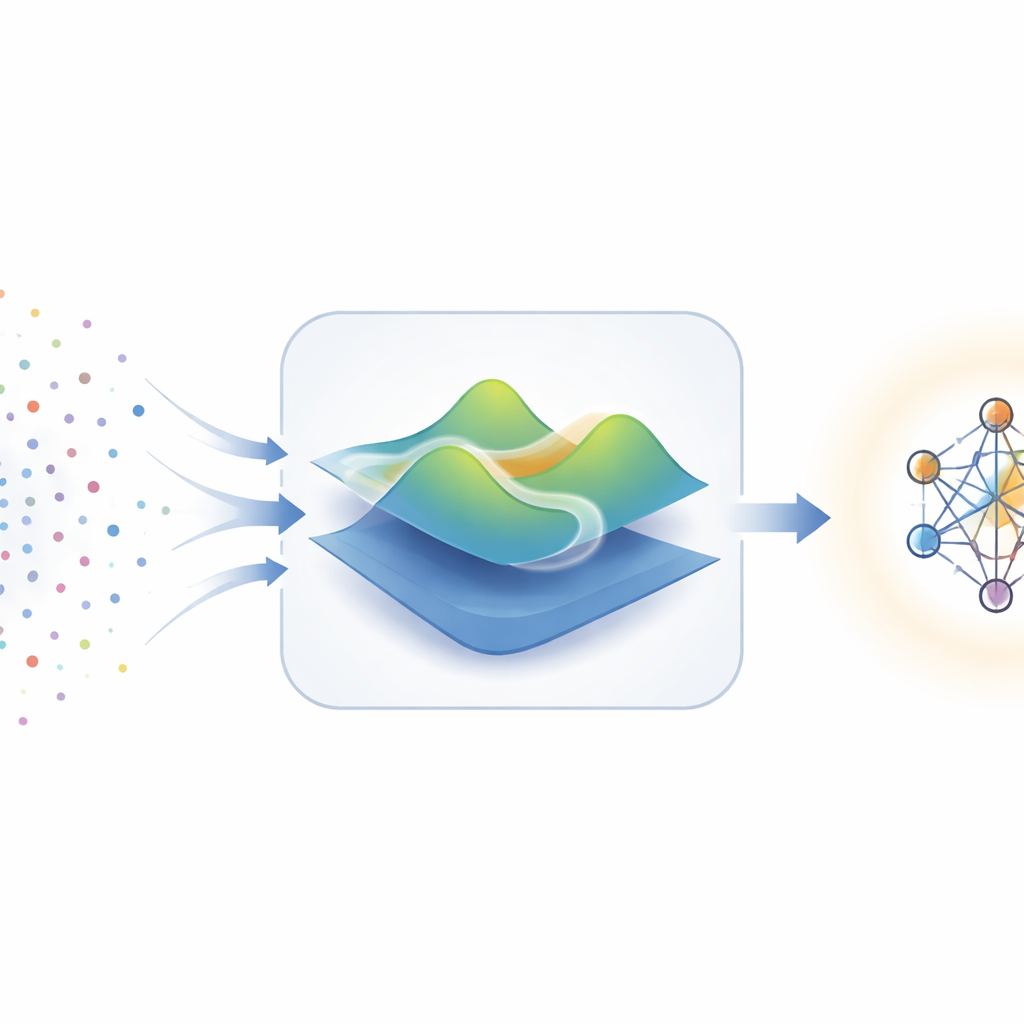

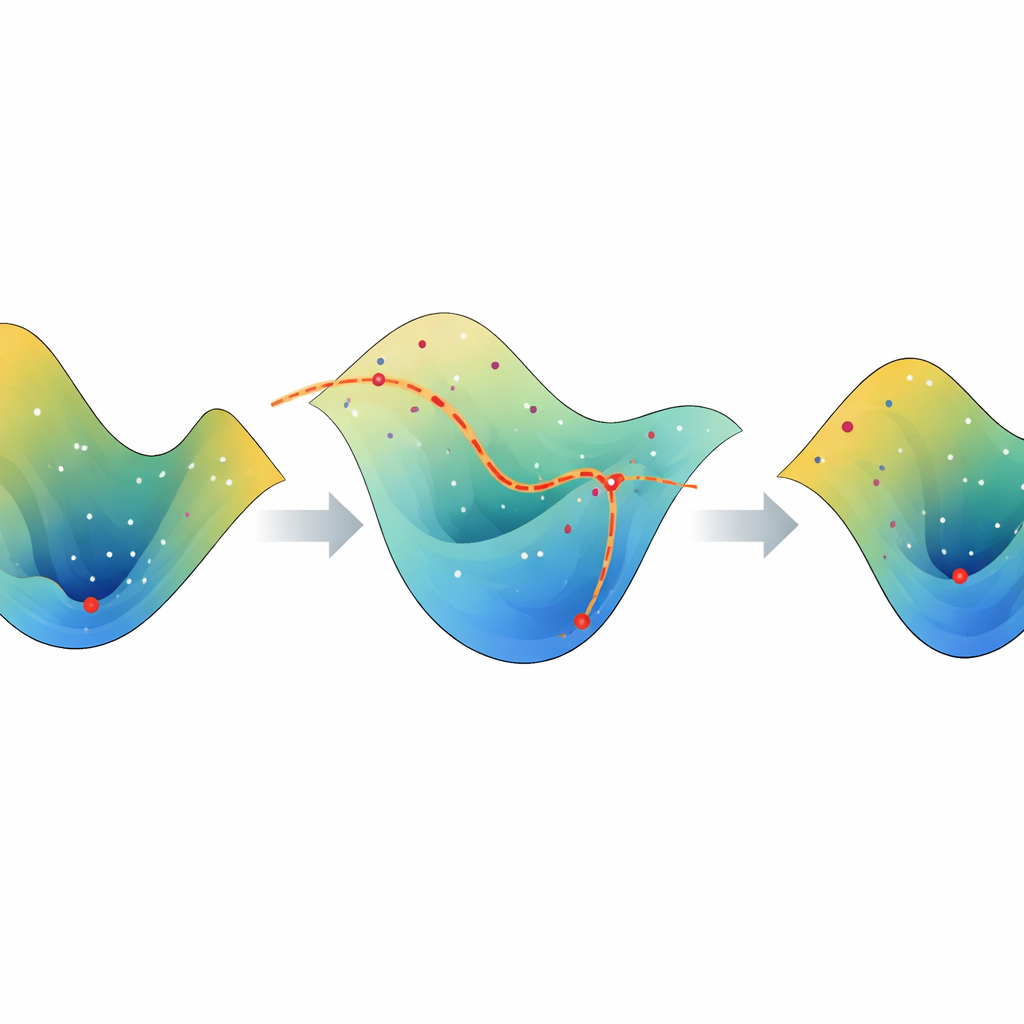

Abordagens tradicionais para ajuste de hiperparâmetros, como busca em grade ou busca aleatória, são um pouco como testar receitas jogando ingredientes juntos e torcendo para que o resultado fique bom. Métodos mais refinados, como otimização Bayesiana, tentam ser mais inteligentes ao construir um modelo aproximado de como as configurações afetam o desempenho e então usar esse modelo para escolher a próxima combinação a testar. Mas esses métodos assumem que a “paisagem” de desempenho é suave e bem comportada, o que frequentemente não é verdade em problemas do mundo real repletos de peculiaridades, ruído e saltos abruptos. O HomOpt enfrenta esse desafio construindo repetidamente substitutos aproximados para a paisagem verdadeira — chamados modelos substitutos — e depois transformando um substituto no seguinte de forma suave à medida que mais dados chegam, acompanhando como a melhor solução se move durante essa transformação.

Modelos que se transformam suavemente em vez de recomeçar

A ideia central do HomOpt vem de um conceito matemático chamado homotopia que, em termos simples, trata de transformar gradualmente uma forma em outra sem rasgar ou saltar. Nesse arcabouço, cada modelo substituto é uma imagem suavizada de como diferentes configurações de hiperparâmetros afetam o desempenho de um modelo. À medida que novos resultados experimentais são coletados, o HomOpt constrói um substituto atualizado e então define uma transformação contínua entre as versões antiga e nova. Em vez de descartar o trabalho anterior e reiniciar a busca, ele acompanha como o ponto ótimo na superfície antiga desliza por essa paisagem em transformação até alcançar um bom ponto na nova. Esse movimento guiado torna a busca mais direcionada e menos aleatória, aumentando as chances de encontrar melhores configurações em menos etapas.

Ferramentas flexíveis para diferentes tipos de dados

Para demonstrar que a ideia funciona na prática, os autores conectam dois tipos bem diferentes de modelos substitutos ao HomOpt. Primeiro, usam Modelos Aditivos Generalizados, que são suaves e relativamente fáceis de interpretar, tornando-os úteis quando as relações entre configurações e desempenho mudam de forma gradual. Em segundo lugar, usam CatBoost, um poderoso método em conjunto bem adequado para problemas complicados e de alta dimensionalidade, como reconhecimento de imagens. O HomOpt não se prende a um único substituto; em vez disso, trata a escolha do substituto como um componente plug-in que pode corresponder à dificuldade e à estrutura da tarefa. A estrutura pode lidar com configurações contínuas, discretas e categóricas, e pode se apoiar em estratégias de busca comuns, como busca aleatória, otimização Bayesiana ou métodos baseados em árvores, atuando como uma camada de refinamento em vez de um substituto.

Colocando o método à prova

Os pesquisadores avaliam o HomOpt em um conjunto diversificado de benchmarks. Em tarefas clássicas de aprendizado de máquina extraídas de conjuntos de dados tabulares públicos, eles ajustam modelos como máquinas de vetores de suporte, florestas aleatórias, regressão logística, perceptrons multicamadas e árvores com gradient boosting. Eles também examinam problemas exigentes de reconhecimento em cenário aberto, onde um sistema precisa lidar com categorias previamente não vistas, usando um classificador especializado chamado Extreme Value Machine. Finalmente, testam o HomOpt em tabelas de busca por arquitetura neural para conjuntos de imagens conhecidos, como CIFAR-10 e coleções no estilo ImageNet, onde o espaço de designs possíveis é especialmente grande e acidentado. Em muitos desses cenários, o HomOpt ou acelera a descida rumo a boas soluções ou melhora o desempenho final em comparação com os métodos subjacentes sozinhos, frequentemente usando menos avaliações caras de modelos.

O que isso significa para a prática cotidiana da IA

Para os praticantes, a mensagem principal é que o HomOpt oferece uma forma estruturada de tornar o ajuste de hiperparâmetros mais inteligente, em vez de apenas mais exaustivo. Ao refinar continuamente uma imagem aproximada da paisagem de desempenho e seguir suavemente como seu ponto ótimo se desloca conforme essa imagem melhora, o método reduz buscas desperdiçadas e aproveita melhor cada execução de modelo. Como funciona com uma ampla gama de medidas de perda, tipos de modelo e estratégias de busca, o HomOpt pode ser tratado como um complemento de uso geral para ferramentas de otimização existentes. Em termos simples, ele promete obter sistemas de IA mais precisos e robustos com o mesmo orçamento de computação — e fazê-lo de uma forma que escala desde pequenos problemas tabulares até tarefas visuais grandes e complexas.

Citação: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

Palavras-chave: otimização de hiperparâmetros, modelos substitutos, métodos de homotopia, aprendizado de máquina automatizado, busca por arquitetura neural