Clear Sky Science · pt

Avaliação comparativa de modelos de linguagem multimodal para vídeos na avaliação de qualidade de vídeos de divulgação científica sobre olho seco

Por que isso importa para espectadores comuns

Aplicativos de vídeos curtos estão se tornando rapidamente o primeiro lugar onde as pessoas buscam conselhos sobre saúde, inclusive problemas oculares como o olho seco, que afeta centenas de milhões de pessoas no mundo. Mas, junto com clipes úteis, é fácil encontrar vídeos de baixa qualidade ou enganosos, e é difícil para os médicos fiscalizá‑los. Este estudo investiga se novos sistemas de inteligência artificial capazes de “assistir” a vídeos poderiam ajudar a checar automaticamente a qualidade desses clipes de saúde, e mostra por que, por enquanto, tais ferramentas não estão prontas para substituir o julgamento de especialistas.

Olhos secos e a ascensão dos vídeos de saúde

O olho seco é mais do que um incômodo; pode causar visão embaçada, dor e atrapalhar o trabalho e a vida cotidiana. À medida que a condição se torna mais comum, especialmente entre idosos e usuários intensivos de telas, muita gente busca na internet explicações e dicas de autocuidado. Plataformas como o TikTok hospedam inúmeros vídeos curtos sobre olho seco, mas sua natureza aberta permite que qualquer um publique conteúdo, independentemente de formação médica. Conselhos ruins ou exagerados podem atrasar o tratamento adequado ou incentivar remédios caseiros perigosos, por isso são necessárias com urgência maneiras confiáveis de avaliar a qualidade dos vídeos em grande escala.

Como os pesquisadores testaram revisores de vídeo por IA

A equipe coletou 185 vídeos em chinês sobre olho seco no TikTok usando uma conta nova e neutra e regras estritas para manter apenas clipes originais e educativos. Dois especialistas em oftalmologia então pontuaram cada vídeo usando três ferramentas estabelecidas, frequentemente empregadas em pesquisas de educação médica. Uma ferramenta avaliou quão fáceis eram de entender os vídeos e quão claramente sugeriam etapas concretas que os espectadores poderiam seguir. A segunda forneceu uma nota geral de qualidade, de pobre a excelente. A terceira detalhou a qualidade em aspectos como fluidez da apresentação das informações, precisão, uso de elementos complementares como animações, e o quão fiel o conteúdo era ao título do vídeo.

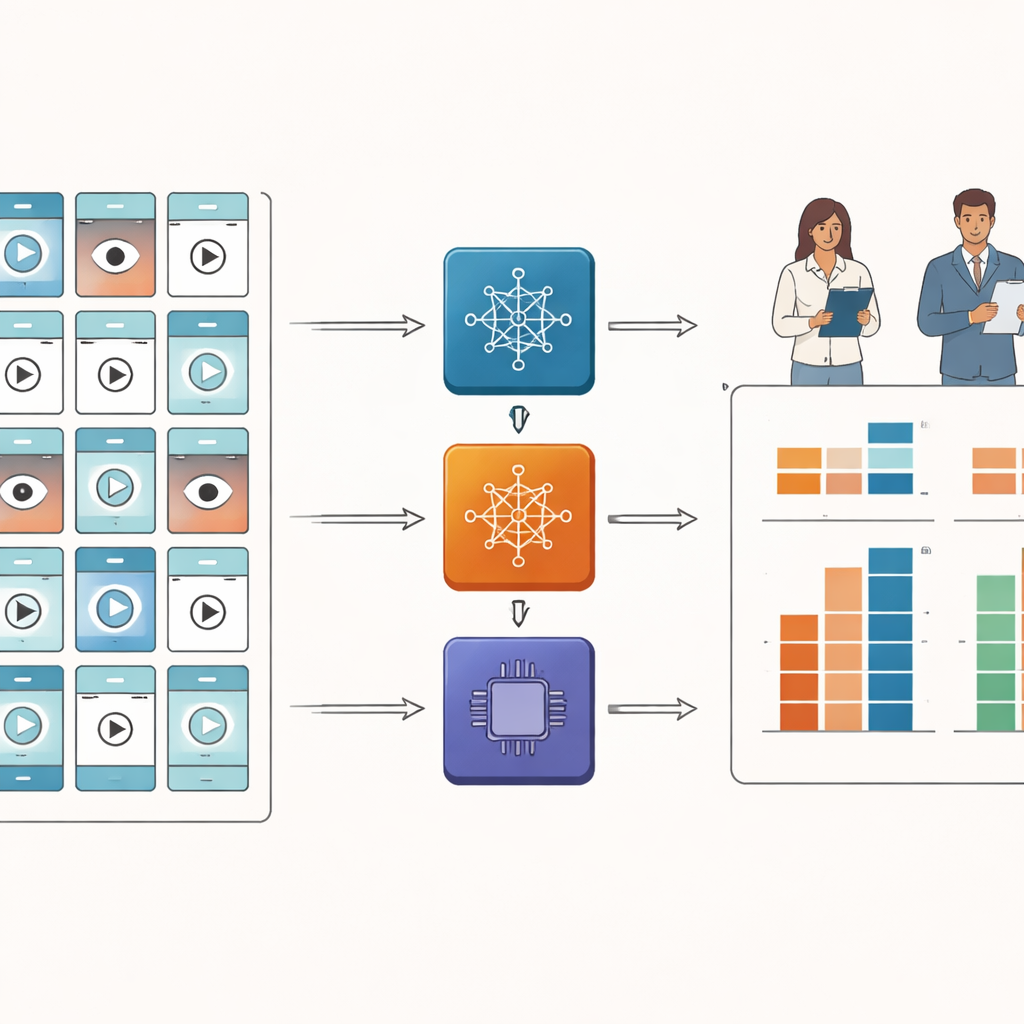

Testando modelos de IA com sensibilidade a vídeo

Em seguida, os pesquisadores alimentaram os mesmos vídeos em três avançados “modelos de linguagem multimodal para vídeo”, sistemas de IA projetados para interpretar informação visual quadro a quadro e responder a perguntas sobre o que observam. Eles criaram instruções detalhadas para que cada modelo imitasse o mais fielmente possível as ferramentas de avaliação dos médicos. A questão central era se a IA e os especialistas humanos dariam notas semelhantes. Para medir isso, a equipe usou uma estatística padrão de confiabilidade que captura quão próximos dois “avaliadores” diferentes concordam, não apenas em tendências, mas em números reais.

O que a IA acertou — e errou

Os avaliadores humanos concordaram em grande parte entre si, o que sugere que suas pontuações eram estáveis e confiáveis. Em contraste, os três sistemas de IA apresentaram baixa concordância com os especialistas na maioria das áreas. Nenhum dos modelos conseguiu igualar de forma confiável os médicos na qualidade geral dos vídeos nem em características detalhadas, como o quanto os títulos refletiam o conteúdo. Um modelo tendia a atribuir notas mais altas do que os especialistas, outro tendia a dar notas mais baixas, e apenas um ocasionalmente ficava no meio‑termo. O único ponto relativamente positivo foi a “praticabilidade” — o quão claramente os vídeos indicavam o que fazer — em que dois modelos alcançaram um nível mediano de concordância, mas ainda aquém do necessário para tomada de decisões no mundo real.

Por que a IA atual fica aquém

Os autores sugerem várias razões para essa lacuna. Os sistemas de IA testados foram treinados principalmente em cenas cotidianas e tarefas de vídeo genéricas, não em material educativo em saúde cuidadosamente estruturado. Muitos vídeos científicos dependem fortemente de explicações faladas, legendas, gráficos e metáforas, em vez de imagens em movimento dramáticas; contudo, os modelos neste estudo analisaram apenas os quadros visuais e não ouviram o áudio nem leram os títulos e outras informações descritivas que os humanos usam para julgar relevância e precisão. Como resultado, grandes porções do sentido nunca chegaram à IA, especialmente quando detalhes-chave eram falados em vez de mostrados. Linguagem figurada comum na educação em saúde em chinês também pode confundir sistemas que interpretam declarações de forma literal.

O que isso significa para pacientes e plataformas

Este trabalho fornece um roteiro inicial, não uma rede de segurança pronta. Mostra que, em princípio, listas de verificação de qualidade familiares para informação em saúde podem ser traduzidas em instruções para modelos de IA que assistem vídeos. Também deixa claro que sistemas de uso geral atuais ainda não são suficientemente confiáveis para avaliar vídeos médicos ou combater desinformação sem supervisão humana. Ao liberar seu quadro de avaliação e o conjunto de vídeos anotados, os autores esperam incentivar modelos melhores e mais especializados que possam combinar visuais, som e contexto adicional, e que funcionem entre doenças e idiomas. Por enquanto, os espectadores devem continuar a tratar vídeos curtos de saúde como pontos de partida, não como aconselhamento médico, e as plataformas não devem confiar apenas em IA para garantir informação confiável.

Citação: Zhou, S., Huang, M., Wei, J. et al. Benchmark evaluation of video large language models in quality assessment of science popularization videos for dry eye. Sci Rep 16, 8756 (2026). https://doi.org/10.1038/s41598-026-39444-0

Palavras-chave: doença do olho seco, vídeos de saúde, inteligência artificial, desinformação, TikTok