Clear Sky Science · pt

Otimização de medidas de intervenção em doenças infecciosas usando aprendizado por reforço com dados da epidemia de COVID-19 no Reino Unido

Ferramentas inteligentes para decisões difíceis em saúde

Quando uma nova doença varre um país, os líderes precisam decidir rapidamente o quanto restringir a vida cotidiana. Fechar tudo pode salvar vidas, mas arruinar a economia; agir devagar demais faz os hospitais lotarem. Este artigo investiga se uma forma de inteligência artificial, chamada aprendizado por reforço, pode ajudar governos a encontrar respostas mais inteligentes e equilibradas usando simulações detalhadas de como um vírus como o COVID‑19 realmente se espalha por comunidades reais.

Simulando um país no computador

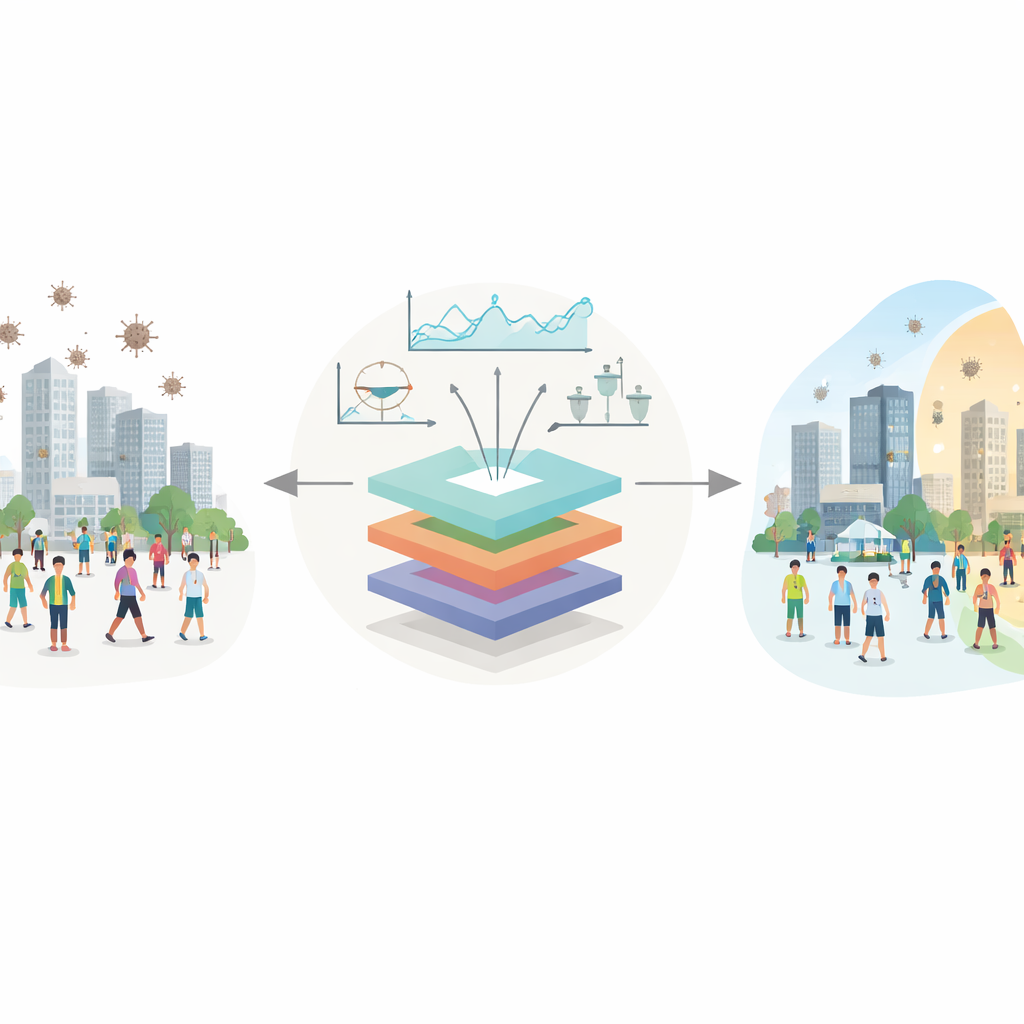

Em vez de usar equações simples que tratam as pessoas como idênticas, os autores se baseiam no Covasim, um modelo computacional rico que acompanha milhares de indivíduos virtuais enquanto vivem, trabalham, estudam e interagem. Cada pessoa simulada tem uma idade, um lugar na rede familiar, escolar e de trabalho, e um estado de saúde que pode mudar de saudável para infectado, recuperado ou óbito. Ajustando cuidadosamente os parâmetros do modelo, a equipe faz este Reino Unido virtual se comportar como o real durante a primeira onda de COVID‑19, batendo com os registros oficiais de casos e mortes do início de 2020. Essa etapa de calibração é crucial, porque qualquer estratégia que o computador aprenda precisa funcionar em um mundo que se assemelhe ao nosso, não num universo de brincadeira.

Ensinando um conselheiro digital a agir

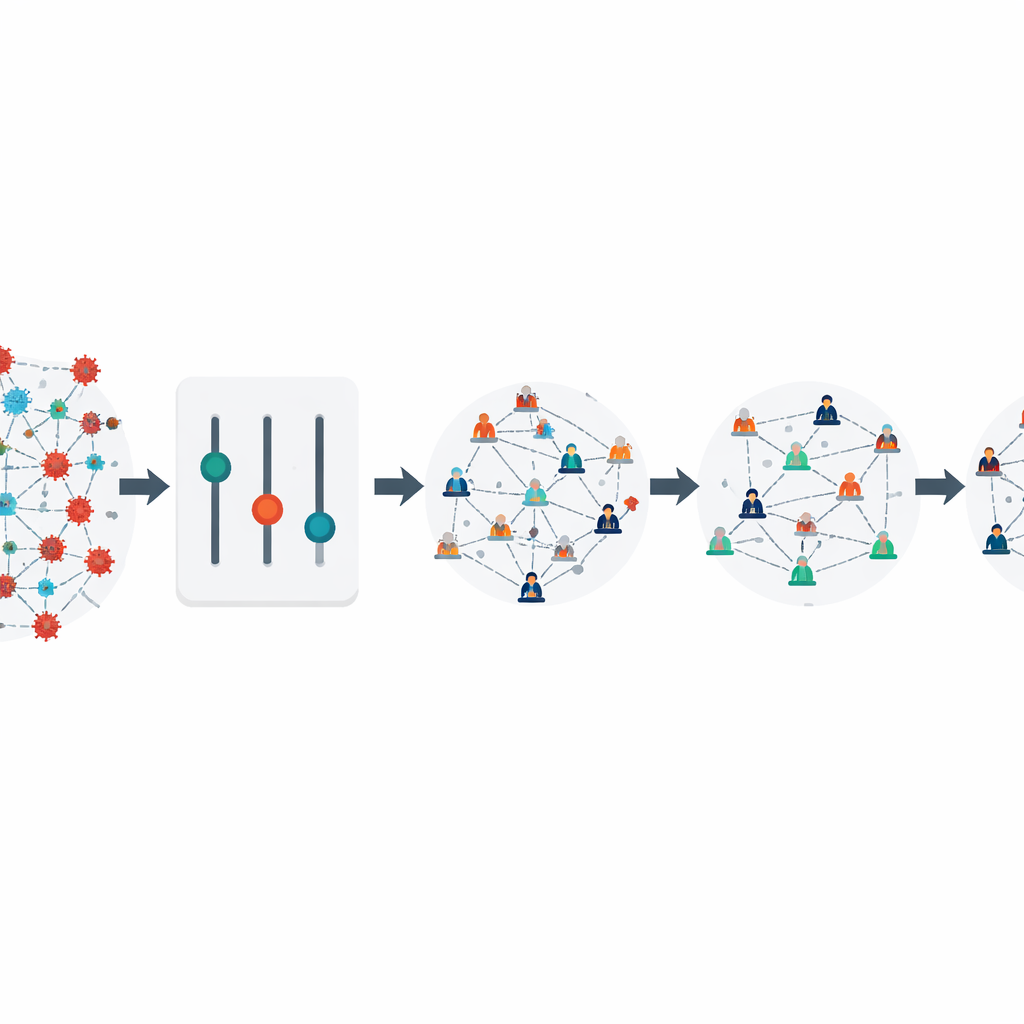

Uma vez que o modelo se comporta como a realidade, os pesquisadores inserem o aprendizado por reforço, um ramo da IA em que um “agente” de software experimenta decisões repetidamente e é recompensado ou penalizado com base nos resultados. Aqui, o agente pode ajustar três alavancas principais a cada semana simulada: quão rigorosos são os bloqueios parciais, quantas pessoas são testadas e quão agressivo é o rastreamento de contatos. O sistema de recompensa é projetado para capturar dois objetivos em concorrência: manter baixas as infecções, as formas graves da doença e as mortes, ao mesmo tempo que limita os danos econômicos causados pelo fechamento de locais de trabalho e pelo isolamento de pessoas. Rodando milhares de epidemias simuladas, o agente descobre quais combinações e tempos de medidas rendem a maior pontuação geral.

Encontrando um equilíbrio melhor que regras fixas

O estudo compara vários métodos de aprendizado e formas de descrever as escolhas do agente. Um método que trata ações como regulagens contínuas, em vez de um pequeno menu de opções fixas, tem desempenho especialmente bom. Aprende a responder rapidamente quando o vírus começa a se espalhar, impondo restrições curtas porém fortes, combinadas com testagem e rastreamento intensos. À medida que o surto simulado é controlado, relaxa os bloqueios enquanto mantém parte da testagem e do rastreamento, e então volta a apertar brevemente se as infecções ameaçam disparar. Esse padrão flexível mantém o número total de infectados em cerca de 300.000 no modelo, muito abaixo do ocorrido com as políticas do mundo real usadas no Reino Unido no mesmo período, e também inferior a uma regra simples de “sete dias aberto, sete dias fechado”. As perdas econômicas no modelo são reduzidas em mais de dois terços em comparação com essa estratégia rígida de alternância de lockdown.

O tempo faz toda a diferença

Os autores também examinam como essas diferentes estratégias afetam o número efetivo de reprodução em tempo real, uma medida de quantas novas infecções cada caso gera. Em suas simulações, a política projetada pela IA empurra esse número para abaixo do valor crítico de um cerca de um mês antes da resposta real do Reino Unido. Essa mudança aparentemente pequena reduz dramaticamente as infecções acumuladas, destacando o quanto uma ação precoce e bem planejada pode mudar o curso dos eventos. Eles testam ainda a política aprendida em um cenário muito diferente, usando dados da grande onda de COVID‑19 de Hong Kong em 2022, e verificam que a mesma estratégia continua a ter bom desempenho, sugerindo que as regras aprendidas capturam princípios gerais em vez de se ajustarem demais a um único país.

O que isso significa para surtos futuros

Para não especialistas, a principal mensagem é que não precisamos escolher cegamente entre salvar vidas e salvar meios de subsistência. Combinando simulações detalhadas de como um vírus circula por redes sociais reais com IA que aprende por tentativa e erro, os formuladores de políticas poderiam receber manuais de ação baseados em dados que se adaptam conforme as condições mudam. Os autores enfatizam que tais ferramentas não têm a intenção de substituir o julgamento humano, mas de atuar como poderosos auxiliares de decisão, explorando inúmeras hipóteses muito mais rápido do que as pessoas conseguem. Conforme novas epidemias surgirem, essa abordagem pode ajudar líderes a agir mais cedo e com mais precisão, usando testagem, rastreamento e fechamentos parciais direcionados para manter a doença sob controle enquanto preserva o máximo possível da vida normal e da atividade econômica.

Citação: Zhang, B., Chen, Y., Li, H. et al. Optimization of infectious disease intervention measures using reinforcement learning with UK COVID-19 epidemic data. Sci Rep 16, 10627 (2026). https://doi.org/10.1038/s41598-026-39377-8

Palavras-chave: política de COVID-19, aprendizado por reforço, simulação epidêmica, intervenções não farmacêuticas, estratégia de saúde pública