Clear Sky Science · pt

Parser de endereços de pacientes via aprendizado contrastivo ciente de KG e inferência LLM restrita on‑premises

Por que endereços de pacientes organizados importam

Por trás de cada visita ao hospital há uma linha modesta de texto: o endereço residencial do paciente. Longe de ser um detalhe clerical, esses endereços alimentam mapeamento de doenças, planejamento de emergências e decisões sobre onde posicionar clínicas e ambulâncias. Ainda assim, em muitos sistemas de prontuário, os endereços são armazenados como textos bagunçados e inconsistentes, cheios de abreviações, erros de digitação e informações faltantes. Este artigo apresenta o AddrKG‑LLM, um novo método que transforma textos de endereço indisciplinados em registros limpos e confiáveis, preservando a privacidade dos dados sensíveis.

O problema dos endereços residenciais bagunçados

Quando os endereços são digitados livremente, as pessoas omitem bairros, trocam a ordem das palavras ou usam apelidos locais que mapas oficiais não reconhecem. Métodos computacionais mais antigos comparam strings caractere a caractere ou como listas simples de palavras, o que funciona apenas quando as entradas já estão organizadas e completas. Sistemas de aprendizado profundo mais recentes interpretam o contexto com mais inteligência, mas ainda podem ser confundidos por formulações incomuns e exigem grande poder computacional. Recentemente, modelos de linguagem grandes mostraram notável habilidade para entender e gerar texto. Entretanto, quando autorizados a responder livremente, também tendem a “alucinar” detalhes que não constam nos dados — um risco inaceitável na saúde, onde os registros devem ser precisos e auditáveis.

Um caminho em duas etapas do caos para a ordem

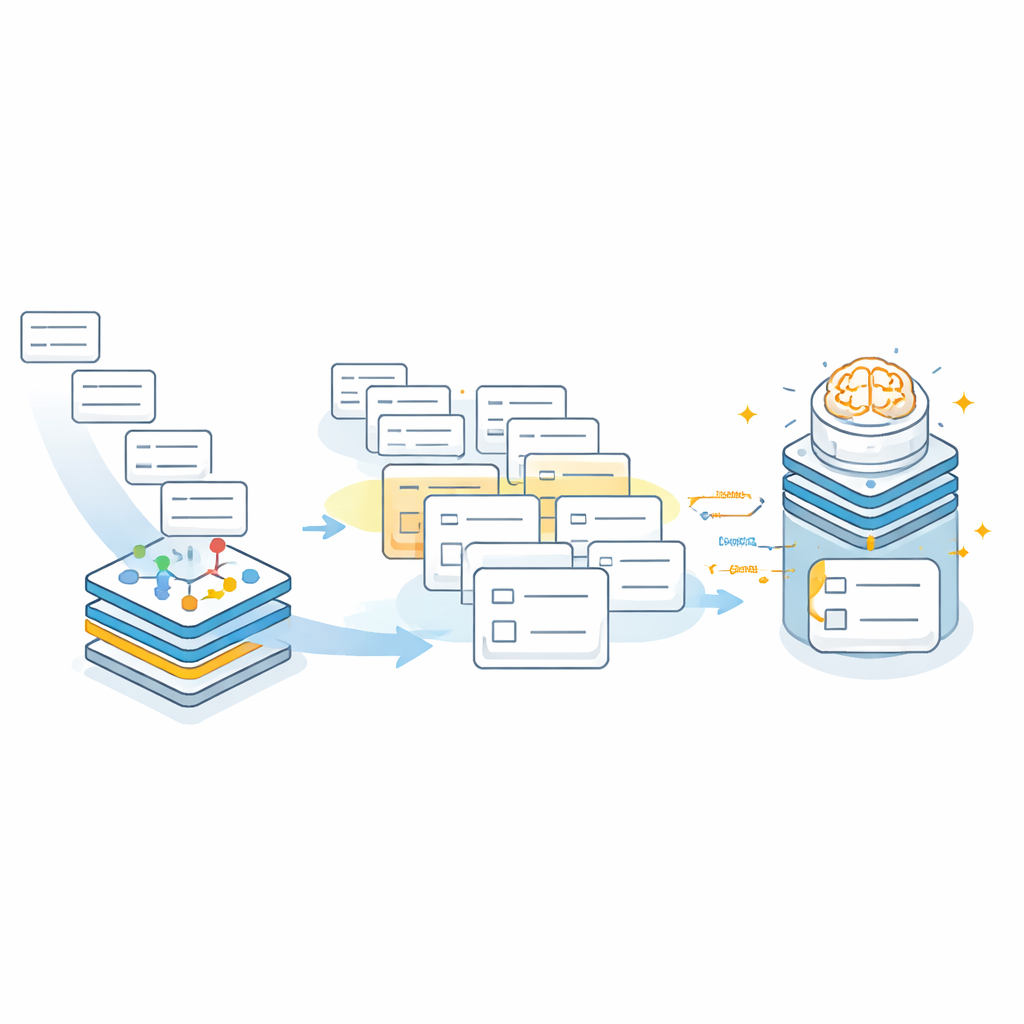

Os pesquisadores projetaram o AddrKG‑LLM como um pipeline em duas etapas que adiciona estrutura e limites ao redor do modelo de linguagem, em vez de deixá‑lo trabalhar sozinho. Primeiro, os endereços recebidos são limpos para remover detalhes altamente identificáveis, como números de prédio e cômodos e contatos telefônicos, ajudando a proteger a privacidade. O texto remanescente é convertido em uma representação numérica densa que captura seu significado. Ao mesmo tempo, a equipe constrói um grafo de conhecimento — uma rede em forma de mapa que codifica as relações oficiais entre cidades, bairros, ruas e conjuntos residenciais. Usando uma técnica chamada aprendizado contrastivo, eles treinam o sistema para que endereços que se referem à mesma comunidade real fiquem próximos nesse espaço compartilhado, enquanto locais não relacionados sejam empurrados para mais longe. Isso permite que o sistema recupere rapidamente uma lista curta de candidatos prováveis para cada novo registro de paciente.

Manter a IA em uma coleira curta

Na segunda etapa, o modelo de linguagem grande opera dentro de um espaço de busca cuidadosamente delimitado. Em vez de inventar um endereço do zero, o modelo recebe o texto original limpo mais o pequeno conjunto de comunidades candidatas sugeridas pelo grafo de conhecimento. O prompt instrui explicitamente o modelo a escolher apenas entre esses candidatos e a gerar resultados em uma estrutura JSON fixa com campos separados para cidade, distrito, rua ou município e comunidade. Se nenhum dos candidatos for adequado — por exemplo, quando a comunidade verdadeira não foi recuperada — o modelo é orientado a retornar valores vazios em vez de chutar. Esse comportamento de “rejeição primeiro” reduz fortemente o risco de entradas plausíveis, porém incorretas, entrarem nos registros hospitalares.

Quão bem isso funciona na prática?

A equipe testou o AddrKG‑LLM em dez mil endereços hospitalares reais desidentificados que refletem o ruído do mundo real: abreviações, bairros faltantes, variantes ortográficas e até entradas completamente inválidas. Eles compararam seu sistema com ferramentas clássicas de correspondência de strings, modelos de rotulação sequencial baseados em aprendizado profundo, modelos de linguagem de uso geral operados de forma livre e um serviço comercial de padronização de endereços. Em medidas rígidas que exigem que todos os campos de um endereço estejam corretos simultaneamente, o AddrKG‑LLM superou todas essas linhas de base, aumentando a acurácia geral em mais de doze pontos percentuais em relação a um forte modelo baseado em BERT. Os ganhos foram especialmente nítidos para endereços abreviados e parcialmente faltantes, onde a hierarquia incorporada no grafo de conhecimento ajuda a preencher lacunas. Os autores também exploraram como a performance varia com diferentes tamanhos de modelos de linguagem e com diferentes números de candidatos recuperados, mostrando como hospitais podem equilibrar velocidade e acurácia conforme suas necessidades.

O que isso significa para o atendimento diário

Para não especialistas, a mensagem principal é que o AddrKG‑LLM oferece uma maneira de limpar dados vitais, porém bagunçados, de endereços de pacientes mantendo o controle firmemente nas mãos humanas. Ao acoplar um grafo de conhecimento com formato de mapa a um modelo de linguagem restrito que roda inteiramente nos servidores do hospital, a estrutura fornece endereços mais precisos e consistentes sem enviar dados sensíveis a serviços de nuvem externos ou permitir que a IA improvise. O resultado é uma ferramenta prática que pode fortalecer a vigilância de doenças, melhorar o planejamento de recursos e apoiar operações hospitalares mais seguras e eficientes — simplesmente garantindo que cada paciente esteja confiavelmente localizado no mapa.

Citação: Li, J., Pan, X. & Jia, Y. Patient address parsing via KG-aware contrastive learning and constrained on-prem LLM inference. Sci Rep 16, 8003 (2026). https://doi.org/10.1038/s41598-026-39348-z

Palavras-chave: parser de endereços de pacientes, qualidade de dados de saúde, grafo de conhecimento, modelo de linguagem grande, informática médica