Clear Sky Science · pt

Análise da relação entre traços do locutor e características multimodais em entrevistas de emprego com preservação de privacidade

Por que sua voz em entrevistas de emprego levanta novas questões

Cada vez mais empresas recorrem a entrevistas em vídeo automatizadas, nas quais algoritmos ouvem como você fala e inferem traços como confiança, confiabilidade ou sociabilidade. Mas a sua voz carrega muito mais do que uma primeira impressão — ela pode sugerir sua identidade, saúde e origem. Este artigo investiga se é possível ocultar quem você é em uma gravação enquanto ainda se permite que computadores avaliem como você se apresenta como candidato. Em outras palavras, podemos manter os benefícios da contratação assistida por IA sem sacrificar nossa privacidade silenciosamente?

Das primeiras impressões aos julgamentos automatizados

Psicólogos organizacionais sabem há muito tempo que padrões amplos de personalidade — frequentemente descritos pelos cinco grandes traços: abertura, conscienciosidade, extroversão, amabilidade e estabilidade emocional — são relevantes para o sucesso no trabalho. Avanços recentes em inteligência artificial permitem que computadores estimem esses traços a partir de como as pessoas falam em entrevistas de emprego, capturando não apenas o que os candidatos dizem, mas como dizem: o timbre, volume, ritmo e estilo geral de fala. Esses sistemas prometem triagem mais rápida e consistente de candidatos. Ainda assim, levantam uma questão preocupante: se uma empresa armazenar sua voz, esses mesmos dados poderiam depois ser usados para reconhecê-lo, traçar um perfil seu ou inferir detalhes sensíveis que você nunca concordou em compartilhar?

Como esconder uma voz sem perder seu caráter

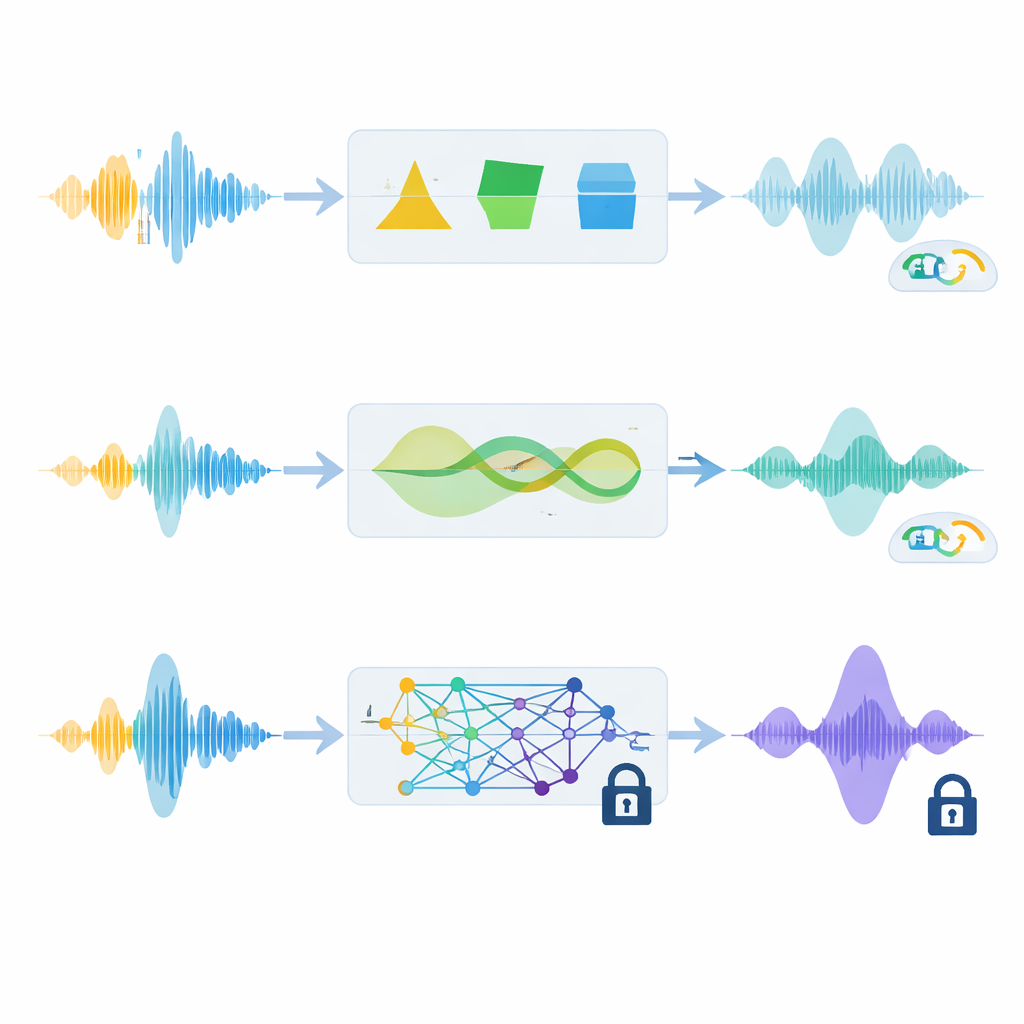

Para enfrentar esse dilema, os pesquisadores estudaram técnicas que alteram a voz de uma pessoa para que ela não soe mais como o indivíduo original, preservando, ao mesmo tempo, as pistas necessárias para avaliações de personalidade e de contratação. Eles focaram em três métodos de anonimização. Dois usam artifícios tradicionais de áudio, como reformular sutilmente as frequências do som e esticar ou deslocar o tom ao longo do tempo. O terceiro baseia-se em um codec neural moderno de áudio, que comprime a voz em uma série de códigos digitais e então a reconstrói como uma nova voz de alta qualidade, mas com som diferente. Crucialmente, a equipe ajustou todos os métodos para que o gênero percebido do locutor permanecesse o mesmo e para que a voz convertida fosse consistente entre várias respostas em uma entrevista online longa.

Testando privacidade e utilidade

Usando quase 1.900 vídeos reais de entrevistas de emprego online de pessoas de diferentes regiões dos Estados Unidos, os autores fizeram duas perguntas principais. Primeiro, quão difícil seria para um atacante corresponder vozes anonimizadas aos locutores originais usando um sistema avançado de reconhecimento de voz? Segundo, após a anonimização, os algoritmos ainda poderiam prever avaliações de personalidade e recomendações de contratação com precisão semelhante? Eles avaliaram a privacidade usando uma taxa de erro da verificação automática de locutor — erro maior significa maior proteção — e mediram a utilidade por meio da precisão do reconhecimento de fala, da qualidade percebida do áudio e de quão bem modelos de aprendizado de máquina conseguiam inferir traços e decisões de contratação a partir de características acústicas e linguísticas.

Como o trade-off realmente se apresenta

Os resultados revelam um equilíbrio nuançado entre segurança e desempenho. O método mais simples, que remodela levemente as frequências da voz, ofereceu apenas privacidade modesta e poderia falhar quase completamente quando o sistema do atacante fosse ajustado às vozes anonimizadas. Uma técnica de sinal mais avançada, que altera o tempo e o tom, teve desempenho muito melhor: reduziu significativamente as chances de reidentificação bem-sucedida, preservando o ritmo e a expressividade da fala. Como resultado, as previsões de contratação e de personalidade permaneceram próximas às feitas a partir das gravações originais. O método baseado em codec neural de áudio proporcionou a maior privacidade, tornando muito mais difícil ligar vozes anonimizadas aos locutores reais e, frequentemente, até reduzindo ruídos de fundo. No entanto, nas gravações de entrevistas reais e ruidosas, esse método também afetou pistas prosódicas sutis que influenciam a percepção de traços, levando a uma queda perceptível no desempenho da estimativa de traços e a erros maiores na transcrição automática.

O que isso significa para contratações justas e privadas

O estudo mostra que não existe uma solução única para todos: privacidade mais forte frequentemente tem custo sobre a capacidade da IA de ler personalidade e recomendar candidatos. Para cenários típicos de contratação, em que estimativas de traço e decisões justas são prioridade, abordagens refinadas de processamento de sinal — especialmente o método baseado em fase testado aqui — podem oferecer o melhor compromisso, protegendo a identidade enquanto mantêm a “sensação” da voz da pessoa. Em situações com exigências de privacidade mais altas, como o compartilhamento amplo de dados de fala ou a proteção contra atacantes poderosos, métodos neurais mais recentes podem fornecer maior proteção, mas os projetistas devem aceitar alguma perda na precisão da avaliação de personalidade e adequação. Em última análise, o trabalho argumenta que proteger as vozes dos candidatos deve ser tratado como uma exigência ética, não como um apêndice, e que ferramentas futuras devem selecionar cuidadosamente quais aspectos da fala ocultar e quais preservar.

Citação: Mawalim, C.O., Leong, C.W. & Okada, S. Privacy-aware speaker trait and multimodal features relationship analysis in job interviews. Sci Rep 16, 8181 (2026). https://doi.org/10.1038/s41598-026-39322-9

Palavras-chave: anonimização de voz, IA na contratação, traços do locutor, privacidade em dados de fala, entrevistas de emprego