Clear Sky Science · pt

Reconhecimento de emoções dominantes por vídeo para dispositivos portáteis baseados em EEG

Por que seus vídeos podem saber como você se sente

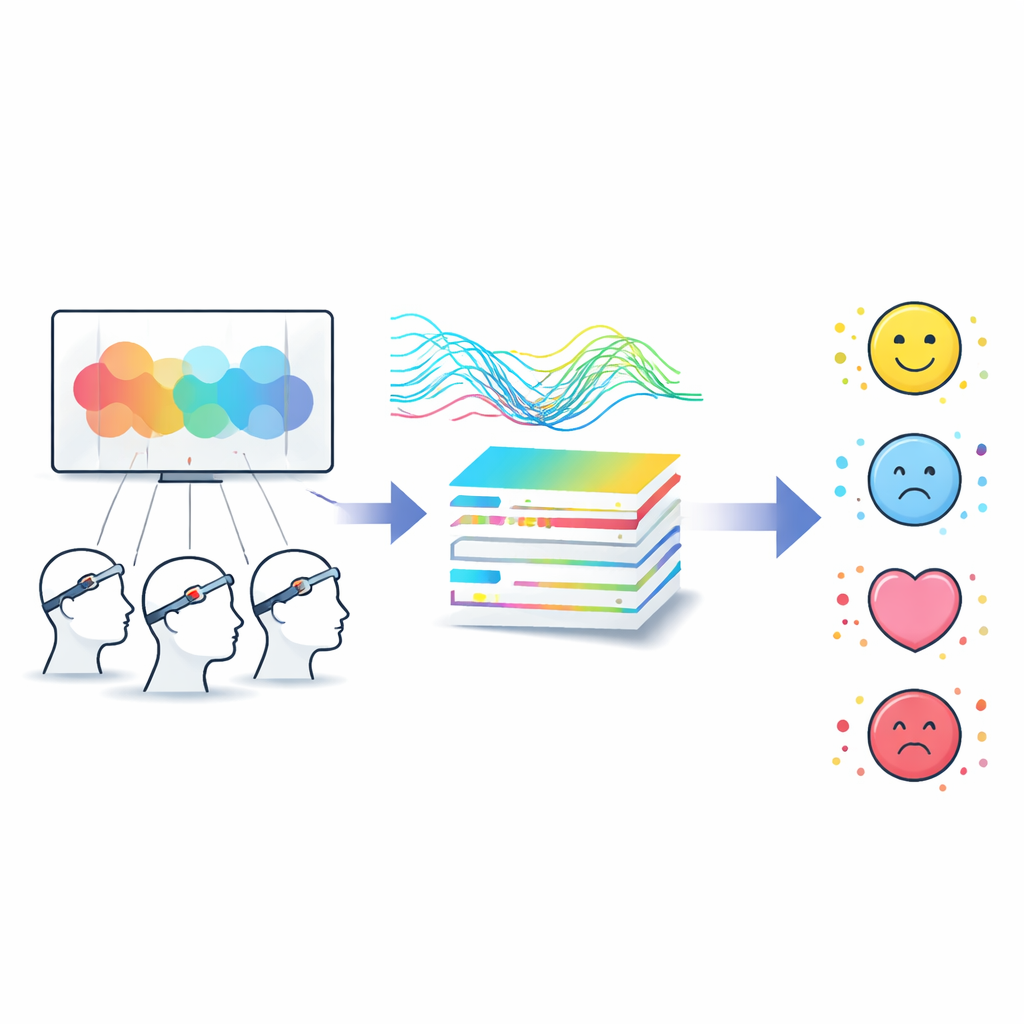

Imagine assistir a um trailer de filme enquanto uma faixa leve na cabeça escuta discretamente seu cérebro e tenta adivinhar se você está feliz, relaxado, triste ou assustado. Este estudo investiga como tornar esse cenário realista usando um pequeno dispositivo portátil de ondas cerebrais (EEG) em vez de equipamentos de laboratório volumosos. O trabalho importa para quem se interessa por mídia mais inteligente: desde anunciantes que querem entender reações do público até plataformas de streaming que poderiam recomendar programas com base em como os espectadores realmente se sentem, não apenas no que eles clicam.

Lendo sentimentos a partir das ondas cerebrais

Nossos cérebros produzem sinais elétricos fracos que podem ser captados no couro cabeludo usando eletroencefalografia, ou EEG. Esses sinais se alteram sutilmente quando experimentamos diferentes emoções. Um conjunto de dados popular de pesquisa, chamado DEAP, registrou o EEG de pessoas enquanto assistiam a vídeos musicais e depois pediu que avaliassem o quão agradável, intenso, controlado e apreciável cada vídeo parecia. A maioria dos estudos anteriores tentou extrair a maior precisão possível usando muitos eletrodos e computadores potentes, mas sob condições ideais de laboratório que não correspondem à vida real. Este artigo, em vez disso, faz uma pergunta mais prática: com um dispositivo portátil de baixo custo e menos eletrodos, ainda conseguimos capturar a emoção principal que um vídeo tende a evocar em muitas pessoas?

Encontrando uma história emocional compartilhada

Um obstáculo é que as pessoas não descrevem seus sentimentos da mesma forma. Dois espectadores podem assistir ao mesmo clipe, um chamando-o de “emocionante” e outro de “mais ou menos”. Os pesquisadores enfrentam isso construindo um sistema de calibração de rótulos passo a passo que busca padrões entre os espectadores em vez de confiar na avaliação de uma única pessoa. Primeiro, todas as avaliações são colocadas em uma escala comum e comprimidas em algumas dimensões-chave. Em seguida, um agrupamento não supervisionado reúne respostas emocionais semelhantes, com o objetivo de dividir os vídeos em quatro amplos quadrantes do espaço emocional: feliz (agradável e intenso), relaxado (agradável e calmo), assustado (desagradável e intenso) e triste (desagradável e calmo). Uma etapa final de refinamento ajusta casos incertos com base em informações de avaliação adicionais, produzindo um rótulo de emoção dominante para cada vídeo que melhor reflete a impressão geral do grupo.

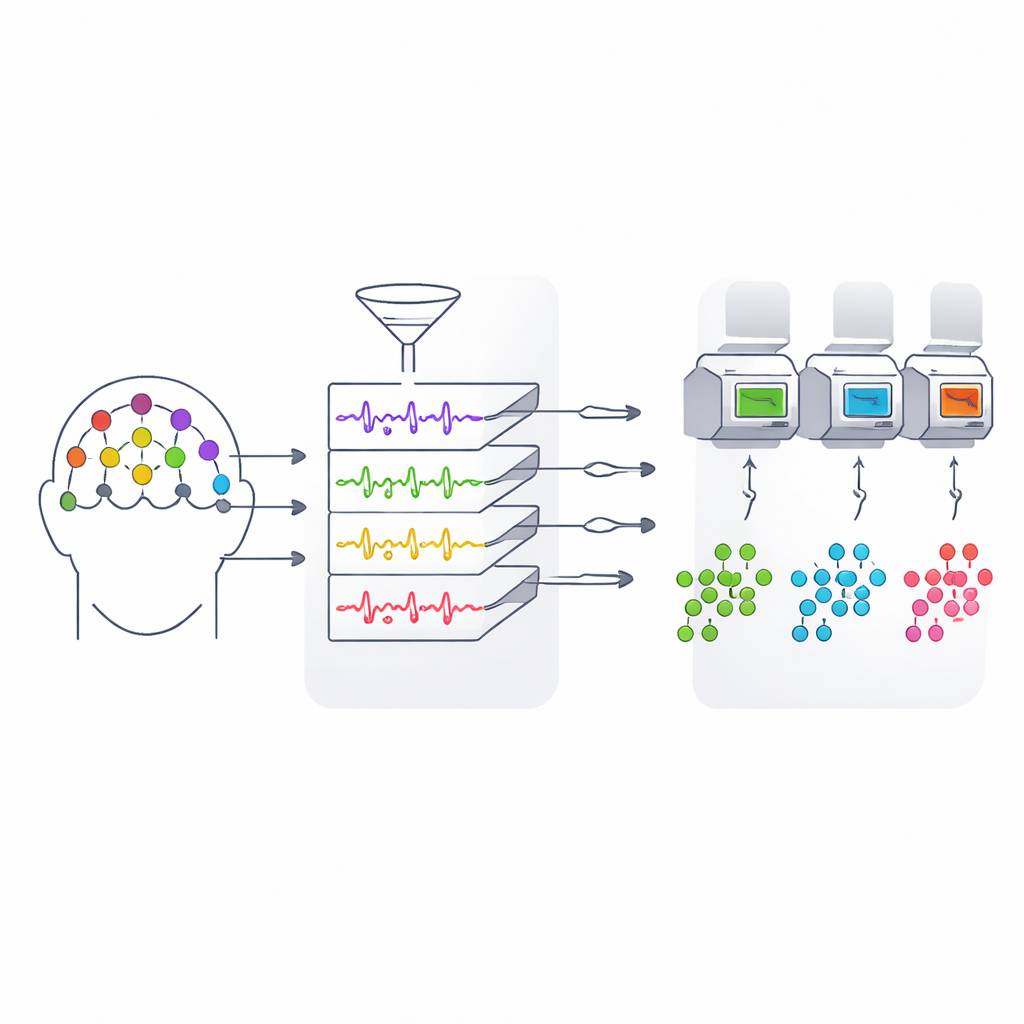

Fazendo mais com menos hardware

Outro desafio é o hardware: capacetes completos de EEG com 32 ou mais eletrodos são incômodos e caros. A equipe projeta uma forma de reduzir isso para apenas 11 locais escolhidos com cuidado sobre a testa, centro, laterais e parte de trás da cabeça — regiões ligadas ao controle emocional, excitação, audição, visão e atenção. Eles então realizam uma análise detalhada de como a energia do sinal se distribui pelas clássicas bandas de ondas cerebrais (do ritmo lento ao rápido) sob diferentes estados emocionais. Ao comparar esses padrões, mostram que certas combinações de frequências e locais no couro cabeludo carregam pistas especialmente fortes sobre se um espectador está, por exemplo, muito excitado ou profundamente relaxado. Essa abordagem de razão de energia em múltiplas bandas permite manter os sinais mais informativos enquanto elimina grande parte da redundância.

Deixando os dados destacarem o que importa

Mesmo com menos eletrodos, cada segundo de gravação contém um fluxo enorme de números. Para evitar sobrecarregar os modelos, os autores combinam vários tipos de características — como medidas de energia baseadas em wavelets, quão fortemente diferentes regiões cerebrais flutuam em conjunto e como a potência em várias frequências muda ao longo do tempo — em uma descrição rica, mas estruturada, de cada exibição. Uma etapa de seleção guiada por saliência então classifica essas características por quão úteis são para distinguir emoções, mantendo apenas um subconjunto compacto. Usando essa representação reduzida, três modelos padrão de aprendizado de máquina são treinados para reconhecer qual das quatro emoções dominantes melhor se ajusta a um determinado vídeo. Em testes exigentes, nos quais o sistema deve generalizar para pessoas completamente novas, o melhor modelo alcança cerca de 45% de precisão, um resultado sólido para uma escolha em quatro classes com dados cerebrais ruidosos e apenas 11 canais.

O que isso significa para a tecnologia do dia a dia

Para não especialistas, a mensagem chave é que podemos começar a avaliar como grupos de pessoas se sentem em relação a vídeos usando pequenos dispositivos portáteis de EEG em vez de equipamentos completos de laboratório. Ao limpar os rótulos emocionais, concentrar-se nas partes mais informativas do sinal de EEG e selecionar apenas um punhado de sensores bem posicionados, os autores mostram que é possível detectar o tom emocional dominante de um vídeo — feliz, relaxado, assustado ou triste — entre os espectadores. O sistema não é perfeito, mas aponta para ferramentas práticas de rastreamento do sentimento do público, teste de conteúdo e recomendações sensíveis às emoções que se baseiam em respostas cerebrais objetivas em vez de apenas em pesquisas ou cliques.

Citação: Wen, X., Xu, W., Tian, L. et al. Video-dominant emotion recognition for portable EEG-based devices. Sci Rep 16, 7899 (2026). https://doi.org/10.1038/s41598-026-39315-8

Palavras-chave: reconhecimento de emoções por EEG, interface cérebro–computador, análise afetiva de vídeo, neurociência vestível, computação afetiva