Clear Sky Science · pt

Usar um grande modelo de linguagem para aprimorar o raciocínio de outro grande modelo de linguagem por meio do GRPO atualizado por recompensa

Ensinando Máquinas a Pensar com Clareza

Muitos dos modelos de linguagem atuais conseguem conversar, traduzir e responder perguntas, mas ainda têm dificuldade em mostrar o processo como um bom aluno de matemática ou um analista cuidadoso faria. Este artigo investiga como um sistema de inteligência artificial pode ser usado para aprimorar as habilidades de raciocínio de outro, e como fazer isso sem construir manualmente grandes conjuntos de dados especializados. Para leitores interessados em como a IA pode se tornar mais confiável em áreas como finanças, medicina ou pesquisa científica, o trabalho oferece uma receita prática para fazer com que os modelos expliquem suas respostas de forma mais clara e consistente.

De Documentos Brutos a Exemplos Ensináveis

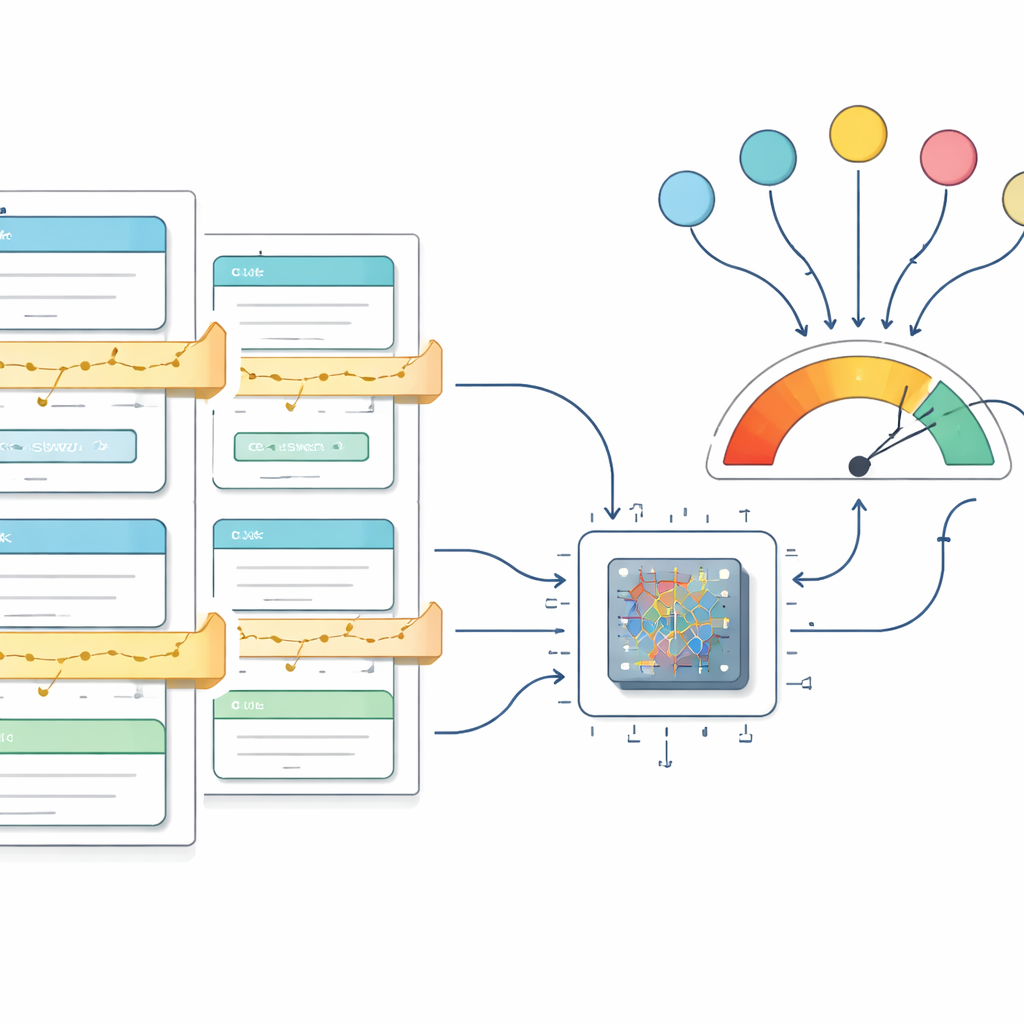

Os autores partem de uma observação simples: a maior parte da informação do mundo real vive em formas desordenadas, como relatórios, cartas a acionistas ou páginas da web, e não em um formato limpo de pergunta e resposta. Para conectar essa lacuna, eles apresentam duas ferramentas de software, Huggify-Data e o CoT Data Generator. Essas ferramentas pegam texto não estruturado e automaticamente o transformam em pares de perguntas e respostas, então pedem a um modelo de linguagem potente que forneça os passos de raciocínio faltantes entre eles. O resultado é um triplo estruturado para cada exemplo: uma pergunta, uma cadeia de raciocínio e uma resposta. Crucialmente, esse pipeline pode ser aplicado a quase qualquer domínio, de matemática escolar a finanças corporativas, tornando possível construir dados de treinamento focados em raciocínio sem exércitos de anotadores humanos.

Como Um Modelo Treina Outro

Uma vez criados esses tripletos pergunta–raciocínio–resposta, eles são usados para treinar um modelo “aluno” menor a pensar da mesma maneira estruturada. Ao aluno pede-se não apenas que forneça uma resposta final, mas que gere uma explicação claramente separada seguida da conclusão. O treinamento é guiado por um método chamado Group Relative Policy Optimization, que compara várias respostas candidatas para a mesma pergunta e direciona o modelo em direção às melhores. O artigo atualiza esse método com um termo de recompensa adicional que verifica se a saída do modelo segue o formato desejado, até mesmo observando quão próximo ela está de um exemplo de referência bem formado. Essa recompensa penaliza suavemente explicações embaralhadas ou incompletas, empurrando o modelo para respostas limpas e interpretáveis.

Colocando a Abordagem à Prova

Para avaliar se a estrutura funciona na prática, os autores a aplicam a dois conjuntos de dados muito diferentes. O primeiro, GSM8K, consiste em problemas de enunciado do ensino fundamental que exigem raciocínio aritmético em vários passos. O segundo é construído a partir das cartas anuais de Warren Buffett aos acionistas, onde o objetivo é capturar raciocínios em longo formato sobre investimento e decisões corporativas. Em ambos os casos, o pipeline transforma texto bruto em dados de treinamento estruturados e ajusta um modelo de porte médio chamado Qwen 2.5. Durante o treinamento, uma regra de pontuação simples recompensa respostas corretas e bem formatadas; à medida que o aprendizado avança, a recompensa média sobe de forma constante e se estabiliza em seu máximo teórico, mostrando que o modelo dominou em grande parte o comportamento alvo nos dados de treinamento.

Como o Modelo Aprimorado Desempenha

O desempenho é medido usando a “acurácia média por token”, que pergunta, em termos gerais, que fração das pequenas unidades de texto (tokens) nas saídas do modelo corresponde às esperadas. Embora isso difira da avaliação tradicional de tudo-ou-nada nas respostas de teste, é bem adequado para julgar se explicações e respostas são produzidas na estrutura correta. No GSM8K, o melhor modelo atinge 98,2% de acurácia por token, e nas cartas de Buffett alcança 98,5%. Essas pontuações são superiores às relatadas para sistemas amplamente conhecidos, como GPT‑4 e Claude 3.5 Sonnet sob a mesma métrica, tudo isso usando apenas um modelo de 3 bilhões de parâmetros que pode ser treinado em menos de dois dias em hardware alugado. Os autores também compartilham detalhes sobre custos computacionais e configurações de hardware, e liberam todo o código, modelos e conjuntos de dados para que outros possam inspecionar e construir em cima.

O Que Isso Significa para o Uso Cotidiano da IA

Para não especialistas, a conclusão principal é que sistemas de IA podem ser ensinados não só a responder, mas a responder de maneira disciplinada e fácil de seguir, usando dados extraídos automaticamente de documentos ordinários. Ao combinar um modelo professor rico em raciocínio, um pipeline de dados flexível e um esquema de recompensa que valoriza tanto a correção quanto a clareza, os autores mostram como moldar modelos menores em solucionadores de problemas mais confiáveis. Embora ressaltem limitações — como a necessidade de testes mais robustos de entendimento real e segurança —, a estrutura aponta para um futuro em que organizações possam transformar seus próprios arquivos de texto em assistentes de IA personalizados e transparentes para educação, finanças e além.

Citação: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

Palavras-chave: grandes modelos de linguagem, raciocínio em cadeia (chain-of-thought), otimização por recompensa, curadoria de dados, IA específica por domínio