Clear Sky Science · pt

Uma análise comparativa de modelos de chatbot incorporados e ChatGPT-4 para responder a dúvidas sobre tratamento ortodôntico

Por que chatbots mais inteligentes importam para quem usa aparelho

Quem já usou aparelho sabe que as dúvidas não esperam o horário de atendimento: essa dor vai passar? Posso comer isso? Preciso me preocupar com a articulação da mandíbula? Este estudo investiga se um chatbot ortodôntico desenvolvido com um propósito específico — projetado para responder a essas perguntas do dia a dia — pode fornecer respostas mais claras e confiáveis do que um sistema de inteligência artificial geral, o ChatGPT‑4. O trabalho dá uma ideia de como ferramentas de IA cuidadosamente adaptadas podem apoiar tanto pacientes quanto clínicos no cuidado odontológico moderno.

Um chatbot construído só para perguntas sobre aparelho

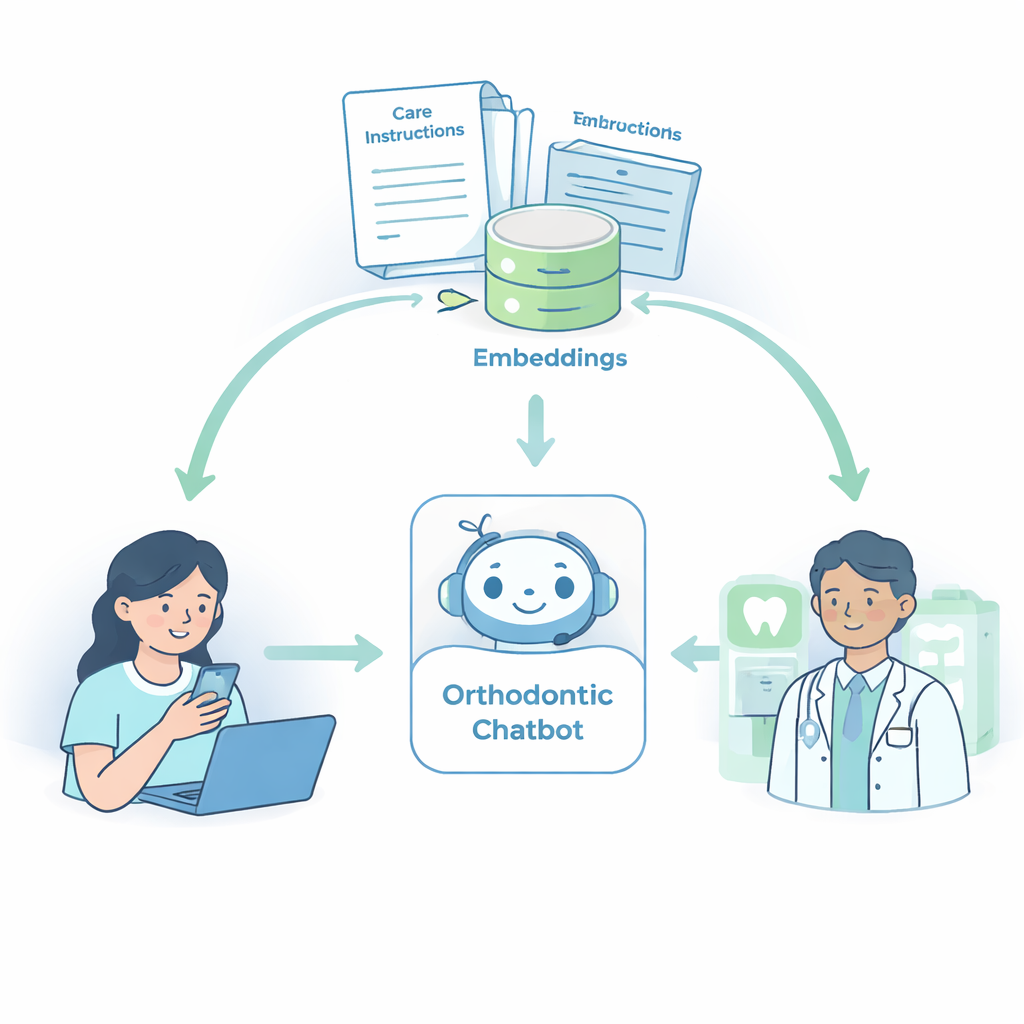

Os pesquisadores criaram um chatbot incorporado focado exclusivamente em tratamento ortodôntico. Em vez de treinar uma IA inteiramente nova, eles conectaram um modelo de linguagem avançado a uma biblioteca selecionada de materiais destinados a pacientes e trechos-chave de livros-texto. Essa biblioteca incluiu folhetos da British Orthodontic Society sobre temas como higiene oral, alimentação, cuidados com o aparelho, elásticos e contenções, além de explicações breves de livros de ortodontia padrão. Usando uma técnica chamada geração aumentada por recuperação, o sistema buscava nessa biblioteca trechos relevantes sempre que uma pergunta era feita e os utilizava para moldar sua resposta, procurando espelhar o que um paciente ouviria durante uma conversa típica na cadeira clínica.

Como o estudo testou os dois sistemas

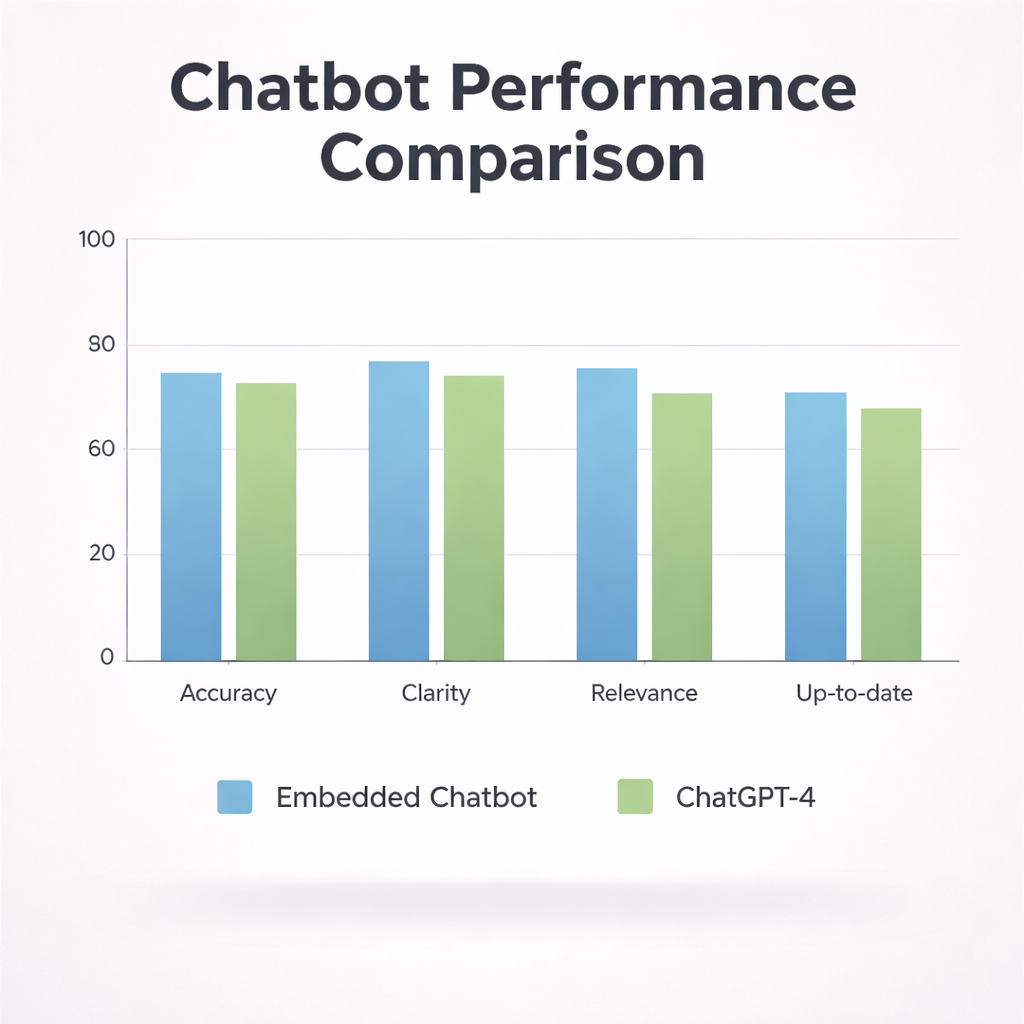

Para avaliar o desempenho desse chatbot especializado, a equipe o comparou com o ChatGPT‑4, usado de forma padrão via a interface ChatGPT Plus. Eles reuniram 30 perguntas do mundo real que pacientes costumam fazer antes, durante e depois do tratamento com aparelho — por exemplo, se o aparelho causa dor, como afeta a fala ou o canto, com que frequência são necessárias consultas de revisão e se o aparelho pode ajudar problemas da articulação mandibular. Ambos os sistemas receberam os mesmos comandos, instruindo-os a responder como um especialista em ortodontia usando linguagem clara e acessível ao paciente. Seis consultores ortodontistas experientes então avaliaram cada resposta anonimizadas em quatro aspectos: precisão, clareza, relevância para a pergunta e quão atual parecia a informação, usando uma escala de cinco pontos.

Medindo qualidade, não apenas impressões

Em vez de confiar em impressões gerais, os pesquisadores usaram um método de pontuação estruturado chamado Índice de Validade de Conteúdo. Para cada pergunta e cada aspecto de qualidade, eles contaram quantos especialistas classificaram uma resposta como “concordo” ou “concordo plenamente” e converteram isso em uma pontuação entre zero e um. Pontuações altas significavam que a maioria dos especialistas considerava a resposta precisa, clara, relevante ou atual. Eles também calcularam médias em todas as perguntas para ver o desempenho geral de cada sistema. Testes estatísticos foram aplicados para verificar se quaisquer diferenças entre os dois chatbots eram grandes o suficiente para ser consideradas significativas, em vez de decorrentes apenas do acaso.

O que os ortodontistas acharam das respostas

O chatbot incorporado, em geral, saiu na frente. Cerca de três quartos de suas respostas alcançaram um limiar de qualidade aceitável, em comparação com um pouco mais da metade das respostas do ChatGPT‑4. Em média, o chatbot especializado obteve melhores pontuações em precisão, clareza e relevância, e também pareceu levemente mais alinhado com as orientações atuais. Por exemplo, ao explicar dor durante o tratamento com aparelho ou se o aparelho afeta a fala, suas respostas foram diretas, concretas e muito próximas ao aconselhamento padrão ao paciente. Em contraste, as respostas do ChatGPT‑4, embora frequentemente razoáveis, tendiam a ser mais gerais e às vezes mais técnicas, o que pode ter reduzido sua clareza aos olhos dos especialistas. No entanto, quando os pesquisadores aplicaram testes estatísticos formais, as diferenças entre os dois sistemas não foram grandes o suficiente para serem consideradas estatisticamente significativas.

Limites e lições para o futuro da IA na clínica

O estudo também revelou que mesmo especialistas nem sempre concordam sobre o que conta como a “melhor” resposta. A concordância geral entre os ortodontistas foi mais fraca do que o esperado, especialmente para aspectos subjetivos como clareza e relevância. Os pesquisadores observaram várias outras limitações: estudaram apenas duas configurações de IA, não envolveram pacientes diretamente e basearam seu chatbot especializado em um conjunto específico de materiais escritos. Ainda assim, o trabalho contribui para evidências crescentes de que sistemas de IA podem responder razoavelmente bem a muitas perguntas odontológicas comuns, e que adicionar material de referência focado e atualizado pode impulsionar o desempenho.

O que isso significa para quem usa aparelho

Para os pacientes, a conclusão é encorajadora, mas cautelosa. Um chatbot bem projetado e focado em ortodontia pode fornecer respostas claras e confiáveis para muitas dúvidas cotidianas e pode reduzir a ansiedade entre consultas. Ao mesmo tempo, este estudo mostra que tal ferramenta ainda não substitui a necessidade de julgamento profissional ou aconselhamento presencial. A promessa real está em combinar esses assistentes de IA adaptados com o cuidado especializado, de modo que pessoas com aparelho possam obter informações oportunas e fáceis de entender, mantendo o ortodontista como referência para decisões finais.

Citação: Khalil, R., Amin, L., Sukhia, R.H. et al. A comparative analysis of embedded chatbot models and ChatGPT-4 for answering orthodontic treatment queries. Sci Rep 16, 7776 (2026). https://doi.org/10.1038/s41598-026-39263-3

Palavras-chave: chatbot ortodôntico, IA odontológica, perguntas sobre aparelho, educação do paciente, comparação com ChatGPT