Clear Sky Science · pt

Avaliação de assistentes de aprendizagem com IA no ensino superior de engenharia: implicações para engajamento estudantil, ética e políticas

Por que isso importa para os estudantes universitários de hoje

Estudantes universitários recorrem a chatbots e outras ferramentas de inteligência artificial para obter ajuda com tarefas, programação e conceitos de aula confusos. Mas essas ferramentas realmente apoiam a aprendizagem, e o que acontece com questões como cola, justiça e confiança quando o software se torna um parceiro de estudo? Este artigo acompanha um experimento em cursos de engenharia civil e ambiental que testou um “Hub Educacional de IA” e perguntou aos alunos o que funcionou, o que os preocupou e como eles acham que a IA deveria se encaixar no futuro do ensino superior.

Um colega de estudo digital, muitas ferramentas integradas

O Hub Educacional de IA é um assistente de aprendizagem específico por disciplina que vive dentro da plataforma de ensino online da universidade. Em vez de enviar perguntas a um chatbot geral treinado na internet inteira, os estudantes interagem com um assistente fortemente vinculado às suas próprias aulas, tarefas e plano de curso. Por trás das cortinas, o sistema lê PDFs de curso aprovados pelo instrutor, os transforma em trechos pesquisáveis e alimenta apenas esses trechos em um modelo avançado de linguagem para responder às perguntas dos alunos. O Hub oferece seis ferramentas principais: notas curtas geradas por IA, um chatbot de perguntas e respostas, flashcards, quizzes com correção automática, uma “caixa de areia” para auxílio em programação e respostas rápidas sobre logística do plano de curso. Ele foi projetado para agir como um assistente de ensino amigável e sempre disponível, em vez de um motor de atalhos.

Como o estudo foi realizado

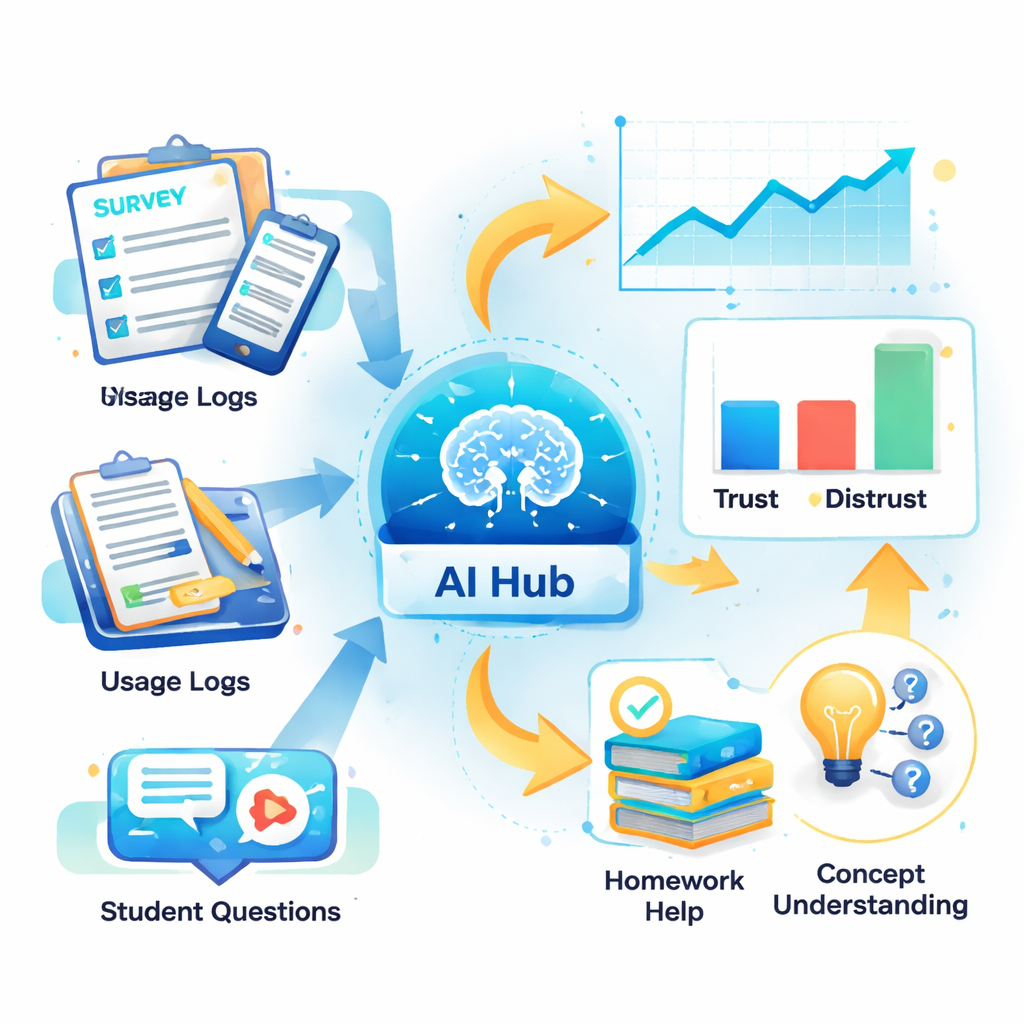

Para ver como os alunos realmente usavam esse assistente, os pesquisadores o incorporaram em dois cursos de graduação em engenharia numa grande universidade pública de pesquisa. Sessenta e cinco dos 77 alunos matriculados se voluntariaram para participar. Eles responderam a pesquisas no início e no fim do semestre sobre sua experiência com IA, sua confiança nessas ferramentas e suas preocupações com ética e integridade acadêmica. Ao mesmo tempo, o sistema registrou discretamente cada interação: quais recursos os alunos usaram, com que frequência retornavam e que tipos de perguntas faziam. A equipe também categorizou centenas de consultas dos alunos em temas como “ajuda com software”, “questões de teoria” e “esclarecimento de tarefas” para entender que tipo de ajuda os estudantes realmente buscavam.

O que os alunos gostaram — e no que não confiaram totalmente

A funcionalidade mais popular, de longe, foi o chatbot, que respondeu por mais de 90% de todas as interações. Os alunos o usaram intensamente para se desbloquear em tarefas técnicas de software em ferramentas como ArcGIS e MATLAB, e para esclarecer conceitos e fórmulas centrais da engenharia. Muitos relataram que o assistente facilitou o entendimento do conteúdo do curso e a conclusão de trabalhos, e alguns disseram que se sentiam mais à vontade para fazer perguntas à IA do que a professores ou monitores. No entanto, a maioria dos estudantes ainda via a ajuda humana como igual ou superior em qualidade. Preocupações sobre respostas incorretas ou enganosas da IA — às vezes chamadas de “alucinações” — fizeram com que muitos usuários tratassem o assistente como uma primeira verificação conveniente, em vez de uma autoridade final.

Áreas éticas cinzentas e confusão sobre políticas

Mesmo quando os alunos apreciavam a ferramenta, sentiam-se inseguros quanto às regras de uso. Muitos não tinham certeza exatamente do que constituía má conduta acadêmica ao trabalhar com IA e temiam ser falsamente acusados de cola. Quase metade acreditava que a IA não comprometia automaticamente a integridade acadêmica, mas parcela semelhante se mostrava apreensiva em usá‑la em trabalhos avaliados. Importante: os estudantes não queriam a proibição da IA; em vez disso, pediam políticas de curso “um tanto restritivas” com orientações claras. A maioria concordou que usar IA como auxílio acadêmico pode ser ético e disse que gostaria de ferramentas semelhantes em outras disciplinas, contanto que as expectativas fossem explicadas em linguagem simples e vinculadas a hábitos responsáveis, como checar fontes e citar a assistência.

Dos dados para um ensino e aprendizagem melhores

Registros de uso e respostas às pesquisas contaram uma história consistente: os alunos usaram o Hub de IA principalmente quando confiavam nele, sentiam‑se confortáveis e viam‑no como realmente útil para tarefas do curso, como revisão de conceitos e trabalhos. Menos confiança na IA andou de mãos dadas com menor uso, enquanto conforto e utilidade percebida se relacionaram com maior engajamento. Ainda assim, os estudantes não atribuíram ao sistema, isoladamente, a melhoria de suas notas, e muitos ainda recorriam a chatbots de uso geral para programação ou matemática que extrapolavam os materiais do curso. Esses padrões sugerem que assistentes de IA funcionam melhor como uma camada de suporte direcionada dentro de uma disciplina — não como substitutos de instrutores e não como solução única para todos.

O que isso significa para a sala de aula do futuro

Para o público em geral, a conclusão é que ajudantes de estudo com IA podem tornar disciplinas técnicas mais acessíveis e dar aos alunos uma maneira sem pressão de fazer perguntas a qualquer hora, mas não resolvem magicamente a aprendizagem por conta própria. Neste estudo, estudantes de engenharia trataram o Hub Educacional de IA como um companheiro prático que podia destravar problemas e explicar ideias difíceis, enquanto continuavam a confiar em professores e hábitos de estudo tradicionais. As maiores preocupações deles centraram‑se não na tecnologia em si, mas em regras confusas e no medo de acusações de cola. Os autores argumentam que, se as faculdades quiserem que a IA realmente melhore a educação, elas devem combinar ferramentas inteligentes e específicas do curso com políticas claras e transparentes e orientação ativa dos docentes, ajudando os alunos a aprender não só com a IA, mas também como usá‑la de forma responsável.

Citação: Sajja, R., Sermet, Y., Fodale, B. et al. Evaluating AI-powered learning assistants in engineering higher education with implications for student engagement, ethics, and policy. Sci Rep 16, 7565 (2026). https://doi.org/10.1038/s41598-026-39237-5

Palavras-chave: IA na educação, estudantes de engenharia, assistente de aprendizagem, integridade acadêmica, engajamento estudantil