Clear Sky Science · pt

Modelos de linguagem multimodais desafiam o Image Challenge do NEJM

Por que isso importa para pacientes e médicos

Obter o diagnóstico correto no momento certo pode ser a diferença entre um tratamento rápido e anos de sofrimento. Ainda assim, médicos — mesmo os altamente treinados — continuam a perder ou atrasar diagnósticos, especialmente em doenças raras ou incomuns. Este estudo faz uma pergunta marcante: quando imagens médicas e detalhes clínicos são fornecidos aos sistemas de inteligência artificial mais avançados de hoje, eles conseguem diagnosticar casos complexos melhor do que um grande número de médicos reais — e, se sim, o que isso significa para os cuidados médicos no futuro?

Um enorme quebra-cabeça construído a partir de casos do mundo real

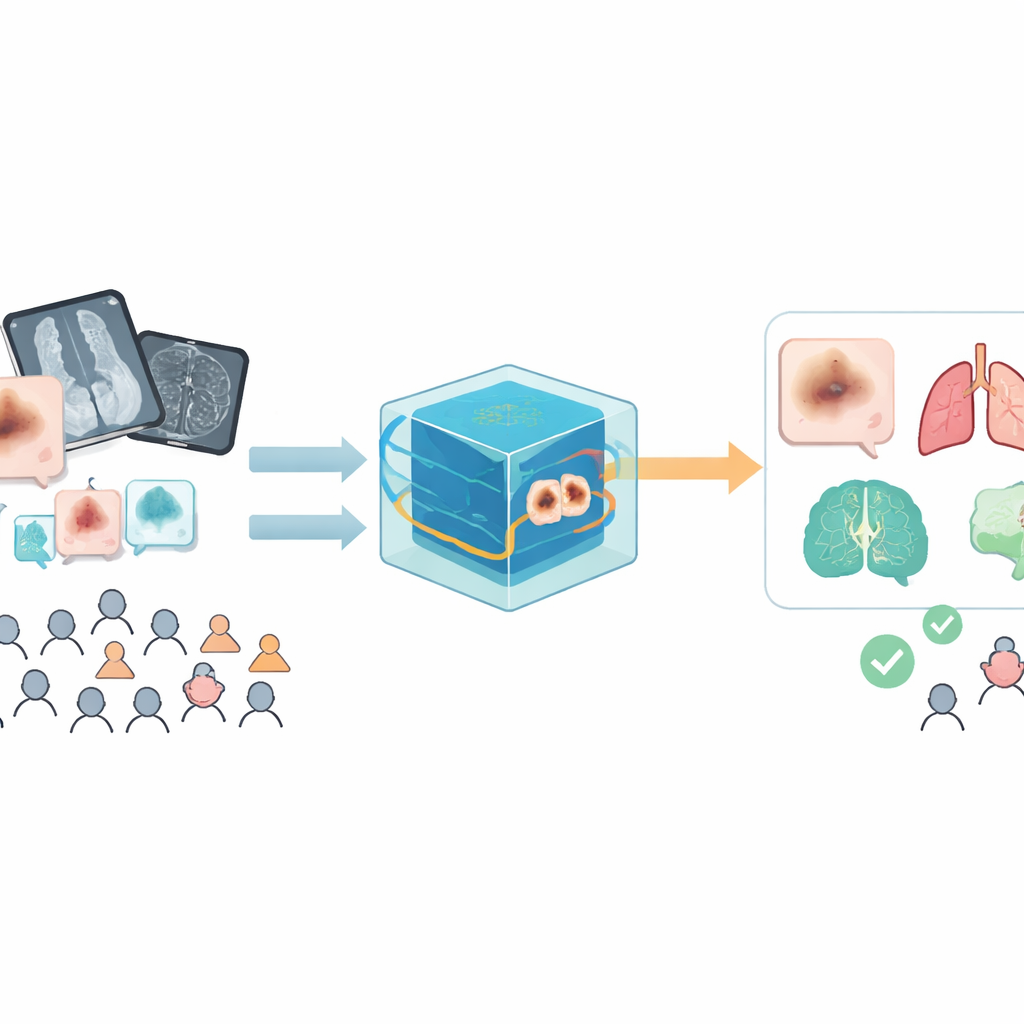

Os pesquisadores recorreram a um recurso de longa data do New England Journal of Medicine chamado "Image Challenge". Cada desafio apresenta a imagem médica de um paciente real — como foto de pele, raio‑X, ressonância magnética ou lâmina ao microscópio — acompanhada de uma breve história clínica e cinco diagnósticos possíveis. Mais de 16 milhões de respostas de mais de 60.000 médicos por caso foram acumuladas desde 2009, criando um registro global único sobre como os médicos se saem nas mesmas questões difíceis. A partir desse arquivo, a equipe selecionou 272 casos cobrindo todas as idades, ambos os sexos e uma ampla gama de condições, desde infecções e distúrbios imunológicos até cânceres, doenças genéticas e traumas.

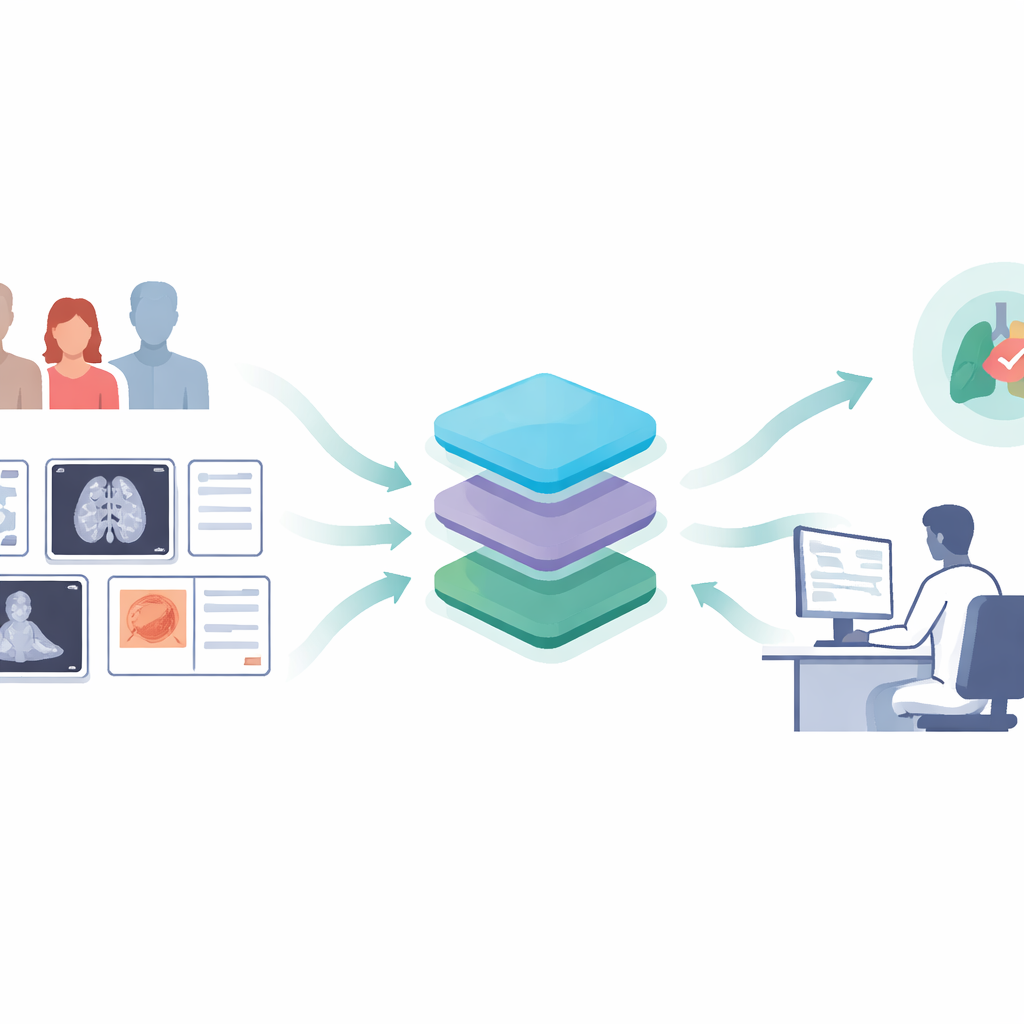

Colocando IA e médicos no mesmo campo de jogo

O estudo testou três dos principais modelos de linguagem multimodais — sistemas que conseguem analisar imagens e texto juntos: GPT‑4o, Claude 3.7 e Doubao. Para cada caso, os modelos primeiro viram apenas a imagem e precisaram escolher uma das cinco opções com uma explicação. Depois, eles viram a imagem mais a descrição clínica e responderam novamente. Para manter o teste justo, os modelos foram usados em configurações padrão, com busca na web e recursos extras de raciocínio desligados, e cada caso foi executado em uma sessão nova para evitar contaminação por respostas anteriores. Dois médicos avaliaram as respostas da IA em relação às soluções oficiais do New England Journal, concentrando‑se em saber se a escolha final correspondia ao diagnóstico verdadeiro, assim como faz o referencial humano.

Desempenho superhumano em doenças e imagens

Quando receberam imagem e texto, todos os três sistemas de IA superaram claramente o conjunto global de médicos. Claude 3.7 e GPT‑4o atingiram cerca de 89–90% de acerto cada um, em comparação com 46,7% para o voto majoritário dos respondentes humanos — uma diferença de mais de 40 pontos percentuais. Mesmo nos casos mais difíceis, em que menos de 40% dos médicos estavam corretos, Claude 3.7 acertou 86,5% dos diagnósticos. A vantagem se manteve na maioria dos tipos de doença e formatos de imagem: os modelos foram especialmente fortes em condições relacionadas a medicamentos e doenças genéticas, e lidaram não só com fotos e raios‑X, mas também com conjuntos endoscópicos, patológicos e mistos. O desempenho foi igualmente sólido para homens e mulheres e, em alguns dos grupos mais vulneráveis, como lactentes menores de um ano, os modelos foram dramaticamente mais precisos do que os médicos.

Mentes diferentes, não apenas mais rápidas

Talvez a descoberta mais surpreendente tenha sido com que frequência os modelos tiveram sucesso quando os médicos não tiveram. Em quase metade dos casos, Claude 3.7 estava correto enquanto a maioria dos médicos estava errada, e o oposto — médicos corretos, modelo errado — foi raro. No total, para o Claude 3.7 houve cerca de quinze casos de "vantagem do modelo" para cada um de "vantagem do médico". Ainda assim, o acordo entre humanos e IA sobre qual resposta escolher foi baixo, um sinal de que os sistemas não estão simplesmente ecoando padrões humanos, mas chegando a diagnósticos corretos por rotas diferentes. A adição do texto clínico geralmente ajudou muito, aumentando a acurácia da IA em 28–42 pontos percentuais em relação às imagens isoladas. Ainda assim, em uma pequena fração de casos, detalhes extras levaram modelos de uma resposta correta baseada na imagem para uma resposta errada, sugerindo novos tipos de vieses e modos de falha que precisarão de estudo cuidadoso.

O que isso pode significar para os cuidados futuros

Os autores concluem que os modelos de linguagem multimodais alcançaram um nível "superhumano" neste exigente questionário diagnóstico: são mais precisos que a média dos médicos e mantêm sua vantagem mesmo quando os casos confundem a maioria dos clínicos. Ao mesmo tempo, sua baixa sobreposição com as escolhas humanas sugere que pensam de maneiras complementares em vez de agir como cópias digitais dos clínicos. Usados com sabedoria, esses sistemas poderiam servir como leitores secundários poderosos, oferecendo opiniões independentes em casos difíceis ou raros e ajudando a detectar problemas que médicos humanos poderiam perder. Não estão prontos para substituir o julgamento clínico, mas podem em breve tornar‑se parceiros valiosos à beira do leito e na sala de leitura, verificando nosso trabalho e ampliando a rede de segurança para os pacientes.

Citação: Sheng, C., Shen, S., Wang, L. et al. Multimodal large language models challenge NEJM image challenge. Sci Rep 16, 8132 (2026). https://doi.org/10.1038/s41598-026-39201-3

Palavras-chave: diagnóstico médico, inteligência artificial, imagens médicas, doenças raras, apoio à decisão clínica