Clear Sky Science · pt

Efeitos locais acumulados e redes neurais de grafos para previsão de links

Por que entender links ocultos importa

Muitos dos sistemas que moldam nossas vidas — redes sociais, colaborações científicas, redes cerebrais e até a própria web — podem ser descritos como redes de pontos conectados. Uma pergunta central é quais novas conexões provavelmente se formarão no futuro, por exemplo quem irá colaborar com quem ou qual artigo citará outro. Redes neurais de grafos modernas são ferramentas poderosas para esse tipo de “previsão de links”, mas também são caixas-pretas: funcionam bem, porém é difícil entender por que tomam determinada decisão. Este artigo aborda esse problema ao adaptar uma técnica geral de explicação para que possamos ver como a variação de uma única propriedade de um nó afeta as chances de aparecimento de links para ele.

De pontuações simples a cérebros de grafos opacos

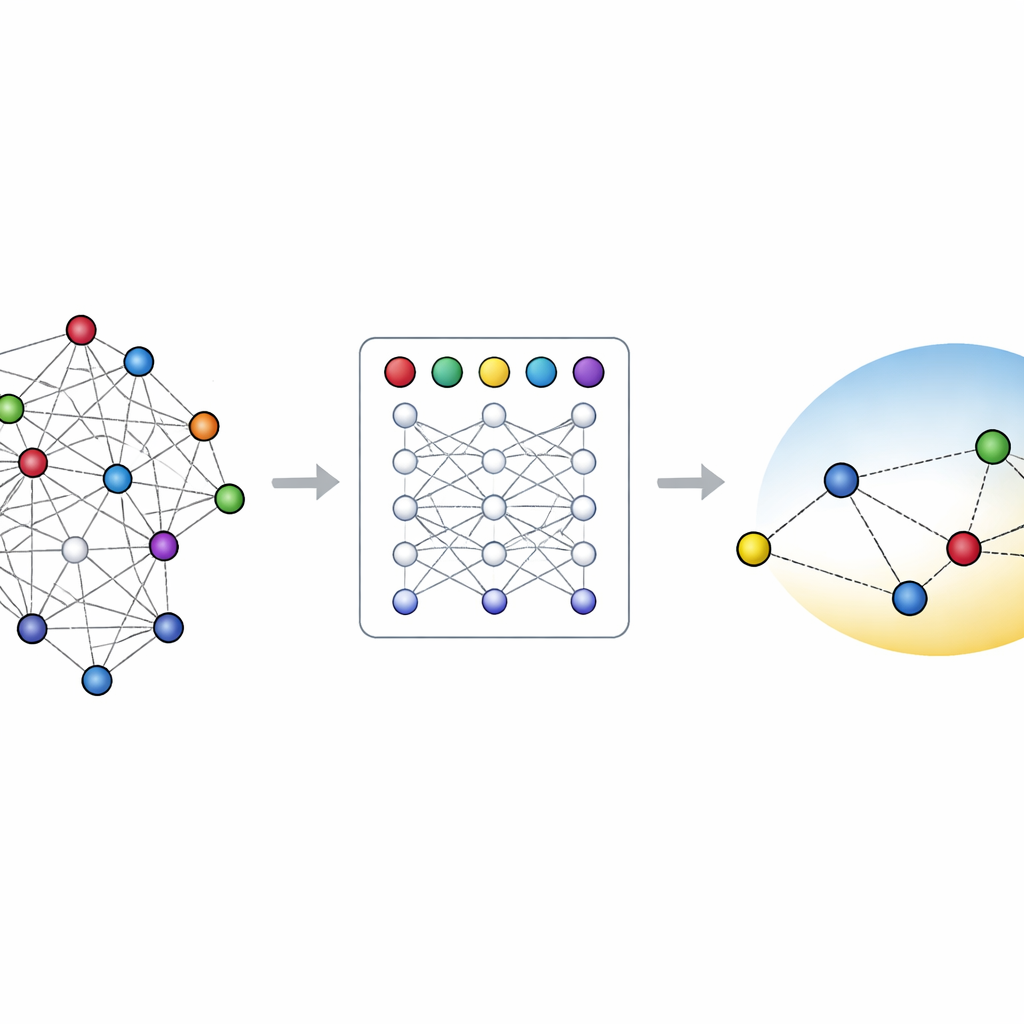

A ciência de redes inicial dependeu de regras simples para adivinhar links ausentes ou futuros. Por exemplo, duas pessoas com muitos amigos em comum têm maior probabilidade de se tornarem amigas, e páginas da web muito conectadas tendem a atrair ainda mais links. Na última década, essas pontuações manuais foram superadas por métodos que aprendem descrições numéricas compactas, ou embeddings, de cada nó. Redes neurais de grafos vão além: elas passam mensagens repetidamente ao longo das arestas para que o embedding de cada nó agregue informações de seus vizinhos e dos vizinhos desses vizinhos. Isso as torna excelentes em previsão de links, mas também significa que seus mecanismos internos ficam emaranhados e difíceis de interpretar.

Ver como uma única característica desloca previsões

Fora do mundo dos grafos, uma forma popular de interpretar modelos de caixa-preta é chamada Efeitos Locais Acumulados (ALE). Em vez de apenas indicar quais características são importantes, ALE pergunta como a predição do modelo muda quando você altera uma característica para cima ou para baixo ao longo de seus valores possíveis e então acumula essas mudanças locais em uma curva suave. Os autores adaptam ALE para previsão de links com redes neurais de grafos alterando a característica de um nó por vez e verificando como a probabilidade prevista de links entre esse nó e muitos outros responde. Isso produz uma visualização que mostra, por exemplo, como aumentar a parcela de autores de “Big Tech” em um artigo ou mudar a posição vertical de um segmento de vaso no cérebro altera a chance estimada de uma conexão pelo modelo.

Duas maneiras de calcular efeitos: exata e rápida

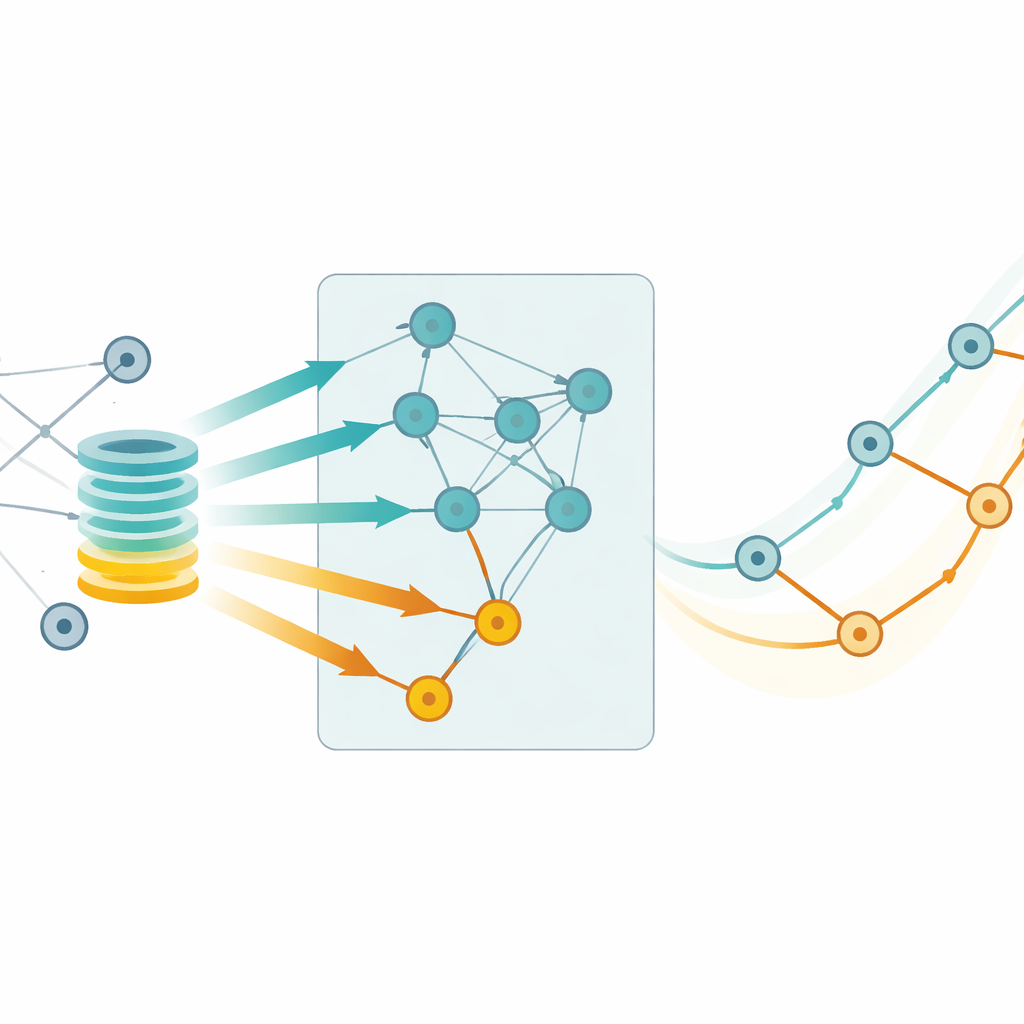

Redes neurais de grafos acrescentam uma complicação ao ALE: quando você altera muitos nós ao mesmo tempo, eles podem influenciar-se mutuamente por meio da passagem de mensagens, potencialmente distorcendo a explicação. Por isso, os autores comparam duas estratégias. Na versão “exata”, a característica de cada nó é modificada isoladamente, de modo que nenhum par de nós alterados pode contaminar os embeddings um do outro — porém isso é computacionalmente caro. Na versão “aproximada”, muitos nós são alterados ao mesmo tempo, tratando os dados mais como uma tabela comum e ignorando essas interações; isso é bem mais rápido, mas pode introduzir viés. Variando sistematicamente quantos nós são modificados e contra quantos parceiros potenciais eles são testados, os autores medem como essas escolhas afetam as curvas ALE.

Testes em grafos sintéticos e dados reais

Para avaliar a precisão, a equipe primeiro constrói uma rede sintética onde a verdadeira regra que governa a formação de links é conhecida: arestas são mais prováveis quando uma característica especial de “sinal” é alta em ambas as extremidades. Aqui, eles podem comparar diretamente as curvas ALE com a verdade de referência. Eles constataram que, à medida que mais nós são modificados simultaneamente, o método aproximado se afasta da relação verdadeira, enquanto o método exato permanece fiel. Em grandes conjuntos de dados do mundo real — uma rede de citações de artigos em inteligência artificial e um mapa 3D detalhado de vasos sanguíneos do cérebro de camundongo — já não é possível observar a regra verdadeira, então usam o método exato, agregado por muitas execuções, como explicação padrão-ouro e verificam quanto o método aproximado diverge. Testes estatísticos e experimentos de permutação mostram que, na maioria das combinações de modelo e conjunto de dados, as diferenças entre os dois métodos são modestas, embora as curvas aproximadas sejam mais variável de uma execução para outra.

O que esses efeitos revelam sobre o mundo

Além da metodologia, as curvas ALE oferecem vislumbres do que os modelos realmente aprenderam. Na rede de citações, elas indicam que artigos com uma fração maior de autores afiliados a grandes empresas de tecnologia têm maior probabilidade — segundo o modelo — de receber citações, ecoando preocupações sobre a influência crescente da indústria na pesquisa em IA. No grafo de vasos, duas arquiteturas diferentes de redes neurais de grafos aprendem tendências opostas sobre como a altura de um vaso no cérebro se relaciona com sua conectividade, sublinhando que ALE expõe as crenças do modelo, e não necessariamente a verdade biológica. Esses desalinhamentos podem sinalizar áreas onde a arquitetura do modelo, os dados de treinamento ou a avaliação precisam ser repensados.

Conclusão para leitores e praticantes

O estudo mostra que Efeitos Locais Acumulados podem ser adaptados para explicar previsões de links em redes neurais de grafos, oferecendo curvas intuitivas que mostram como alterar uma característica de nó aumenta ou diminui as probabilidades de conexão. Calcular essas curvas de maneira exata é mais confiável, porém mais lento, enquanto uma aproximação mais ágil costuma ser suficiente se for tolerável um pouco mais de ruído, especialmente ao se usar médias de várias execuções. Para quem já emprega ferramentas de explicação em modelos tradicionais de aprendizado de máquina, isso traz uma forma visual familiar de enxergar sistemas complexos baseados em grafos e questionar se o que o modelo aprendeu realmente corresponde ao nosso entendimento das redes que importam para nós.

Citação: Kaczyńska, P., Sienkiewicz, J. & Ślęzak, D. Accumulated local effects and graph neural networks for link prediction. Sci Rep 16, 8574 (2026). https://doi.org/10.1038/s41598-026-39000-w

Palavras-chave: redes neurais de grafos, previsão de links, explicabilidade de modelos, efeitos locais acumulados, ciência de redes