Clear Sky Science · pt

Modelos de linguagem de grande porte ajustados com prompts estruturados permitem a construção eficiente de grafos de conhecimento sobre câncer de pulmão

Por que transformar texto médico em mapas é importante

O câncer de pulmão é um dos cânceres mais letais do mundo, e informações sobre seu diagnóstico e tratamento estão espalhadas por artigos de pesquisa, prontuários hospitalares, consultas online e livros de casos da medicina tradicional. Médicos e pesquisadores têm dificuldade em acompanhar esse dilúvio de texto. Este estudo explora uma forma nova de transformar automaticamente esse conhecimento disperso em um único “mapa” navegável — um grafo de conhecimento sobre câncer de pulmão — usando um modelo de linguagem de grande porte ajustado e prompts cuidadosamente estruturados. O objetivo é tornar o conhecimento médico complexo mais fácil de ser buscado por computadores e mais útil para especialistas em ferramentas de suporte à decisão.

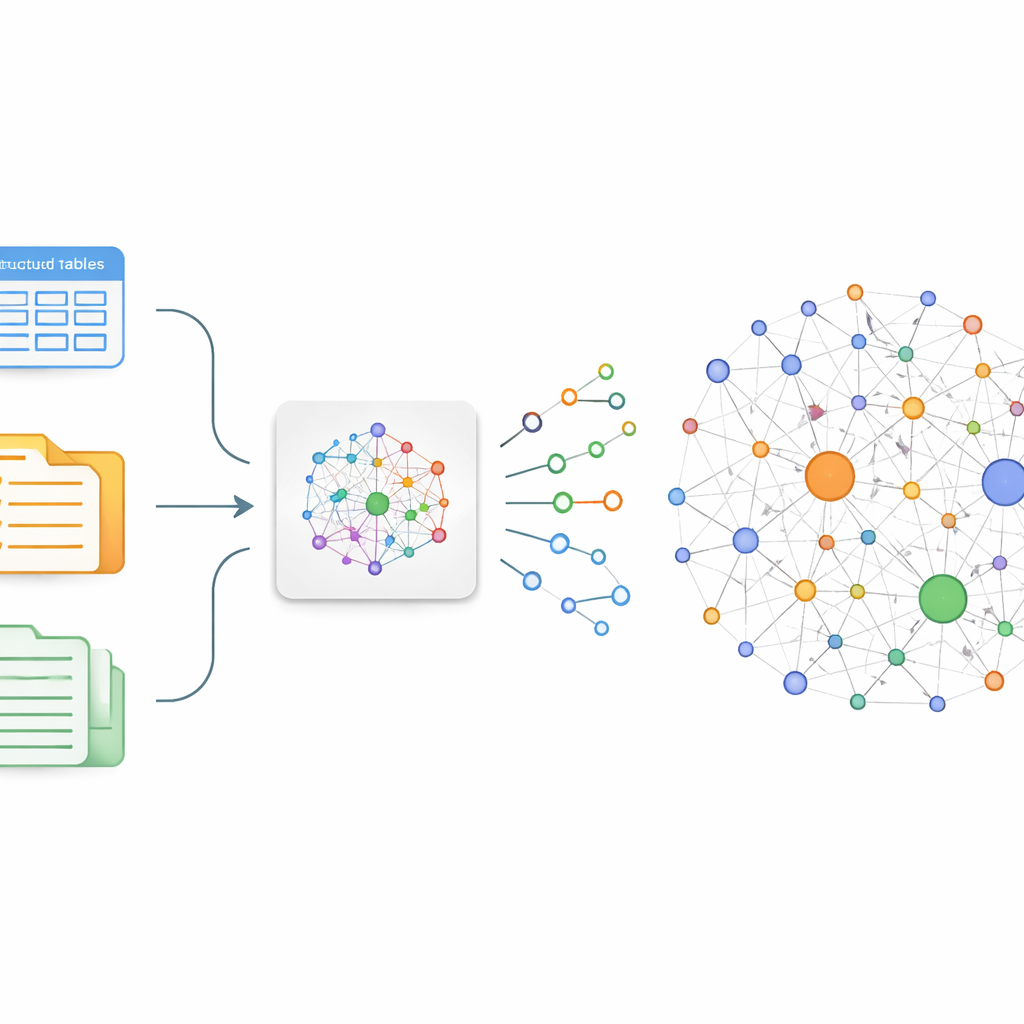

De histórias dispersas a fatos conectados

Os autores concentram-se em uma ideia simples: se for possível extrair de forma confiável quem-faz-o-quê-com-o-quê a partir do texto médico, é possível costurar esses fatos em um grafo. Na prática, isso significa converter sentenças em linguagem livre em pequenos blocos chamados triplas — pares de entidades ligadas por uma relação, como “câncer de pulmão – tratado por – quimioterapia.” Métodos tradicionais para construir esses grafos exigem exércitos de anotadores ou regras frágeis que perdem nuances e novas descobertas. Para superar isso, a equipe ajusta um modelo chinês existente de grande porte, o ChatGLM-6B, de modo que ele se especialize em identificar triplas medicamente relevantes sobre câncer de pulmão em uma ampla gama de fontes, desde conversas online entre pacientes e médicos até bancos de dados estruturados e registros da medicina tradicional chinesa.

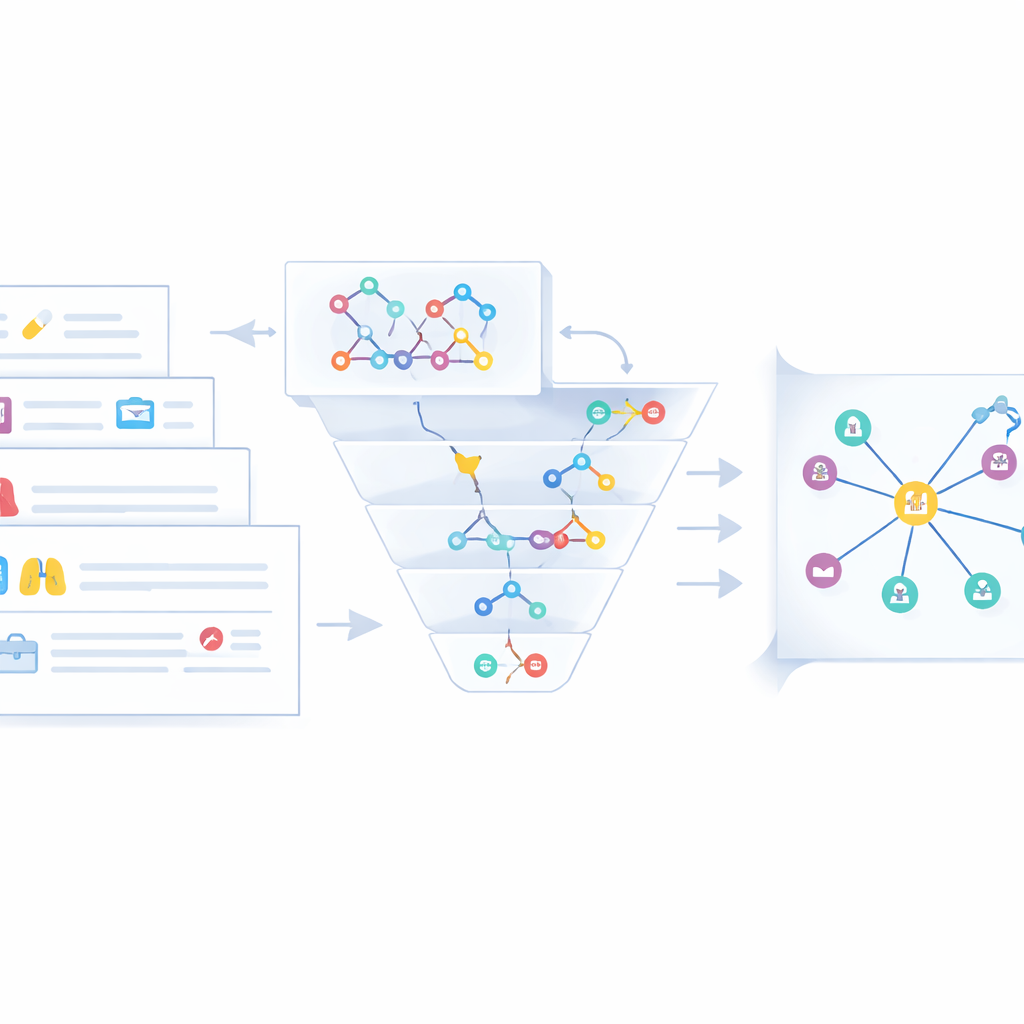

Ensinando uma IA a pensar em unidades ordenadas

Simplesmente pedir a um modelo de linguagem de uso geral para “extrair informação” costuma gerar respostas desorganizadas e prolixas. Os pesquisadores, portanto, projetam um esquema de prompting rígido e depois ajustam o modelo em quase 50.000 exemplos de bom comportamento. Cada exemplo mostra uma instrução e a saída esperada exatamente no formato de triplas. O prompt orienta o modelo a agir como um especialista profissional em mineração de texto, a produzir apenas triplas estruturadas em um formato legível por máquina e a “pensar passo a passo” quando as frases contêm detalhes aninhados — por exemplo, um tratamento, o fármaco usado e sua dosagem. Essa combinação de definição de papel, regras de formato e raciocínio passo a passo transforma o modelo — agora chamado KGLM — de um assistente conversacional em um extrator disciplinado de fatos prontos para máquinas.

Mesclando muitas vozes em um grafo claro

As triplas brutas extraídas do texto são apenas parte da história. A mesma doença ou fármaco frequentemente aparece sob nomes diferentes — “doença pulmonar obstrutiva crônica” versus “DPOC”, por exemplo. Para evitar bagunça e confusão, os autores desenvolvem uma etapa de fusão que une entidades equivalentes em três fluxos de dados: texto web não estruturado, casos clínicos semi-estruturados e grafos de conhecimento médico existentes. Primeiro, uma verificação rápida baseada em similaridade de strings sinaliza correspondências óbvias. Quando isso não basta, um modelo de similaridade semântica mais profundo (Sentence-BERT) compara significados no contexto. Entidades consideradas duplicatas são colapsadas em um único nó canônico, preferindo nomes mais curtos e armazenando outras formas como aliases. Especialistas então revisam casos-limite e removem afirmações enganosas ou de baixa qualidade, resultando em um grafo de conhecimento sobre câncer de pulmão mais limpo e coerente, armazenado em um banco de dados Neo4j.

Qual o desempenho desse mapa de conhecimento?

Para avaliar o desempenho, a equipe compara o KGLM com abordagens padrão de deep learning baseadas em BERT e redes convolucionais, bem como com o modelo ChatGLM original não ajustado. Na tarefa de extração de relações — decidir quais entidades estão ligadas e de que forma — o KGLM ajustado e guiado por prompts alcança uma pontuação F1 de cerca de 0,82, superando todas as linhas de base testadas e melhorando aproximadamente 25% em relação ao modelo inicial. Testes de ablação mostram que cada componente do prompt importa: remover o papel do especialista, o formato estrito de triplas ou a orientação de “pensar passo a passo” reduz a precisão, especialmente para frases complexas com atributos aninhados ou terminologia da medicina tradicional chinesa. Um painel de especialistas clínicos e de informática também considera o grafo resultante mais preciso, utilizável e clinicamente relevante do que grafos construídos sem ajuste fino ou prompts estruturados.

O que isso significa para ferramentas médicas futuras

Em termos simples, o estudo mostra que, com o treinamento e as instruções corretas, um modelo de linguagem de grande porte pode transformar de forma eficiente textos reais e desordenados sobre câncer de pulmão em uma teia estruturada e pesquisável de fatos. Esse grafo de conhecimento sobre câncer de pulmão, embora ainda protótipo de pesquisa e limitado a fontes em chinês e a uma única área de doença, aponta para um futuro em que “mapas de conhecimento” constantemente atualizados possam dar suporte a sistemas de auxílio à decisão, ferramentas educacionais e exploração de pesquisas. Os autores ressaltam que tais grafos devem ser cuidadosamente validados e atualizados regularmente, e não estão prontos para orientar cuidados sem supervisão de especialistas. Ainda assim, os resultados sugerem que modelos de linguagem ajustados, combinados com prompting inteligente, podem tornar a tarefa assustadora de organizar o conhecimento médico mais escalável e oportuna.

Citação: Zhou, C., Gong, Q., Luan, H. et al. Fine-tuned large language models with structured prompts enable efficient construction of lung cancer knowledge graphs. Sci Rep 16, 9505 (2026). https://doi.org/10.1038/s41598-026-38959-w

Palavras-chave: câncer de pulmão, grafo de conhecimento, modelo de linguagem de grande porte, extração de relações, IA médica