Clear Sky Science · pt

Otimização de energia por DQN para redes de comunicação alimentadas sem fio

Alimentando Dispositivos Minúsculos Pelo Ar

De postes de iluminação inteligentes a detectores de incêndio escondidos em florestas, inúmeros dispositivos minúsculos hoje compõem a Internet das Coisas. Manter todos eles abastecidos de energia é um grande problema: baterias acabam, e instalar cabos de energia por toda parte é impraticável. Este artigo explora uma forma de transmitir energia sem fio para esses dispositivos e usar inteligência artificial para compartilhar essa energia de maneira inteligente, de modo que sensores críticos permaneçam ativos por mais tempo e toda a rede funcione com mais fluidez.

Por que a Energia Sem Fio Precisa de Controle Mais Inteligente

Redes de comunicação alimentadas sem fio emitem ondas de rádio que os dispositivos podem converter em eletricidade enquanto também as usam para transmitir dados. Na maioria dos estudos anteriores, essa conversão de energia foi tratada como se se comportasse de forma simples e linear: mais sinal significava sempre proporcionalmente mais potência. Na realidade, circuitos de colheita de energia começam a “achatar” quando o sinal recebido é forte, desperdiçando parte da energia. Ao mesmo tempo, ambientes reais são desordenados: a luz solar para painéis fotovoltaicos pode oscilar, edifícios bloqueiam sinais e eventos súbitos, como incêndios, podem criar necessidades urgentes de dados em nós específicos. Regras estáticas que ignoram essas variações podem deixar alguns sensores sem energia e fazer com que outros a desperdicem, reduzindo a vida útil geral da rede.

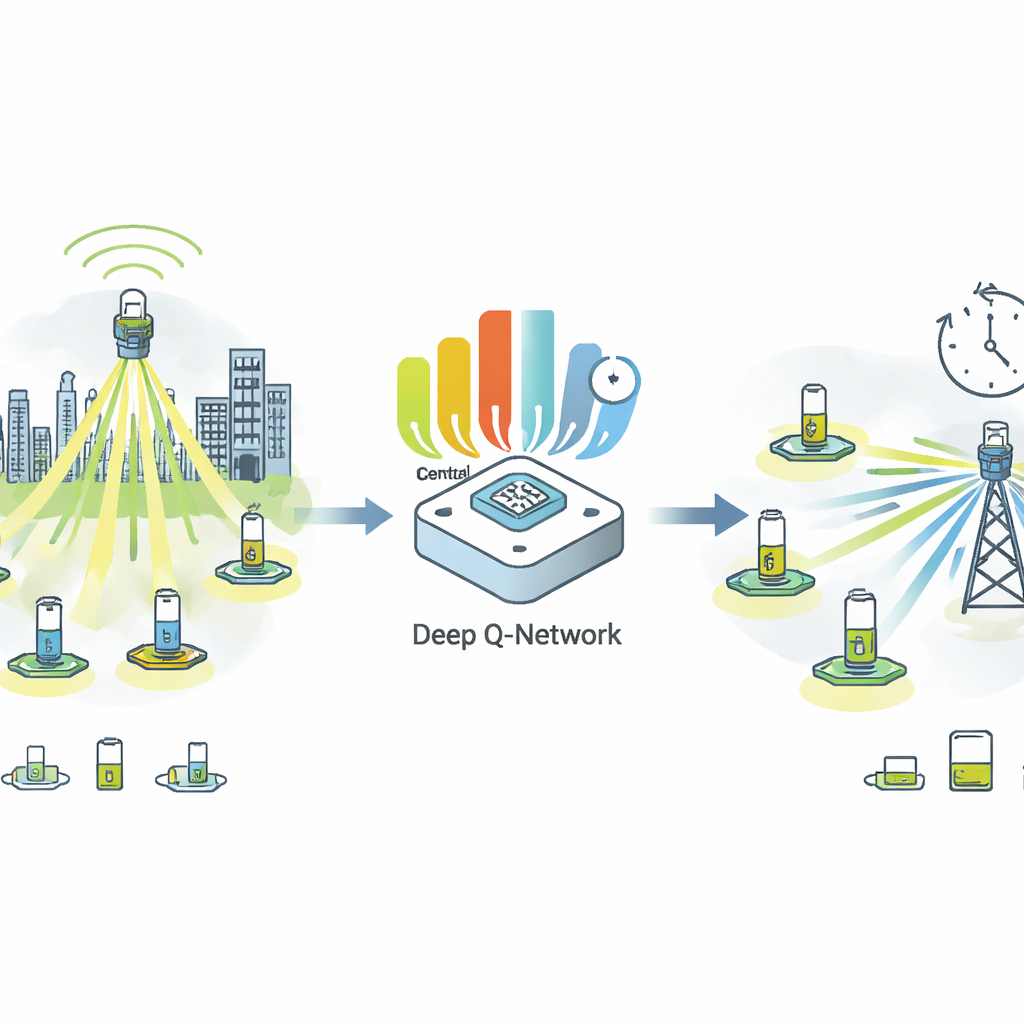

Um Cérebro Aprendente para a Rede de Energia

Para enfrentar isso, os autores projetam um controlador baseado em aprendizado construído sobre uma técnica chamada Deep Q-Networks, uma forma de aprendizado por reforço. Em vez de depender de fórmulas matemáticas fixas, esse controlador trata a rede como um jogo jogado ao longo do tempo. Em cada rodada, ele observa a energia restante em cada nó, a qualidade dos enlaces de rádio e quão urgente é cada tarefa — por exemplo, monitoramento de incêndio versus verificações de temperatura rotineiras. Com base nessas observações, decide quanta potência transmitir para cada nó. Após cada decisão, recebe um feedback que mistura vários objetivos: enviar a maior quantidade possível de dados úteis, compartilhar energia de forma justa para que nenhum dispositivo seja consistentemente negligenciado e evitar o uso desperdiçador da fonte de energia compartilhada. Ao longo de muitas rodadas, o controlador aprende quais padrões de compartilhamento de energia levam ao melhor desempenho de longo prazo.

Antecipando e Balanceando Objetivos Concorrentes

Um ingrediente chave na estrutura é a previsão. O sistema usa um método estatístico chamado Regressão por Processo Gaussiano para prever quanto de energia os nós provavelmente irão colher no futuro próximo, por exemplo conforme as condições de iluminação mudam. Também emprega um modelo flexível de como os sinais de rádio se atenuam e refletem em ambientes realistas semelhantes a cidades. Essas peças alimentam um processo de decisão que é atualizado a cada poucos segundos, permitindo que o controlador responda rapidamente quando as condições da rede mudam. O sinal de recompensa que guia o aprendizado combina três ideias simples: eficiência (quantos bits de informação são entregues por unidade de energia), justiça (quão uniformemente a energia é distribuída entre os nós) e prioridade (assegurar que tarefas de alta urgência recebam o que necessitam). Ajustando a importância relativa desses três componentes, operadores de rede podem optar entre máxima duração, justiça estrita ou taxas de dados de pico.

O Que as Simulações Revelam

Como experimentos no mundo real ainda estão em andamento, os autores avaliam seu método em simulações computacionais detalhadas de uma rede com 30 dispositivos alimentados sem fio, e também exploram cenários de até 100 nós. Em comparação com uma divisão fixa simples de energia e um método de aprendizado mais tradicional, o novo controlador mantém a rede funcionando por muito mais tempo — cerca de metade a mais de rodadas antes dos nós desligarem. Ele também mantém a variação dos níveis de energia entre dispositivos muito mais estreita, significando muito menos “pontos mortos” onde nós falham prematuramente. A estratégia aprendida se adapta várias vezes mais rápido a mudanças súbitas, como uma queda na qualidade do sinal ou um aumento na urgência das tarefas, e mantém maior vazão de dados em uma ampla gama de condições de rádio. Importante, os autores prestam atenção a detalhes práticos, mostrando que uma versão compacta do modelo de aprendizado pode rodar em microcontroladores de baixo custo usados em muitos dispositivos IoT, com tempos de decisão na ordem de dezenas de milissegundos.

Da Simulação a Redes Reais de Sensores

O estudo conclui que emparelhar energia sem fio com um controlador baseado em aprendizado pode estender significativamente a vida e a confiabilidade de redes de sensores, especialmente quando as condições são imprevisíveis e as tarefas diferem em urgência. Ao reconhecer que circuitos de colheita saturam, que o ambiente de rádio flutua e que alguns sensores importam mais que outros em determinado momento, a abordagem proposta aprende a equilibrar necessidades concorrentes melhor do que regras estáticas. Os autores deixam claro que seus resultados até agora vêm de simulações e que os ganhos exatos precisarão ser confirmados em hardware real. Ainda assim, o trabalho aponta para um futuro em que vastas redes de pequenos dispositivos podem operar por longos períodos com mínima intervenção humana, sugando energia do ar de forma inteligente enquanto mantêm o fluxo de dados vitais.

Citação: Chen, H., Wang, X., Yuan, L. et al. DQN-empowered energy optimization for wireless powered communication networks. Sci Rep 16, 7987 (2026). https://doi.org/10.1038/s41598-026-38904-x

Palavras-chave: energia sem fio, Internet das Coisas, colheita de energia, aprendizado por reforço, redes de sensores