Clear Sky Science · pt

VolE: Uma estrutura de nuvem de pontos para reconstrução 3D de alimentos e estimativa de volume

Por que medir seu jantar importa

Contar calorias a partir de uma foto parece mágica, mas para médicos e nutricionistas pode ser uma ferramenta poderosa. Saber com precisão quanto as pessoas realmente comem é vital para manejar doenças como diabetes e obesidade, contudo pesar cada refeição numa balança de cozinha é pouco realista no dia a dia. Este artigo apresenta o VolE, um novo método que permite a um smartphone moderno comum construir um modelo tridimensional detalhado de um único alimento e estimar seu volume com precisão surpreendentemente alta — sem hardware especial, cartão de referência ou sensor de profundidade.

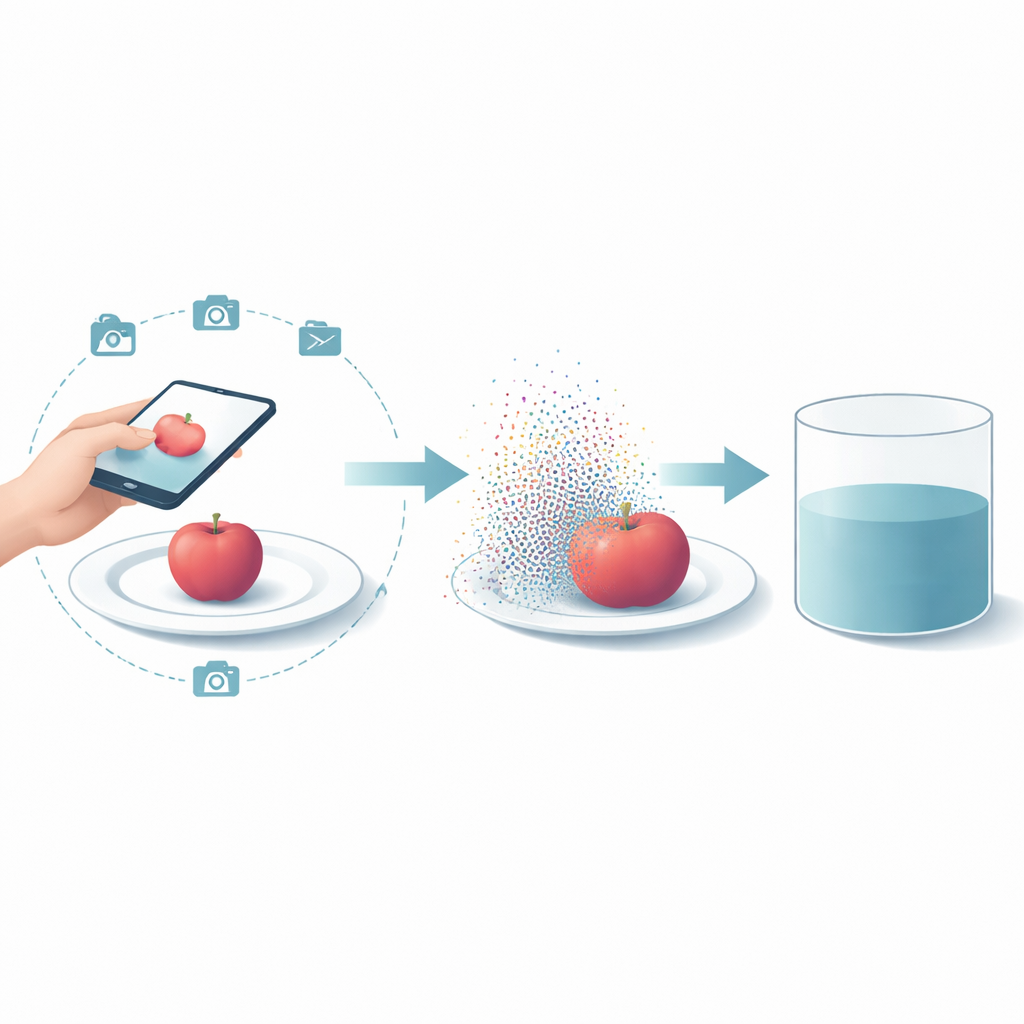

De fotos simples a formas sólidas

A ideia central do VolE é transformar um curto vídeo casual do seu prato em uma forma 3D precisa que possa ser medida. Conforme o usuário move o celular lentamente ao redor do alimento, os recursos integrados de realidade aumentada do dispositivo (ARCore no Android ou ARKit no iOS) registram tanto as imagens quanto a posição e orientação exatas da câmera no espaço real. O VolE combina esses fluxos de imagem e trajetórias da câmera para reconstruir uma densa “nuvem de pontos” do alimento — milhares de pequenos pontos flutuando no espaço que traçam a superfície do item. Como o sistema de AR do telefone já conhece distâncias do mundo real, esse objeto virtual é criado na escala física correta, resolvendo um problema antigo em pesquisa de visão computacional, em que a forma 3D pode ser recuperada, mas não seu tamanho verdadeiro.

Encontrando o alimento e limpando a cena

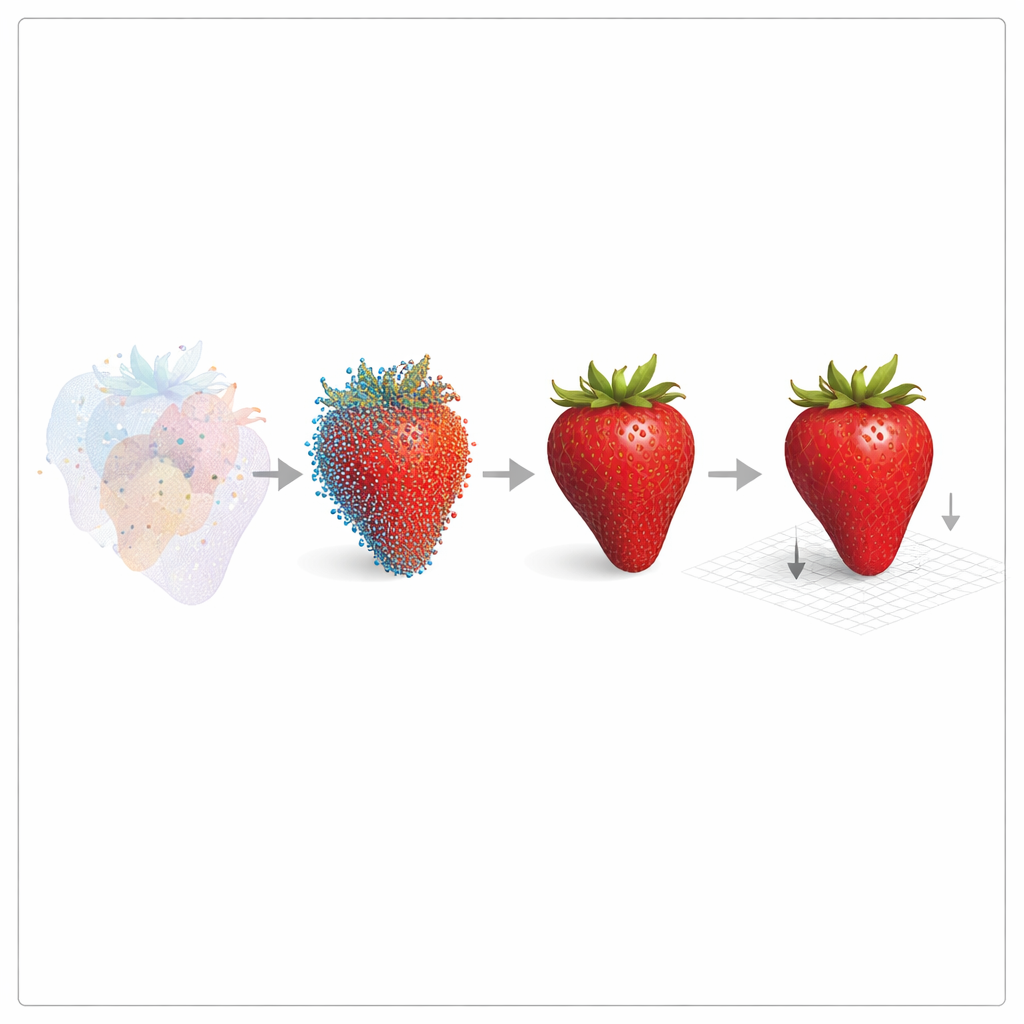

Fotos de comida são visualmente complexas: pratos, mesas e objetos ao fundo competem pela atenção. O VolE resolve isso com uma etapa automática de segmentação de vídeo que funciona como uma tesoura inteligente. Um modelo chamado FoodMem identifica quais pixels pertencem ao alimento em todos os quadros do vídeo, mesmo quando o telefone se move e o alimento fica parcialmente oculto. Usando as posições da câmera refinadas, o VolE projeta os pontos 3D em cada imagem segmentada e mantém apenas aqueles que caem consistentemente sobre o alimento em todas as vistas. O resultado é uma nuvem limpa e isolada de pontos pertencentes apenas ao item alvo, enquanto a maior parte dos pontos de fundo e erros de segmentação é filtrada.

De pontos a um objeto mensurável

Nuvens de pontos por si só são difíceis de medir, então o VolE as converte em uma superfície digital contínua chamada malha. Softwares 3D especializados unem pontos vizinhos em pequenos triângulos que envolvem o alimento como uma pele ajustada, preenchendo pequenas lacunas e tornando o objeto “à prova d’água”. A malha é então refinada por meio de etapas de suavização, denoising e otimização que removem saliências e buracos sem alterar o tamanho real de forma significativa. Finalmente, um truque matemático conhecido como teorema da divergência é usado: a superfície é dividida em muitas pequenas partes, cada uma tratada como uma minúscula pirâmide ancorada na origem. Somando os volumes assinados de todas essas peças obtém-se o volume total do alimento em centímetros cúbicos, pronto para ser convertido em peso e calorias via tabelas padrão de densidade.

Testes com alimentos reais e benchmarks desafiadores

Para avaliar o desempenho do VolE, os autores criaram um novo conjunto de dados chamado “Foodkit” com 21 alimentos reais — de maçãs e bananas a wraps e doces — capturados com 700–1200 imagens cada. Eles mediram o volume verdadeiro usando deslocamento de água e a massa com uma balança de laboratório, e então compararam esses números com as estimativas do VolE. Em todos os itens, o erro médio de volume foi de cerca de 1–2%, correspondente a aproximadamente 99% de precisão, e permaneceu estável em execuções repetidas apesar da aleatoriedade interna do software de reconstrução. O VolE também foi avaliado em conjuntos de dados públicos desafiadores usados em competições internacionais, superando ou igualando os melhores métodos existentes para estimativa de volume de alimentos, enquanto não exige placas de calibração, sensores de profundidade ou rigs de câmera fixos.

O que isso significa para a saúde cotidiana

Em termos simples, este trabalho mostra que um telefone que você já possui pode, com os algoritmos certos, medir sua comida quase tão bem quanto equipamentos de laboratório. Ao transformar vídeos casuais em modelos 3D precisos, o VolE elimina a necessidade de balanças, scanners especializados ou fotos cuidadosamente montadas com objetos de referência. Embora atualmente funcione melhor para um único item principal em um prato e ainda rode em um computador potente em vez de diretamente no celular, o método aponta para um futuro próximo em que aplicativos de acompanhamento alimentar poderão estimar tamanhos de porção automaticamente e de forma confiável. Isso pode tornar o monitoramento nutricional de longo prazo mais objetivo, menos oneroso e muito mais acessível a pessoas que gerenciam sua saúde no dia a dia.

Citação: Haroon, U., AlMughrabi, A., Zoumpekas, T. et al. VolE: A point-cloud framework for food 3D reconstruction and volume estimation. Sci Rep 16, 8648 (2026). https://doi.org/10.1038/s41598-026-38756-5

Palavras-chave: estimativa de volume de alimentos, reconstrução 3D, saúde móvel, realidade aumentada, avaliação dietética