Clear Sky Science · pt

Predição de carga de trabalho baseada em atenção e alocação dinâmica de recursos para ambientes de computação heterogêneos

Por que computadores mais inteligentes importam para todos

Por trás de cada filme que você transmite, mapa que abre ou assistente de IA com quem conversa, enormes armazéns de computadores trabalham silenciosamente 24 horas por dia. À medida que a inteligência artificial se torna mais poderosa, esses data centers são levados ao limite: precisam conciliar muitos tipos de tarefas em muitos tipos de máquinas, mantendo custos, velocidade e consumo de energia sob controle. Este artigo apresenta uma nova forma de prever o que esses computadores vão precisar no futuro próximo e de distribuir o trabalho entre diferentes tipos de hardware para que os serviços permaneçam rápidos e confiáveis, desperdiçando menos eletricidade.

Muitas tarefas, muitas máquinas

Data centers modernos não dependem mais de um único tipo de servidor. Em vez disso, combinam processadores tradicionais com chips gráficos potentes, placas especializadas em IA e circuitos reprogramáveis. Diferentes tarefas de IA — como treinar um grande modelo de linguagem, servir recomendações em tempo real ou analisar imagens — se adaptam de maneiras bem diferentes a essas máquinas. Hoje, os operadores frequentemente alocam recursos usando regras fixas ou previsões simples baseadas no uso de ontem. Quando a demanda dispara de repente, isso pode causar respostas lentas ou violação de acordos de serviço; quando a demanda cai, hardware caro pode ficar ocioso, consumindo energia sem realizar muito trabalho.

Aprender a olhar onde importa

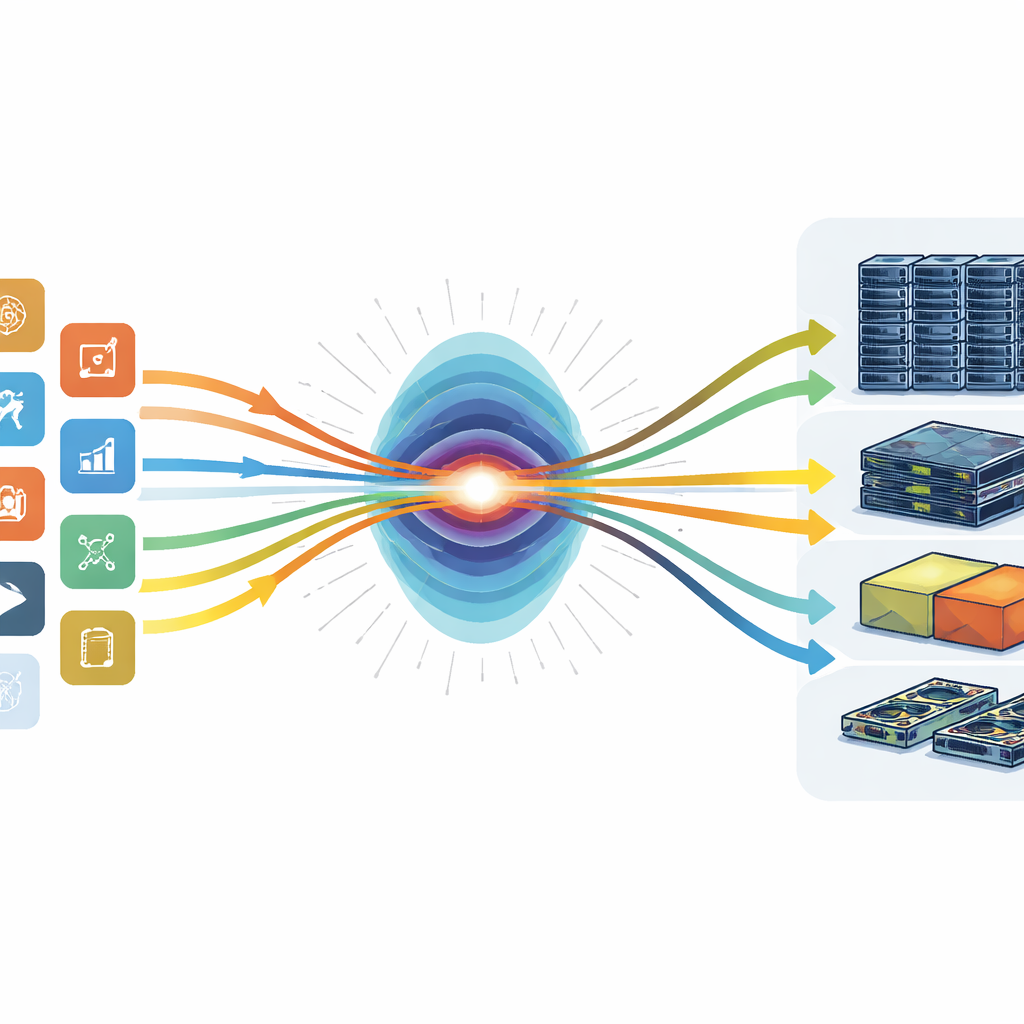

Os autores emprestam um conceito de modelos de IA de ponta chamado “atenção” e o aplicam ao gerenciamento de data centers. Em vez de tratar todos os dados de uso passados da mesma forma, o sistema aprende quais momentos no tempo e quais tipos de tarefa são mais úteis para prever o que acontecerá a seguir. Uma parte do modelo foca em como cada carga de trabalho — como um trabalho de treinamento ou um serviço online — muda ao longo do tempo. Outra parte olha lateralmente através das diferentes cargas que rodam ao mesmo tempo para descobrir conexões ocultas, como um padrão em que a conclusão de um lote de trabalhos de treinamento costuma levar a um aumento em consultas online relacionadas. Ao sobrepor essas duas visões, o sistema pode prever demandas futuras por processadores, memória e aceleradores com mais precisão do que métodos anteriores.

Transformando previsões em decisões melhores

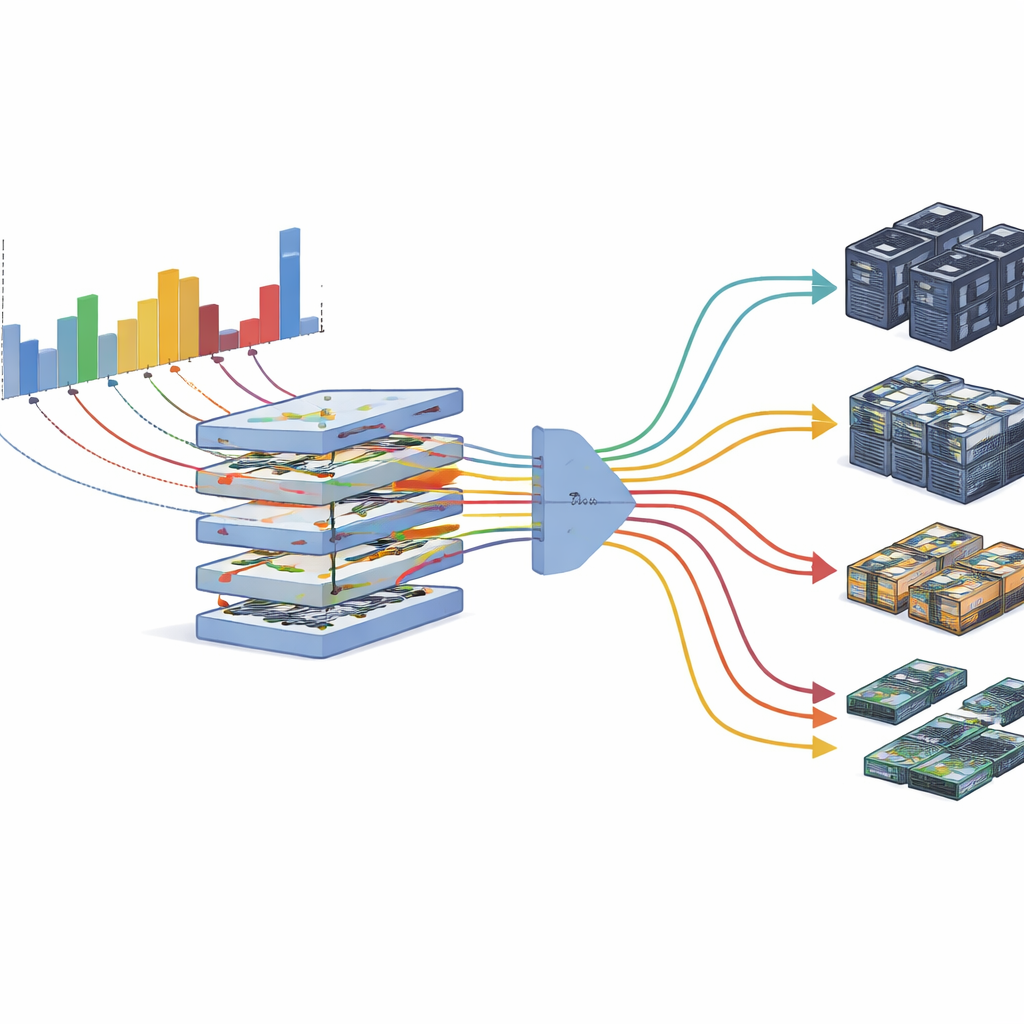

Só prever não basta; o data center precisa agir com base nisso. A segunda metade da estrutura transforma essas previsões em decisões concretas sobre onde executar cada tarefa. Os autores tratam isso como um ato de equilíbrio entre três objetivos: terminar os trabalhos rapidamente, usar o mínimo de energia possível e manter as máquinas ocupadas em vez de ociosas. O escalonador representa o data center como uma rede de dispositivos diferentes e usa um procedimento de otimização para escolher colocações que negociam esses objetivos conforme as preferências do operador. Como previsões nunca são perfeitas, o sistema também estima sua própria incerteza e deixa margens de segurança quando necessário, monitorando a realidade em tempo real para ajustar pausando trabalhos de baixa prioridade ou movendo tarefas quando o uso se afasta das expectativas.

Colocando o sistema à prova

Para ver como essa abordagem funciona na prática, os pesquisadores construíram um cluster de teste com uma mistura realista de processadores, GPUs e hardware especializado em IA, e alimentaram-no com registros detalhados de atividade de data centers do mundo real do Google, Alibaba e de um laboratório acadêmico. Eles compararam seu método com ferramentas de previsão e estratégias de escalonamento populares, incluindo técnicas usadas em sistemas de produção e controladores baseados em aprendizado por reforço. O preditor baseado em atenção fez previsões consistentemente mais precisas, especialmente para os picos bruscos que frequentemente ocorrem em cargas de IA. Quando combinado com seu alocador dinâmico, o sistema elevou o uso geral de hardware para cerca de quatro quintos da capacidade, reduziu o tempo médio de conclusão de tarefas em aproximadamente um quarto e diminuiu o consumo de energia em cerca de 15%, tudo isso mantendo violações de serviço em um nível muito baixo.

O que isso significa para usuários comuns

Para não especialistas, a conclusão principal é que uma coordenação mais inteligente dentro dos data centers pode tornar os serviços de IA mais rápidos, baratos e sustentáveis sem exigir novos chips ou prédios. Ao aprender onde “prestar atenção” no fluxo de dados de uso, essa estrutura ajuda o hardware existente a realizar mais trabalho útil e ficar ocioso com menos frequência. Isso significa que empresas podem entregar apps mais responsivos e ferramentas de IA mais potentes enquanto contêm contas de eletricidade e pegadas de carbono. À medida que sistemas semelhantes de predição e alocação se espalhem e amadureçam, a maquinaria invisível da internet pode se tornar não apenas mais capaz, mas também mais sustentável.

Citação: Shao, S., Ding, X., Zhao, B. et al. Attention-based workload prediction and dynamic resource allocation for heterogeneous computing environments. Sci Rep 16, 8571 (2026). https://doi.org/10.1038/s41598-026-38622-4

Palavras-chave: agendamento de data center, predição de carga de trabalho de IA, computação heterogênea, computação energeticamente eficiente, alocação de recursos