Clear Sky Science · pt

Auditoria de privacidade mais rigorosa do gradiente estocástico diferencialmente privado no modelo de ameaça de estado oculto

Por que isso importa para a tecnologia do dia a dia

Aplicativos modernos aprendem constantemente com nossos dados, desde fotos e mensagens até prontuários médicos. Uma maneira líder de manter esse treinamento seguro é chamada privacidade diferencial, que adiciona ruído calibrado para que os dados de uma única pessoa não se destaquem. Mas como sabemos se essas proteções realmente funcionam na prática, especialmente para as redes neurais profundas usadas hoje? Este artigo investiga essa questão e mostra quando esconder o “filme do treinamento” de um modelo realmente ajuda na privacidade — e quando não ajuda.

Como o aprendizado privado deveria funcionar

O gradiente estocástico diferencialmente privado (DP-SGD) é o algoritmo central para aprendizado de máquina com preservação de privacidade. Ele treina modelos passo a passo em pequenos lotes de dados, recortando o gradiente de cada passo (a direção de melhoria) e adicionando ruído aleatório antes de atualizar o modelo. A teoria fornece limites superiores sobre o quanto os dados de qualquer pessoa podem influenciar o modelo final, resumidos por um número de privacidade frequentemente chamado de épsilon. Em paralelo, a “auditoria de privacidade” tenta atacar o modelo treinado e ver quanta informação pode realmente ser extraída na prática. Se teoria e auditoria coincidirem, podemos confiar na contabilidade de privacidade; se não coincidirem, algo importante está sendo negligenciado.

O que muda quando apenas o modelo final é revelado

A maioria das auditorias anteriores assumia um adversário poderoso que pode ver todos os pontos de verificação intermediários do modelo durante o treinamento. Na prática, muitas organizações liberam apenas o modelo final, não o histórico completo de treinamento. Esse cenário mais realista é chamado de modelo de ameaça de estado oculto. Trabalhos teóricos recentes sugeriram que, pelo menos para problemas convexos simples, esconder modelos intermediários pode amplificar a privacidade ao longo do tempo: dados usados no início do treinamento seriam “lavados” por atualizações ruidosas posteriores. Entretanto, o aprendizado profundo moderno depende de modelos altamente não convexos, onde a superfície de perda é acidentada e complexa. Não estava claro se a mesma amplificação realmente ocorreria aí — ou se os ataques existentes eram simplesmente fracos demais para expor a perda de privacidade completa.

Uma nova maneira do adversário empurrar o modelo

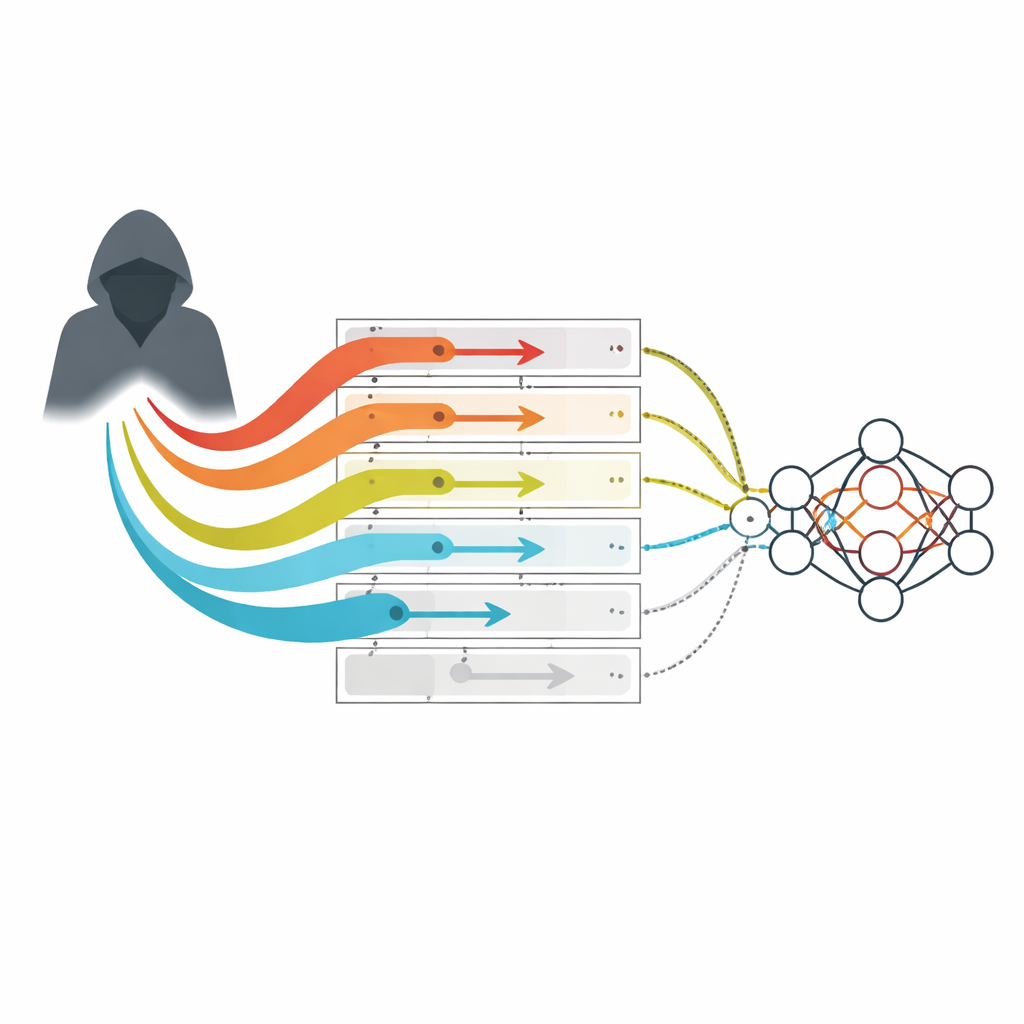

O autor introduz uma nova família de adversários de “fabricação de gradientes” adaptada ao modelo de estado oculto. Em vez de tentar desenhar um ponto de dado especial e então observar como sua perda muda durante o treinamento (como nos ataques tradicionais baseados em perda), esses adversários prescrevem diretamente a sequência de gradientes que seriam aplicados se um ponto de dado de pior caso estivesse presente. Eles escolhem gradientes que sempre atingem o limite de recorte e se alinham com direções de parâmetros raramente usadas, tornando sua influência mais fácil de detectar mesmo sem ver modelos intermediários. Duas variantes simples são estudadas: uma que escolhe aleatoriamente uma direção de parâmetro, e outra que simula o processo de treinamento para encontrar a direção menos atualizada antes de injetar gradientes fortes e repetidos ao longo dela.

O que os experimentos revelam sobre o risco real à privacidade

Usando esse arcabouço, o artigo audita o DP-SGD em conjuntos de dados de imagens e tabulares com arquiteturas comuns, como redes convolucionais e residuais, bem como um pequeno modelo totalmente conectado. Quando o gradiente fabricado é usado em cada passo de treinamento, os novos adversários correspondem aos limites teóricos estritos de privacidade — embora só vejam o modelo final. Isso significa que, nesse caso extremo, esconder pontos de verificação intermediários não fornece nenhuma privacidade extra. Quando o gradiente fabricado é inserido com menos frequência, o quadro muda: para lotes grandes em relação ao nível de ruído, as auditorias permanecem próximas à teoria (novamente sugerindo pouca amplificação real), mas para lotes menores e ruído mais alto, surge uma lacuna que aponta para uma amplificação de privacidade genuína, embora modesta, em cenários não convexos.

Espiando o limite do pior caso

Para entender os limites absolutos da privacidade no modelo de estado oculto, o artigo também estuda um adversário teórico mais extremo que não apenas fabrica gradientes, mas também projeta toda uma paisagem de perda para manter a influência de um ponto de dado especial viva ao longo das iterações. Nesse cenário controlado, os resultados separam de forma clara dois regimes: com tamanhos de lote grandes, a contabilidade de privacidade baseada na teoria padrão é essencialmente apertada, mas com lotes pequenos e ruído substancial, a informação inicial sobre um ponto de dado é em parte esquecida ao longo do tempo. Crucialmente, essa amplificação é mais fraca do que a conhecida para problemas convexos simples e nunca apaga completamente o risco à privacidade.

O que isso significa para usuários e praticantes

Para não especialistas, a conclusão é que simplesmente ocultar o histórico de treinamento de um modelo de aprendizado profundo não garante magicamente uma privacidade muito mais forte. Quando os dados de uma pessoa são usados com muita frequência durante o treinamento, seu risco é próximo ao que a teoria conservadora de hoje já prevê. Alguma proteção extra surge em regimes mais favoráveis — lotes pequenos com ruído significativo —, mas é modesta e não reduz o risco a zero. Essas descobertas tanto validam partes da contabilidade de privacidade existente quanto destacam seus limites, oferecendo uma visão mais clara e realista de quanto proteção o DP-SGD pode fornecer quando apenas o modelo final é compartilhado.

Citação: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

Palavras-chave: privacidade diferencial, DP-SGD, auditoria de privacidade, segurança em aprendizado de máquina, modelo de estado oculto