Clear Sky Science · pt

Uma rede YOLOv11 aprimorada para detecção de detritos marinhos em ambiente subaquático

Por que localizar lixo subaquático importa

Bem abaixo da superfície do oceano, sacolas plásticas, garrafas, linhas de pesca e outros detritos se acumulam silenciosamente. Esse lixo prejudica a vida marinha, obstrui habitats sensíveis e pode até interferir com robôs subaquáticos que cientistas usam para estudar e proteger o mar. O artigo resumido aqui descreve um sistema de visão computacional mais inteligente que ajuda câmeras e robôs a localizar e rotular automaticamente lixo subaquático em tempo real, mesmo em águas turvas e lotadas de ruído visual.

O desafio de ver com clareza sob o mar

Diferentemente de fotos claras em terra, imagens subaquáticas costumam ser escuras, nebulosas e tingidas de azul ou verde. A luz se atenua rapidamente com a profundidade, areia e plâncton turvam a água, e os resíduos frequentemente são pequenos, parcialmente ocultos ou se parecem com pedras e plantas. Métodos tradicionais de processamento de imagem têm dificuldades nessas condições, e até detectores modernos de aprendizado profundo podem perder objetos minúsculos ou confundir texturas de fundo com detritos. Ainda assim, detecção precisa e rápida é crucial para mapear a poluição, orientar robôs de limpeza e acompanhar como o lixo marinho muda ao longo do tempo.

Baseando-se em um cavalo de batalha rápido da visão

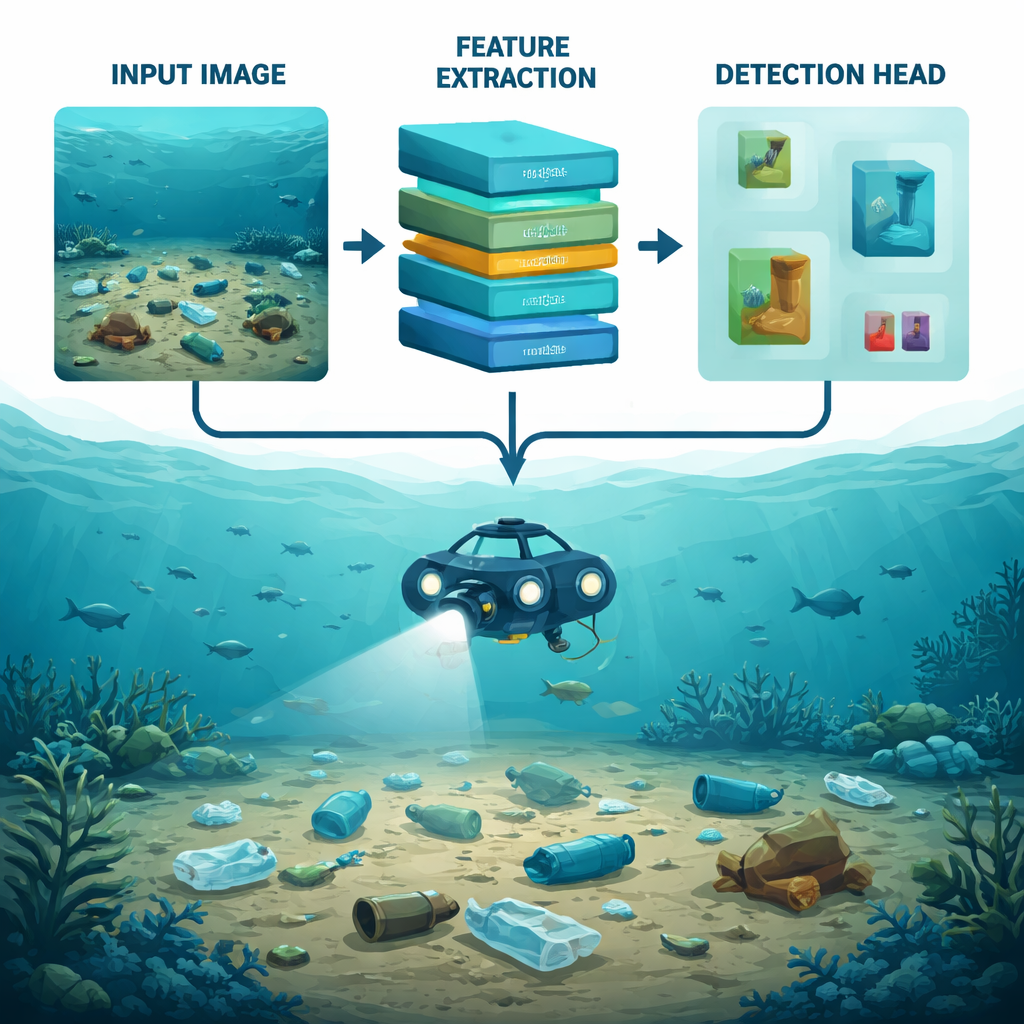

Os autores partem do YOLOv11, um membro recente da família “You Only Look Once” de detectores de objetos. Modelos YOLO são populares porque varrem a imagem uma única vez e prevêem as localizações e tipos de múltiplos objetos em tempo real. Contudo, o desenho padrão do YOLOv11 foi criado para cenas mais típicas, como ruas ou fotos internas, não para o mundo visualmente hostil subaquático. Para fechar essa lacuna, os pesquisadores redesenham duas partes-chave da rede: como ela inicialmente extrai padrões visuais da imagem e como, mais tarde, decide quais partes são objetos de lixo importantes e quais são apenas ruído de fundo.

Uma nova forma de captar detalhes em várias escalas

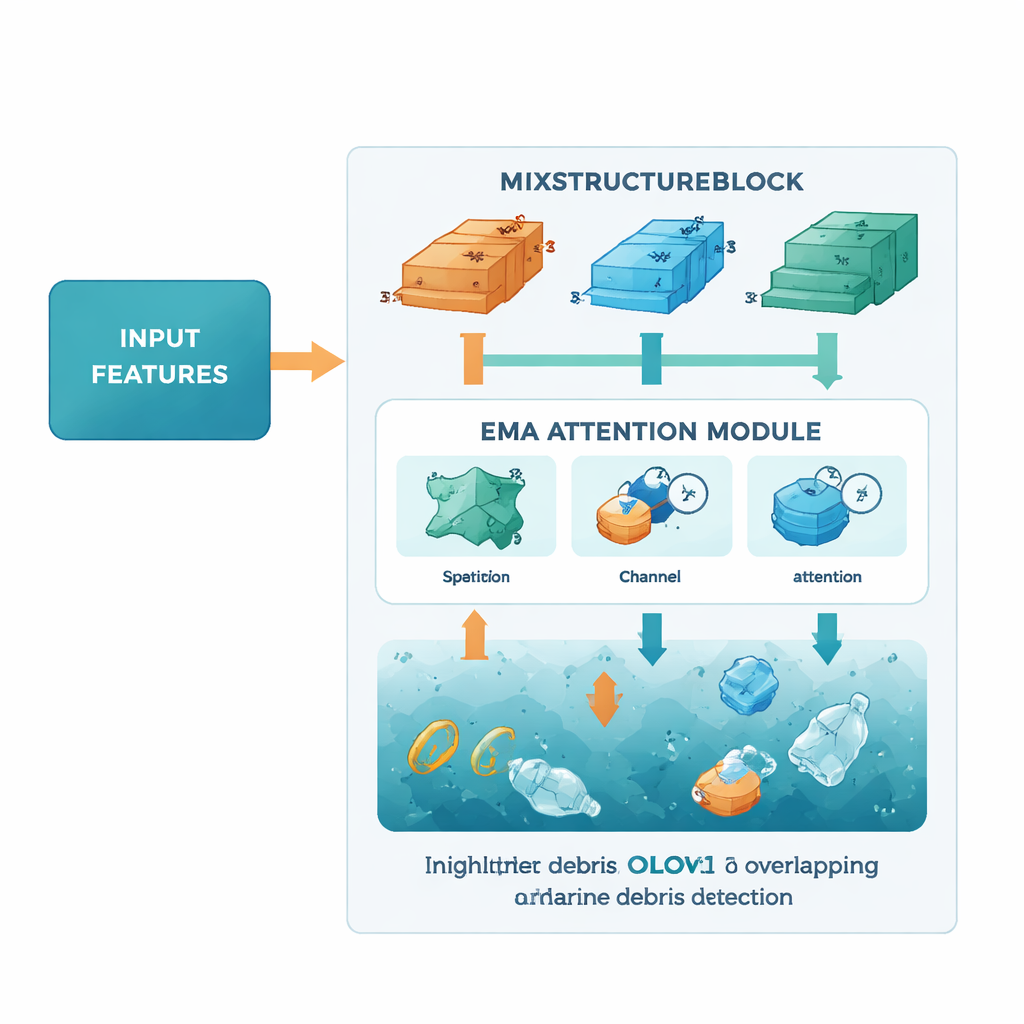

A primeira melhoria é um módulo chamado MixStructureBlock, que substitui um bloco padrão na espinha dorsal do YOLOv11. Em vez de usar um padrão fixo de filtros, o MixStructureBlock executa várias ramificações em paralelo que observam a cena com diferentes “tamanhos de janela” e espaçamentos. Isso ajuda a rede a perceber tanto detalhes finos, como a borda de uma tampa de garrafa, quanto formas maiores, como uma sacola à deriva. Além disso, o bloco inclui mecanismos de atenção simples que aprendem a enfatizar cores e locais informativos enquanto reduzem a importância de trechos de fundo pouco úteis. O resultado é um conjunto de características mais rico e mais limpo, que torna pedaços pequenos e tênues de detritos mais fáceis de detectar.

Ensinando a rede onde focar

A segunda atualização é um módulo Efficient Multi-scale Attention (EMA), adicionado mais adiante na rede, onde as detecções são feitas. O EMA examina os mapas de características tanto no espaço quanto nos canais, fazendo efetivamente duas perguntas ao mesmo tempo: “Onde na imagem algo importante está acontecendo?” e “Quais tipos de padrões são mais relevantes agora?” Ao agregar informação em múltiplas escalas e usar operações matemáticas leves, o EMA aguça o foco da rede em regiões prováveis de conter lixo—como objetos sobrepostos ou itens apagados distantes da câmera—enquanto mantém o modelo compacto e rápido o suficiente para uso em tempo real em hardware embarcado.

Submetendo o sistema ao teste

Para avaliar o projeto, a equipe treinou e testou o modelo no TrashCan, uma grande coleção pública de imagens de águas profundas montada no Japão. Uma versão do conjunto rotula detritos por tipo específico de objeto (como copo, sacola ou cano de metal), enquanto outra agrupa itens por material (como plástico ou tecido). Em ambas as versões, a rede aprimorada supera várias linhas de base fortes, incluindo o YOLOv11 original, sistemas anteriores de detecção de detritos marinhos e outras variantes do YOLO focadas no ambiente subaquático. Ela não apenas detecta mais detritos corretamente, especialmente itens pequenos e em aglomeração, como também o faz com um tamanho de modelo notavelmente pequeno — cerca de 5 megabytes — bem adequado para veículos subaquáticos com energia limitada.

O que isso significa para oceanos mais limpos

Em termos simples, o estudo mostra que repensar cuidadosamente como uma IA “vê” imagens subaquáticas pode fazer diferença real na detecção de lixo sob as ondas. Ao combinar extração de padrões em múltiplas escalas com atenção inteligente às regiões importantes, o sistema proposto identifica mais detritos mantendo eficiência suficiente para uso em tempo real. Implantado em sistemas de câmera e robôs subaquáticos, tal tecnologia pode ajudar cientistas e agências ambientais a mapear pontos críticos de poluição, orientar esforços de limpeza e monitorar se políticas para reduzir o lixo marinho estão funcionando—aproximando-nos de oceanos mais saudáveis.

Citação: Yuanwei, J., Yijiang, D., Xuemei, W. et al. An improved YOLOv11 network for marine debris detection in underwater environment. Sci Rep 16, 7074 (2026). https://doi.org/10.1038/s41598-026-38305-0

Palavras-chave: detecção de detritos marinhos, robótica subaquática, detecção de objetos, aprendizado profundo, poluição oceânica