Clear Sky Science · pt

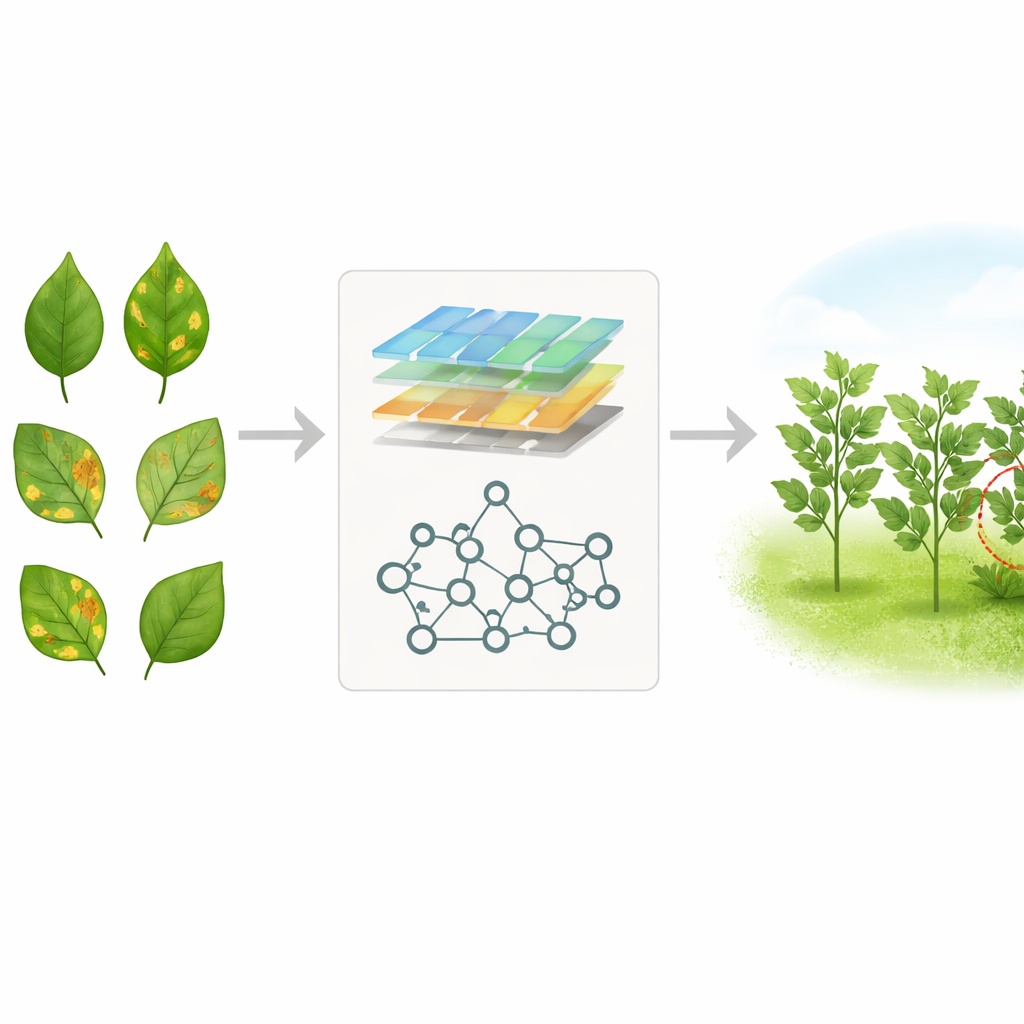

Uma estrutura híbrida de aprendizado profundo usando modelos convolucionais e transformadores para classificação robusta de doenças em plantas

Por que identificar plantas doentes é importante

Doenças de plantas destroem silenciosamente uma grande parcela da produção de alimentos do mundo a cada ano, reduzindo rendimentos, afetando a renda dos agricultores e ameaçando a segurança alimentar. Detectar essas doenças precocemente é difícil: os campos são grandes, há poucos especialistas fitossanitários e muitos sintomas são sutis. Este artigo explora como um novo tipo de inteligência artificial pode aprender a reconhecer dezenas de doenças foliares a partir de fotos simples, oferecendo um caminho para ferramentas em smartphones ou câmeras de campo que ajudam os agricultores a agir antes que os problemas se espalhem.

Do juízo humano aos olhos digitais

O diagnóstico tradicional baseia‑se na inspeção visual das folhas por pessoas e, às vezes, no envio de amostras para laboratório. Esse processo é lento, subjetivo e frequentemente indisponível em regiões rurais. Na última década, pesquisadores treinaram programas de computador para interpretar imagens de folhas. Sistemas anteriores exigiam que engenheiros projetassem manualmente características visuais, ou usavam modelos de aprendizado profundo chamados redes neurais convolucionais, que se destacam em capturar texturas, cores e contornos. Esses métodos melhoraram a precisão, mas ainda enfrentavam dificuldades quando os sinais da doença eram fracos, distribuídos pela folha ou parecidos entre diferentes enfermidades. O novo estudo pergunta se combinar duas abordagens modernas de IA pode fornecer respostas mais confiáveis nesses casos desafiadores.

Combinando duas formas de ver

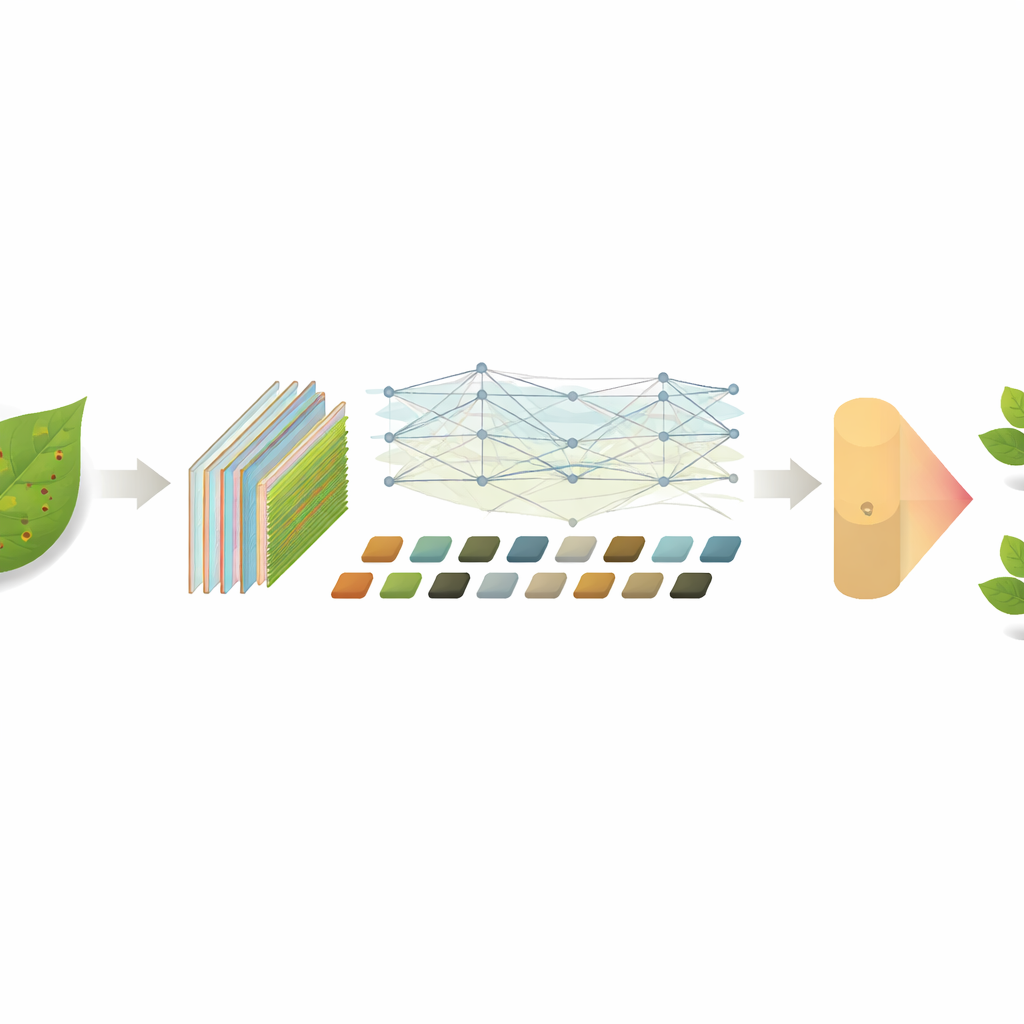

Os autores constroem um sistema híbrido que funde uma rede convolucional com um modelo de imagem mais recente conhecido como vision transformer. A primeira parte, EfficientNet‑B7, atua como uma lupa, vasculhando fotos de folhas em busca de detalhes finos, como pequenas manchas, nervuras e alterações de cor. Sua saída é então remodelada e passada a um transformador (ViT‑B16), projetado para perceber como diferentes regiões da imagem se relacionam entre si em longas distâncias. Ao transformar as características detalhadas em uma série de pequenos patches e permitir que o transformador avalie como cada patch interage com todos os outros, o sistema consegue entender tanto as lesões locais quanto o padrão geral na superfície da folha. Essa combinação busca imitar a forma como um agrônomo experiente observa de perto uma lesão ao mesmo tempo em que considera sua posição e entorno.

Ensinando o sistema com milhares de folhas

Para treinar e testar o modelo, os pesquisadores usaram uma grande coleção pública de 21.534 imagens mostrando 38 condições diferentes, incluindo várias doenças e folhas saudáveis de culturas como maçã, tomate, videira e milho. Eles padronizaram as fotos para um tamanho comum e aplicaram truques digitais — como rotações, reflexões e zoom — para simular as condições desordenadas dos campos reais. O modelo primeiro aprende padrões visuais gerais a partir de dados de imagem existentes e, em seguida, é refinado nessa coleção de plantas. Durante o treinamento, a equipe acompanha não apenas a acurácia geral, mas também com que frequência o sistema identifica corretamente cada doença e quão bem evita alarmes falsos, garantindo que o desempenho se mantenha tanto nas classes comuns quanto nas mais raras.

Desempenho da abordagem híbrida

Ao ser avaliado em imagens inéditas, o modelo híbrido classifica corretamente a saúde e as doenças das plantas em 98,13% dos casos, mantendo pontuações altas em medidas rigorosas de precisão, recall e equilíbrio entre ambas. Ele lida tanto com folhas saudáveis quanto com doenças difíceis, embora sintomas muito iniciais continuem sendo mais desafiadores. Os autores comparam seu sistema com uma variedade de alternativas populares, incluindo redes convolucionais independentes, modelos puramente transformadores, redes móveis leves, detectores rápidos como YOLO e ferramentas clássicas como máquinas de vetor de suporte e florestas aleatórias. Nesses testes diretos, o híbrido consistentemente se destaca, superando até concorrentes fortes que usam apenas EfficientNet ou ensembles de múltiplas redes.

O que isso significa para fazendas e alimentação

Na prática, o estudo mostra que combinar duas “visões” complementares de uma imagem — detalhes locais nítidos e contexto amplo — pode melhorar significantemente a detecção automática de doenças em plantas. Embora o sistema atual ainda espere fotos relativamente claras e funcione melhor em máquinas com processadores gráficos, as mesmas ideias de projeto podem ser adaptadas para versões mais leves para smartphones, drones ou dispositivos de campo de baixo custo. À medida que essas ferramentas amadurecem, elas podem oferecer aos agricultores orientações rápidas e no local sobre o que está atacando suas culturas e onde, apoiando tratamentos mais precoces, redução do uso de químicos e colheitas mais estáveis. Para leitores em geral, a mensagem principal é que câmeras e algoritmos mais inteligentes estão se tornando aliados poderosos na proteção do abastecimento alimentar mundial.

Citação: Jawed, M.M., Tufail, F.A., Ahmed, M.Z. et al. A hybrid deep learning framework using convolutional and transformer models for robust plant disease classification. Sci Rep 16, 9704 (2026). https://doi.org/10.1038/s41598-026-38209-z

Palavras-chave: detecção de doenças em plantas, aprendizado profundo, vision transformer, agricultura de precisão, classificação de imagens