Clear Sky Science · pt

Redes neurais quânticas recorrentes diagonais com abordagem estável para identificação de sistemas não lineares

Ensinando Máquinas a Entender Sistemas Complicados

Muitos dos sistemas que moldam nossas vidas — dos motores elétricos em eletrodomésticos ao fluxo turbulento de ar e até alguns processos médicos — se comportam de maneira complexa e não linear. Isso significa que pequenas variações nas entradas podem produzir respostas surpreendentemente grandes ou caóticas. Prever e controlar tais sistemas é difícil, mas essencial para eficiência, segurança e economia de energia. Este artigo apresenta um novo tipo de máquina de aprendizado que combina ideias da computação quântica, redes neurais e teoria de estabilidade para modelar esses comportamentos difíceis de forma mais precisa e confiável.

Por que Modelos Convencionais Não Dão Conta

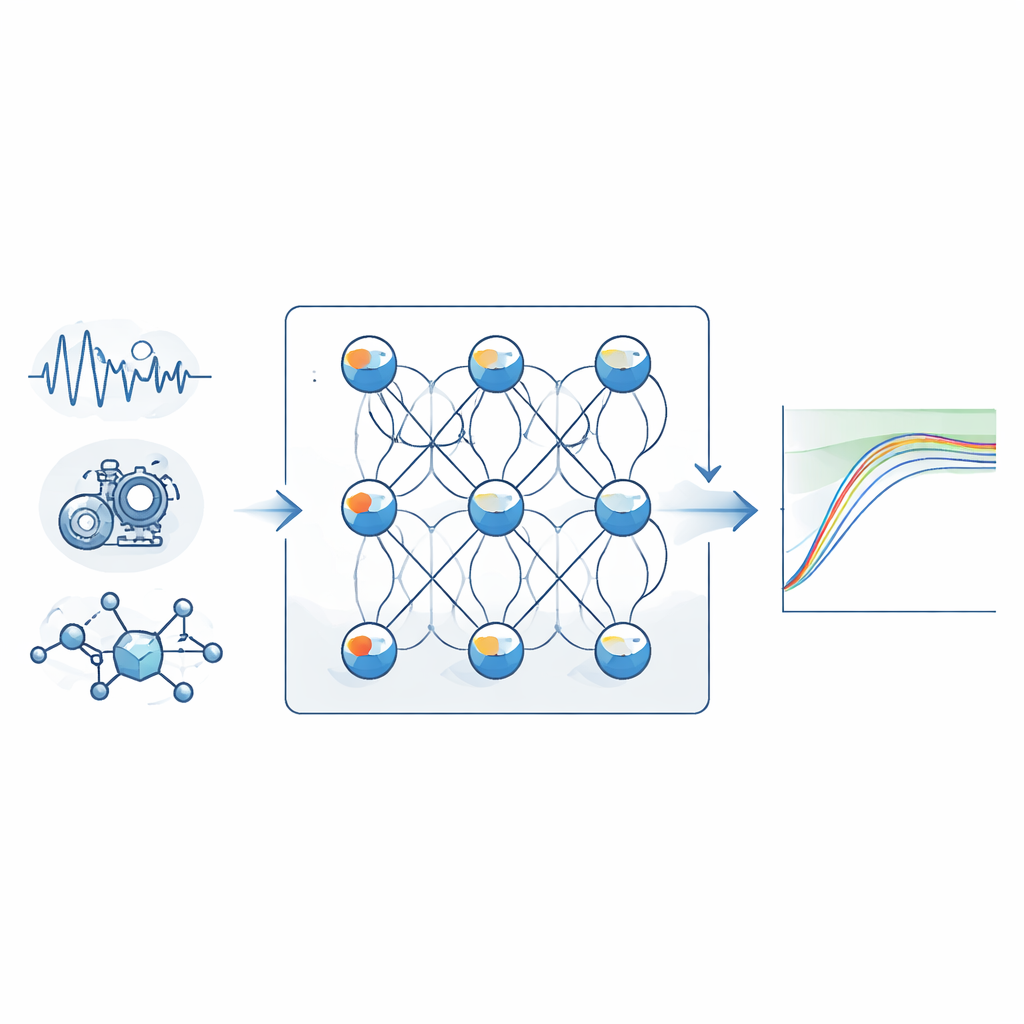

Ferramentas de modelagem tradicionais frequentemente assumem que causa e efeito são organizados e proporcionais, o que funciona bem para sistemas simples ou quase lineares. Mas muitos sistemas reais têm memória, realimentação e limiares que tornam seu comportamento altamente não linear. Redes neurais clássicas ajudaram, porém trazem seus próprios problemas. Redes feed-forward, onde a informação flui em apenas uma direção, são boas para tarefas estáticas, mas têm dificuldade quando sinais passados importam. Redes recorrentes, que realimentam informação para criar memória, conseguem capturar comportamento dependente do tempo, mas costumam ser difíceis de treinar, propensas à instabilidade e computacionalmente pesadas quando cada neurônio se conecta a todos os outros.

Misturando Ideias Quânticas com Loops Simples

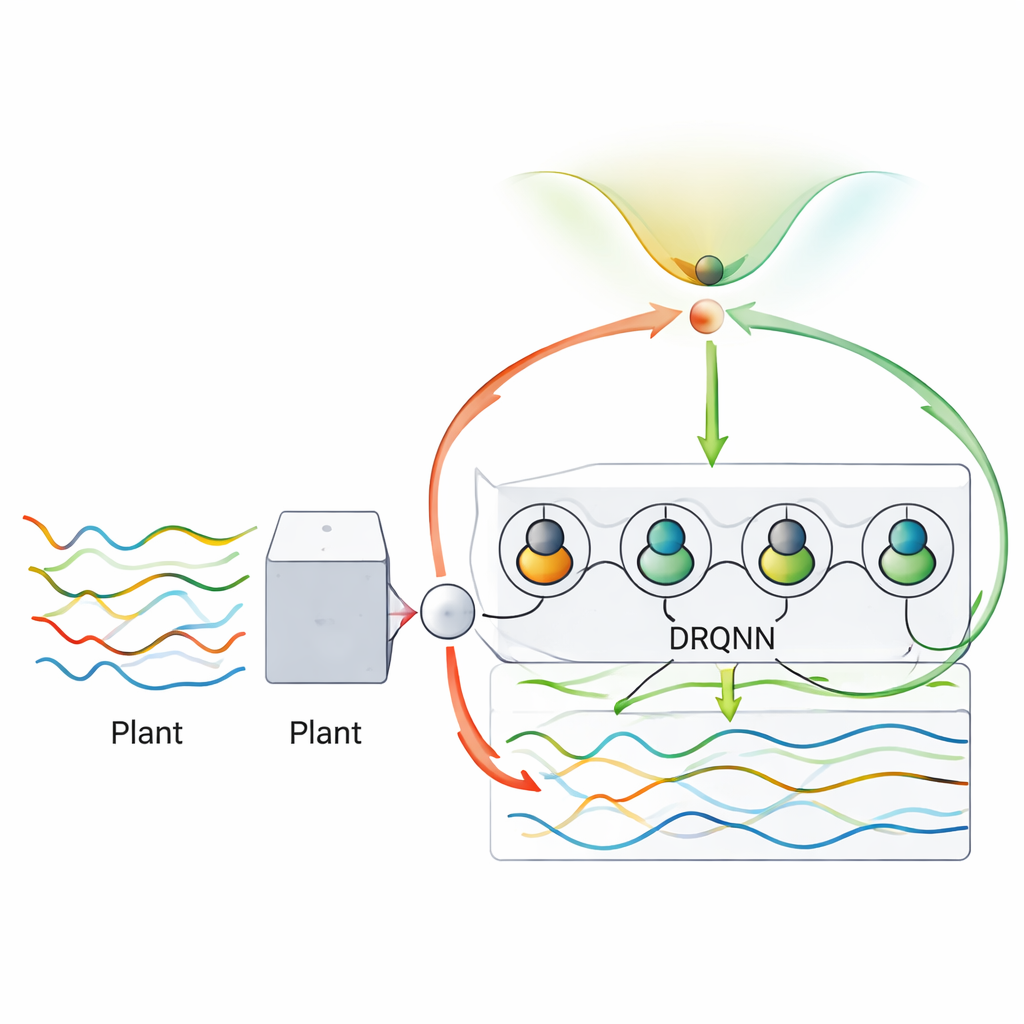

Os autores propõem uma rede neural recorrente diagonal inspirada em qubits com estabilidade de Lyapunov, abreviada DRQNN-LS. Em sua essência, essa rede ainda se parece com uma clássica rede de três camadas: entradas, uma camada oculta e uma saída. Mas dois detalhes a tornam especial. Primeiro, as unidades ocultas se comportam como bits quânticos simplificados, cujos estados internos são descritos usando quantidades semelhantes a fases em vez de números comuns. Essa representação inspirada em quântica permite que cada unidade codifique informação mais rica de forma compacta, melhorando a capacidade da rede de aproximar relações complexas. Segundo, em vez de um emaranhado de conexões de realimentação, cada neurônio oculto só se retroalimenta. Essa recorrência “diagonal” preserva a memória necessária para acompanhar padrões temporais reduzindo drasticamente o número de conexões que precisam ser ajustadas.

Manter o Aprendizado Estável e Sob Controle

Um desafio importante no treinamento de qualquer rede recorrente é manter o aprendizado estável: se os pesos mudam com muita agressividade, a saída do modelo pode explodir ou oscilar; se mudam muito lentamente, o treinamento leva uma eternidade e pode ficar preso. Aqui os autores se apoiam na teoria de estabilidade de Lyapunov, uma estrutura matemática desenvolvida originalmente para analisar a segurança de sistemas físicos. Eles constroem uma função especial parecida com energia que combina o erro de modelagem e o tamanho dos parâmetros da rede. Ao derivar cuidadosamente como essa função evolui no tempo, obtêm regras automáticas para atualizar os pesos e parâmetros internos da rede de modo que a “energia” total só possa diminuir. Isso produz taxas de aprendizado adaptativas que aceleram ou desaceleram por conta própria, garantindo convergência sem ajuste manual.

Testando a Nova Rede

Para mostrar que a DRQNN-LS é mais do que uma boa ideia no papel, os autores a testam em três tarefas bem diferentes. Primeiro, modelam um sistema não linear matemático com comportamento conhecido, verificando quão bem a rede consegue acompanhar sua saída. Em segundo lugar, enfrentam o mapa de Henon caótico, um teste clássico onde pequenas mudanças nas condições iniciais podem gerar trajetórias totalmente distintas. Terceiro, aplicam o método a dados reais de um pequeno motor de corrente contínua, um dispositivo prático e ruidoso cujo funcionamento interno não é totalmente conhecido. Em cada caso, comparam a nova abordagem com vários modelos neurais existentes, incluindo redes recorrentes diagonais clássicas e versões anteriores inspiradas em quântica treinadas com regras de gradiente mais simples.

Melhor Precisão, Robustez e Tolerância ao Ruído

Nos três exemplos, a DRQNN-LS produz consistentemente erros de previsão menores e melhor ajuste aos sinais reais do que os métodos concorrentes, mesmo quando os dados são deliberadamente corrompidos com ruído substancial. Embora o novo modelo exija um pouco mais de computação por passo — porque acompanha estados recorrentes inspirados em quântica e avalia a atualização baseada em Lyapunov — os tempos de execução permanecem pequenos o suficiente para uso em tempo real em processadores modernos. Os resultados sugerem que combinar uma estrutura recorrente simplificada, estados de neurônios ao estilo quântico e aprendizado matematicamente garantido e estável gera uma ferramenta poderosa e prática para entender e prever dinâmicas não lineares no mundo real.

O Que Isso Significa para o Futuro

Para não especialistas, a conclusão é que estamos aprendendo a construir gêmeos digitais mais inteligentes e confiáveis de sistemas físicos complexos. A DRQNN-LS oferece uma maneira de permitir que uma máquina aprenda o comportamento de um processo complexo diretamente a partir dos dados, garantindo que seu aprendizado não “exploda” nem divague de forma imprevisível. Essa combinação de flexibilidade e estabilidade pode ser valiosa em áreas que vão do controle industrial e robótica a sistemas de energia e, possivelmente, à modelagem biológica ou médica, onde comportamento não linear e medições ruidosas são a norma.

Citação: Khalil, H., Elshazly, O. & Shaheen, O. Stable approach based diagonal recurrent quantum neural networks for identification of nonlinear systems. Sci Rep 16, 8274 (2026). https://doi.org/10.1038/s41598-026-37973-2

Palavras-chave: identificação de sistemas não lineares, rede neural quântica, rede neural recorrente, estabilidade de Lyapunov, modelagem de dinâmica caótica