Clear Sky Science · pt

Uma estrutura de deep learning para diagnóstico do câncer de mama usando Swin Transformer e Rede de Fusão Multiescala com Atenção Dupla

Por que isso importa para pacientes e médicos

O câncer de mama é um dos tumores mais comuns em mulheres, e as mamografias são a principal ferramenta para detectá‑lo precocemente. Ainda assim, interpretar essas imagens de raio‑X é difícil, mesmo para especialistas, e pequenos sinais de alerta podem passar despercebidos. Este estudo apresenta um novo sistema de inteligência artificial (IA) projetado para ajudar radiologistas a identificar câncer de mama com mais confiabilidade, combinando duas formas poderosas de “enxergar” as mamografias: uma que capta a visão ampla e outra que foca em detalhes minúsculos.

O desafio de ver tanto a floresta quanto as árvores

Sistemas modernos de IA já auxiliam na leitura de imagens médicas, mas a maioria depende de um único tipo de modelo. Redes neurais convolucionais são boas em detectar padrões locais, como bordas nítidas ou pequenos pontos brilhantes. Vision transformers, uma família mais recente de modelos, se destacam em entender relações ao longo de toda a imagem. No entanto, mamografias exigem ambas as capacidades ao mesmo tempo: o câncer pode se manifestar como microcalcificações minúsculas ou distorções sutis, mas seu significado depende de como esses sinais se encaixam na estrutura geral da mama. Ao mesmo tempo, conjuntos de dados reais de mamografia são relativamente pequenos e frequentemente desbalanceados, com muito menos casos com câncer do que exames normais, o que facilita que sistemas de IA sofram overfitting ou apresentem viés.

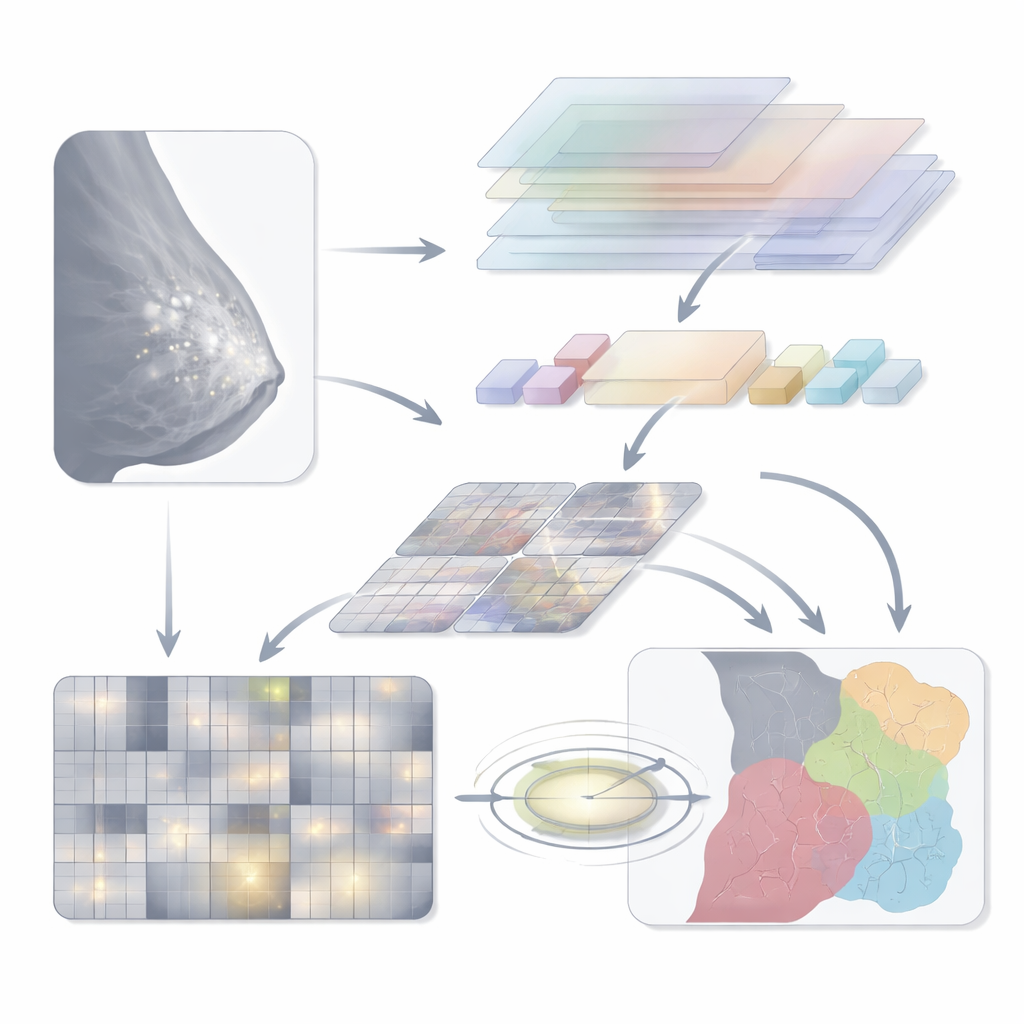

Uma IA de duas vias que vê em largura e amplia em profundidade

Os autores apresentam um modelo híbrido que chamam Swin‑DAMFN, construído especificamente para fundir visão global e local. Um ramo baseia‑se no Swin Transformer, que divide a mamografia em janelas e usa um mecanismo de atenção para capturar contexto de longo alcance—como diferentes partes da mama se relacionam. O segundo ramo é uma rede convolucional personalizada, a Dual‑Attention Multi‑scale Fusion Network (DAMFN). Esse ramo é ajustado para captar detalhes extremamente finos, como microcalcificações e leves distorções de tecido. Em sua arquitetura, blocos especializados analisam a imagem em múltiplas escalas e direções, e então empregam módulos de atenção para enfatizar regiões com maior relevância clínica, atenuando o tecido de fundo.

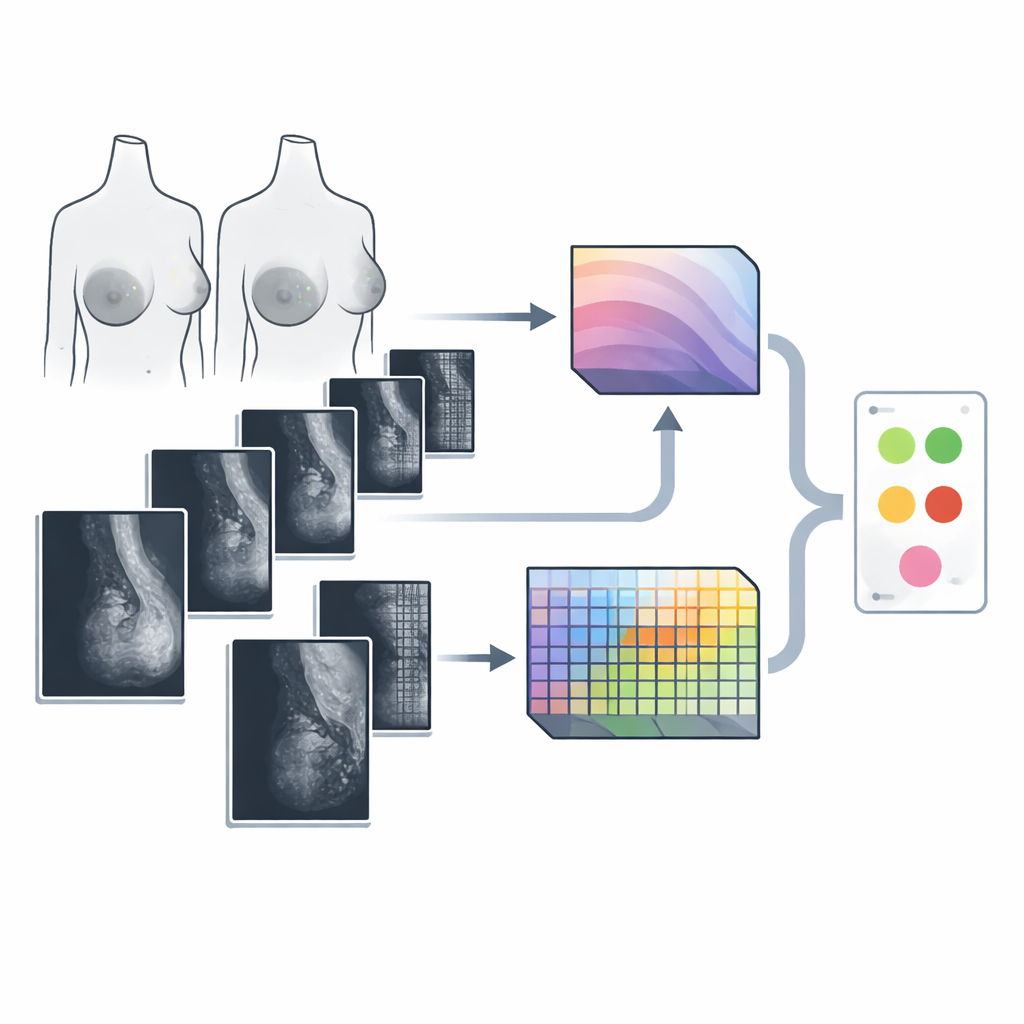

Ensinando o sistema com imagens mais numerosas e ricas

Como os conjuntos de mamografias reais são limitados e tendem a favorecer casos sem câncer, os pesquisadores reforçaram os dados de treino de duas maneiras complementares. Primeiro, utilizaram um tipo de modelo generativo chamado GAN condicional para sintetizar fragmentos realistas de mamografias, especialmente para categorias malignas subrepresentadas. Essas imagens geradas ajudam a equilibrar as classes e expõem o modelo a mais variações da aparência da doença. Em segundo lugar, aplicaram alterações fotométricas—pequenos ajustes aleatórios em brilho, contraste e nitidez—tanto nas imagens reais quanto nas sintéticas. Isso força a IA a se concentrar em padrões anatômicos reais, em vez de características superficiais de iluminação ou ruído, melhorando sua capacidade de generalizar para novos exames.

Como as peças funcionam juntas durante o diagnóstico

Durante a análise, uma mamografia pré‑processada é enviada simultaneamente para os dois ramos. O Swin Transformer produz um resumo compacto da estrutura global, enquanto o DAMFN gera um mapa detalhado de características locais. Esses mapas são então alinhados em tamanho e fundidos em uma única representação. Um bloco leve de “triplet attention” refina ainda mais essa fusão ao verificar cruzadamente canais e dimensões espaciais, direcionando o foco do modelo para áreas com maior probabilidade de conter doença. Finalmente, uma cabeça de classificação simples faz a média das informações e produz uma predição entre várias classes, como tecido normal, achados benignos ou diferentes tipos de lesões malignas.

O que os resultados significam na prática

A equipe testou o Swin‑DAMFN em dois conjuntos de dados públicos amplamente usados, CBIS‑DDSM e MIAS, e o comparou com muitos modelos populares de deep learning. Seu sistema alcançou cerca de 99% de acurácia no CBIS‑DDSM e quase 99% no MIAS, com sensibilidade (capacidade de detectar cânceres) e especificidade (evitar falsos positivos) igualmente altas. Estudos de ablação cuidadosos mostraram que cada componente—os ramos duplos, a fusão baseada em atenção e a estratégia de aumento de dados—contribuiu para esses ganhos. Embora os autores ressaltem que testes mais amplos em dados hospitalares diversos ainda sejam necessários, os achados sugerem que sistemas híbridos de IA como o Swin‑DAMFN podem se tornar auxiliares valiosos no rastreamento do câncer de mama, ajudando radiologistas a detectar lesões perigosas mais cedo e de forma mais consistente, ao mesmo tempo em que reduzem carga de trabalho e incerteza.

Citação: Aldawsari, M.A., Aldosari, S.J., Ismail, A. et al. A deep learning framework for breast cancer diagnosis using Swin Transformer and Dual-Attention Multi-scale Fusion Network. Sci Rep 16, 8941 (2026). https://doi.org/10.1038/s41598-026-37969-y

Palavras-chave: câncer de mama, mamografia, deep learning, modelos transformer, IA em imagem médica