Clear Sky Science · pt

Detecção de objetos em tempo real para veículos aéreos não tripulados baseada em vision transformer e edge computing

Olhos mais inteligentes no céu

Veículos aéreos não tripulados — drones — estão rapidamente se tornando ferramentas rotineiras para tarefas como inspeção de pontes, monitoramento de tráfego e busca por pessoas desaparecidas. Mas, para que um drone realmente ajude nessas missões críticas em tempo, ele precisa fazer mais do que apenas filmar o mundo; precisa reconhecer objetos pequenos em tempo real enquanto voa com bateria limitada e um computador de bordo reduzido. Este artigo apresenta uma nova forma de dar aos drones “olhos” mais nítidos e rápidos ao combinar uma técnica avançada de IA chamada vision transformer com o uso inteligente de servidores de borda próximos, para que objetos pequenos como pedestres, bicicletas e carros sejam detectados de maneira rápida e confiável a partir do ar.

Por que os drones têm dificuldade para ver pequenos detalhes

Do alto, pessoas e veículos podem reduzir-se a poucas dezenas de pixels em um quadro de vídeo. Sistemas tradicionais de redes neurais usados em drones são projetados para rodar rapidamente em chips de baixo consumo, mas frequentemente deixam passar esses objetos minúsculos ou falham quando a iluminação ou o ângulo de visão muda. Modelos mais recentes de vision transformer, emprestados do campo de processamento de linguagem, são muito melhores em entender a cena como um todo e em extrair pequenos detalhes de fundos confusos. O problema é que eles normalmente exigem enorme poder de computação, muito além do que uma plataforma voadora pode carregar. Os autores buscaram fechar essa lacuna: manter a visão aguçada do transformer, mas torná‑lo suficientemente enxuto para rodar em tempo real no drone, e descarregar trabalho extra para um servidor de borda próximo somente quando as condições permitirem.

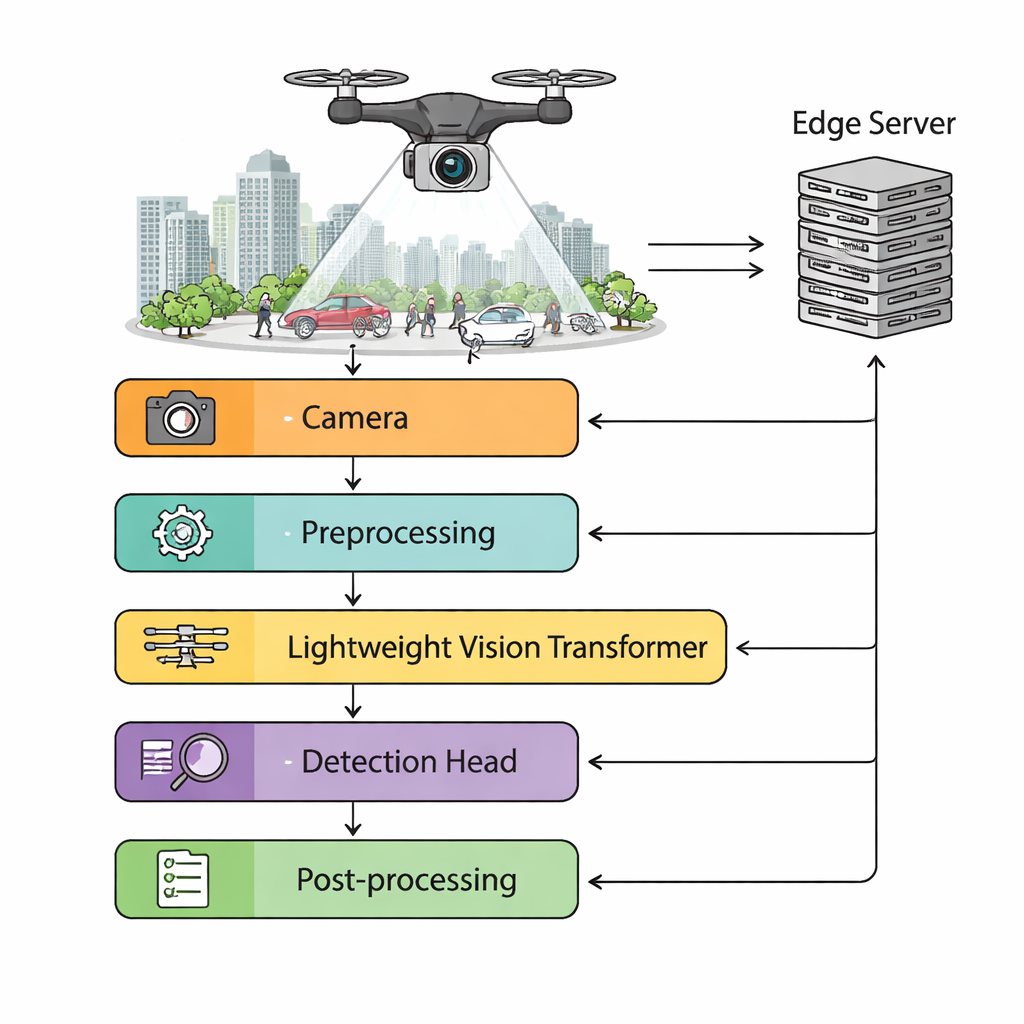

Um cérebro dividido: drone e borda trabalhando juntos

O framework proposto divide o trabalho entre o drone e um computador de borda no solo. A câmera do drone transmite vídeo em alta definição para um módulo de pré‑processamento a bordo que estabiliza imagens tremidas, ajusta brilho e redimensiona dinamicamente as imagens dependendo de quanta capacidade de processamento está disponível. Um vision transformer leve então extrai features ricas de cada quadro, alimentando uma cabeça de detecção que prevê onde estão os objetos e o que eles são. Um escalonador monitora o atraso da rede sem fio, o nível da bateria e a carga de processamento. Quando o link com a borda é rápido e estável, tarefas mais pesadas — como processamento em lote de quadros ou execução de modelos extras para aumentar a precisão — podem ser transferidas para o servidor de borda. Quando a conexão se degrada, o sistema alterna automaticamente para processamento inteiramente autônomo a bordo para que o drone nunca tenha que “voar às cegas”.

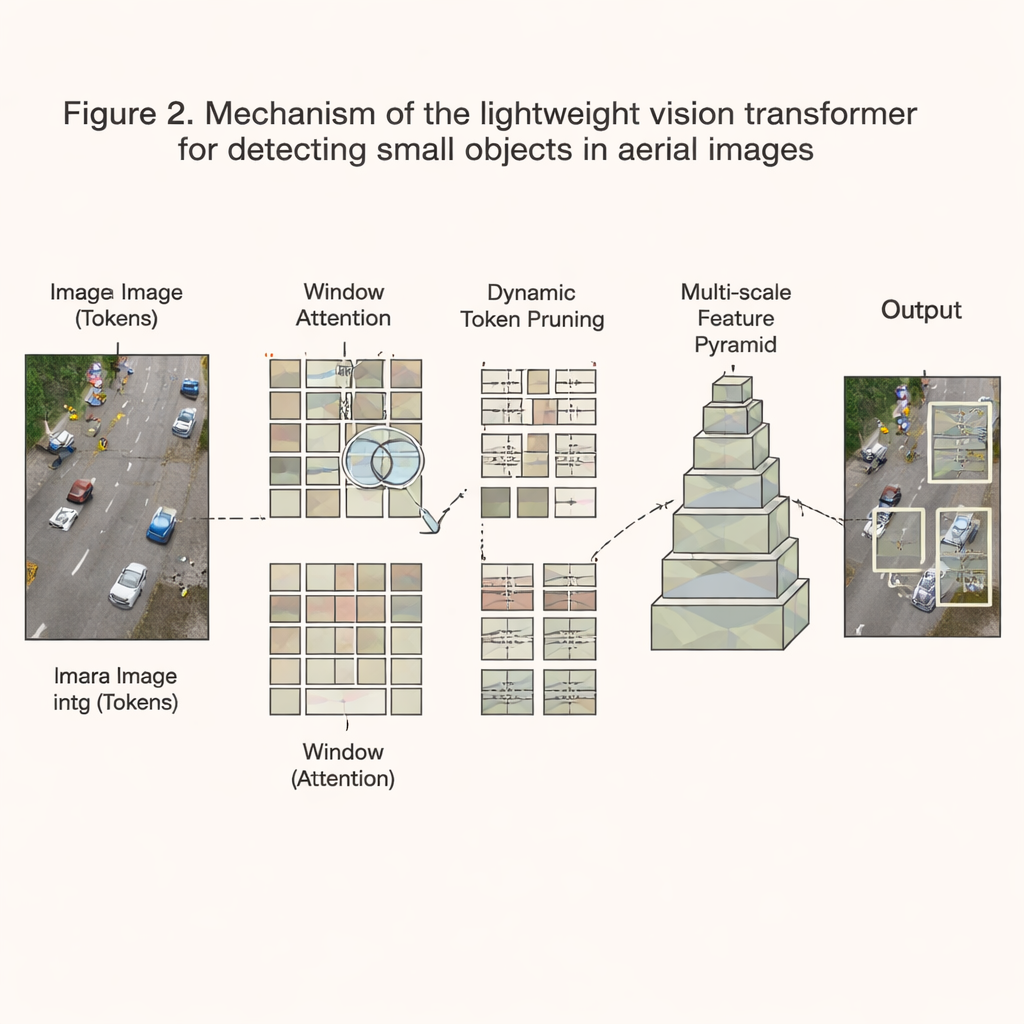

Reduzindo o modelo sem perder a visão

Para tornar o transformer pequeno e rápido o suficiente, os autores redesenham seu funcionamento interno. Em vez de permitir que cada parte da imagem compare-se com todas as outras — um processo que cresce explosivamente com a resolução — eles restringem a atenção a janelas locais que deslizam pela imagem, reduzindo o custo computacional a níveis mais manejáveis. Além disso, um esquema de poda dinâmica avalia constantemente quais regiões da imagem contêm informação útil e quais são majoritariamente fundo vazio. Tokens considerados não informativos são descartados cedo, poupando tempo e memória, enquanto cenas complexas e cheias de elementos preservam mais detalhes. O modelo também constrói uma pirâmide de features em múltiplas escalas para que tanto pedestres minúsculos quanto veículos maiores possam ser detectados no mesmo quadro. Combinado com quantização cuidadosa (usando menos bits por número), poda de canais e otimizações de software de baixo nível, essas mudanças reduzem os cálculos necessários em cerca de dois terços enquanto preservam mais de 94% da precisão original.

Colocando o sistema à prova

A equipe avalia seu projeto em um grande conjunto de dados aéreo montado a partir de benchmarks públicos de drones e de milhares de imagens recém‑coletadas sobre cidades, subúrbios e áreas rurais em diferentes estações e condições de iluminação. Em um computador embarcado popular usado em drones, o NVIDIA Jetson Xavier NX, o sistema opera a cerca de 39 quadros por segundo — rápido o bastante para operação em tempo real — enquanto alcança maior precisão do que detectores leves amplamente usados, como variantes do YOLO. Em particular, é significativamente melhor em identificar objetos pequenos, com um ganho de cerca de sete pontos percentuais na precisão média em relação a redes convolucionais convencionais. Testes de campo de uma semana em uma plataforma comercial de drone mostram que o sistema mantém o desempenho apesar de vibração da câmera, mudança de iluminação e conectividade sem fio flutuante, e que pode alternar suavemente entre modos assistidos pela borda e totalmente a bordo durante voos reais.

O que isso significa para missões reais com drones

Em termos claros, este trabalho demonstra que é possível dar aos drones uma visão mais nítida e confiável sem acoplar a eles um computador do tamanho de um data center. Ao redesenhar o vision transformer para ser enxuto, focar seletivamente nas partes mais informativas de cada imagem e emparelhar o drone com um servidor de borda próximo quando possível, os autores entregam um detector que enxerga mais, erra menos e ainda roda em tempo real dentro de restrições rígidas de energia e memória. Isso torna tarefas como busca e resgate, avaliação de desastres e inspeção de infraestrutura mais seguras e eficazes, porque os drones conseguem identificar melhor pequenos detalhes críticos — como uma pessoa encalhada ou um cabo danificado — exatamente quando cada segundo conta.

Citação: Zhu, W., Chen, K. Real-time object detection for unmanned aerial vehicles based on vision transformer and edge computing. Sci Rep 16, 6814 (2026). https://doi.org/10.1038/s41598-026-37938-5

Palavras-chave: drones, detecção de objetos, edge computing, vision transformer, imagens em tempo real