Clear Sky Science · pt

Estrutura de aprendizado por reforço adaptativa para otimização sustentável de microrredes em ambientes urbanos áridos

Manter as Luzes Acesas em uma Cidade do Deserto

Imagine gerir uma cidade moderna onde dias de verão frequentemente ultrapassam 40°C, aparelhos de ar-condicionado funcionam sem parar e as linhas de energia lutam para dar conta. Essa é a rotina em lugares como Riade, na Arábia Saudita. Este artigo explora como um novo tipo de sistema de controle inteligente, inspirado na forma como computadores aprendem a jogar videogames complexos, pode coordenar painéis solares, turbinas eólicas, baterias, geradores a diesel e a rede principal para manter uma cidade assim alimentada de forma mais econômica e com menos poluição.

Por que Redes de Energia Pequenas Importam

Em vez de depender apenas de grandes usinas distantes, muitas cidades estão recorrendo a “microrredes”—pequenas redes locais que combinam diferentes fontes de energia e podem até compartilhar eletricidade com vizinhos. Em regiões quentes e secas isso é especialmente importante: a demanda por refrigeração sobe e desce com o clima, a energia solar aparece em picos durante o dia e o vento pode ser fraco ou imprevisível. Sistemas de controle tradicionais tendem a seguir regras ou horários fixos. Eles não são muito bons em reagir a mudanças súbitas, como um pico no uso de ar-condicionado ou um dia de poeira que bloqueia o sol. O resultado é desperdício de energia limpa, mais combustível queimado em geradores a diesel e contas mais altas.

Um Cérebro que Aprende para o Sistema de Energia

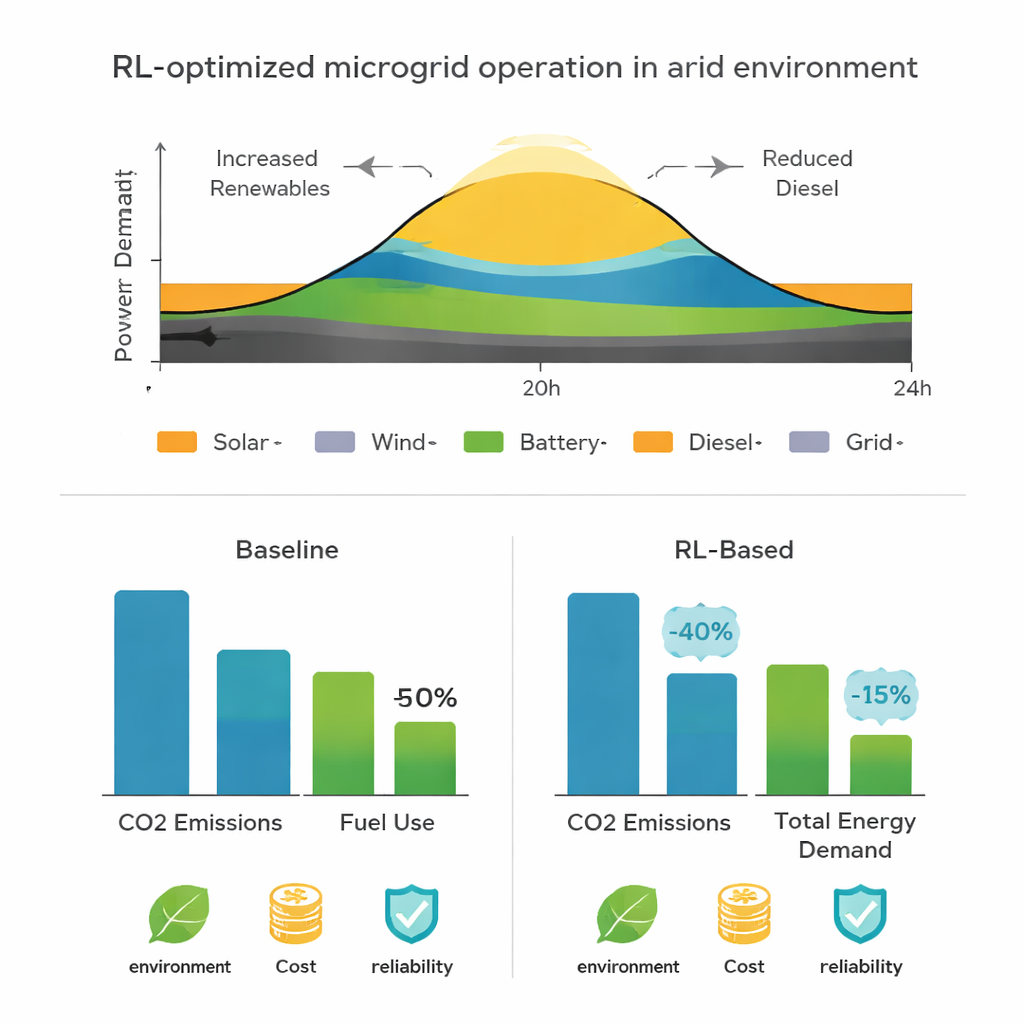

Os pesquisadores construíram um modelo de computador detalhado de cinco microrredes interconectadas representando edifícios e distritos típicos de Riade—casas grandes e pequenas, blocos de uso misto e áreas comerciais. Cada microrrede tinha sua própria combinação de painéis solares, pequenas turbinas eólicas, reserva a diesel e armazenamento em baterias, além de um vínculo com a rede elétrica mais ampla. Usando software de energia predial (EnergyPlus), geraram dados hora a hora para um ano inteiro: quanto de energia as pessoas consumiam, quão quente estava, quão forte brilhava o sol e quão veloz soprava o vento. Sobre isso, adicionaram um “agente” de aprendizado por reforço—um cérebro de software que observa o estado do sistema (demanda, carga das baterias, sol e vento disponíveis, estado dos geradores) e decide o que fazer a seguir: carregar ou descarregar baterias, ligar ou desligar geradores a diesel, importar ou exportar energia e compartilhar energia entre microrredes.

Como o Sistema Aprende a Tomar Melhores Decisões

O aprendizado por reforço funciona por tentativa e erro. Na simulação, o agente experimenta diferentes ações de controle hora a hora e recebe uma recompensa ou penalidade com base no que acontece. A recompensa combina três ideias simples: manter os custos baixos, manter a energia disponível e evitar desperdiçar ou ignorar energia renovável. Se suas decisões levarem ao uso caro de diesel, a faltas de energia ou energia solar sem aproveitamento, o agente é penalizado. Se conseguir suprir a demanda com mais sol e vento, menos emissões e operação estável, recebe recompensa. Ao longo de dezenas de milhares de rodadas de treinamento, o agente gradualmente descobre estratégias que equilibram esses objetivos. Uma vez treinado, pode tomar decisões em tempo real em apenas alguns milésimos de segundo.

O que Acontece Quando o Deserto Reage

Para verificar se essa abordagem realmente ajudaria em um clima severo, a equipe testou sob condições realistas e estressantes. O modelo reproduziu as oscilações sazonais de Riade, com forte refrigeração no verão e cargas mais amenas no inverno. O controlador baseado em aprendizado acompanhou com precisão o consumo horário e anual de energia (explicando cerca de 90–94% da variação), o que é crucial para antecipar picos. Reduziu perdas de energia ao longo de um dia típico e deslocou mais do suprimento para solar e eólica, usando baterias para suavizar lacunas. Quando os pesquisadores simularam eventos como uma tempestade de poeira que repentinamente cortou a energia solar ou uma onda de calor que aumentou muito a demanda, o sistema respondeu descarregando baterias, coordenando o uso de diesel e compartilhando excedente de energia entre microrredes—tudo sem cortar o fornecimento aos usuários.

Ar Mais Limpo e Contas Mais Baixas

Além de manter o fornecimento de energia, o estudo avaliou o impacto ambiental usando análise do ciclo de vida focada na operação dia a dia. Em comparação com uma configuração tradicional baseada em regras, o sistema adaptativo reduziu as emissões de dióxido de carbono em cerca de 14%, diminuiu a poluição formadora de chuva ácida em aproximadamente 14% e reduziu o consumo total de energia em torno de 10%. Esses ganhos vêm principalmente de operar geradores a diesel com menos frequência e de melhor aproveitamento da energia renovável local e do armazenamento. Em termos simples, dotar a microrrede de um cérebro que aprende permitiu extrair mais trabalho útil de cada unidade de energia limpa, depender menos de combustível e manter a confiabilidade mesmo quando o clima do deserto se torna hostil.

Citação: Mohamed, M.A.S., Almazam, K., Alzahrani, M. et al. Adaptive reinforcement learning framework for sustainable microgrid optimization in arid urban environments. Sci Rep 16, 7356 (2026). https://doi.org/10.1038/s41598-026-37752-z

Palavras-chave: microrredes, aprendizado por reforço, energia renovável, gestão de energia, cidades áridas