Clear Sky Science · pt

Segmentação automatizada de plantas daninhas com rotulagem baseada em conhecimento para aplicações de aprendizado de máquina

Por que um controle de plantas daninhas mais inteligente importa

As plantas daninhas silenciosamente roubam grande parte dos alimentos do mundo. Elas competem com as culturas, reduzem produtividades e forçam os agricultores a aplicarem mais herbicida, o que é caro tanto para os bolsos quanto para o meio ambiente. Este estudo mostra como drones e uma análise de imagem inteligente podem mapear automaticamente as plantas daninhas em campos de trigo—sem que alguém precise rotular manualmente cada planta. Esse tipo de automação pode acelerar o desenvolvimento de ferramentas para pulverização mais precisa, reduzindo o uso de químicos ao mesmo tempo em que mantém colheitas elevadas.

Do tratamento em massa ao ataque pontual

Ao redor do globo, campos sem controle efetivo de plantas daninhas podem perder entre um quinto e quase toda sua produção potencial. Em regiões como as províncias de pradaria do Canadá, os custos com herbicidas já somam centenas de milhões de dólares por ano, e plantas daninhas resistentes a herbicidas estão se espalhando. Novas ferramentas de “agricultura de precisão” pretendem pulverizar apenas onde as plantas daninhas realmente ocorrem, em vez de tratar todo o campo de forma indiscriminada. Para isso, as máquinas primeiro precisam de mapas de plantas daninhas precisos, e abordagens modernas dependem de modelos de aprendizado de máquina que analisam cada pixel de uma imagem. A barreira é que esses modelos exigem conjuntos de dados de treinamento enormes e cuidadosamente rotulados—normalmente criados por humanos desenhando contornos em torno das plantas, uma imagem por vez. Este estudo pergunta: podemos pular totalmente essa etapa de rotulagem manual?

Uma visão de drone do trigo e das plantas daninhas

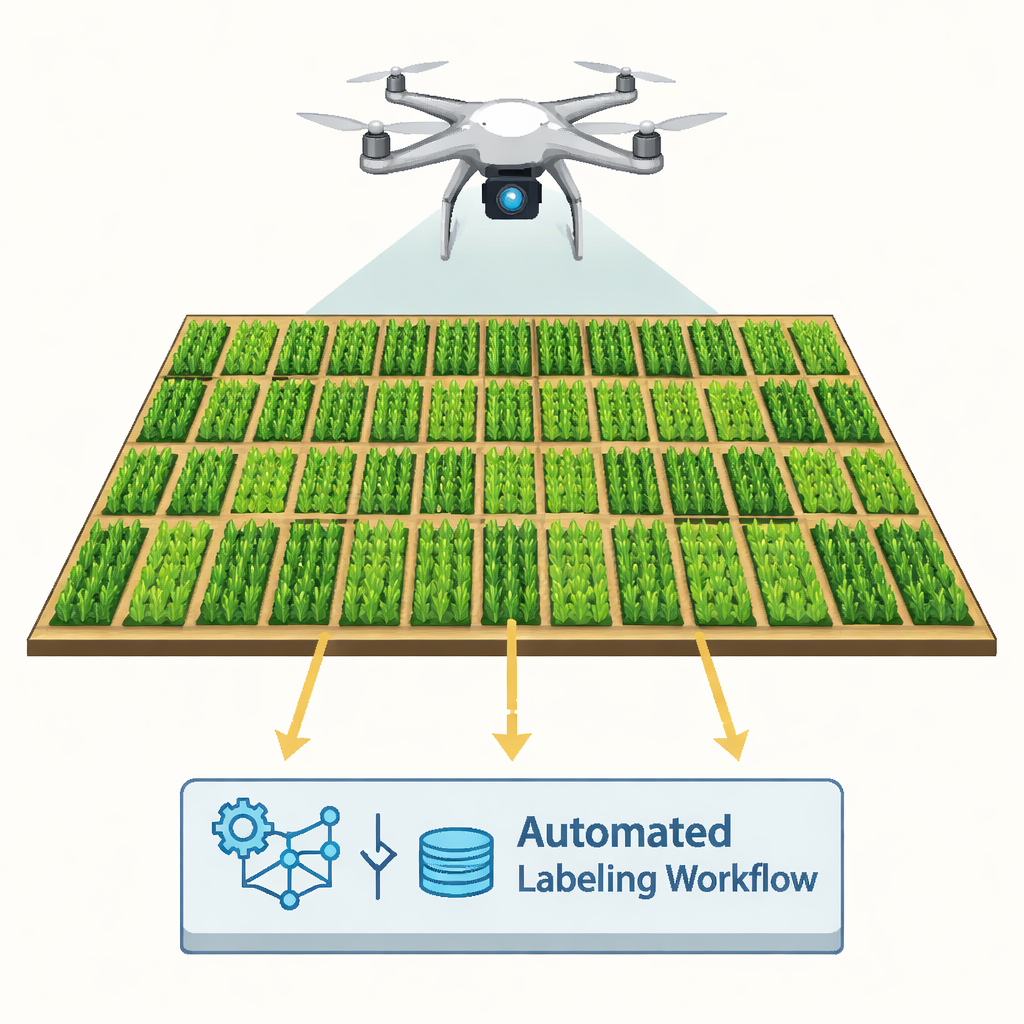

Os pesquisadores trabalharam em um campo experimental de trigo de 2.000 metros quadrados perto de Saskatoon, no Canadá. O trigo foi plantado em linhas retas, e faixas de várias espécies de plantas daninhas—incluindo kochia, aveia brava, mostarda brava e falsa carrapicharia—foram deliberadamente semeadas entre as linhas da cultura. Um drone equipado com uma câmera RGB de alta resolução voou a 10 metros do solo, capturando imagens tão detalhadas que cada pixel representava menos de um milímetro na superfície do campo. Essas imagens foram costuradas em uma única “ortofoto”, essencialmente uma imagem tipo mapa precisa do campo, que tornou-se a entrada para um fluxo de trabalho computacional automatizado.

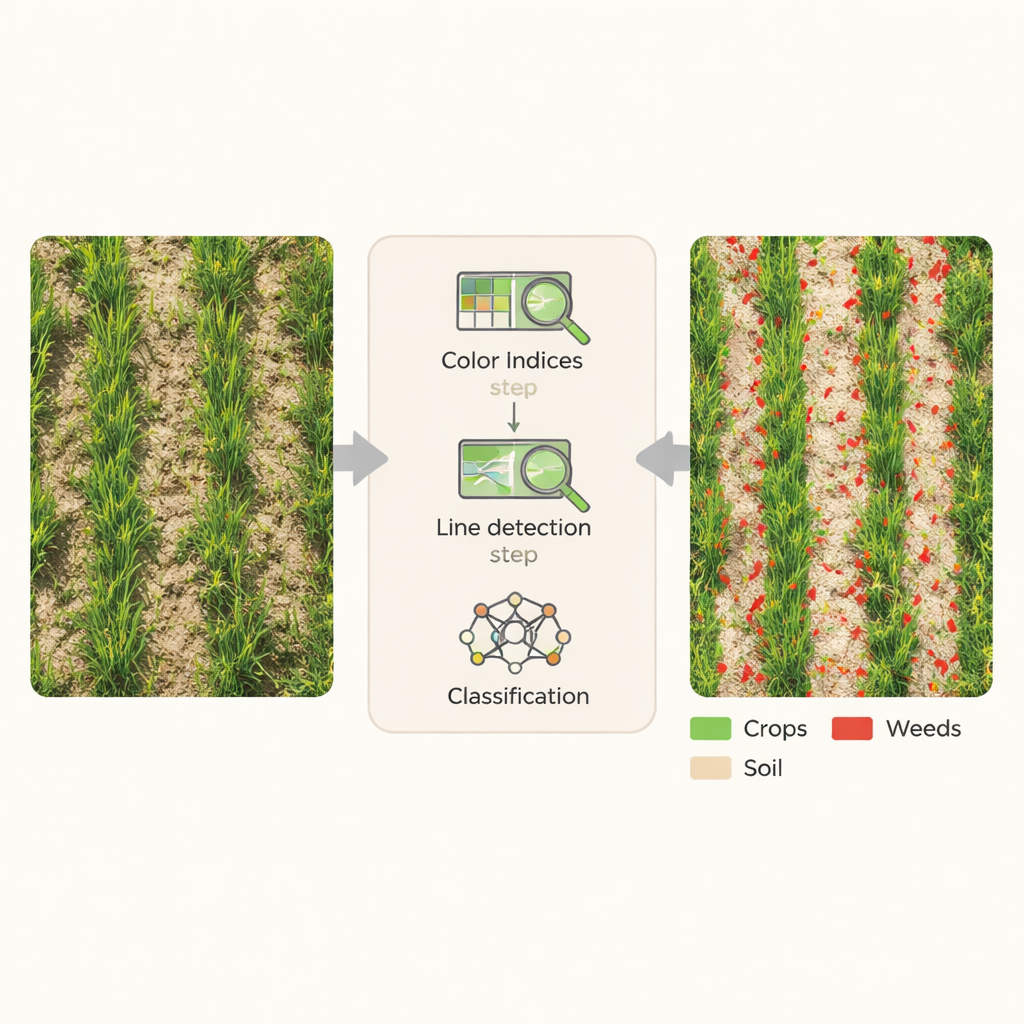

Transformando cor e forma em rótulos automáticos

Em vez de treinar um modelo de deep learning com milhares de exemplos rotulados à mão, a equipe construiu um pipeline baseado em conhecimento dentro de um software especializado de análise de imagem. Primeiro, eles realçaram a imagem usando fórmulas simples de cor que enfatizam plantas verdes contra solo marrom. Índices como o Excess Green Index e um Índice de Cor da Vegetação foram combinados para separar de forma limpa a vegetação do solo exposto. Em seguida, o sistema procurou por características longas e finas, em forma de linha, que correspondem à forma e orientação das folhas e fileiras de trigo. Ao escanear a imagem em muitos ângulos e aplicar filtros de convolução—janelas deslizantes matemáticas que destacam estruturas repetitivas—o fluxo de trabalho pôde identificar onde as linhas da cultura se situavam e, por contraste, onde as plantas daninhas provavelmente estavam entre ou dentro dessas linhas.

De pixels a mapas de plantas daninhas sem desenho manual

Uma vez identificadas as linhas da cultura e as áreas cobertas por plantas, o software aplicou limiares automáticos para classificar cada pixel em uma de três classes: cultura, planta daninha ou solo exposto. Segmentação em estilo tabuleiro de xadrez e cálculos de distância até a linha ajudaram a refinar essas decisões, especialmente em pontos complicados onde as copas de cultura e plantas daninhas se sobrepunham. Importante, todas essas etapas rodaram a partir de um conjunto fixo de regras—baseadas no conhecimento agronômico sobre como o trigo e as plantas daninhas aparecem e onde crescem—sem usar quaisquer amostras de treinamento rotuladas manualmente. A imagem foi processada em pequenos blocos para eficiência e depois remontada em um único mapa completamente classificado de todo o campo.

Quão preciso é o mapeamento de plantas daninhas sem treinamento?

Para testar o método, a equipe comparou seu mapa automatizado com milhares de pontos de verificação aleatórios nas imagens do campo, bem como com estimativas humanas de cobertura e contagem de plantas daninhas. No geral, o fluxo de trabalho rotulou corretamente 87% dos pontos, e uma medida estatística de concordância conhecida como kappa foi 0,81, considerada forte. A detecção de plantas daninhas especificamente teve uma acurácia de usuário de 76%, com a maioria dos erros ocorrendo onde copas densas de cultura e plantas daninhas se sobrepunham. Ainda assim, a cobertura e as contagens automatizadas de plantas daninhas seguiram de perto as avaliações humanas de campo e visuais, com relações suficientemente fortes para dar confiança de que o sistema captura padrões biológicos reais, não apenas ruído de imagem.

O que isso significa para as fazendas do futuro

Este trabalho demonstra que mapas de plantas daninhas de alta qualidade podem ser produzidos a partir de imagens de drone usando regras de especialistas em vez de conjuntos de treinamento rotulados manualmente. Em um computador desktop padrão, o campo de 2.000 metros quadrados foi totalmente processado em cerca de 20 minutos. Os mapas rotulados resultantes podem apoiar diretamente tarefas como avaliação da performance de herbicidas, orientar pulverizadores de taxa variável ou alimentar modelos de aprendizado de máquina e deep learning mais avançados com dados de treinamento prontos. Para agricultores e pesquisadores, essa rotulagem automatizada oferece um caminho para um manejo de plantas daninhas mais rápido, barato e sustentável, aproximando a agricultura de precisão da prática cotidiana.

Citação: Ha, T., Aldridge, K., Johnson, E. et al. Automated weed segmentation with knowledge based labeling for machine learning applications. Sci Rep 16, 6220 (2026). https://doi.org/10.1038/s41598-026-37475-1

Palavras-chave: agricultura de precisão, mapeamento de plantas daninhas, imagens de drone, rotulagem automatizada, monitoramento de culturas