Clear Sky Science · pt

Uma nova abordagem baseada em aprendizado por reforço para previsão de carga e preço de curto prazo em mercados de energia

Por que prever a energia de amanhã importa

Cada vez que você acende uma luz, uma vasta rede de usinas, mercados e computadores trabalha nos bastidores para manter a eletricidade disponível e acessível. Se os operadores de rede conseguem prever com precisão quanta energia as pessoas vão consumir e como os preços vão se comportar nas próximas horas, eles podem evitar apagões, reduzir desperdícios e economizar dinheiro para todos. Este artigo explora uma nova forma de fazer essas previsões de curto prazo usando técnicas desenvolvidas originalmente para ensinar máquinas a jogar e controlar robôs.

Estimativas mais inteligentes para um mundo energético em mudança

A demanda e os preços da eletricidade podem oscilar fortemente de hora a hora. Ondas de calor, ondas de frio, feriados e custos de combustíveis empurram o sistema em direções diferentes. Ferramentas tradicionais de previsão, como linhas de tendência simples ou mesmo modelos de machine learning padrão, frequentemente tratam o problema como um ajuste unidirecional aos dados passados. Elas têm dificuldade quando as condições mudam rapidamente ou quando muitos fatores interagem de forma complexa. Os autores defendem que redes elétricas modernas, especialmente aquelas com participação crescente de fontes renováveis, precisam de ferramentas de previsão que se adaptem em tempo real e aprendam diretamente com seus acertos e erros.

Um agente que aprende no mercado de energia

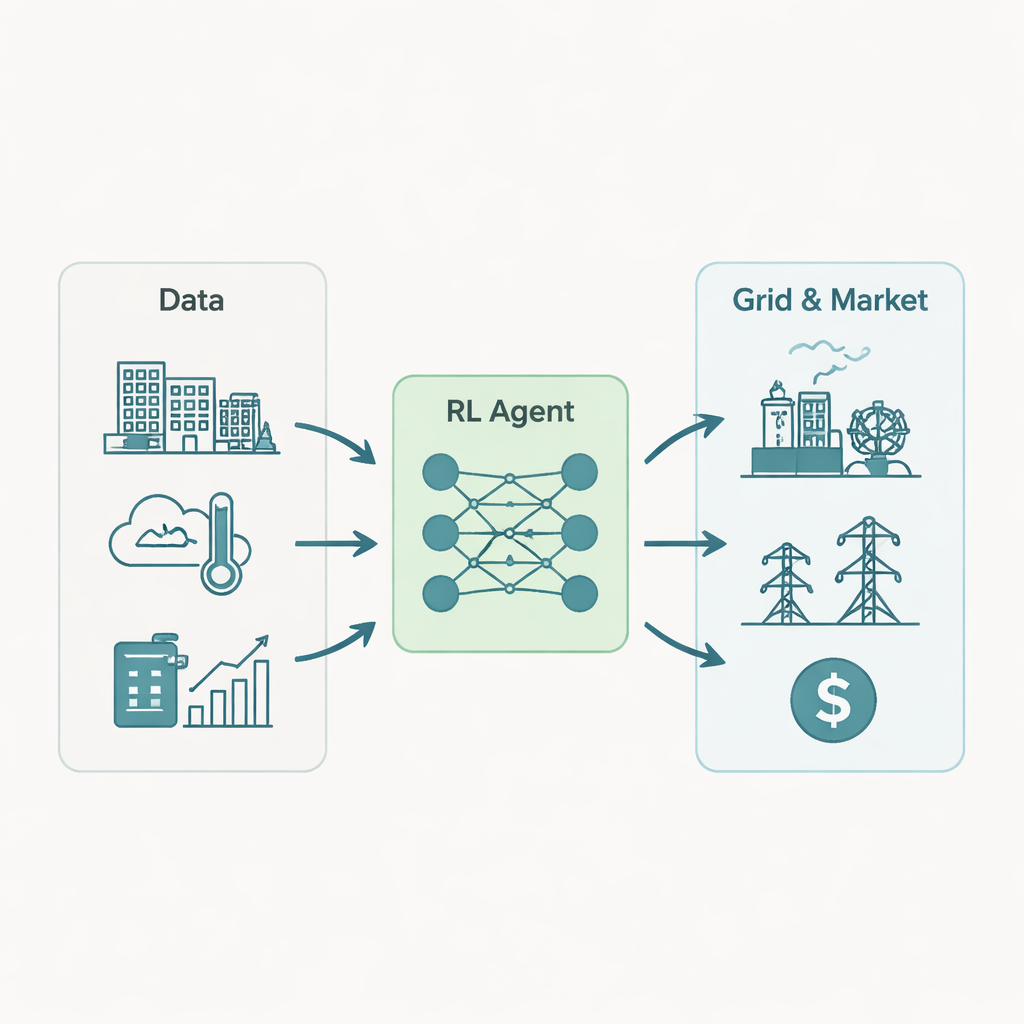

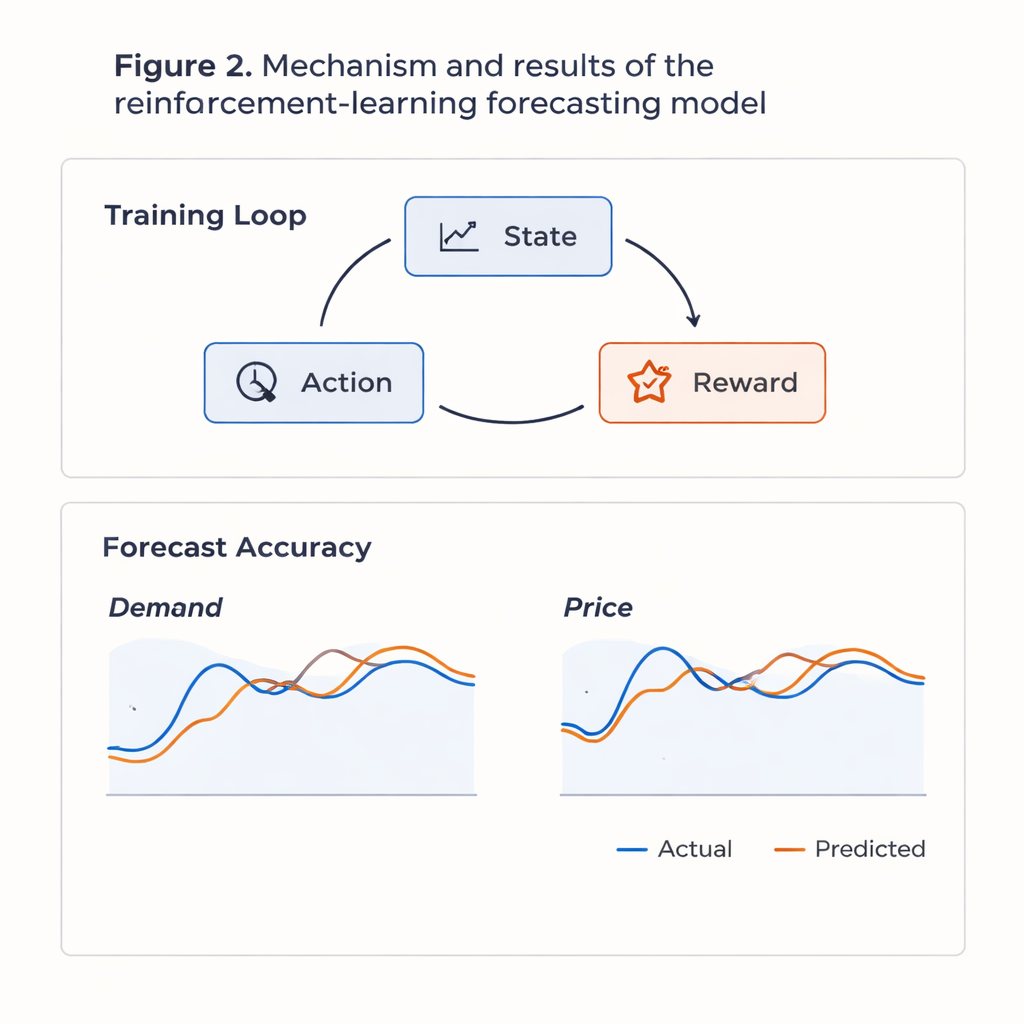

Os pesquisadores reformularam a previsão como um jogo de tomada de decisão. A cada hora, um “agente” computacional observa a situação atual: demanda recente de energia, preços passados, temperatura, umidade, dia da semana, feriados e custos de combustíveis. Em seguida, escolhe uma ação: sua melhor estimativa para a demanda e o preço da eletricidade na próxima hora. Quando os valores reais chegam, o agente recebe uma pontuação com base no erro — erros grandes são punidos, erros pequenos são recompensados. Ao longo do tempo, o sistema procura uma estratégia que maximize sua pontuação de longo prazo, não apenas a precisão de um único passo. Para lidar com as muitas entradas envolvidas, os autores usam um esquema de aprendizado por reforço profundo baseado em um Deep Q-Network, um tipo de rede neural que estima quão boa é cada ação possível em cada situação.

Dos dados brutos a previsões confiáveis

Para testar a abordagem, a equipe recorreu a dados do mundo real da PJM Interconnection, um grande mercado de energia dos EUA que cobre partes do Centro-Oeste e costa leste. Usaram cerca de três anos de registros horários (2021–2023), incluindo preços de mercado, demanda de eletricidade, observações meteorológicas e índices de preços de combustíveis. Antes do treinamento, limparam os dados, preencheram valores ausentes raros, removeram outliers incomuns e escalonaram tudo para faixas comparáveis. Também empregaram técnicas estatísticas para comprimir o grande conjunto de variáveis de entrada mantendo a maior parte da variabilidade útil. O agente de aprendizagem foi então treinado em múltiplas passagens por esse histórico, migrando gradualmente de tentativas aleatórias para explorar os padrões descobertos.

Como o agente de aprendizagem se saiu

Quando confrontado com métodos de previsão amplamente usados — incluindo ARIMA (um modelo tradicional de séries temporais), redes LSTM e o popular algoritmo XGBoost — o sistema de aprendizado por reforço saiu na frente. Em dados de teste reservados que o modelo nunca havia visto, ele reduziu os erros percentuais médios na demanda e no preço em cerca de 15–20% em comparação com essas referências. As previsões acompanharam de perto os ciclos diários de inverno e verão e seguiram as oscilações gerais de preço, embora o modelo ainda tivesse dificuldades com os picos de preço mais acentuados e raros e com comportamentos incomuns em feriados. A análise da estratégia aprendida mostrou que o agente descobriu implicitamente um padrão economicamente sensato: após observar preços muito altos, tendia a esperar uma demanda um pouco menor na hora seguinte, imitando uma resposta à demanda real sem que isso lhe fosse explicitamente informado.

O que isso significa para o uso cotidiano de energia

Para não especialistas, a mensagem principal é que essa abordagem baseada em aprendizado pode ajudar operadores de rede a gerir sistemas de energia de forma mais fluida e econômica. Previsões de curto prazo mais precisas permitem que geradores e operadores de mercado programem usinas com maior eficiência, integrem fontes renováveis com menos surpresas e reduzam o risco de picos de preço ou escassez. Embora o método exija muitos dados e seja intensivo em termos computacionais, e ainda precise ser aprimorado para eventos extremos, ele aponta para um futuro em que os mercados de eletricidade são orientados por ferramentas adaptativas e autoaperfeiçoadas que aprendem continuamente com o comportamento em constante mudança de consumidores, do clima e dos custos de combustível.

Citação: Wu, Y., Ma, Y. & Aliev, H. A novel reinforcement learning-based approach for short-term load and price forecasting in energy markets. Sci Rep 16, 5141 (2026). https://doi.org/10.1038/s41598-026-37366-5

Palavras-chave: previsão de redes inteligentes, previsão de preço da eletricidade, aprendizado por reforço, previsão de demanda de energia, deep Q-network