Clear Sky Science · pt

RiemannInfer: melhorando a inferência de transformers por meio da geometria riemanniana

Por que isso importa para usuários comuns de IA

Chatbots e assistentes de IA modernos conseguem resolver problemas de matemática, escrever redações e até explicar temas médicos, mas ainda não entendemos totalmente como chegam às suas conclusões — nem como fazê‑los raciocinar com mais confiabilidade. Este artigo apresenta o “RiemannInfer”, uma nova maneira de olhar para dentro de modelos de linguagem grandes (LLMs) tratando sua atividade interna como movimento sobre uma superfície geométrica curva. Essa perspectiva não só oferece uma imagem mais intuitiva de como esses sistemas “pensam”, como também torna seu raciocínio mais rápido e preciso.

Transformando o pensamento da IA em uma jornada geométrica

No interior de um LLM como GPT‑4 ou Llama, cada palavra em uma frase é representada por um vetor de alta dimensão, e camadas de “atenção” decidem com que intensidade palavras influenciam umas às outras. Os autores observam que esses estados ocultos podem ser vistos como pontos em um espaço vasto cuja forma geral codifica a compreensão de linguagem do modelo. Em vez de tratar o raciocínio como uma série de cálculos de probabilidade sobre textos, eles o reinterpretam como um problema de encontrar caminhos: o modelo viaja de um estado inicial (a pergunta) até um estado final (a resposta) ao longo de uma rota nesse espaço. Usando ferramentas da geometria riemanniana — a matemática de superfícies curvas — eles constroem uma variedade curva que captura como os padrões de atenção dobram e esticam essa paisagem interna.

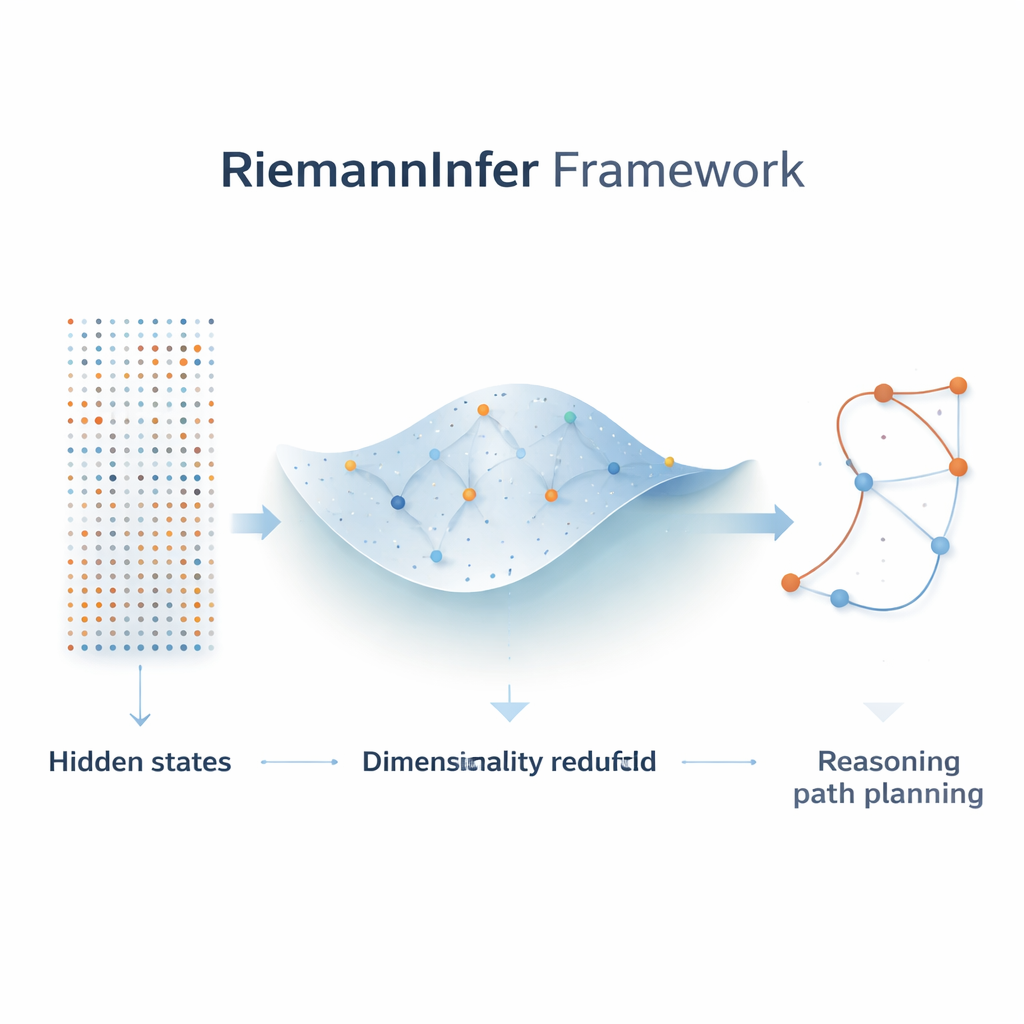

Comprimindo a complexidade sem perder o panorama geral

Como o espaço interno bruto de um LLM é enorme, o primeiro passo no RiemannInfer é encolhê‑lo preservando sua estrutura essencial. Os autores combinam técnicas de topologia, que estuda como pontos se conectam, com um algoritmo popular de redução de dimensionalidade chamado UMAP. Antes de reduzir o número de dimensões, eles analisam a “forma” da nuvem de estados ocultos para garantir que padrões de conectividade-chave sobrevivam à compressão. O resultado é um espaço de dimensão inferior onde relações importantes entre tokens — como quais palavras prestam forte atenção umas às outras — são em grande parte preservadas. Esse mapa geométrico compacto torna factível realizar cálculos precisos sobre distâncias, caminhos mais curtos e curvatura.

Construindo um mapa curvo a partir da atenção

A inovação central é traduzir pesos de atenção em uma medida geométrica de distância. Quando o modelo presta forte atenção entre dois tokens, o RiemannInfer os trata como próximos na variedade; atenção fraca os coloca mais distantes. A partir dessas relações, os autores definem uma métrica — uma regra matemática que determina comprimentos e ângulos — e a usam para calcular geodésicas, o equivalente curvo de linhas retas, assim como a curvatura, que mede quão acentuadamente o espaço se dobra. A atenção multi‑head torna‑se naturalmente uma mistura de múltiplas métricas, cada uma capturando um aspecto diferente da estrutura linguística, como gramática ou sentido. Com essa construção, decisões do modelo podem ser interpretadas como a escolha de caminhos particulares através de uma paisagem cujos picos e vales refletem onde a informação é densa ou escassa.

Planejando trajetos de raciocínio de baixo esforço

Uma vez construída a variedade, os autores reformulam o raciocínio como a busca de um caminho “fácil” da pergunta à resposta — aquele que minimiza o trabalho total realizado ao longo do trajeto. Eles tomam emprestada uma analogia do alpinismo: subir por uma rota íngreme e acidentada exige mais energia do que seguir uma crista mais suave até o mesmo cume. No contexto do LLM, a curvatura assume o papel de íngreme, e o trabalho de raciocínio do modelo corresponde a quanto sua incerteza interna é reduzida ao longo de um caminho. Usando fórmulas aproximadas para geodésicas e curvatura, combinadas com um algoritmo eficiente de busca em grafos (algoritmo de Dijkstra), o RiemannInfer identifica rapidamente rotas que minimizam esse trabalho, guiando efetivamente o modelo para cadeias de pensamento mais eficientes.

O que os experimentos mostram em modelos reais

Os autores testam o RiemannInfer em diversos LLMs de ponta, incluindo GPT‑4o, Llama‑3‑405B e DeepSeek‑V2‑400B, em benchmarks exigentes de matemática e raciocínio como GSM8K, MATH500, StrategyQA e AGIEval. Em todos os casos, envolver esses modelos com o framework RiemannInfer aumenta sua precisão em alguns pontos percentuais — números pequenos, mas significativos na fronteira de desempenho — enquanto mantém ou melhora levemente a velocidade. Uma comparação com um método puramente linear e mais simples mostra que ignorar a geometria curva dos estados ocultos prejudica dramaticamente o desempenho, ressaltando a importância da visão em variedade.

Panorama geral: dando ao raciocínio da IA uma sensação física

Para um leitor leigo, a conclusão principal é que os autores transformaram o funcionamento opaco de modelos de linguagem grandes em algo mais tangível: uma jornada por uma paisagem curva onde um bom raciocínio corresponde a seguir trilhas suaves e de baixo esforço. Ao ancorar padrões de atenção e passos de raciocínio em conceitos geométricos e físicos — distância, curvatura e trabalho — o RiemannInfer oferece tanto uma via prática para melhorar resultados quanto uma ponte conceitual entre IA e a física de espaços contínuos. Embora os métodos atuais sejam aproximados e muitos detalhes ainda precisem ser refinados, esse arcabouço aponta para futuros sistemas de IA cujos processos de pensamento possam ser analisados, otimizados e talvez até projetados usando a linguagem da geometria e da física.

Citação: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Palavras-chave: modelos de linguagem grandes, aprendizado profundo geométrico, variedade riemanniana, mecanismos de atenção, eficiência de raciocínio