Clear Sky Science · pt

Quando LLMs falam ZigBee: explorando modelos de baixa latência e de raciocínio para geração de tráfego de rede

Casas inteligentes precisam de simulações críveis

À medida que nossas casas se enchem de lâmpadas inteligentes, tomadas e sensores, a conversa invisível entre esses dispositivos torna‑se tanto uma conveniência quanto um possível ponto fraco. Engenheiros que projetam e protegem esses sistemas precisam de maneiras seguras de “ensaiar” como as redes se comportam em condições do mundo real, incluindo falhas raras e ataques cibernéticos. Este artigo explora se modelos modernos de IA baseados em linguagem — os mesmos usados em chatbots — podem ser reaproveitados para gerar tráfego realista de casas inteligentes, oferecendo aos pesquisadores um novo campo de testes poderoso sem precisar gravar todos os cenários possíveis em residências reais.

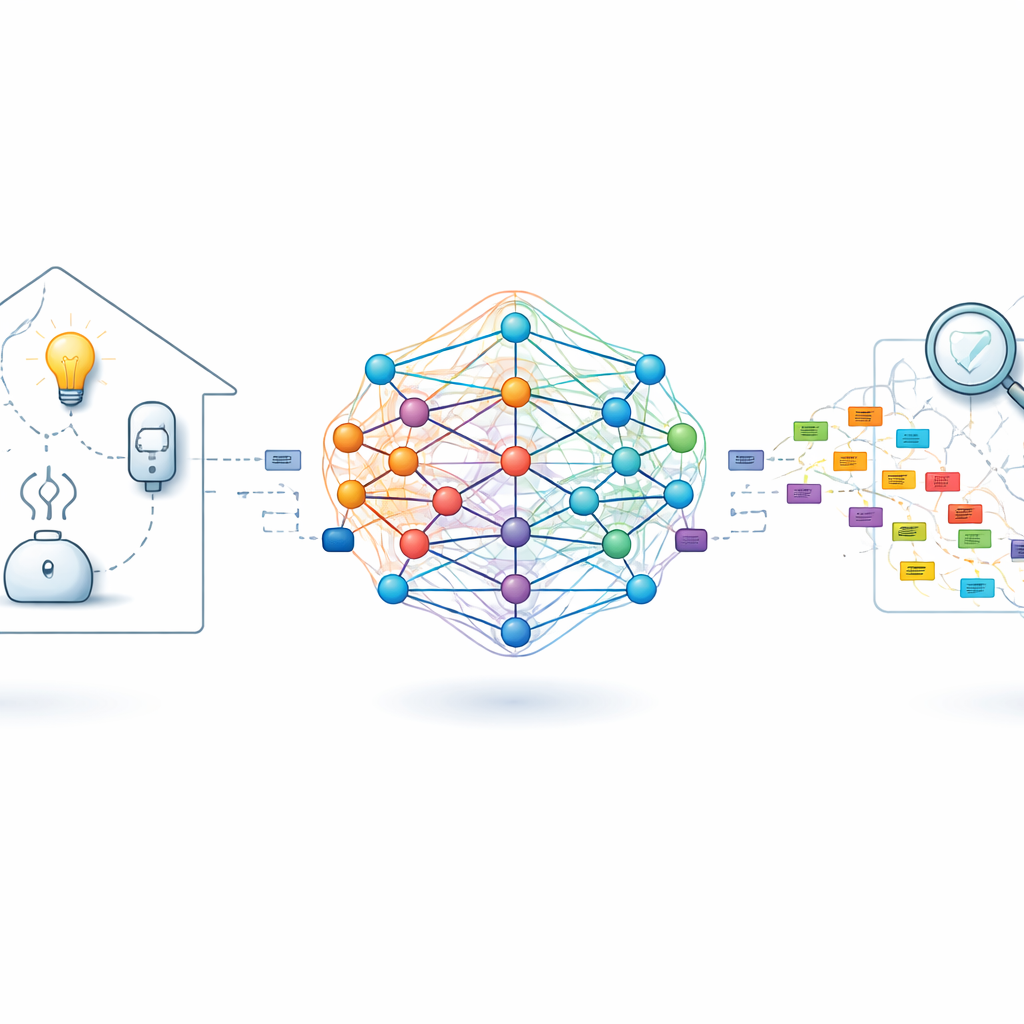

Da linguagem humana às conversas entre dispositivos

O estudo foca no ZigBee, um padrão sem fio popular usado em lâmpadas inteligentes, tomadas e sensores de movimento. Em vez de gerar texto comum, os autores alimentam amostras de pacotes ZigBee — registros com carimbo de tempo de quem falou com quem e quais campos de protocolo foram usados — em modelos de grande linguagem (LLMs) da OpenAI, especificamente GPT‑4.1 e GPT‑5. Esses modelos tratam cada pacote como uma “frase” estruturada e aprendem padrões de como dispositivos e o hub central se comunicam ao longo do tempo. O objetivo não é apenas imitar estatísticas básicas como tamanho médio de pacote, mas produzir tráfego novo que obedeça às regras estritas do ZigBee, use endereços de dispositivo válidos e preserve tempos realistas e padrões de requisição–resposta.

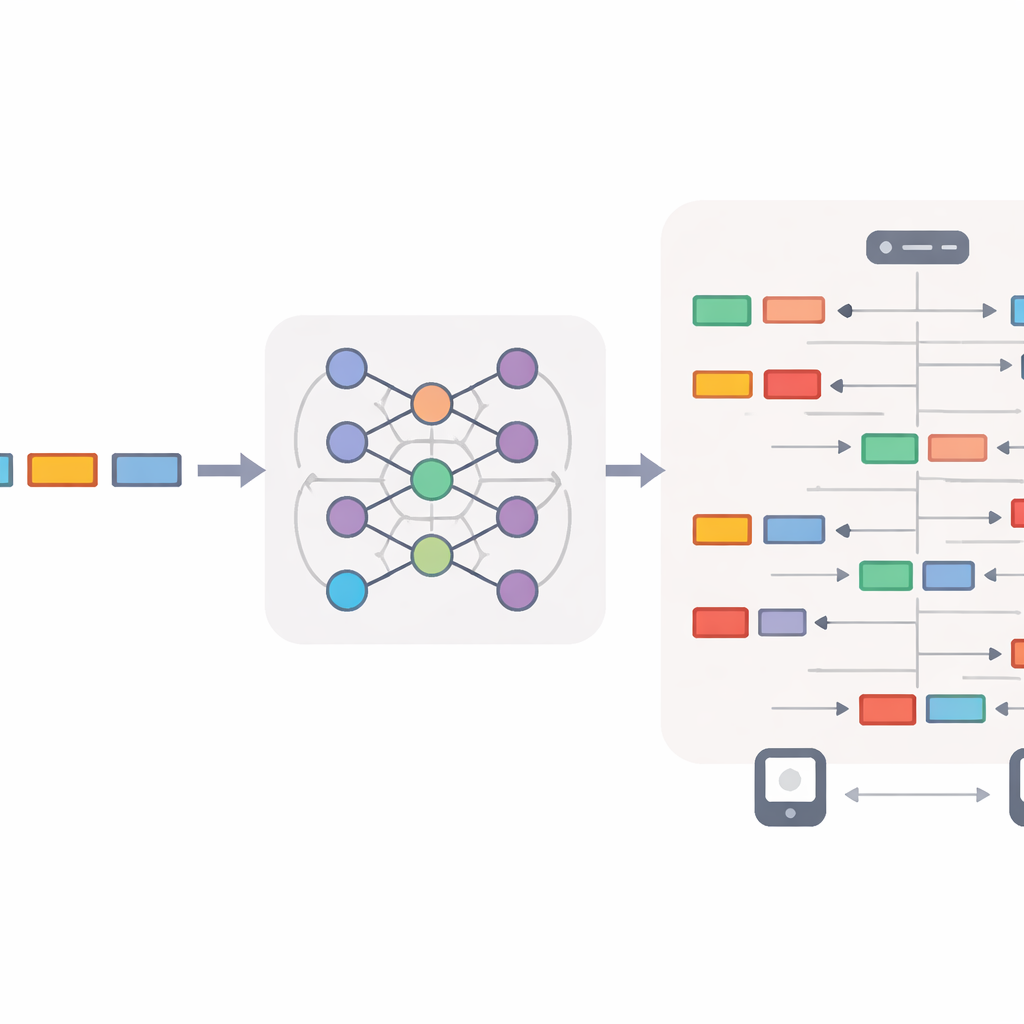

Dois experimentos: fala unilateral e diálogo completo

Para testar a ideia, os pesquisadores desenham dois experimentos principais usando um grande conjunto de dados real de casas inteligentes chamado ZigBeeNet, que contém cerca de 25 milhões de pacotes coletados de 15 dispositivos ao longo de 20 dias. No primeiro experimento, estudam a comunicação unilateral de uma única lâmpada inteligente para o hub, ensinando o LLM usando apenas os primeiros dez minutos de tráfego real como exemplos. No segundo, avançam para um cenário mais realista em que a lâmpada e o hub trocam mensagens em ambas as direções, incluindo broadcasts do hub. Em ambos os casos, um pequeno conjunto de pacotes de exemplo é mostrado ao modelo dentro do prompt (few‑shot learning), e pede‑se ao modelo que gere trechos mais longos de tráfego completamente novo que possam ser convertidos de volta em arquivos padrão de captura de pacotes e inspecionados com ferramentas de rede comuns.

Guiando o modelo com regras e verificações humanas

Como um campo deslocado ou um carimbo de tempo fora de ordem pode quebrar a ilusão de realismo, a equipe constrói um cuidado processo de prompting e feedback. Primeiro, filtram e exportam os pacotes reais, depois elaboram prompts que especificam endereços de dispositivo permitidos, tipos de mensagem e formatos de tempo. Numa fase inicial, um especialista humano revisa a saída do modelo, procurando problemas como endereços inválidos, números de sequência impossíveis ou lacunas no tempo. Em vez de corrigir pacotes manualmente, traduzem essas constatações em regras de prompt mais rígidas — por exemplo, proibindo que um dispositivo envie para si mesmo ou exigindo que a contagem de pacotes permaneça dentro de uma faixa realista. Uma vez que as regras estão estáveis, os prompts são “congelados” e reutilizados sem alterações, de modo que experimentos posteriores sejam totalmente automáticos e reprodutíveis.

Colocando LLMs contra geradores tradicionais

Para ver se os LLMs realmente acrescentam valor, os autores comparam GPT‑4.1 e GPT‑5 com duas abordagens clássicas de deep learning: redes neurais recorrentes (RNNs) e redes adversariais geradoras (GANs), ambas adaptadas para gerar sequências no estilo ZigBee. Eles avaliam todos os modelos em várias dimensões: quão próximas os tempos entre chegadas se assemelham ao tráfego real, se os pacotes decodificam corretamente em ferramentas padrão, se as regras do protocolo e os papéis dos dispositivos são respeitados, com que frequência pacotes se repetem e com que frequência copiam exatamente exemplos de treinamento. Os resultados mostram que ambos os modelos GPT produzem tráfego quase perfeitamente decodificável e conforme o protocolo, com baixa divergência em relação a padrões temporais reais, enquanto as RNNs têm dificuldade com ordenação de longo prazo e as GANs frequentemente criam tráfego irrealisticamente denso ou semanticamente inválido, especialmente para comunicação bidirecional e durações mais longas.

Quando mais “pensamento” não ajuda

O estudo também investiga uma questão surpreendente: dar ao GPT‑5, orientado ao raciocínio, mais “tempo de pensar” interno melhora o realismo da rede? Ao ajustar o esforço de raciocínio oculto do GPT‑5 de baixo para alto, os autores descobrem que maior esforço torna o modelo mais lento e mais verboso, mas não melhora — e às vezes prejudica — a semelhança do seu tráfego com a realidade. O GPT‑4.1, um modelo mais rápido e sem foco em raciocínio, iguala ou supera consistentemente o GPT‑5 em métricas-chave de qualidade enquanto usa menos recursos computacionais. Em simulações estendidas de 30 minutos, ambos os LLMs mantêm comportamento correto do ZigBee, mas as referências clássicas RNN e GAN deslizam fortemente em temporalidade e conformidade com o protocolo.

O que isso significa para casas inteligentes mais seguras

Para não especialistas, a mensagem principal é que modelos de linguagem modernos podem aprender não apenas conversas humanas, mas também a “linguagem” de dispositivos de casas inteligentes, gerando tráfego crível e que segue regras sob demanda. O trabalho demonstra que um modelo relativamente rápido e de baixa latência como o GPT‑4.1 já pode servir como um gerador de tráfego de alta fidelidade para testes e avaliação de segurança, potencialmente reduzindo a necessidade de capturar dados sensíveis do mundo real. Também ressalta que raciocínios mais complexos e pesados nem sempre são melhores: para tarefas técnicas altamente estruturadas, modelos mais simples e eficientes podem ser a escolha mais inteligente. Com a liberação do código e dos dados pelos autores, essa abordagem pode ajudar pesquisadores no mundo inteiro a testar sistemas de casas inteligentes, melhorar a detecção de intrusões e explorar novos designs de rede em um ambiente sintético e seguro.

Citação: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Palavras-chave: IoT para casa inteligente, geração de tráfego ZigBee, modelos de grande linguagem, testes de segurança de rede, dados de rede sintéticos