Clear Sky Science · pt

Diagnóstico diferente de câncer de mama BI-RADS usando MobileNetV1 e vision transformer baseado em inteligência artificial explicável (XAI)

Detectando o risco de câncer mais cedo

O câncer de mama é mais tratável quando é detectado precocemente, mas a leitura de mamografias é um trabalho difícil e pressionado pelo tempo. Este estudo descreve um novo sistema de inteligência artificial (IA) projetado não apenas para identificar sinais de câncer em mamografias com altíssima precisão, mas também para mostrar aos médicos exatamente quais áreas da imagem da mama influenciaram suas decisões. Ao combinar de forma inteligente duas técnicas modernas de análise de imagem, o sistema pretende apoiar radiologistas com segundas opiniões rápidas, confiáveis e transparentes.

Por que ler mamografias é tão difícil

As mamografias são imagens de raios-X da mama usadas para verificar sinais precoces de câncer. Os radiologistas atribuem a cada exame um escore BI-RADS, uma escala padronizada que vai de achados normais a claramente cancerígenos. Em mamas densas, onde há muito tecido glandular, áreas suspeitas podem ficar escondidas ou parecer semelhantes a estruturas inofensivas. Muitas ferramentas computacionais anteriores focaram apenas em decisões simples de sim ou não para câncer, tiveram dificuldade com a gama completa de categorias BI-RADS ou funcionaram como uma caixa-preta, deixando os médicos sem saber por que uma decisão específica foi tomada.

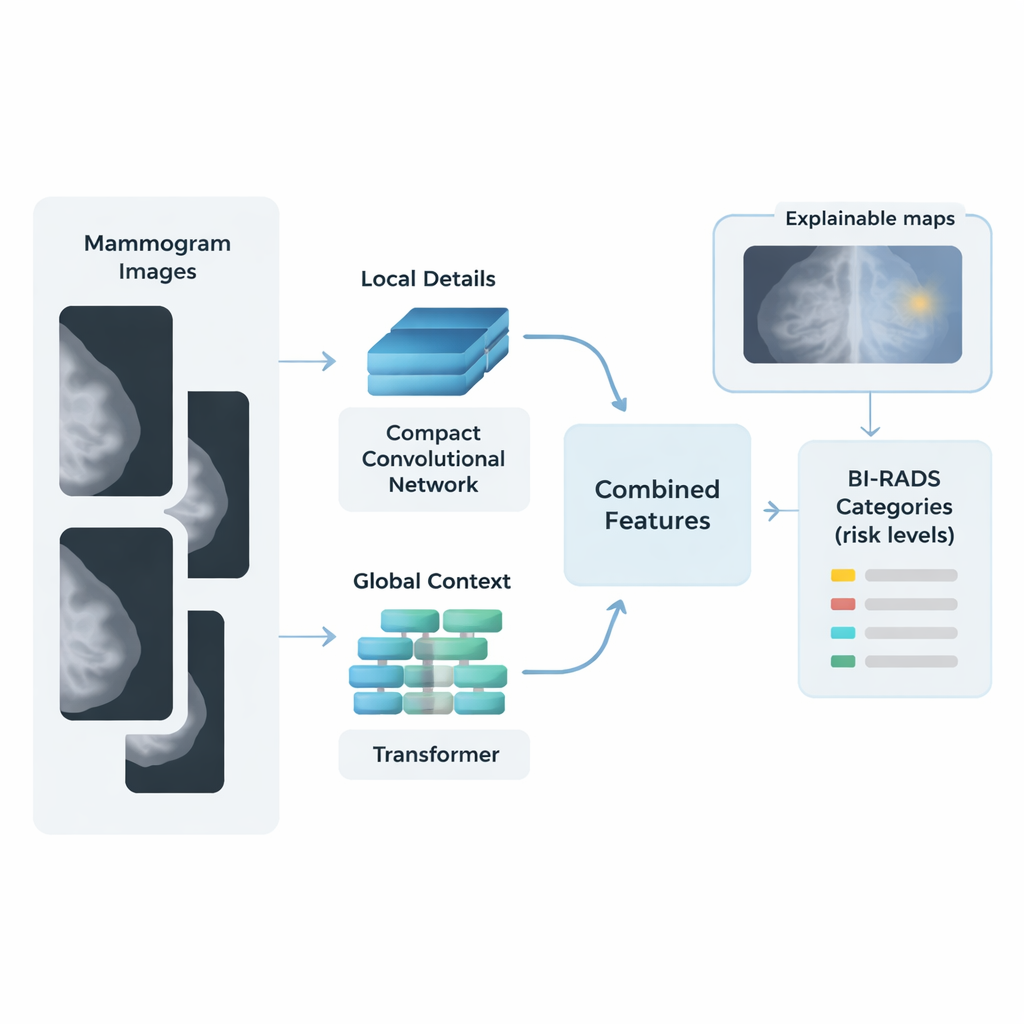

Misturando duas maneiras de “olhar” uma imagem

Os pesquisadores construíram uma estrutura híbrida de IA que imita como um leitor humano cuidadoso pode examinar uma mamografia: primeiro analisando pequenos detalhes e depois considerando a visão geral. Uma parte do sistema, baseada em uma rede compacta chamada MobileNetV1, concentra-se em detalhes locais, como microcalcificações e bordas nítidas de lesões. Uma segunda parte, um vision transformer, divide a imagem em patches e analisa como padrões se relacionam em toda a mama, capturando a estrutura tecidual geral e distorções sutis. As características extraídas por essas duas “correntes” são então fundidas em uma única descrição rica de cada imagem.

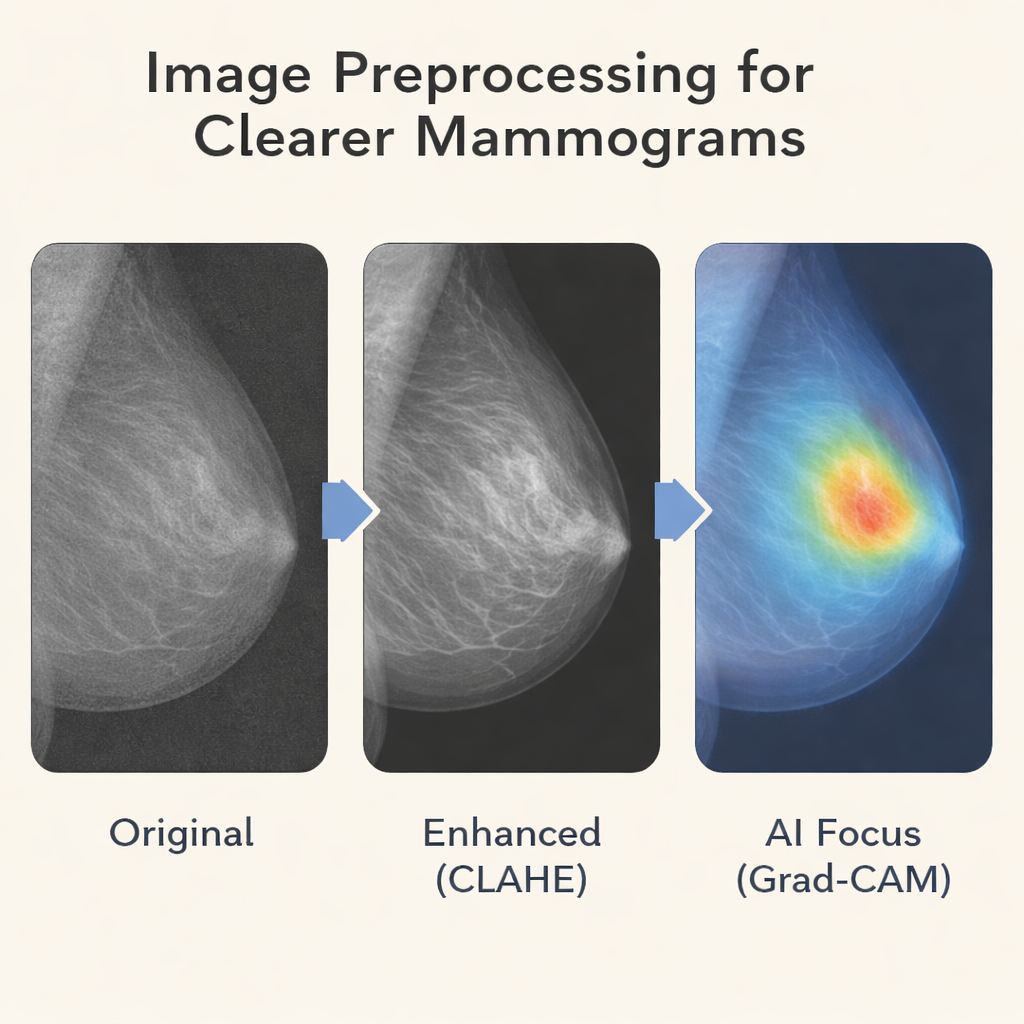

Limpeza, balanceamento e simplificação dos dados

Antes de as imagens entrarem no pipeline de IA, elas passam por várias etapas de preparação. A equipe melhora o contraste usando um método que realça estruturas sutis sem exagerar o ruído, tornando pontos tênues mais fáceis de ver. As imagens são redimensionadas e normalizadas para que o sistema as veja de forma consistente. Para combater o fato de que algumas categorias BI-RADS, como casos claramente malignos, são relativamente raras, os autores usam truques de aumento de dados como pequenas rotações e flips e aplicam treinamento sensível à classe para que categorias menos comuns ainda tenham influência durante o aprendizado. Depois que as duas correntes extraem características, uma ferramenta matemática chamada análise de componentes principais comprime essas informações, preservando o que mais importa enquanto reduz a complexidade.

Das características às pontuações de risco, com explicações

Para a etapa final, em vez de confiar em um classificador neural pesado e opaco, os autores usam muitos modelos simples de regressão logística combinados em um conjunto por “bagging”. Cada modelo oferece uma maneira direta de conectar características da imagem aos níveis de risco BI-RADS, e a votação majoritária entre eles fornece estabilidade e resistência ao sobreajuste no conjunto de dados relativamente modesto. Testado em mais de 6.000 mamografias do conjunto de dados de câncer de mama da King Abdulaziz University, o sistema híbrido alcançou mais de 99% de acurácia, sensibilidade e especificidade nas quatro principais categorias BI-RADS que visava: normal, provavelmente benigno, suspeito e maligno.

Deixando os médicos verem o que a IA vê

Para tornar suas decisões compreensíveis, o sistema emprega técnicas de IA explicável conhecidas como Grad-CAM e Grad-CAM++. Estas produzem mapas de calor coloridos sobrepostos à mamografia, destacando as regiões que mais influenciaram a pontuação BI-RADS prevista. Em casos malignos, as áreas destacadas tipicamente se alinham com massas ou aglomerados de calcificações observados por radiologistas experientes; em imagens normais, há pouca ou nenhuma ativação focada. Esse retorno visual ajuda os clínicos a julgar se o modelo está prestando atenção a características medicamente relevantes e pode revelar por que certos casos limítrofes — como tecido denso que imita uma lesão — são difíceis mesmo para especialistas.

O que isso pode significar para os pacientes

O estudo mostra que, em um único conjunto de dados clínicos, esse sistema de IA explicável e de fluxo duplo pode classificar mamografias em múltiplos níveis de risco com precisão comparável a, e em certos aspectos superando, muitos métodos anteriores. Embora ainda precise ser testado em populações mais diversas e em diferentes hospitais, a abordagem aponta para ferramentas de IA que não são apenas altamente precisas, mas também rápidas o suficiente para clínicas atarefadas e transparentes o bastante para ganhar a confiança de radiologistas e pacientes. Na prática, tais sistemas poderiam funcionar como um par de olhos especialistas adicional — sinalizando achados sutis, reduzindo cânceres perdidos e apoiando conversas mais claras e confiantes sobre o risco de câncer de mama.

Citação: Abdelsabour, I., Elgarayhi, A., Sallah, M. et al. Different BI-RADS breast cancer diagnosis using MobileNetV1 and vision transformer based on explainable artificial intelligence (XAI). Sci Rep 16, 7190 (2026). https://doi.org/10.1038/s41598-026-37199-2

Palavras-chave: câncer de mama, mamografia, inteligência artificial, vision transformer, IA explicável