Clear Sky Science · pt

Sistema de atribuição de especialistas baseado em processamento de linguagem natural para ações Marie Sklodowska-Curie

Por que escolher o especialista certo realmente importa

Quando milhares de propostas de pesquisa competem por recursos limitados, tudo depende de quem as avalia. Se os especialistas designados não entendem verdadeiramente o tema de uma proposta, ideias promissoras podem ser mal interpretadas ou ignoradas. Este artigo explora como a inteligência artificial, especificamente sistemas modernos de processamento de linguagem, pode ajudar a casar propostas com os melhores especialistas possíveis de forma mais precisa e justa do que as ferramentas atuais baseadas em palavras-chave.

O problema das listas de verificação por palavras-chave

Até agora, a atribuição de especialistas em grandes programas de financiamento europeus, como as bolsas de pós-doutoramento Marie Skłodowska-Curie, tem se apoiado fortemente em palavras-chave. A plataforma atual vasculha as descrições das propostas e os perfis dos avaliadores para encontrar termos correspondentes e, em seguida, sugere três especialistas mais alternativas. Mas os Vice-Chairs — cientistas seniores que supervisionam o processo — acabam alterando cerca de 40% dessas designações. Esse nível de correção humana torna o sistema trabalhoso, lento e um tanto opaco, especialmente quando chegam até 10.000 propostas por ano, muitas vezes em áreas emergentes onde listas fixas de palavras-chave têm desempenho ruim.

Ler pesquisa como um humano, em escala

Os autores desenvolveram um novo sistema de atribuição que tenta “ler” a pesquisa mais como um especialista humano faria. Em vez de confiar em rótulos, ele coleta as publicações de cada especialista via ORCID, um identificador global de pesquisadores, e constrói um banco de dados com mais de 2.800 resumos de artigos. Tanto os resumos das propostas quanto os resumos das publicações são então processados pelo GALACTICA, um grande modelo de linguagem treinado especificamente em textos científicos. O GALACTICA transforma cada resumo em uma impressão digital numérica que captura seu significado, não apenas sua redação. Ao comparar essas impressões digitais, o sistema pode estimar quão próximo o conteúdo de uma proposta está do trabalho anterior de cada especialista.

Três maneiras de somar expertise

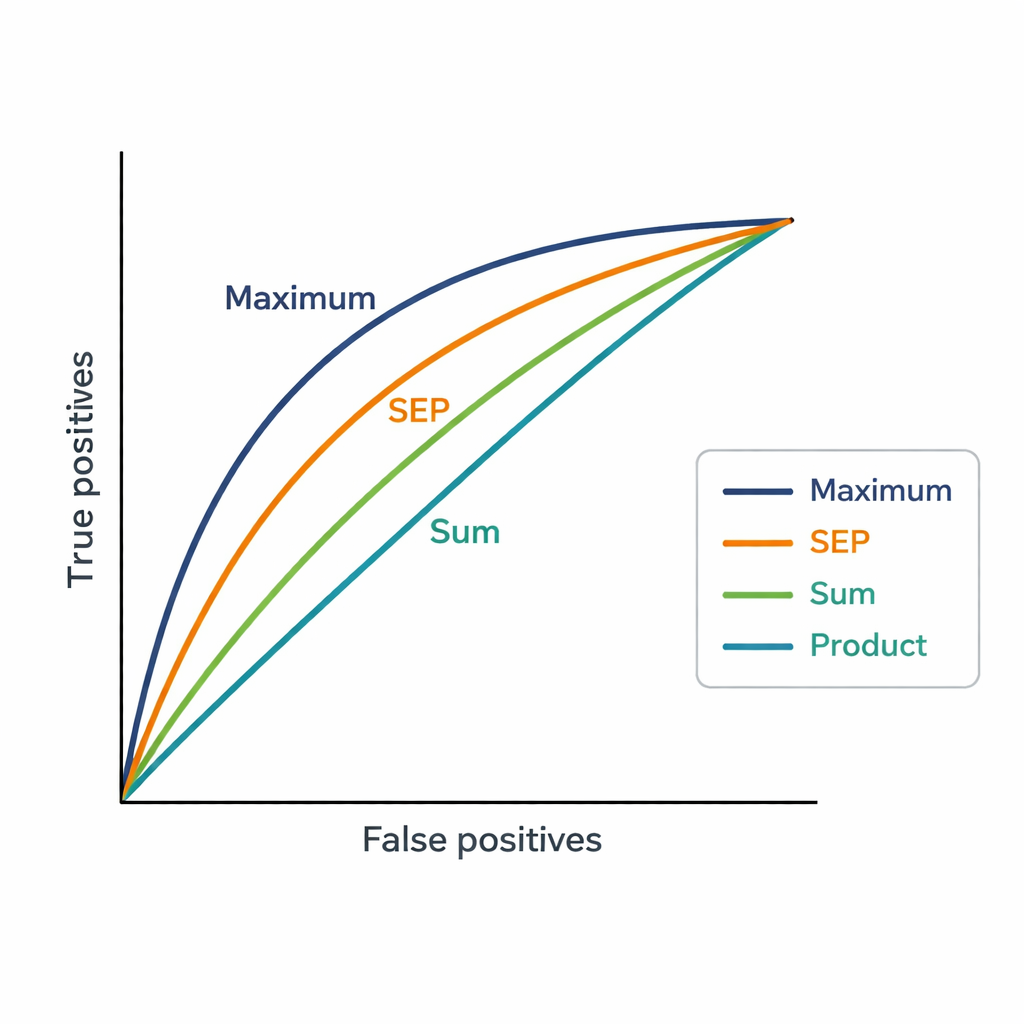

Um desafio é que especialistas podem ter dezenas de publicações. O sistema precisa de uma única pontuação por especialista e proposta, então os autores testaram três maneiras simples de combinar similaridades. A estratégia Soma agrega todas as pontuações de similaridade, recompensando relevância ampla e repetida. A estratégia Produto as multiplica, enfatizando similaridade consistente ao longo de muitas publicações, mas punindo fortemente qualquer correspondência fraca. A estratégia Máxima mantém apenas a correspondência única mais forte, partindo do princípio de que um artigo muito relacionado pode ser suficiente para justificar uma atribuição. Essas pontuações são então usadas para classificar 48 especialistas candidatos para cada uma das 181 propostas, e as classificações são comparadas com as escolhas finais de especialistas feitas pelos Vice-Chairs.

O que os números revelam sobre as escolhas humanas

A estratégia Máxima casou-se mais de perto com as decisões dos Vice-Chairs, alcançando uma AUC de 0,82, melhor do que tanto o sistema atual baseado em palavras-chave (AUC 0,75) quanto as outras metodologias de agregação. Na prática, o especialista escolhido pelos Vice-Chairs geralmente aparecia entre as quatro primeiras sugestões produzidas pela Máxima. Isso sugere que, ao atribuir avaliadores, as pessoas tendem a focar se existe ao menos uma conexão muito forte entre o trabalho anterior de um especialista e uma proposta, em vez de exigir que todas as publicações do especialista estejam alinhadas. O novo método também gera pontuações muito mais detalhadas do que os níveis grosseiros de “afinidade” da plataforma, permitindo distinções mais claras entre especialistas com ranqueamentos próximos.

O que isso significa para futuras avaliações de bolsas

Para um leitor leigo, a conclusão é direta: ao usar IA que entende a linguagem científica, agências de fomento podem combinar melhor propostas com os especialistas adequados, reduzir correções manuais e tornar o processo mais consistente e transparente. Enquanto diferentes formas de combinar evidências das publicações ressaltam aspectos distintos da expertise, a regra simples do “melhor único ajuste” parece espelhar como os humanos realmente decidem. À medida que esses sistemas forem testados mais amplamente e com modelos de linguagem mais recentes, eles podem se tornar parte central de uma avaliação de pesquisa mais justa e eficiente em todo o mundo.

Citação: Álvarez-García, E., García-Costa, D., De Waele, I. et al. Expert assignment system based on natural language processing for Marie Sklodowska-Curie actions. Sci Rep 16, 6396 (2026). https://doi.org/10.1038/s41598-026-37115-8

Palavras-chave: parecer externo, correspondência de especialistas, financiamento à pesquisa, processamento de linguagem natural, grandes modelos de linguagem