Clear Sky Science · pt

YOLO-DC para detecção de veículos usando redes convolucionais deformáveis e atenção de coordenada entre canais

Por que identificar carros por câmeras é realmente importante

Cidades modernas dependem de câmeras que monitoram vias movimentadas, ajudando a gerenciar congestionamentos e abrindo caminho para veículos autônomos. Mas identificar de forma confiável cada veículo nesses fluxos de câmera é surpreendentemente difícil, especialmente quando os carros são pequenos à distância, parcialmente ocultos pelo tráfego ou borrados por chuva, neblina ou escuridão. Este artigo apresenta o YOLO‑DC, um novo sistema de visão computacional que busca detectar carros, ônibus e outros veículos de forma rápida e precisa, mesmo em condições reais confusas e em dispositivos com capacidade de processamento limitada.

O problema de trânsito por trás da pesquisa

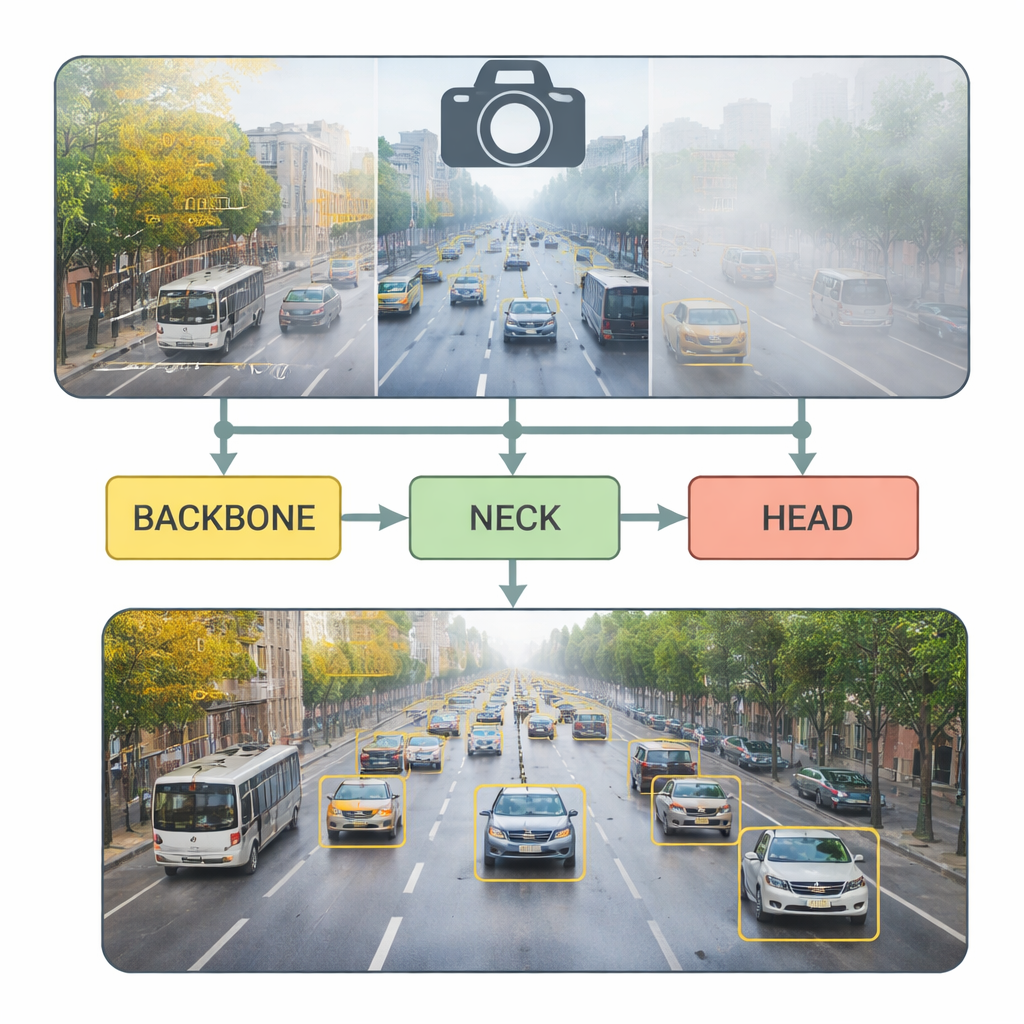

Cidades em expansão enfrentam vias congestionadas, mais acidentes e aumento de emissões. Sistemas de transporte inteligente prometem ajuda ao monitorar o tráfego em tempo real e orientar motoristas humanos e autônomos. O ingrediente central é a detecção de veículos em vídeo, rápida e confiável. Algoritmos “em duas etapas” anteriores analisam imagens em várias passagens e podem ser muito precisos, mas frequentemente são lentos demais para uso em tempo real em câmeras de via pública ou em veículos. Sistemas “em etapa única” mais recentes, como a família YOLO (“You Only Look Once”), trocam um pouco de complexidade por velocidade muito maior, tornando‑se populares na prática. Ainda assim, eles têm dificuldades com veículos pequenos, sobrepostos e com clima severo que oculta detalhes. O YOLO‑DC se baseia no modelo YOLOv8 mais recente e redesenha suas camadas internas para lidar melhor com esses desafios.

Como o YOLO‑DC enxerga mais com foco mais inteligente

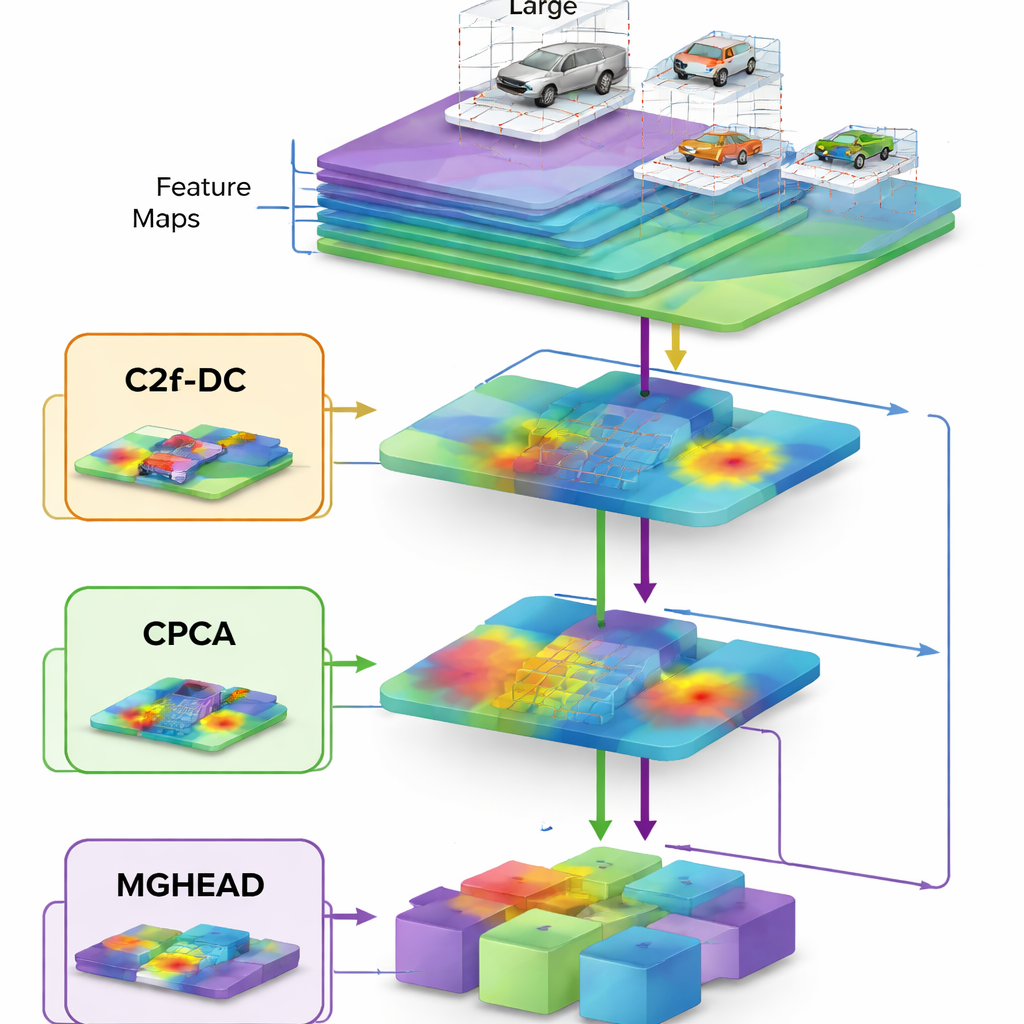

No coração do YOLO‑DC está uma espinha dorsal (backbone) reformulada, a parte que primeiro transforma imagens brutas em características abstratas. Os autores introduzem um mecanismo chamado atenção de coordenada entre canais, que ensina efetivamente a rede não apenas onde olhar na imagem, mas também quais tipos de padrões visuais merecem mais peso. Combinado com as chamadas convoluções deformáveis — filtros que podem curvar seu padrão de amostragem para acompanhar veículos inclinados ou de formas irregulares — essa espinha dorsal se adapta melhor a carros vistos em diferentes ângulos, escalas e posições. Em vez de tratar cada trecho de estrada igualmente, o sistema aprende a enfatizar os contornos e texturas indicativos que distinguem veículos reais de edifícios, árvores ou marcações viárias.

Capturando veículos pequenos e distantes sem perder velocidade

A parte intermediária do modelo, conhecida como neck, é responsável por fundir informações de visões amplas e desfocadas com detalhes próximos e finos. O YOLO‑DC aprimora essa etapa de duas maneiras. Primeiro, um módulo de atenção de priorização de canais ajuda a rede a suprimir ruído e destacar pistas sutis de veículos minúsculos e distantes no quadro. Segundo, um bloco redesenhado inspirado na arquitetura leve FasterNet reduz o número de operações aplicando convoluções completas apenas a uma parte dos dados e então misturando‑os de forma eficiente. Esse redesenho cuidadoso reduz tanto o número de parâmetros quanto o tráfego de memória, permitindo que o modelo rode mais rápido enquanto de fato melhora a precisão — uma combinação incomum, mas muito desejável, para dispositivos de borda como câmeras de trânsito e computadores embarcados em veículos.

Vendo veículos em várias escalas e em tempo ruim

A etapa final, ou head, decide onde estão os objetos e o que eles são. O YOLO‑DC introduz convoluções agrupadas multiescala aqui, dividindo os mapas de características em vários grupos de canais que usam diferentes tamanhos de filtro antes de serem recombinados. Isso dá ao detector uma sensação de escala mais rica, permitindo que reconheça grandes ônibus que ocupam o quadro, caminhões de porte médio e carros minúsculos mal visíveis ao longe, tudo ao mesmo tempo. Em testes extensivos no conjunto UA‑DETRAC, que contém cenas de estrada em condições nubladas, ensolaradas, chuvosas e noturnas, o YOLO‑DC igualou ou superou a precisão de detectores de ponta enquanto usava apenas uma fração de sua computação e processando centenas de quadros por segundo em hardware moderno. No conjunto DAWN, projetado especificamente para neblina, chuva, neve e tempestades de areia, o novo modelo entregou ganhos especialmente grandes em chuva intensa e neblina densa, onde sistemas tradicionais frequentemente falham.

O que os resultados significam para as vias do dia a dia

Para não especialistas, a mensagem principal é que o YOLO‑DC é melhor em “ver” o tráfego real como ele realmente é: lotado, bagunçado e frequentemente obscurecido por mau tempo ou iluminação precária. Ao combinar filtros flexíveis que acompanham as formas dos veículos com mecanismos de atenção que se concentram nas regiões mais informativas, o sistema detecta mais veículos, erra menos e roda rápido o suficiente para análise de vídeo ao vivo em hardware modesto. Isso o torna um bloco promissor para gestão de tráfego mais inteligente, monitoramento de acidentes mais confiável e direção autônoma mais segura — tudo isso mantendo os custos de processamento baixos o bastante para implantação ampla nas ruas da cidade e em veículos do futuro.

Citação: Liu, Z., Zhu, M., Gao, B. et al. YOLO-DC for vehicle detection using deformable convolutional networks and cross-channel coordinate attention. Sci Rep 16, 6284 (2026). https://doi.org/10.1038/s41598-026-37094-w

Palavras-chave: detecção de veículos, transporte inteligente, YOLO, tempo adverso, visão em tempo real