Clear Sky Science · pt

Deriva de interpretação em IA explicável sob ruído de rótulos

Por que as explicações de IA podem silenciosamente sair do rumo

Muitas pessoas hoje confiam na inteligência artificial não apenas por respostas, mas por razões: por que um empréstimo foi negado? Por que um sistema sinalizou um paciente como de alto risco? Este estudo mostra que, mesmo quando a precisão de um modelo de IA parece reassuringmente estável, a história que ele conta sobre por que tomou uma decisão pode derivar dramaticamente se os dados de treinamento contêm erros. Essa mudança oculta nas explicações — o que os autores chamam de “deriva de interpretação” — pode enganar profissionais que dependem da IA para justificar decisões importantes.

Quando dados limpos encontram rótulos bagunçados

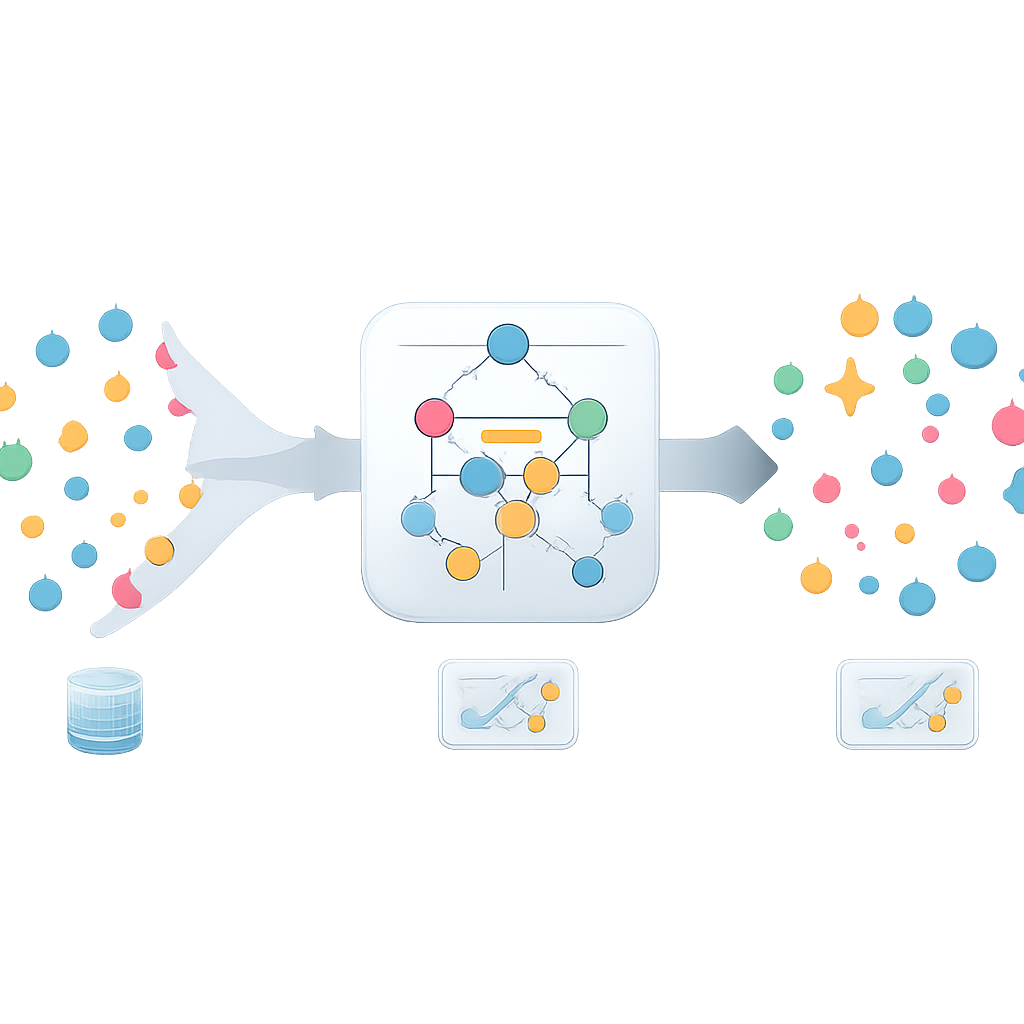

A maioria dos sistemas modernos de IA são “caixas-pretas”, oferecendo predições sem razões claras. Para tornar a IA mais transparente, muitas aplicações recorrem a modelos baseados em regras que se assemelham ao raciocínio humano do tipo se–então: por exemplo, “se a pressão arterial é alta e a idade é superior a 60, então o risco é alto.” Esses conjuntos de regras são particularmente atraentes em áreas sensíveis como saúde, direito e finanças, onde os usuários precisam inspecionar e confiar na lógica. Mas dados do mundo real raramente são perfeitos. Um problema comum é o ruído de rótulos — casos em que a suposta “resposta correta” nos dados de treinamento está errada, como um diagnóstico mal registrado ou um resultado de cliente mal rotulado. Embora se saiba que o ruído de rótulos prejudica a qualidade das predições, seu impacto na estabilidade das explicações de IA não havia sido estudado de forma sistemática.

Testando como as explicações resistem ao ruído

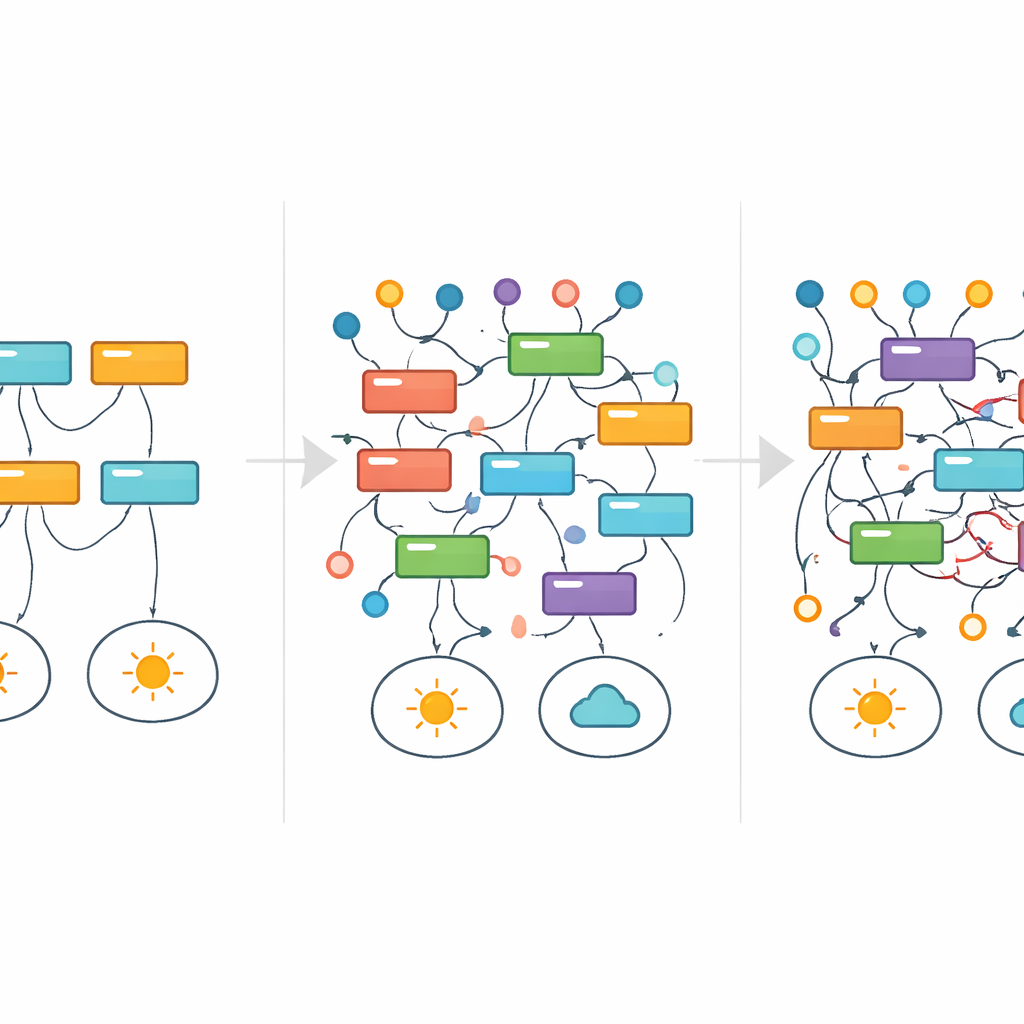

Os autores avaliaram quão robustas permanecem as explicações baseadas em regras quando os rótulos são gradualmente corrompidos. Eles usaram quatro conjuntos de dados diferentes de saúde, serviços financeiros, doença hepática e até teoria dos números, todos preparados como tarefas de previsão sim–não. Três métodos de aprendizado de regras foram comparados: dois algoritmos populares e rápidos (IREP e RIPPER) e uma abordagem mais intensiva computacionalmente chamada Human Knowledge Models (HKM), que visa explicitamente produzir conjuntos de regras muito simples, no estilo humano. Para cada método, os pesquisadores treinaram modelos repetidamente enquanto invertiam aleatoriamente uma fração crescente dos rótulos de treinamento — desde dados quase perfeitamente limpos até quase completo nonsense. Eles acompanharam duas coisas em paralelo: quão bem os modelos ainda previam em um conjunto de teste limpo e quanto as regras aprendidas mudaram em comparação com aquelas de dados isentos de ruído.

Precisão estável, lógica em fluxo

Na superfície, os resultados podem adormecer os usuários em um falso senso de segurança. Para níveis moderados de ruído, especialmente com o método HKM, o desempenho preditivo parecia relativamente estável quando medido pela comum pontuação F1. Ainda assim, um olhar mais atento aos conjuntos de regras contou uma história diferente. Usando uma medida de similaridade que compara coleções de regras, os autores descobriram que mesmo quantidades modestas de ruído de rótulos rapidamente corroeram a sobreposição entre as explicações originais e as ruidosas. Em outras palavras, o modelo pode ainda estar certo em muitos casos, mas por razões cada vez mais diferentes. Conjuntos de regras mais complexos foram especialmente frágeis: à medida que o número de condições em uma regra crescia, pequenas mudanças nos dados mais facilmente fraturavam ou substituíam essas regras, acelerando a perda de estabilidade interpretativa.

Acompanhando regras enquanto aparecem e desaparecem

Para visualizar como explicações individuais sobrevivem ou falham conforme o ruído aumenta, os pesquisadores emprestaram uma ferramenta da medicina: análise de sobrevivência. Em vez de acompanhar a sobrevivência de pacientes ao longo do tempo, eles rastrearam quanto tempo uma regra particular continuou a aparecer entre os melhores modelos à medida que o ruído de rótulos aumentava. Em vez de desaparecer gradualmente, muitas regras cintilaram — uma indicação de que explicações inteiramente diferentes podiam dominar em níveis distintos de ruído, mesmo para a mesma tarefa subjacente. Em um simples conjunto de dados de divisibilidade de números, por exemplo, regras limpas e matematicamente corretas foram gradualmente substituídas por aproximações mais amplas e, por fim, por padrões convolutos e aparentemente arbitrários que ainda se ajustavam aos rótulos corrompidos. Ao longo de grande parte desse processo, métricas de desempenho de destaque não sinalizaram claramente que algo estava errado.

O que isso significa para quem depende da IA

A mensagem central é que uma IA “confiável” não pode ser julgada apenas pela precisão. Mesmo modelos que apresentam sua lógica em regras legíveis por humanos podem silenciosamente mudar seu raciocínio quando os rótulos de que aprendem são imperfeitos — que é exatamente a situação na maioria dos bancos de dados do mundo real. Os autores argumentam que desenvolvedores e reguladores devem tratar a estabilidade das explicações como um requisito de primeira classe, ao lado da precisão e equidade. Novas métricas que medem diretamente quão consistentes permanecem as explicações de um modelo sob ruído, e ferramentas que alertem os usuários sobre a deriva de interpretação, serão essenciais se quisermos sistemas de IA cujas histórias sobre o mundo sejam tão confiáveis quanto suas predições.

Citação: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

Palavras-chave: IA explicável, ruído de rótulos, interpretabilidade de modelos, modelos baseados em regras, deriva de interpretação