Clear Sky Science · pt

Avaliação do estado funcional de mobilidade em prontuários eletrônicos usando grandes modelos de linguagem

Por que a capacidade de caminhar é um sinal de saúde poderoso

À medida que as pessoas vivem mais, os médicos estão prestando atenção não apenas em quanto vivemos, mas em quão bem conseguimos nos mover, caminhar e cuidar de nós mesmos. Dificuldades para levantar de uma cadeira, subir escadas ou se deslocar pela cidade costumam aparecer muito antes de uma crise médica. Ainda assim, as descrições mais detalhadas das habilidades diárias de uma pessoa geralmente estão enterradas em textos livres de notas de médicos e terapeutas nos prontuários eletrônicos, onde são difíceis de localizar por computadores. Este estudo explora se os modernos grandes modelos de linguagem — o mesmo tipo de IA por trás de muitos chatbots — conseguem ler essas notas de forma confiável e transformar descrições de movimento em informações estruturadas e pesquisáveis.

Transformando notas confusas em dados de mobilidade utilizáveis

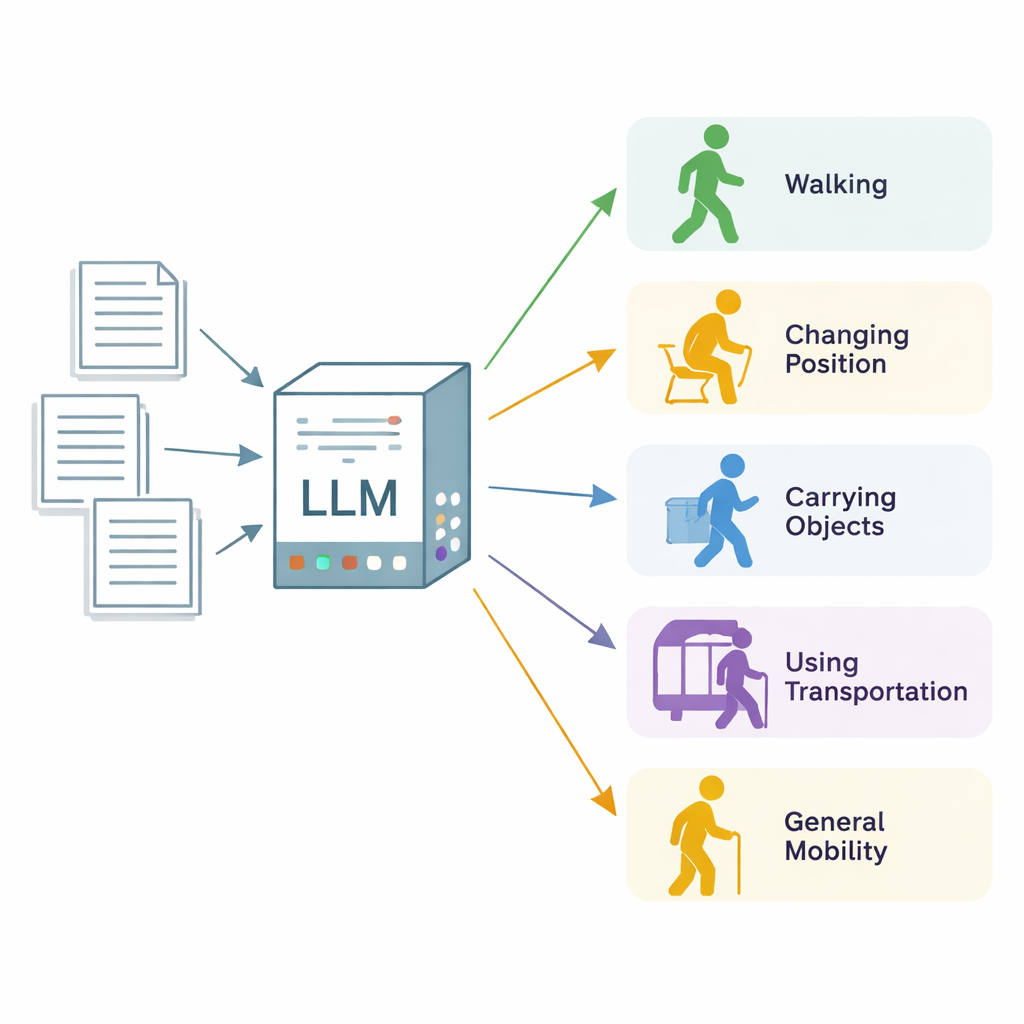

Os pesquisadores concentraram‑se em “estado funcional de mobilidade”, um termo amplo para o quanto uma pessoa consegue mudar de posição corporal, caminhar, carregar e manusear objetos, usar transporte e se locomover no dia a dia. Eles utilizaram 600 notas clínicas reais de três instituições de saúde de Minnesota e Wisconsin, a maioria de visitas de fisioterapia e terapia ocupacional, além de um conjunto de notas de clínica mais gerais. Anotadores especialistas vasculharam cada nota, seção por seção, e rotularam cada trecho que descrevia uma das cinco categorias de mobilidade, marcando se o paciente estava claramente limitado (“prejudicado”) ou funcionando normalmente (“não prejudicado”). Esses rótulos de especialistas serviram como padrão‑ouro para avaliar o sistema de IA.

Como o modelo de IA foi treinado para ler como um clínico

A equipe usou o Llama 3, um grande modelo de linguagem de código aberto, e o executou em servidores locais seguros para que os dados dos pacientes nunca saíssem do sistema de saúde. Em vez de treinar o modelo do zero, eles projetaram cuidadosamente prompts — conjuntos de instruções escritas e definições — para ensinar ao modelo o que procurar. Testaram prompts “zero‑shot”, que fornecem apenas instruções, e prompts “few‑shot”, que também incluem alguns exemplos de notas. Em seguida, analisaram onde o modelo errava e elaboraram um prompt “informado por erros” que explicava o que incluir, o que ignorar (como planos de tratamento futuros) e como lidar com casos complicados como quedas, tontura ou uso de cadeira de rodas. A IA foi solicitada, para cada seção de nota e cada categoria de mobilidade, se a mobilidade era mencionada e, em caso afirmativo, se o paciente estava prejudicado.

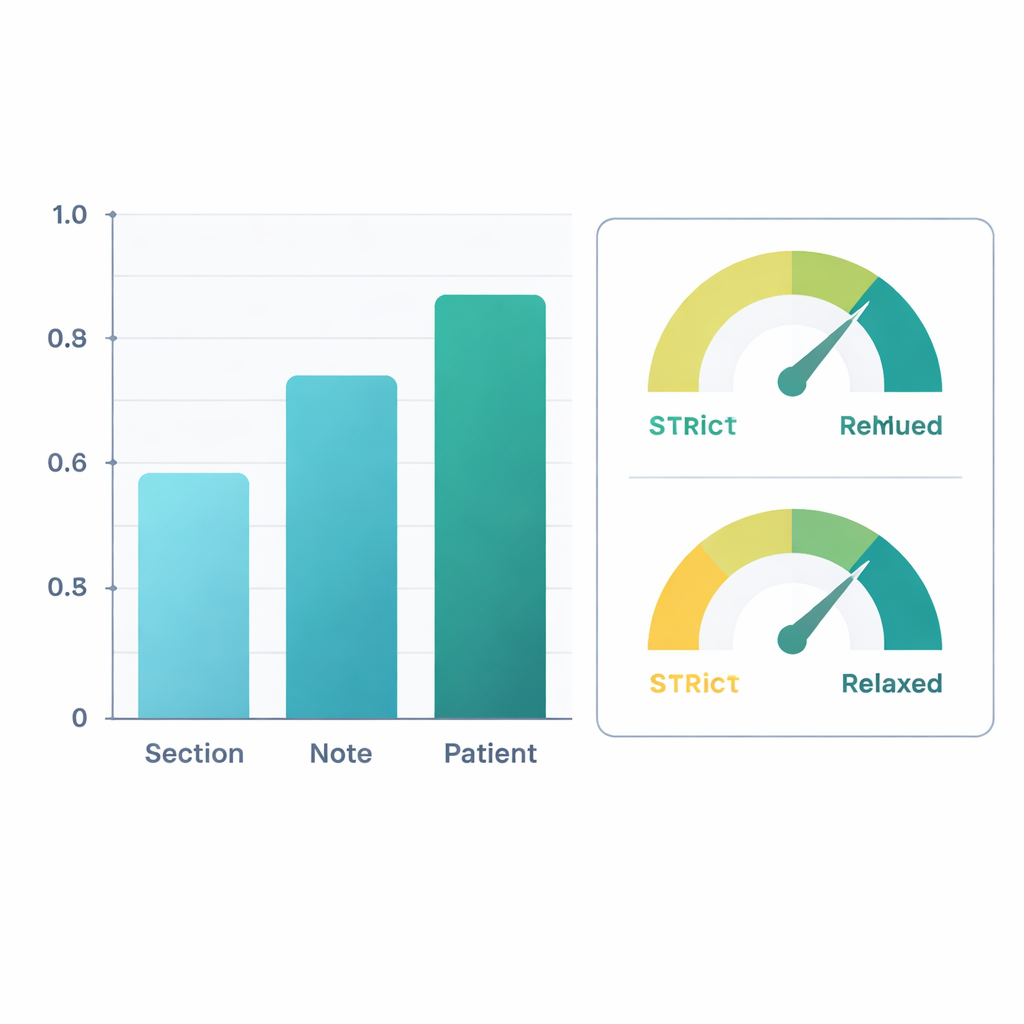

Bom desempenho que melhora ao nível do paciente

Quando avaliado em relação aos rótulos de especialistas, o sistema refinado teve bom desempenho. No nível do paciente — combinando informações de todas as suas notas — a IA alcançou uma pontuação F1 (uma medida comum de acurácia) de cerca de 0,88 para simplesmente localizar informações de mobilidade e 0,90 para decidir se a pessoa estava prejudicada. Isso significa que seus julgamentos corresponderam de perto aos dos revisores humanos. O desempenho foi um pouco menor ao analisar seções individuais das notas, onde a redação pode ser escassa ou ambígua, mas a acurácia melhorou conforme as informações eram agregadas por notas inteiras e depois por todas as notas de um paciente. Em uma segunda análise, os pesquisadores consideraram “inferências clinicamente razoáveis” como corretas — por exemplo, assumir que dor intensa no joelho ao caminhar provavelmente limita a caminhada, mesmo que não esteja declarado explicitamente. Sob essa visão mais permissiva, as pontuações F1 ao nível do paciente subiram acima de 0,96 para extração e 0,95 para classificação de limitação.

O que a IA errou — e por que isso ainda importa

A maioria dos erros surgiu do modelo interpretar nas entrelinhas. Frequentemente ele inferiu problemas de mobilidade com base em dor, tontura ou planos de terapia futuros, mesmo quando a nota não dizia claramente que o paciente estava limitado. Outros erros refletiram zonas cinzentas nas definições, como se quedas repetidas devem ser tratadas como problema ao caminhar ou problema de equilíbrio ao mudar de posição. A classe chamada “mobilidade, não especificada”, destinada a capturar atividades cotidianas e exercícios, foi especialmente difícil de delimitar. Apesar dessas questões, os erros costumavam ser sensatos do ponto de vista clínico, em vez de aleatórios ou absurdos. Ao rodar o modelo de forma determinística (sem aleatoriedade embutida) em servidores locais controlados, a equipe também garantiu que os resultados fossem reproduzíveis e que a privacidade dos pacientes fosse preservada.

Como isso pode mudar o cuidado com idosos

Para um leigo, a conclusão é que um sistema de IA agora pode ler notas rotineiras de médicos e terapeutas bem o suficiente para resumir quão bem os pacientes se movimentam e onde têm dificuldades. Isso significa que os sistemas de saúde poderiam acompanhar mudanças na caminhada, no equilíbrio e nas atividades diárias ao longo do tempo sem acrescentar novos questionários ou testes, sinalizar pessoas com alto risco de quedas ou internações e identificar quem pode se beneficiar de fisioterapia ou avaliações de segurança domiciliar. Ao converter milhões de notas em texto livre em dados estruturados de mobilidade, essa abordagem ajuda os médicos a enxergar o quadro maior de como o envelhecimento e as doenças afetam a vida cotidiana — aproximando a saúde de uma medicina verdadeiramente personalizada e centrada na função.

Citação: Liu, X., Garg, M., Jia, H. et al. Mobility functional status ascertainment in electronic health records using large language models. Sci Rep 16, 6045 (2026). https://doi.org/10.1038/s41598-026-37025-9

Palavras-chave: mobilidade, prontuários eletrônicos, grandes modelos de linguagem, estado funcional, IA clínica