Clear Sky Science · pt

Avaliação das vulnerabilidades de sistemas de marcha por meio de ataques adversariais gerados por PPO e GAN

Por que enganar um padrão de caminhada importa

A maioria de nós reconhece amigos e familiares pela forma como caminham, mesmo à distância. Computadores agora podem fazer algo parecido: sistemas de “reconhecimento de marcha” analisam o modo de andar de uma pessoa para identificá‑la sem impressões digitais ou escaneamento facial. Essas ferramentas são cada vez mais usadas em segurança e vigilância. Este estudo faz uma pergunta inquietante: quão fácil é enganar tais sistemas usando pequenas modificações cuidadosamente elaboradas que humanos não perceberiam — mas máquinas sim? A resposta tem grandes implicações para privacidade, segurança e o quanto podemos confiar na inteligência artificial em cenários de alto risco.

Como os computadores leem a forma como caminhamos

O reconhecimento de marcha moderno depende de aprendizado profundo, a mesma família de técnicas por trás do reconhecimento facial e de carros autônomos. Em vez de olhar para uma única imagem, esses sistemas combinam muitos quadros de uma pessoa caminhando em uma única “imagem de energia de marcha”, uma espécie de silhueta borrada que captura como as partes do corpo se movem ao longo de um ciclo completo de passo. Uma rede neural projetada especificamente aprende então a distinguir a marcha de uma pessoa da de outra, mesmo quando roupas ou objetos carregados mudam. Em testes em dois grandes conjuntos de pesquisa com vídeos de caminhada (os datasets CASIA‑B e OU‑ISIR), o modelo de referência dos autores identificou corretamente as pessoas em mais de 97% dos casos — desempenho forte que poderia sugerir que a tecnologia está pronta para uso no mundo real.

Os adesivos invisíveis que enganam câmeras inteligentes

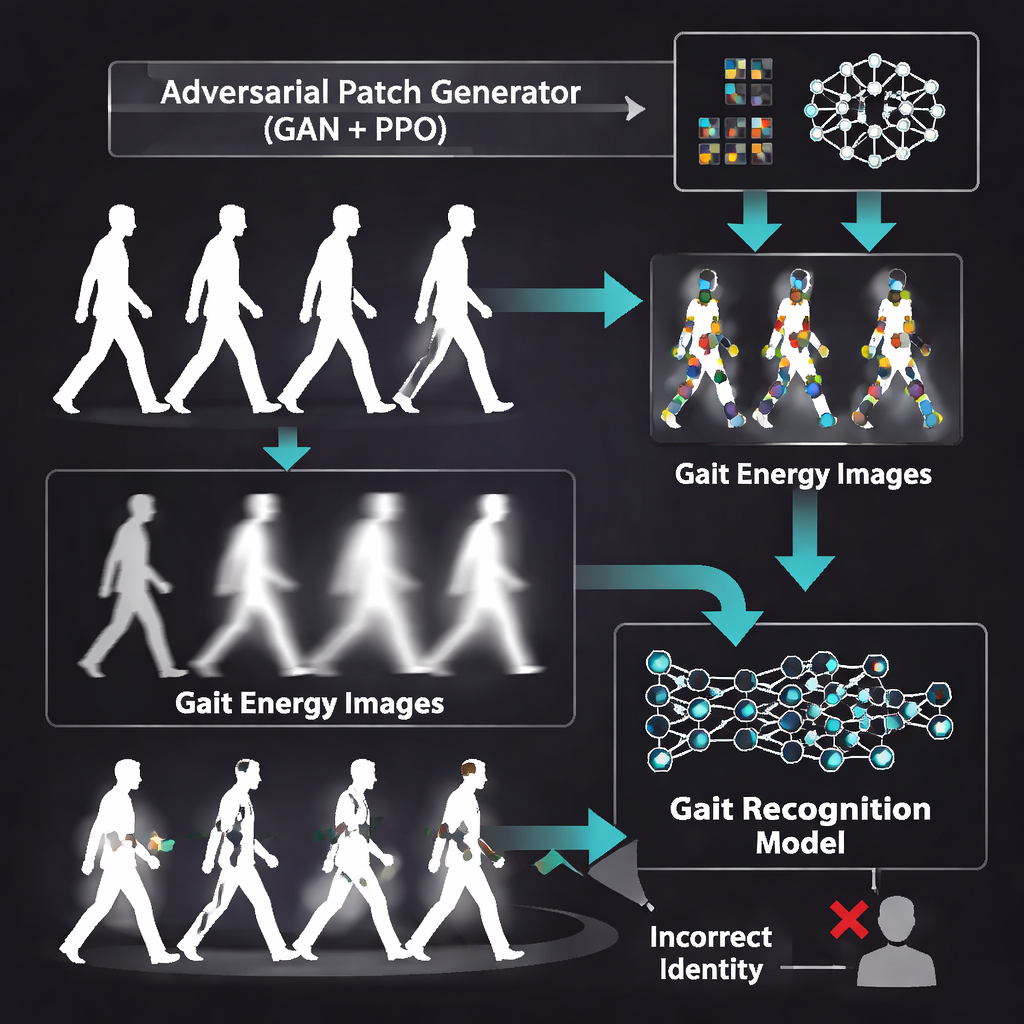

O cerne do artigo não é construir um sistema de identificação melhor, mas quebrá‑lo de propósito para expor suas fraquezas. Os pesquisadores geram pequenas “patches” adversariais — regiões quadradas de pixels alterados que parecem inofensivas, mas são matematicamente calibradas para confundir a rede neural. Para criar esses patches, eles usam uma Rede Adversarial Generativa (GAN), um tipo de IA que aprende a produzir imagens com aparência realista competindo contra um crítico interno. A GAN é treinada diretamente em imagens de energia de marcha para que sua saída se integre naturalmente às silhuetas fantasmagóricas. Esses patches são projetados para serem suficientemente sutis de modo que um observador humano, ao olhar para o padrão de caminhada, provavelmente não perceberia nada de estranho.

Deixando um agente de aprendizado encontrar os pontos fracos

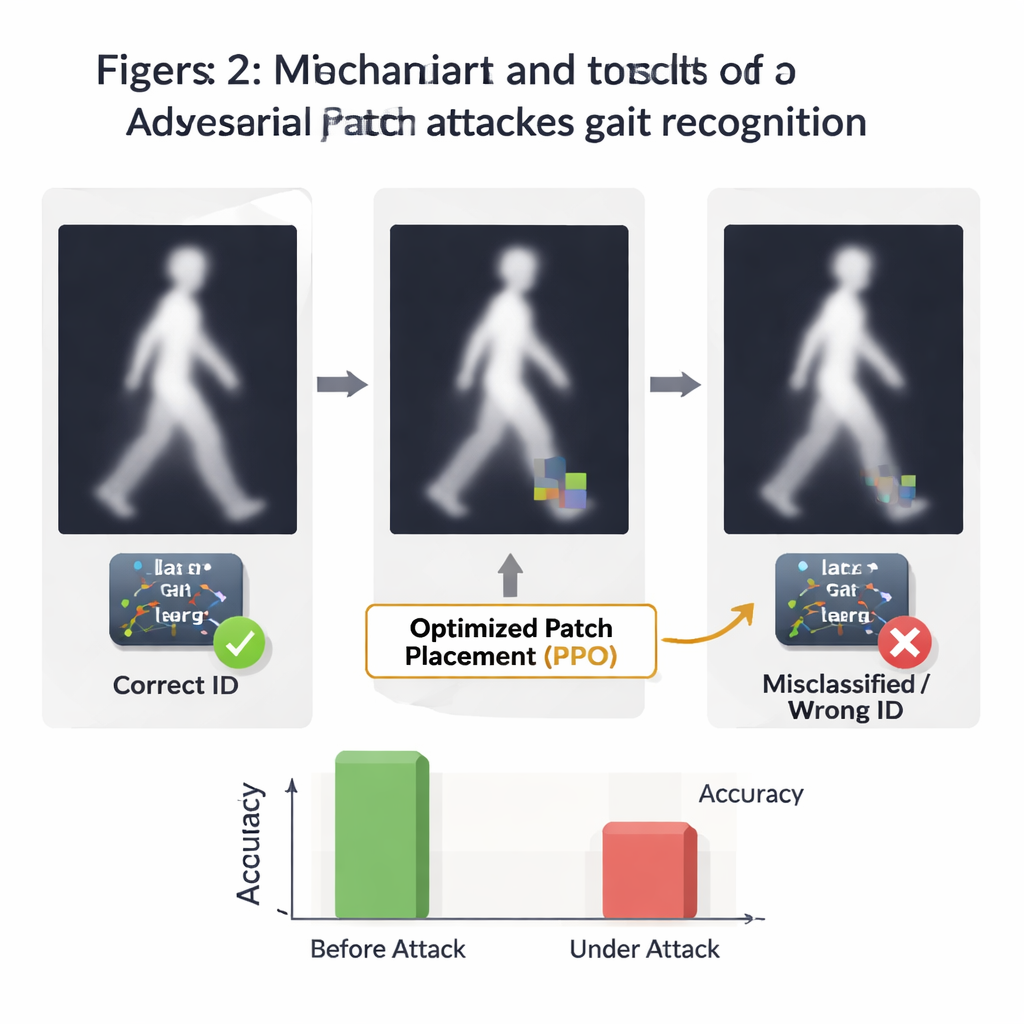

Onde um patch é colocado pode importar tanto quanto sua aparência. Para descobrir os locais mais danosos, os autores recorrem a um método de aprendizado por reforço chamado Proximal Policy Optimization (PPO). Eles tratam cada imagem de marcha como um ambiente em forma de grade e deixam um “agente” de software mover o patch — para cima, para baixo, para a esquerda ou para a direita — enquanto observa quanto cai a confiança do sistema de reconhecimento. Quando uma posição faz o modelo identificar a pessoa incorretamente, o agente é recompensado; quando falha, é penalizado. Ao longo de muitos episódios, o agente aprende uma política para posicionar patches em regiões especialmente vulneráveis da imagem de marcha, frequentemente próximo às partes do corpo em movimento das quais o modelo mais depende.

O que acontece quando o ataque é desencadeado

Após treinar tanto o gerador de patches quanto a estratégia de posicionamento, a equipe ataca seu próprio reconhecedor de marcha de alto desempenho. Em condições normais, o sistema apresenta excelente acurácia, poucos falsos alarmes e forte separação entre correspondências corretas e incorretas. Uma vez que patches adversariais são adicionados, porém, o desempenho cai drasticamente. Dependendo de quão agressivamente o patch pode se mover pela imagem, as taxas de sucesso do ataque ultrapassam 60%, e a fração de pessoas corretamente identificadas pode cair para quase um terço do nível original. Curvas que antes mostravam discriminação quase perfeita entre usuários genuínos e impostores afundam em direção à linha de adivinhação aleatória, revelando o quão facilmente o modelo pode ser desviado sem distorções visíveis.

O que isso significa para a segurança do dia a dia

Para não‑especialistas, a conclusão é clara: um sistema de reconhecimento de marcha que parece altamente preciso em laboratório pode ser surpreendentemente frágil diante de manipulações engenhosas desenhadas por máquinas. O estudo mostra que combinar ferramentas generativas de imagem com aprendizado por tentativa e erro pode produzir mudanças pequenas e quase invisíveis que causam erros sérios de identificação. Em vez de um manual para abuso no mundo real, o trabalho é pensado como um alerta e um quadro de testes. Ele oferece aos projetistas de sistemas uma maneira de sondar e medir quão vulneráveis são seus modelos, e ressalta a necessidade de construir defesas contra tais ataques antes que o reconhecimento de marcha seja amplamente confiado para vigilância, controle de acesso ou outras aplicações críticas.

Citação: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Palavras-chave: reconhecimento de marcha, segurança biométrica, ataques adversariais, aprendizado profundo, aprendizado por reforço